あなたの会社の財務状況を見てみれば、AIツールによって引き起こされたデータ漏洩に間接的に関連する隠れた損失があることに気づくでしょう。

今後、法的費用や失われた競争優位性が、あなたの最大の運用上の悪夢となる可能性があります。

- 主なポイント: 一部の企業は、AIツールからのデータ漏洩により、年間で300万ドル以上の損失を出していると推計しています。

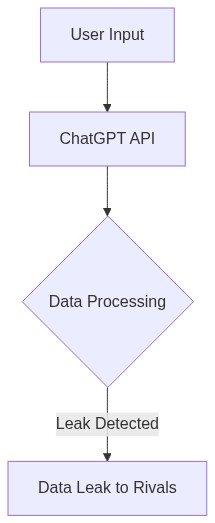

- 重要なポイント: ChatGPTの統合は一見無害に見えるが、多くの場合、曖昧な制限があるAPIに機密データを露出している。

- キーポイント: あなたのツールスタックを今すぐ監査して、もう一つの警告の事例になることを避けましょう。

フック/詐欺: ChatGPT—便利な幻想の背後に潜むデータの沼地

皆がAIの列車に飛び乗るのが早いこと、まるで現代産業の救世主かのように。しかし、その層を剥がしてみると、ベンダーたちはあなたのデータを守ることよりも、それを金の糸に変えて企業のマントにすることに熱心だということがわかる。現実は?「ChatGPTはビジネス戦略をスパイする競争相手たちの静かな見張り塔になった」とJohn CorcoranがHackerNewsで述べ、企業がリスクを評価するために大慌てする中で論争を引き起こした。同じ古い話だ:テクノロジーの誇大広告が実用的な欠点を覆い隠し、機密性がもはや安全であると感じられない。

より大きな視点では、APIの誤操作に対する不満のささやきが明らかになる。ディスカッションフォーラム全体に拡散したRedditのリークによると、「これらのAPIが厳格で明確に宣言されたファイアウォールなしにデータを吸い上げることができるのは、実際の問題です」 (source)。OpenAIが意図せずに共有したデータで競争を煽っている?

情報過多の深入り: APIの幕の隙間

深く掘り下げることが好きな人のための不安な技術的事実がここにあります—APIの制限はしばしば、特に指定されない限り、1分間に5,000回の呼び出しで広く設定されていることです。考えてみてください、これらの設定を調整するのは誰なのか?確実に日々の業務で手一杯の小さなチームではありません。TLS暗号化が当たり前だと思うだろう—もう一度考え直してください。多くの内部通信は暗号化されておらず、企業スパイ活動の完璧な舞台を整えています。

OpenAI自身のホワイトペーパーの行間を読むと、暗号化されたTLSが広範な文脈でのみ言及され、明示的なデフォルト設定にはほとんど触れられていません (source)。本質的に、ここにはデータの過剰のために設計されたシステムがあるのです、調整ではありません。未使用のスロットリング機能、未ラップのペイロード—傍受に簡単に弱い。中間者暗号化によるカスタムミドルウェアを導入するか、さもなければ重要なデータを銀の盛り皿に乗せて渡すことになります。

お金/仕事の影響: データ漏えいが解雇通知に等しいとき

ある朝会社からのメモを見て目覚めることを想像してください: 「侵害が発生し、解雇は避けられない」。この悪夢は企業が認めたがらない現実に近づいています。データ漏えいの平均的な金銭的損害は、IBMによると驚異の3.86百万ドルに達します (source)。その脆弱性の影は、より多くの企業がChatGPTをブラックリストに載せる理由です。それは悪循環となり、潜在的な露出がプロジェクトの縮小、時にはパイプラインの削減、そして確かに人々の削減を意味します。

そして、それが大企業だけが損をしていると思うなら、小さな会社もAI導入を控えており、その影響を受ける余裕がないため緊迫しています。特に契約中のエンジニアにとっては、二重の束縛です。割り当てを失うか、クライアントが「データ損失のバグ」に感染した後のダウンサイジングの一部になるリスクを負うかのどちらか。この雇用市場の調整は、開発者を絶え間ない不確実性の状態に置きます。

サバイバルガイド: 安全に、賢くプレイする

これはAIの沼地を生き抜くためのツールキットです。まず、あらゆる新しいAIツールに対して厳格な精査プロセスを開始しましょう—一度でなく、継続的な戦略として。それにAI使用ポリシーを確立し、重要なシステムを第三者のAPIから力強く分離しましょう。ファイアウォールルールでAIプロセスを隔離し、安全なサンドボックスに追いやり、徹底的に認定されたセキュリティ対策が開始されるまで、それらを敏感なデータパスから切り離しましょう。

緊急監査を直ちに開始する必要があります。30日間の猶予があります:ChatGPTのようなツールとの既存の統合を徹底的に精査しましょう。漏洩した企業のリストに名前が出始めたときに慌ただしくしないように。さもなければ、ビジネスを閉じる、得られないVC資金を求める、あるいは、あなたの技術的選択について何の発言権もなかったスタッフを解雇することになります。覚えておいてください、この新しい世界では、まず保護し、次に統合することです。

| 要因 | 潜在的利益 | 潜在的リスク |

|---|---|---|

| コスト効率 | タスクやプロセスの自動化による運用コストの削減 | データ漏洩やセキュリティ問題による予想外の出費 |

| データ処理 | 意思決定のためのデータ駆動インサイトの向上 | 不適切なデータ処理が競合他社へのデータ漏洩を引き起こす |

| イノベーション | AIサポートによるイノベーションサイクルの迅速化 | データ漏洩による知的財産の損失リスク |

| 競争優位性 | 最新のAI技術で先を行く | 競合他社があなたの運営状況に関する機密情報を手に入れるかもしれない |

| 顧客信頼 | パーソナライズされたインタラクションによる顧客サービスの向上 | データ漏洩による顧客信頼の喪失 |

| 規制遵守 | AIモニタリングを使用した業界基準の遵守 | データ保護法の不遵守による罰金や法的措置 |

一般の人々は、ChatGPTのようなAIシステムが完璧ではないことを認識する必要があります。私たちはそれらが真空状態で動作すると考えがちですが、それは違います。これらは、重要な情報を不注意にさらす可能性のある大量のデータセットに大きく依存しています。そして正直なところ、最新のAIを構築することに躍起になっているのに、蓄積する技術的負債を軽視しているのは大きな間違いです。バグや脆弱性は簡単にデータ漏洩につながります。私たちは、依然として多くの欠陥を抱えるシステムに過度に信頼を置いています。

**

見てください、技術を批判するのは簡単ですが、それを構築している最中ではそうもいきません。VC資金はAIに流れ込みます。それは、投資家がその変革的な可能性を見ているからです。需要に応じるには、時には迅速なプロトタイピングが必要です。確かにAPIのコストはありますし、リスクもありますが、それが安全プロトコルを置く理由です。大局的に見れば、AIは社会を前進させており、単に脆弱性を露呈するだけではありません。それは境界を押し広げる際に、すべての技術が採用する計算されたリスクです。

**

計算されたリスク?利益よりもデータの安全性が優先されるのはいつでしょうか?あなたはセキュリティプロトコルについて話していますが、これらのAIスタートアップのうち、何社が侵害に対して十分に準備できているのでしょうか?ChatGPTシステムは、個人データから企業秘密まで、敏感な情報を吸収し、再度吐き出すことが証明されています。これはお金を超えた問題です—エンドユーザーの知識なしに、倫理的な境界線が頻繁に越えられています。そして、忘れてはならないのは、その機密データが漏洩したとき、それが競合他社の手に渡ることであり、これは企業の誠実性を完全に損なうのです。

**

アドボケイトの言う通りです。VC資金をいくら注ぎ込んでも、これらの本質的な欠陥を軽減しない限り、単に紙の家を建てているだけです。これらのソフトウェアの欠陥は、不便をもたらすだけでなく、生計やプライバシーを危険にさらします。革新への競争が、堅牢で安全なコードの必要性を覆い隠してはなりません。データ処理の大幅な改善がなければ、次の大規模な侵害までただ時間を稼いでいるだけです。

**

人々は、うまくいく無数の実例よりも、うまくいかない数回の事例に焦点を当てる傾向があります。すべての技術的進歩には不確実性が伴い、学ぶにつれて調整が行われます。重要なのはデータ暗号化を改善し、リークを予測して阻止するリアルタイム監視ソリューションに投資することであり、進歩を完全に止めることではありません。AIで世界の大きな問題を解決しているのです—木を見て森を見失わないようにしましょう。

**

個人および企業の基本的なプライバシー権を保証できない場合、これらの進歩は誰のためにあるのでしょうか?オープンソースAIはコードに多くの目を向けますが、それは安全な実践に直結しません。システムの達成可能性を重視することでデータの扱いと安全性を軽視することは優先順位の誤りです。市場が、即効性よりも倫理基準を優先したときに初めて、私たちは本当に支持できる技術を目にすることができるのです。

根本的な問題はテクノロジー、個人、そしてそれを表現するデータに対する敬意に帰結します。

ChatGPTの真実?それは貪欲なデータ吸引機であり、あなたのささやきで競合他社を気付かぬうちに強化している可能性があります。膨大なデータが吸い上げられ、漏洩するリスクがあり、さらに悪いことに、無自覚のまま業界のライバルを強化しているかもしれません。2023年3月に起きた悪名高いOpenAIデータ漏洩事件を覚えていますか?それは、知識を持つ覗き屋がのぞくなら誰でもユーザーチャット履歴をさらけ出すものでした。CEOサム・アルトマンは認めました:「我々には重大な問題があった」;翻訳するなら—あなたのインテリジェンスは手に入れ放題だったということです。もっと不気味なのは、OpenAIの競合他社が1日あたり300万ドル相当のユーザーデータをチェックなしに貪っているかもしれないということです。

生存ガイド:すべてのキーストロークが誰かの王国のなかで破片であると仮定します。チームに敏感な情報の区切り方を訓練し、データ匿名化を強化してください—もし脅威が現実なら、それは妄想ではありません。そしてお願いですから、細かい文字を読みなさい。そうしなければ、あなたの次の偉大なアイディアはライバルのプレスリリースで挨拶してくるかもしれません。あるRedditユーザーが冷たく言っていました、「AIはただ聞くだけではなく、覚えている」と。賢く生きるか、忘れ去られるかです。