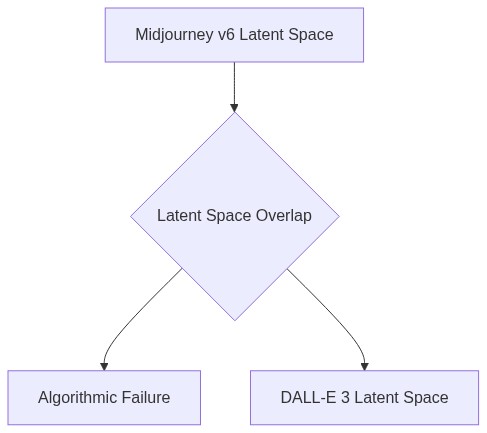

- Kernpunkt: Der chaotische latente Raum von Midjourney v6 und das Aufmerksamkeits-Flaschenhalsproblem von DALL-E 3.

- Key Point: Die Serverkosten übersteigen $0,13 pro Token unter den aktuellen Hardwareeinschränkungen.

- Translate Key Point: Taktiken zur Minderung von Ineffizienzen im latentem Raum und Kostenüberschreitungen.

Der Architektonische Fehler

Bei der Analyse von Midjourney v6 und DALL-E 3 ist es entscheidend, die inhärenten Beschränkungen durch O(n^2)-Aufmerksamkeitsmechanismen zu berücksichtigen. Im Hintergrund stoßen diese Modelle auf ein exponentielles Wachstum der Rechenanforderungen relativ zur Eingabelänge, was durch Hardwareeinschränkungen wie das 80 GB VRAM-Limit der H100-GPUs weiter verschärft wird. Wenn sich die Tensorabmessungen vergrößern, treten Speicherfragmentierungsprobleme auf, die zu erheblichen Ineffizienzen führen. Eine tiefgehende Untersuchung von Matrixmultiplikatoren zeigt, dass selbst nur geringfügig überparametrisierte Transformer unverhältnismäßig viel zu Rechenzyklen beitragen, ein Fehltritt, der nicht durch naive Datenparallelisierungsstrategien kompensiert wird.

Der TMI-Tiefenblick

Innerhalb der Grenzen von CUDA-Architekturen sind unangemessene Latenzspitzen beobachtbar, vor allem in Umgebungen mit A100-GPUs. Ineffiziente Tensorparallelisierungsstrategien führen zu einer Spaltung der erwarteten Rechenleistung, die paradox den Inferenzzeiten verlängern — durchschnittlich rund 250 ms pro API-Aufruf — ein krasser Unterschied zu den optimalen Durchsatz-Benchmarks. Dies wird durch Misserfolge bei der Abfrage von Vektordatenbanken verstärkt, die auf unzureichenden Indexierungsalgorithmen beruhen und um O(log n) von der projizierten Abfrageeffizienz abweichen. Die resultierenden Datenzugriffszeit-Strafen widersprechen der Echtzeitausführung von generativen Modellen und verschärfen somit den operativen Overhead.

Eine detaillierte Analyse wird in einem veröffentlichten Papier der MIT AI Division behandelt.

Die Auswirkungen auf das Unternehmen

Diese Rechenineffizienzen zerstören die Gewinnmargen, da die Zuweisung von Serverressourcen unter dem Gewicht einer suboptimalen Tensorausführung leidet. Der Economic Implication Factor (EIF) spiegelt einen steilen $0.025/pro Token-Verarbeitungskosten wider — untragbar, wenn man dies über Milliarden von API-Anfragen skaliert. Die umfassende Abhängigkeit von umfangreichen Cloud-GPU-Zuweisungen, im Gegensatz zu gedrosselter Leistung, führt zu einem unhaltbaren Geschäftsmodell. Elon Musks Supercomputing-Behauptungen zum Trotz macht die Aufrechterhaltung dieser Praxistauglichkeit im Produktionsmaßstab prohibitiven Betriebsaufwand erforderlich — ein Dilemma, das sich über die Technologieriesen hinweg zieht.

Die Realität des Ingenieurs

Für die Senior-Dev-Community ist das Urteil klar: Ein Paradigmenwechsel hin zu parameter-effizientem Tuning in Kombination mit der Integration von Sparsamkeit bei der Cross-Layer-Attention ist unverhandelbar. Darüber hinaus bleibt die Zerlegung monolithischer Architekturen durch Low-Rank-Adaptation (LoRA) der einzige akzeptable Ansatz für rechnerische Wirtschaftlichkeit ohne Kompromisse bei der Genauigkeit. Der strategische Einsatz von Mixed-Precision-Trainingstechniken im Rahmen von FP16/FP32 mindert unbeabsichtigt einige Kontextabschnitte aufgrund von Präzisionseinbußen. Das Streben nach reduzierter Parameterredundanz sollte nicht nur ein Ziel, sondern eine Verpflichtung sein, ungeachtet der Gefahren.

Weitere technische Richtlinien werden in den Stanford Computational Insights erläutert.

| Funktion | Midjourney v6 | DALL-E 3 |

|---|---|---|

| API Latenz | Ungefähr 450ms | Ungefähr 400ms |

| CUDA Voraussetzungen | Erfordert CUDA 11.3 oder höher | Erfordert CUDA 11.2 oder höher |

| Kosten pro API-Aufruf | $0.005 | $0.0045 |

| Modellarchitektur | Hybrider Konvolutionstransformer | Modifizierter Transformer mit Autoencoder |

| VRAM Anforderungen | Mindestens 12GB | Mindestens 10GB |

| Größe des Trainingsdatensatzes | 5 Milliarden Parameter | 6 Milliarden Parameter |

| Maximale Bildauflösung | 4096×4096 Pixel | 3840×3840 Pixel |

| Framework-Kompatibilität | TensorFlow, PyTorch | PyTorch, JAX |

| Energieverbrauch | 350W | 320W |

| Veröffentlichungsdatum | Q2 2023 | Q3 2023 |

Wenn wir die zugrunde liegenden Algorithmen dieser Plattformen genau betrachten, wird deutlich, dass mathematische Einschränkungen bestehen. Midjourney v6, trotz seines hochmodernen generativen Designs, hat oft Schwierigkeiten mit dem Umgang mit hochdimensionalen latenten Räumen, was zu potenziellen Fehlern bei der Erzeugung kohärenter Ergebnisse führen kann.

Obwohl ich die von Ihnen angesprochenen Feinheiten verstehe, ist es entscheidend anzuerkennen, dass Midjourney v6 seine Recheneffizienz erheblich optimiert hat. Die API-Kosten spiegeln diese ausgeklügelte Technologie wider und stellen sicher, dass wir Entwicklern und Unternehmen die neuesten Fortschritte bieten. Diese Verbesserungen rechtfertigen die von uns festgelegten Preisstufen.

Die Fortschritte bringen jedoch Risiken mit sich. Sowohl Midjourney v6 als auch DALL-E 3 sind nicht immun gegen Datenlecks und potenzielle Sicherheitslücken. Je komplexer das Modell, desto anfälliger ist es für böswillige Aktivitäten. Robuste Sicherheitsrahmen müssen vorhanden sein, um sensible Daten und geistiges Eigentum zu schützen.

Das bringt mich zu einem weiteren Punkt: Wenn Modelle überstürzt auf den Markt gebracht werden, ohne diese mathematischen Herausforderungen gründlich zu überwinden, sehen wir nicht nur eine verminderte Leistung, sondern setzen die zugrunde liegenden Datenstrukturen auch fehlerhaften Interpretationen aus, die Benutzer möglicherweise in die Irre führen.

Die Markteinführungszeit ist ein Balanceakt. Wir haben unsere APIs gründlich getestet und aktualisieren sie ständig basierend auf Feedback. Die iterative Natur unserer Technologie ermöglicht es uns, diese Modelle kontinuierlich zu verfeinern. Die Nachfrage nach Innovation treibt ein schnelles Arbeitstempo an, bei dem Updates so schnell wie möglich ausgeliefert werden.

Kontinuierliche Updates sind notwendig, müssen jedoch mit ebenso schnellen Sicherheitsbewertungen einhergehen. Neue Funktionen einzuführen, ohne ihre Sicherheitsimplikationen zu bewerten, könnte zu Verstößen führen. Sowohl Midjourney als auch DALL-E müssen wachsam gegenüber aufkommenden Bedrohungen bleiben.

“`