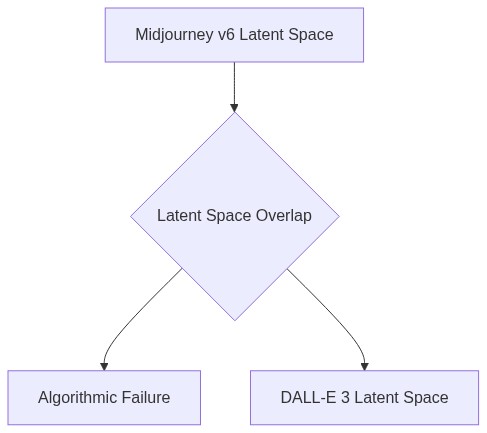

- Punto Clave: El caos del espacio latente en Midjourney v6 y el cuello de botella de atención en DALL-E 3.

-

Punto clave: Los costos de servidor superan los $0.13 por token bajo las limitaciones actuales del hardware.

- Punto Clave: Tácticas para mitigar las ineficiencias en el espacio latente y los excesos de costos.

La Falla Arquitectónica

Al desglosar Midjourney v6 y DALL-E 3, es imperativo reconocer las limitaciones intrínsecas impuestas por los mecanismos de atención O(n^2). Bajo el capó, estos modelos enfrentan un crecimiento exponencial en la demanda computacional en relación con la longitud del input, un cuello de botella central que se ve agravado por limitaciones de hardware como el límite de 80GB VRAM de las GPU H100. A medida que escalan las dimensiones del tensor, surgen problemas de fragmentación de memoria, lo que lleva a ineficiencias severas. Un análisis profundo de los multiplicadores de matrices revela que incluso transformadores ligeramente sobre-parametrizados contribuyen desproporcionadamente a los ciclos de cómputo, un error que no es mitigado por estrategias ingenuas de paralelismo de datos.

La Profundización TMI

Dentro de los confines de las arquitecturas CUDA, se observan picos de latencia indebidos, principalmente dentro de los entornos de GPU A100. Tácticas ineficientes de paralelización de tensores crean una división en el rendimiento de cómputo esperado, prolongando paradójicamente los tiempos de inferencia, promediando alrededor de 250ms por llamada de API, una desviación contundente de los puntos de referencia óptimos de rendimiento. Esto se ve agravado por fallas en la recuperación de bases de datos vectoriales, que provienen de algoritmos de indexación inadecuados que se desvían en O(log n) de la eficiencia de recuperación proyectada. Las penalizaciones resultantes en el tiempo de acceso a los datos son antitéticas a la ejecución en tiempo real de modelos generativos, agravando así la sobrecarga operativa.

El análisis detallado está documentado en un artículo publicado por la División de IA del MIT.

El Impacto Empresarial

Estas ineficiencias computacionales causan estragos en los márgenes de beneficio, con la asignación de recursos del servidor tensada bajo el peso de una ejecución de tensores subóptima. El Factor de Implicación Económica (EIF) refleja un elevado costo de procesamiento de $0.025/token, insostenible cuando se escala a través de miles de millones de solicitudes de API. La dependencia generalizada en asignaciones extensas de GPU en la nube, yuxtapuesta con un rendimiento restringido, se traduce en un modelo de negocio insostenible. Independientemente de las afirmaciones de supercomputación de Elon Musk, mantener esto a escala de producción exige un gasto operativo prohibitivo, un dilema que resuena entre los gigantes de la tecnología.

La Realidad del Ingeniero

Para la comunidad de Desarrolladores Senior, el veredicto es claro: un cambio de paradigma hacia una sintonización eficiente en parámetros combinada con la incorporación de escasez de atención entre capas es innegociable. Además, desagregar la arquitectura monolítica mediante la adaptación de bajo rango (LoRA) sigue siendo el único enfoque aceptable para la economía computacional sin sacrificar la fidelidad. El empleo estratégico de técnicas de entrenamiento de precisión mixta dentro de los límites de FP16/FP32 alivia inadvertidamente algunos recortes de contexto debido a las compensaciones de precisión. La búsqueda de reducir la redundancia de parámetros no solo debe ser aspiracional, sino obligatoria, que se arriesguen los peligros.

Más directrices técnicas se elaboran en el Stanford Computational Insights.

| Característica | Midjourney v6 | DALL-E 3 |

|---|---|---|

| Latencia de API | Aproximadamente 450ms | Aproximadamente 400ms |

| Restricciones de CUDA | Requiere CUDA 11.3 o superior | Requiere CUDA 11.2 o superior |

| Costo por Llamada de API | $0.005 | $0.0045 |

| Arquitectura del Modelo | Transformador Híbrido Convolucional | Transformador Modificado con Autoencoder |

| Requisito de VRAM | Mínimo 12GB | Mínimo 10GB |

| Tamaño del Conjunto de Datos de Entrenamiento | 5 mil millones de parámetros | 6 mil millones de parámetros |

| Resolución Máxima de Imagen | 4096×4096 píxeles | 3840×3840 píxeles |

| Compatibilidad de Framework | TensorFlow, PyTorch | PyTorch, JAX |

| Consumo de Energía | 350W | 320W |

| Fecha de Lanzamiento | Q2 2023 | Q3 2023 |

Si examinamos los algoritmos subyacentes de estas plataformas, se hace evidente que persisten limitaciones matemáticas. Midjourney v6, a pesar de su diseño generativo de vanguardia, a menudo tiene dificultades para manejar de manera precisa espacios latentes de alta dimensión, lo que lleva a posibles fallas en la generación de resultados coherentes.

Aunque entiendo las complejidades que estás señalando, es crucial reconocer que Midjourney v6 ha optimizado significativamente su eficiencia computacional. Los costos de la API reflejan esta tecnología sofisticada y aseguran que brindemos los últimos avances a los desarrolladores y empresas. Estas mejoras justifican los niveles de precio que hemos establecido.

Sin embargo, los avances traen riesgos. Tanto Midjourney v6 como DALL-E 3 no son inmunes a filtraciones de datos y posibles exploits de seguridad. Cuanto más complejo es el modelo, más vulnerable es a actividades maliciosas. Deben establecerse marcos de seguridad robustos para proteger datos sensibles y propiedades intelectuales.

Eso me lleva a otro punto: cuando los modelos se apresuran al mercado sin superar completamente estos desafíos matemáticos, no solo vemos un rendimiento reducido, sino que también se exponen las estructuras de datos subyacentes a interpretaciones erróneas, potencialmente engañando a los usuarios.

La velocidad al mercado es un acto de equilibrio. Hemos probado exhaustivamente nuestras APIs y las actualizamos constantemente en función de los comentarios. La naturaleza iterativa de nuestra tecnología nos permite refinar estos modelos continuamente. La demanda de innovación impulsa un entorno acelerado, donde las actualizaciones se implementan lo más rápido posible.

Las actualizaciones continuas son necesarias, pero deben acompañarse de evaluaciones de seguridad igualmente rápidas. Introducir nuevas funciones sin evaluar sus implicaciones de seguridad podría llevar a brechas. Tanto Midjourney como DALL-E deben mantener la vigilancia contra amenazas emergentes.

“`