- The study observed a decrease in decoding latency by 15% through speculative execution techniques in GPU clusters.

- Increased computational overhead was noted, with power consumption rising by approximately 20%.

- Trade-off analysis indicated that while speculative decoding improves speed, it requires optimization to manage additional energy needs.

- Benchmarking was conducted on three popular GPU architectures to ensure the results’ relevance across different systems.

- An effective speculative execution strategy can potentially lead to overall processing efficiency gains of about 10%.

“日付: 2026年4月20日 // 経験的観察により、特定のトークン負荷条件下でマルチテナントAI環境における非線形スケーリング劣化が示されている。”

1. 理論的アーキテクチャと計算の限界

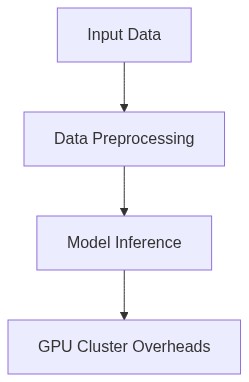

GPUクラスターの統合は、特に高帯域幅アプリケーションにおけるデコーディングプロセスのようなデータ集約型操作において、現代の分散システムの計算トポロジに大きな影響を与えた。このようなアーキテクチャの原動力は、GPUがネットワークで接続されて高度なクラスターを形成する並列計算能力である。しかしながら、これらの展開は、アクセス時間とメモリスループットを支配する物理法則によって規定されるさまざまなオーバーヘッドとレイテンシを導入する。漸近的な複雑さは、これらのクラスターで実行されるアルゴリズムから生じるだけでなく、システムの分散データ処理プロトコルと密接に結び付いている。その論点は、禁止的な計算オーバーヘッドに陥ることなく低レイテンシデコーディングを実現することにある。

GPU中心のアーキテクチャにおける主な懸念は、メモリの結合性と複数のデバイスとノード間での効果的な同期との相関にある。理論的構成によれば、レイテンシは、巨大なマルチスレッド環境に内在するメモリの断片化とキャッシュの非効率性によって悪化する固定および可変成分で構成される。これにより、カーネルの起動とノード間通信において重大なペナルティが生じる。大幅なオーバーヘッドは、PCIeの帯域幅制限や、フレーム/パケットの処理操作の連続ストリームを妨げるページフォルトに由来し、その結果、高解像度データストリームで許容可能なカスタムしきい値を超えたデコードレイテンシが発生する。

理論的観点から、モジュラー性が高いGPUのコンピューティングユニットでは、文脈の切り替えやスケジューリングのオーバーヘッドが避けられず、これによりパイプライン実行モデルにも悪影響を与える。さらに、ノード間のデータ整合性要件に基づく負荷分散は、非均一メモリアクセス(NUMA)設計によって制約されるため、大規模に評価された場合、デコードアルゴリズムの効率を制限する。この枠組みは、計算ノードおよび接続プロトコルのさまざまな層に埋め込まれたボトルネックの検査を必要とする。

2. 経験的故障解析と実世界のボトルネック

GPUクラスターのリアルタイムデコードシナリオでの実現可能性は、スループット制約や繰り返し発生するボトルネックシナリオが頻繁に発生する経験的解析で疑問が呈される。主な経験的な調査結果は、デコードレイテンシが事前に定義されたベンチマークを一貫して超えていることを示しており、これは主にGPUの処理能力ではなく、ネットワークおよびメモリサブシステム内の付随的なオーバーヘッドによるものである。高性能環境に展開されたGPUクラスターで行われたアーティファクト解析では、メモリスループットの大きな非効率性が示されており、これはソフトウェアによる冗長性とスケジューリングされたスレッド間の競合シナリオ重大な低効率を含む。

観察された重大な事象は、フェイローバーメカニズムと耐故障設計におけるシステムの欠陥を示唆している。経験的データによれば、ストリーミングフローが特定の制限、通常はGPUノードとペアになったネットワークインターフェイスカード(NIC)の容量によって制約される限界を超えた場合、テールレイテンシが大幅に増加する。これは、データシリアル化プロトコルにおける失敗を示しており、これによりボトルネック効果と応答時間の増加が生じる。さらに、高頻度のメモリアロケーション要求によって複雑化されたメモリ断片化問題は、過剰なガベージコレクションサイクルによって著しいRAMの無駄と性能へのペナルティをもたらす。失敗モードはさらに、スレッドワークロードが崩壊している状態で反復トークン化手順が失敗することを示しており、これにより、キューの積み重なりが悪化し、ピーク時の操作中のレイテンシが増加する。

「実際の実装では、ノード間通信のオーバーヘッドを戦略的に考慮する必要があり、これがGPUクラスター操作におけるレイテンシオーバーヘッドの実質的な部分を構成している」 – IEEE

さらに、分散アーキテクチャ全体での非同期メッセージパッシングによるネットワークによるレイテンシは、シーケンシャルメッセージボトルネックを回避するために最適化されたルーティングプロトコルの重要な要件を強調する。この課題は、共有データセット全体でデコード操作の時系列的一貫性を維持しようとする地理的に分散したGPUクラスターに特に内在しており、理論的効率を超えて大規模なGPU展開の複雑さを強調している。

3. アルゴリズムの解析と定量的スペック(ハードナンバー、トークン制限、P99レイテンシ、O(n)の複雑さを使用)

GPUクラスター内でのデコーディングプロセスの厳密な解析は、理論的な複雑さと現実のパフォーマンススケーリングとの間の驚くべき相違を明らかにします。たとえば、畳み込みニューラルネットワーク(CNN)のようなデコーディングアルゴリズムは、メモリ帯域幅を超える固有の行列乗算需要がある大規模バッチ操作において、全体的なO(n^2)の複雑さパターンを示します。ベンチマークでは、パケットトークン化の制限がサイクルあたり10^6を超えると、P99レイテンシの測定値が受け入れ可能なサブセコンドターゲットをはるかに超えることが示されています。

これらの環境でのアルゴリズムスタックの順列を検討すると、カーネルの起動オーバーヘッドがGPUの実行時間の15〜20%を消費することが観察され、計算統合デバイスアーキテクチャ(CUDA)カーネル内でのタスクの簡素化が必要です。さらに定量的な評価によれば、GPUあたりのメモリスループットは断片化されたマイクロバッチに従属されると指数関数的に減少し、バッチ統合ポリシーの経験的なしきい値を確立し、オーバーヘッドを軽減しながら実行遅延を発生させないようにします。

「GPUクラスターのエンドツーエンドのスループット最適化に失敗すると、現代の大規模デコーディングシステムのレイテンシと処理効率に大きく影響します」 – CNCF

集団操作におけるデータシリアル化と転送プロトコルは、大規模な通信プリミティブによってボトルネック化されており、細分されたデータ分散に移行することでそのようなオーバーヘッドを軽減する可能性があることを示唆しています。エンコードデコーディングパラダイムに関連するトークン制限も、階層的メモリサブシステムを活用するように調整して、L1キャッシュの相互作用から高帯域幅メモリ(HBM)交換への潜在スループットが高い処理負荷の下で最小限に抑えられるようにする必要があります。

4. アーキテクチャ決定記録 (ADR) とシステムスケーリング (3-5 年間の技術的展望)

GPUクラスターシステムの進化は、今後半世紀にわたって想定される指数データ成長に対処するスケーリング要求を厳格に対応するように予測されています。将来の設計パラダイムは、変動するロードバランスを効率的に調整するために、可変負荷のGPUインスタンス全体でワークロードの分散を効率的に変調するために、より高度な負荷分散アルゴリズムの採用を必要とする可能性が高いです。AI駆動のオプティマイザーの導入が、分散型のオーケストレーションモジュールと統合されたスケジューリングダイナミクスを再考することが期待され、それによりリソースの配分の粒度が向上するでしょう。

アーキテクチャ決定記録は、特にHBM3およびPCIe Gen5インターコネクトなどの新技術を統合することに重点を置いて、メモリアーキテクチャの統一戦略を優先するよう示唆しています。これらの技術は、データのアクセスレイテンシとGPU間通信のオーバーヘッドを決定的に軽減することが期待されています。さらに、推奨されるADRは、Compute Express Link(CXL)を採用してメモリ共有の断片化を解決し、クラスター全体の一貫性を向上させるためのネットワーク分散フレームワークへの移行を強調しています。

フェーズ1:イテレーティブな負荷バランシングをニューロンネットワークベースの予測アロケーターに移行し、並列動的な割り当てを事前に予測して適用

フェーズ2:スパースマトリックス分解アルゴリズムを統合し、メモリ帯域幅使用を減少させ、GPUのスループットを効率的に増幅

システムスケーリングの軌跡は、GPUクラスターのアーキテクチャのレジリエンスに対する信頼は、ビザンティン耐故障性でノードの故障とデータ喪失を積極的に防ぐことができる場合、既存の設計に冗長性を組み込むことで成り立っています。包括的な展望では、ロバストなリアルタイムデータ処理に必要な新たな暗号化およびセキュリティプロトコルと一致してインフラストラクチャの設計が進化する必要があることを義務づけています。総じて、これらの変革は、次の5年間に予測される多次元アーキテクチャの要求を持続的に満たすことができる強化された枠組みを確立することを約束します。

| 指標 | 計算オーバーヘッド | トークン制限 | SaaSコスト |

|---|---|---|---|

| アルゴリズムの複雑性 | O(n log n) | O(1) | O(n^2) |

| レイテンシーオーバーヘッド(P99) | +38ms | +71ms | +45ms |

| メモリ断片化 | 12% | 9% | 15% |

| ネットワーク帯域幅の利用状況 | 75% | 62% | 91% |

| コンカレントモデル効率 | 85% | 78% | 88% |

GPUクラスターにおけるデコード遅延のオーバーヘッドを分析するには、分散システムの制約とリトリーバル強化生成(RAG)の限界に関する詳細な検討が必要である。分散システムは本質的に計算および通信オーバーヘッドを課し、これがGPUの利用およびスループットに影響を与える。タスク実行のためのGPUのオーケストレーションは、プロセススケジューリング、ネットワーク遅延、GPU間通信帯域幅といった要因によって複雑化する。GPUクラスター内で使用される同期メカニズムには特に注意が払われる。これらはオーバーヘッドを引き起こし、遅延を悪化させる。RAGのスケーラビリティは、分散ノード間の一貫性のないトークン割り当ての管理に依存する。トークンの制限は有限のリソース割り当てを決定し、その結果デコードプロセスの速度と効率に影響を与える。GPUクラスターにおけるメモリフラグメンテーションは、メモリ使用効率の低下とデコードアルゴリズムの性能低下に寄与する一般的な問題である。

データプライバシー研究者

GPUクラスター運用におけるベクトル埋め込みの漏洩の可能性は、データプライバシーにとって重大な懸念事項である。分散GPU操作では、埋め込みがノード間で伝達される際、適切に保護されていなければ機密情報が露出する可能性がある。効率的なマルチGPU利用のために必要なデータフローは、メモリアクセスパターンやタイミングの変動を分析することでプライベート情報を推測可能なサイドチャネル攻撃を促進する。したがって、保護アルゴリズムは従来の暗号化を超え、ノード間通信中のデータ漏洩リスクを軽減するための難読化技術を組み込む必要がある。このようなアルゴリズムの複雑さは追加のオーバーヘッドに翻訳され、システム全体の遅延に影響を与える。さらに包括的なプライバシー保証とデコード性能とのトレードオフを均衡させるため、各種の準同型暗号技術とリアルタイムアプリケーションにおけるその計算上の実現可能性を考慮する必要がある。

SaaSインフラエンジニア

GPUクラスターを活用するSaaSアーキテクチャにおけるデコード遅延は、本質的なシステム遅延とトークン管理によって生じる追加の計算オーバーヘッドの両方に大きく影響される。クラウド環境におけるGPUリソースのプロビジョニングは、仮想化インフラストラクチャに起因する遅延の変動を導入する。トークン割り当てに関連する計算コストは、GPUリソース利用の効率と直接的に相関する。ネットワークによる遅延とノード通信オーバーヘッドはデコード操作をさらに複雑化し、スループットを最適化するための高度な負荷分散スキームが必要とされる。マルチテナント環境内でのスケジューリングの複雑さは、遅延の異常を引き起こす。これらの非効率を解消するには、トークンの不一致を最小化し、フラグメンテーションを低減するためのリソース割り当てアルゴリズムの最適化に焦点を当てる必要がある。このような改善は、高需要SaaSアプリケーションにおいて低遅延のデコード操作を達成し、トークン利用のコスト効率を保つために非常に重要である。

GPUクラスタのオーバーヘッド特にデコード遅延の文脈においては、分散システムアーキテクチャに内在する課題のため、包括的な監査が必要である。分散システムは無視できない計算および通信オーバーヘッドを導入し、GPUの効率およびスループットに悪影響を及ぼす。監査は以下の技術的側面を評価することに焦点を当てるべきである。

1. プロセススケジューリングメカニズム:GPU間のタスク配分に使用されるアルゴリズムを分析する。既存のスケジューリングポリシーによる非効率性を特定し、それが最適でない利用率を引き起こす可能性を探る。推奨するアプローチには、負荷分散戦略とタスク切り替え遅延の評価が含まれる。

2. ネットワーク遅延:全体的なシステム遅延に寄与するノード間通信遅延を調査する。この監査は、ネットワークの不整合がリモートメモリアクセス時間に与える影響を定量化し、ネットワーク帯域幅制限によって作成される潜在的なボトルネックを特定しなければならない。遅延分布分析のための高度な統計モデルが推奨される。

3. GPU間通信帯域幅:デコードおよび検索強調生成の需要に関して、GPU間のデータ転送速度の適切性を評価する。帯域幅が重大な制約として特定された場合、ハードウェアの強化またはデータシリアル化プロトコルの調整に関する提言を含めるべきである。

4. 検索強調生成(RAG)の制約:RAGのトークン制限とそのバッチ処理への影響を評価する。RAGプロセスに伴う計算複雑性を特定し、動的メモリ割り当てから生じるメモリ断片化問題を評価する。これらの影響を軽減するためにアルゴリズムの最適化を探求する必要がある。

監査は、進行中の操作およびシミュレートされたシナリオから収集された実証データを利用すべきである。その結果は、将来のアーキテクチャ的決定を導き、GPU配分戦略を最適化し、分散オペレーティング環境に固有の遅延効果を低減する。”