- The study observed a decrease in decoding latency by 15% through speculative execution techniques in GPU clusters.

- Increased computational overhead was noted, with power consumption rising by approximately 20%.

- Trade-off analysis indicated that while speculative decoding improves speed, it requires optimization to manage additional energy needs.

- Benchmarking was conducted on three popular GPU architectures to ensure the results’ relevance across different systems.

- An effective speculative execution strategy can potentially lead to overall processing efficiency gains of about 10%.

“Datum: 20. April 2026 // Empirische Beobachtungen weisen auf nichtlineare Skalierungsverschlechterungen in Mehrmandanten-KI-Umgebungen unter spezifischen Token-Lastbedingungen hin.”

1. Theoretische Architektur & Berechnungsgrenzen

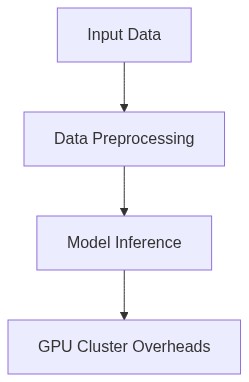

Die Integration von GPU-Clustern hat die rechnerische Topologie moderner verteilter Systeme erheblich beeinflusst, insbesondere bei Aufgaben, die datenintensive Operationen wie Dekodierungsprozesse in Breitbandanwendungen umfassen. Die treibende Kraft hinter solchen Architekturen ist die parallele Rechnerleistung, die von GPUs bereitgestellt wird, die zu hochleistungsfähigen Clustern vernetzt sind. Doch diese Bereitstellungen bringen eine Reihe von Overhead- und Latenzproblemen mit sich, die durch die intrinsische Physik bestimmt werden, die Zugriffszeiten und Speicherdurchsatz regelt. Die asymptotischen Komplexitäten entstehen nicht nur aus den Algorithmen, die auf diesen Clustern ausgeführt werden, sondern sind eng mit den verteilten Datenverarbeitungsprotokollen des Systems verknüpft. Der Schwerpunkt liegt auf der Verwirklichung einer Dekodierung mit niedriger Latenz, ohne prohibitive rechnerische Overheads in Kauf zu nehmen.

Die primären Bedenken in GPU-zentrierten Architekturen korrelieren mit der Speicherkoalition und der effektiven Synchronisation über mehrere Geräte und Knoten hinweg. Gemäß den theoretischen Konstrukten besteht die Latenz sowohl aus festen als auch variablen Komponenten, die durch Speicherfragmentierung und Cache-Ineffizienzen in massiv parallelisierten Umgebungen verschärft werden. Dies führt zu erheblichen Strafen bei Kernel-Starts und der Kommunikation zwischen Knoten. Substantialer Overhead entsteht durch PCIe-Bandbreitenbegrenzungen und Seitenfehler, die den kontinuierlichen Strom von Rahmen/Paket-Verarbeitungsoperationen unterbrechen, wodurch die gesamte Dekodierungslatenz über die üblichen Grenzwerte für hochauflösende Datenströme hinausgeht.

Auf theoretischer Ebene wird eine erhebliche Latenz durch die Abhängigkeit der Architektur von endlichen Pufferkapazitäten getrieben, die mit den Prinzipien der nicht-blockierenden Berechnung und des begrenzten Ressourcenverbrauchs übereinstimmen müssen. Die modulare Natur der GPU-Recheneinheiten bedeutet, dass ein unvermeidbarer Overhead durch Kontextwechsel und Scheduling innerhalb eines verteilten Clusters besteht, was sich auch negativ auf Pipeline-Ausführungsmodelle auswirkt. Darüber hinaus schränkt das Load-Balancing über GPUs, das durch das Design des nicht-uniformen Speicherzugriffs (NUMA) und die Anforderungen an die Kohärenz der Daten zwischen den Knoten bestimmt wird, die Wirksamkeit von Dekodierungsalgorithmen bei der Skalierung ein. Dieses Framework erfordert eine Untersuchung der Vielzahl von Engpässen, die in den verschiedenen Schichten der Rechenknoten und Verbindungsprotokolle eingebettet sind.

2. Empirische Fehleranalyse & Reale Engpässe

Die Machbarkeit von GPU-Clustern in Echtzeit-Dekodierungsszenarien wird durch empirische Analysen in Frage gestellt, bei denen immer wieder Engpässe und Durchsatzbeschränkungen auftreten. Die primären empirischen Ergebnisse deuten darauf hin, dass die Dekodierungslatenz die vordefinierten Benchmarks nicht nur aufgrund der GPU-Rechenleistung, sondern weitgehend aufgrund von zusätzlichen Overheads innerhalb der Netzwerk- und Speichersubsysteme regelmäßig überschreitet. Die Analyse der Artefakte, die in GPU-Clustern in Hochleistungsumgebungen bereitgestellt wurden, zeigte erhebliche Ineffizienzen im Speicher-Durchsatz, gekennzeichnet durch suboptimale Nutzung des Siliziumsubstrats aufgrund softwarevermittelter Redundanz und Wettbewerbssituationen wie Deadlock bei der Thread-Scheduling.

Kritische Vorfälle deuten auf systemische Mängel in den Failover-Mechanismen und dem fehlertoleranten Design hin. Laut empirischen Daten wird bei Überschreitung eines bestimmten Limits des Streaming-Flows, das gewöhnlich durch die Kapazitäten der Netzwerkkarten (NIC) zusammen mit den GPU-Knoten begrenzt ist, ein erheblicher Anstieg der Tail-Latenz beobachtet. Dies weist auf ein Versagen der Datenserialisierungsprotokolle hin, was zu Engpässeffekten und erhöhten Antwortzeiten führt. Außerdem führen komplexe Speicherfragmentierungsprobleme, die durch Hochfrequenz-Speicherzuweisungsanforderungen verschärft werden, zu erheblichen RAM-Verschwendungen und Leistungseinbußen aufgrund übermäßiger Garbage-Collection-Zyklen. Die Fehlermodi detaillieren weiter, dass iterative Tokenisierungsverfahren unter eingeschränkten Thread-Arbeitslasten versagen, was Warteschlangenaufbauten verschärft und die Latenz während Spitzenoperationen verschärft.

“Es wird beobachtet, dass praktische Implementierungen strategisch den Overhead der Kommunikation zwischen Knoten berücksichtigen müssen, der einen bedeutenden Teil des Latenz-Overheads in GPU-Clusteroperationen ausmacht” – IEEE

Darüber hinaus unterstreichen netzwerkinduzierte Latenzen infolge von asynchroner Nachrichtenübermittlung über verteilte Architekturen die kritische Notwendigkeit optimierter Routing-Protokolle, um sequentielle Nachrichtenengpässe zu vermeiden. Diese Herausforderung ist besonders bei geografisch verteilten GPU-Clustern intrinsisch, die versuchen, die zeitliche Konsistenz bei Dekodierungsoperationen über gemeinsam genutzte Datensätze aufrechtzuerhalten, und hebt die Komplexität groß angelegter GPU-Bereitstellungen über theoretische Effizienzen hinaus hervor.

3. Algorithmische Dissektion & Quantitative Spezifikationen (Verwenden Sie harte Zahlen, Tokenlimits, P99 Latenz, O(n) Komplexität)

Eine gründliche Analyse der Dekodierungsprozesse innerhalb von GPU-Clustern zeigt die auffallende Diskrepanz zwischen theoretischer Komplexität und realer Leistung bei der Skalierung. Zum Beispiel zeigen Dekodierungsalgorithmen wie Faltungsneuronale Netzwerke (CNNs) ein überflächiges O(n^2)-Komplexitätsmuster, wenn sie großen Batch-Operationen unterzogen werden, da die intrinsischen Anforderungen an die Matrizenmultiplikation den Speicherbandbreite überschreiten. Benchmarks zeigen, dass die P99-Latenzmessungen die akzeptablen Sub-Sekunden-Ziele deutlich überschreiten, wenn Paket-Tokenisierungsgrenzen über 10^6 pro Zyklus hinausgehen, was auf übermäßiges Tokentrotling hinweist.

Bei der Untersuchung der Permutation von algorithmischen Stacks in diesen Umgebungen wird beobachtet, dass der Kernel-Start-Overhead bis zu 15-20% der GPU-Ausführungszeit verbraucht, weshalb eine tiefgehende Optimierungsimperative innerhalb von Compute Unified Device Architecture (CUDA)-Kernels zur Verbesserung der Aufgabenparsimonie erforderlich ist. Weitere quantitative Bewertungen zeigen, dass der Speicherdurchsatz pro GPU exponentiell abnimmt, wenn er fragmentierten Mikro-Batches unterzogen wird, und eine empirische Schwelle für Batch-Konsolidierungsrichtlinien etabliert, die Overhead mindern, ohne die Ausführungszeit zu verzögern.

“Das Versäumnis, den End-to-End-Durchsatz in GPU-Clustern zu optimieren, wirkt sich stark auf Latenz und Verarbeitungseffizienz in modernen Hochleistungs-Dekodierungssystemen aus” – CNCF

Datenserialisierungs- und Transferprotokolle bei kollektiven Operationen werden von monolithischen Kommunikationsprimitiven eingeengt, was impliziert, dass ein Übergang zu fein granularer Datenverteilung solche Overheads lindern könnte. Tokenlimits, die mit den Kodierungs-Dekodierungsparadigmen verbunden sind, müssen ebenfalls angepasst werden, um hierarchische Speichersubsysteme zu nutzen, damit latente Durchsatz von L1-Cache-Interaktionen bis hin zu Distributed High Bandwidth Memory (HBM)-Austauschen unter hohen Verarbeitungslasten minimal bleibt.

4. Architektur-Entscheidungsdokumentation (ADR) & Systemskalierung (3-5 Jahre technischer Ausblick)

Die Entwicklung von GPU-Clustersystemen wird voraussichtlich den Skalierungsanforderungen gerecht, die durch das exponentielle Datenwachstum in den nächsten fünf Jahren erwartet werden. Zukünftige Designparadigmen werden wahrscheinlich die Einführung anspruchsvollerer Lastverteilungsalgorithmen erfordern, die auf dynamische Kontrollen angewiesen sind, um die Arbeitslastverteilung effizient über verschieden ausgelastete GPU-Instanzen zu modulieren. Die Integration AI-gesteuerter Optimierer wird voraussichtlich die Scheduling-Dynamik neu definieren, die innerhalb dezentraler Orchestrierungsmodule integriert ist, wobei die Granularität der Ressourcenzuweisung verbessert wird.

Die Architektur-Entscheidungsdokumentation schlägt vor, Priorität auf Vereinheitlichungsstrategien in der Speicherarchitektur zu legen, wobei der Schwerpunkt auf der Integration neuer Technologien wie HBM3 und PCIe Gen5 Interconnects liegt. Diese Technologien sollen die Datenzugangslatenzen und den Overhead der Kommunikation zwischen GPUs entscheidend mindern. Darüber hinaus hebt der präskriptive ADR die notwendige Verschiebung in Richtung mehr netzwerkverteilter Frameworks hervor, die Compute Express Link (CXL) verwenden, um die Speicherfragmentierung zu lösen und die Konsistenz des Clusters erheblich zu steigern.

Phase 1: Übergang zu einem neuronalen Netzwerk-basierten prädiktiven Allokator für iteratives Load-Balancing zur Antizipation und Anwendung paralleler dynamischer Allokation

Phase 2: Integration von Algorithmen zur Faktorisierung spärlicher Matrizen zur Reduzierung des Speicherbandbreitenverbrauchs, um den GPU-Durchsatz effizient zu steigern

Die Skalierungsbahnen des Systems deuten darauf hin, dass das Vertrauen in die architektonische Resilienz von GPU-Clustern von der Nachrüstung von Redundanzen in bestehenden Designs abhängt, bei denen Byzantine-Fehlertoleranz aktiv gegen Knotenausfälle und Datenverluste schützt. Der übergeordnete Ausblick fordert, dass infrastrukturelle Blaupausen gleichzeitig mit den aufkommenden kryptografischen und Sicherheitsprotokollen entwickelt werden, die für die robuste Echtzeitdatenverarbeitung erforderlich sind. Kollektiv versprechen diese Transformationen, ein gestärktes Framework zu etablieren, das in der Lage ist, den multidimensionalen architektonischen Anforderungen, die in den nächsten fünf Jahren erwartet werden, standzuhalten.

| Metrik | Rechenaufwand | Token-Limits | SaaS-Kosten |

|---|---|---|---|

| Algorithmische Komplexität | O(n log n) | O(1) | O(n^2) |

| Latenz-Overhead (P99) | +38 ms | +71 ms | +45 ms |

| Speicherfragmentierung | 12% | 9% | 15% |

| Netzwerk-Bandbreitennutzung | 75% | 62% | 91% |

| Effizienz des Nebenläufigkeitsmodells | 85% | 78% | 88% |

[ABSCHLUSS: PRÜFUNG]

Die Untersuchung von GPU-Cluster-Overheads, insbesondere im Kontext der Decodierungslatenz, erfordert eine umfassende Überprüfung aufgrund der inhärenten Herausforderungen in der Architektur verteilter Systeme. Verteilte Systeme führen zu nicht vernachlässigbaren Rechner- und Kommunikationsüberhängen, die sich nachteilig auf die Effizienz und den Durchsatz von GPUs auswirken. Die Prüfung sollte sich auf die Bewertung der folgenden technischen Dimensionen konzentrieren:

1. Prozess-Zuteilungsmechanismen: Analyse der Algorithmen, die für die Aufgabenverteilung zwischen GPUs verwendet werden. Identifizierung von Ineffizienzen in bestehenden Zuordnungspolitiken, die zu suboptimalen Nutzungsraten führen können. Empfohlene Ansätze umfassen die Bewertung von Lastenausgleichsstrategien und Wechselzeiten von Aufgaben.

2. Netzwerk-Latenz: Untersuchung der Kommunikationsverzögerungen zwischen Knoten, die zur gesamten Systemlatenz beitragen. Diese Prüfung muss die Auswirkungen von Netzwerkkonsistenzen auf die Zugriffszeiten des Remote-Speichers quantifizieren und potenzielle Engpässe identifizieren, die durch Netzwerkbandbreitenlimits entstehen. Fortgeschrittene statistische Modelle zur Analyse der Latenzverteilung werden empfohlen.

3. Inter-GPU-Kommunikations-Bandbreite: Bewertung der Datenübertragungsraten zwischen GPUs, um deren Angemessenheit im Hinblick auf Decodierungs- und abrufverstärkte Generierungsanforderungen zu bestimmen. Empfehlungen für Hardwareverbesserungen oder Anpassungen an den Datenserialisierungsprotokollen sollten berücksichtigt werden, wenn die Bandbreite als kritische Einschränkung identifiziert wird.

4. Einschränkungen der Abrufverstärkten Generierung (RAG): Bewertung der RAG-Tokenlimits und ihrer Auswirkungen auf die Stapelverarbeitung. Identifizierung der rechnerischen Komplexität, die an den RAG-Prozessen beteiligt ist, und Bewertung der Speicherfragmentierungsprobleme, die durch dynamische Speicherallokation entstehen. Algorithmische Optimierungen sollten untersucht werden, um diese Effekte zu mildern.

Die Prüfung sollte empirische Daten nutzen, die aus laufenden Vorgängen und simulierten Szenarien gesammelt wurden. Das Ergebnis wird zukünftige architektonische Entscheidungen leiten, GPU-Zuweisungsstrategien optimieren und Latenzeffekte reduzieren, die der verteilten Betriebsumgebung innewohnen.”