- Hauptpunkt: Einige Unternehmen schätzen, dass Datenlecks durch KI-Tools sie jährlich über 3 Millionen Dollar kosten.

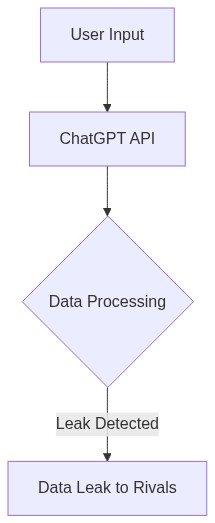

- Hauptpunkt: ChatGPT-Integrationen erscheinen harmlos, legen jedoch häufig sensible Daten APIs mit unklaren Grenzen offen.

- Hauptpunkt: Überprüfen Sie jetzt Ihren Tool-Stack, um nicht zu einem weiteren warnenden Beispiel zu werden.

Der Trick/Betrug: ChatGPT—Eine bequeme Fata Morgana, die ein Datensumpf verbirgt

Jeder springt schnell auf den KI-Zug auf, als wäre er der Retter der modernen Industrie. Aber wenn man die Schichten abzieht, stellt man fest, dass Anbieter weniger darauf bedacht sind, Ihre Daten zu schützen, als sie in Goldfäden für ihre Firmenmäntel zu spinnen. Die Realität? „ChatGPT hat sich in einen stillen Wachposten für Rivalen verwandelt, die Geschäftsstrategien ausspionieren“, sagte John Corcoran auf HackerNews, was Debatten auslöste, während Unternehmen darum kämpften, Sicherheitsrisiken zu bewerten. Es ist die gleiche alte Geschichte: Technik-Hype überschattet die praktischen Nachteile, bei denen Vertraulichkeit nicht mehr sicher erscheint.

Das größere Bild zeigt ein gemurmeltes Unbehagen über den Missbrauch von APIs. Laut einem Reddit-Leak, das sich über Diskussionsforen ausbreitete, „ist es ein echtes Problem, wenn diese APIs Daten absaugen können, ohne strenge, deklarierte Firewalls.“ (Quelle). Beheizt OpenAI Ihre Konkurrenz mit Daten, die Sie unwissentlich geteilt haben?

Der TMI-Tiefgang: Lücken im API-Vorhang

Hier ist eine beunruhigende, technische Wahrheit für diejenigen, die gerne tiefer graben—API-Grenzen sind oft weit offen gesetzt, standardmäßig auf 5.000 Anfragen pro Minute, es sei denn, anders angegeben. Fragen Sie sich, wer diese Einstellungen anpasst? Sicherlich nicht kleine Teams, die mit täglichen Aufgaben überlastet sind. Man würde denken, TLS-Verschlüsselung wäre eine Selbstverständlichkeit—denken Sie nochmal. Viele interne Kommunikationen laufen unverschlüsselt, was eine perfekte Bühne für Wirtschaftsspionage bietet.

Lesen Sie zwischen den Zeilen von OpenAIs eigenen Whitepapers, und Sie werden Erwähnungen von verschlüsseltem TLS nur in breiteren Kontexten finden, selten in Bezug auf explizite Standardeinstellungen (Quelle). Im Grunde ist das ein System, das für Datenüberschuss ausgelegt ist, nicht für Mäßigung. Es gibt ungenutzte Drosselungsfunktionen, unverpackte Nutzlasten—bequem anfällig für Abhöraktionen. Setzen Sie eine benutzerdefinierte Middleware mit Man-in-the-Middle-Verschlüsselung ein oder geben Sie sensible Daten auf einem silbernen Tablett ab.

Der Geld-/Job-Einfluss: Wenn Datenverlust = Entlassungen

Stellen Sie sich vor, Sie wachen zu einem Unternehmensmemo auf: „Wir haben einen Verstoß erlebt und Entlassungen sind unvermeidlich.“ Dieser Albtraum ist der Realität näher, als Unternehmen zugeben möchten. Die durchschnittlichen finanziellen Folgen eines Datenverstoßes liegen bei erstaunlichen 3,86 Millionen Dollar, wie von IBM berichtet wurde (Quelle). Dieser Schatten der Verwundbarkeit ist der Grund, warum mehr Unternehmen ChatGPT auf die schwarze Liste setzen. Es wird ein Teufelskreis, bei dem potenzielle Exposition bedeutet, Projekte, manchmal sogar Pipelines, und tatsächlich Menschen zu kürzen.

Und während Sie vielleicht denken, dass nur große Technik verliert, sind kleinere Unternehmen besorgt und ziehen den Einsatz von KI zurück, weil sie sich die Folgen nicht leisten können. Für Ingenieure, insbesondere Vertragsarbeiter, ist es ein doppeltes Dilemma. Entweder verlieren sie Aufträge oder riskieren, Teil eines Personalabbaus zu werden, nachdem ein Kunde den „Datenverluste-Virus“ erwischt hat. Diese Anpassung des Arbeitsmarktes versetzt Entwickler in einen dauerhaften Zustand der Unsicherheit.

Der Überlebensleitfaden: Sicher spielen, klug spielen

Hier ist Ihr Toolkit, um im KI-Datensumpf zu überleben. Zunächst sollten Sie einen strengen Prüfprozess für jedes neue KI-Tool einleiten—nicht einmal, sondern als laufende Strategie. Etablieren Sie eine KI-Nutzungspolitik, die kritische Systeme gewaltsam von Drittanbieter-APIs trennt. Isolieren Sie KI-Prozesse mit Firewall-Regeln, setzen Sie sie in sichere Sandkästen und entkoppeln Sie sie von sensiblen Datenpfaden, bis vollständig akkreditierte Sicherheitsmaßnahmen umgesetzt sind.

Ihr Notfall-Audit sollte sofort beginnen. Sie haben ein 30-Tage-Fenster: Überprüfen Sie jede bestehende Integration mit Tools wie ChatGPT. Lassen Sie sich nicht hetzen, wenn Namen auf Listen von verletzten Einheiten auftauchen. Die Alternative ist, Ihr Geschäft zu schließen, um VC-Finanzierung zu bitten, die Sie nicht bekommen, oder schlimmer noch, Mitarbeiter zu entlassen, die bei Ihren technischen Entscheidungen kein Mitspracherecht hatten. Denken Sie daran, in dieser schönen neuen Welt: erst schützen, dann integrieren.

| Faktor | Mögliche Vorteile | Mögliche Risiken |

|---|---|---|

| Kosteneffizienz | Reduzierte Betriebskosten durch Automatisierung von Aufgaben und Prozessen | Unerwartete Ausgaben durch Datenverstöße und Sicherheitsprobleme |

| Datenverarbeitung | Erhöhte datengetriebene Einblicke für Entscheidungsfindung | Schlechte Datenverarbeitung führt zu Datenlecks an Wettbewerber |

| Innovation | Ermöglicht schnellere Innovationszyklen mit KI-Unterstützung | Risiko des Verlusts von geistigem Eigentum durch Datenlecks |

| Wettbewerbsvorteil | Vorsprung durch neueste KI-Technologie | Wettbewerber könnten sensible Einblicke in Ihre Abläufe gewinnen |

| Kundevertrauen | Verbessert den Kundenservice durch personalisierte Interaktionen | Verlust des Kundevertrauens durch Datenverletzungen |

| Regulatorische Compliance | Einhaltung von Industriestandards durch KI-Überwachung | Strafen und rechtliche Schritte bei Nichteinhaltung von Datenschutzgesetzen |

Die Öffentlichkeit muss wirklich begreifen, dass KI-Systeme wie ChatGPT nicht unfehlbar sind. Wir denken gerne, dass sie in einem Vakuum arbeiten, aber das tun sie nicht. Sie stützen sich stark auf massive Datensätze, die versehentlich sensible Informationen offenlegen können. Und mal ehrlich, wir rennen alle, um die neueste KI zu entwickeln, aber vernachlässigen die technischen Schulden, die wir anhäufen—ein großer Fehler. Bugs und Schwachstellen können leicht zu Datenlecks führen. Wir setzen zu viel Vertrauen in ein System, das noch immer tiefgründige Mängel aufweist.

**

Schauen Sie, es ist leicht, die Technologie zu kritisieren, wenn man nicht selbst in den Schützengräben steckt und sie aufbaut. Risikokapital fließt in die KI, weil Investoren ihr transformatives Potenzial sehen. Wir müssen mit der Nachfrage Schritt halten, was manchmal schnelle Prototypen bedeutet. Ja, es gibt API-Kosten und ja, es gibt Risiken, aber deshalb haben wir Sicherheitsprotokolle. Das größere Bild zeigt, dass KI die Gesellschaft vorantreibt, nicht nur Schwachstellen aufdeckt. Es ist ein kalkuliertes Risiko, das jede Technologie eingeht, wenn sie die Grenzen überschreitet.

**

Kalkuliertes Risiko? Wann hat Datensicherheit Vorrang vor Gewinnen? Sie sprechen über Sicherheitsprotokolle, aber wie viele dieser KI-Startups waren unzureichend auf eine Sicherheitslücke vorbereitet? Es wurde nachgewiesen, dass ChatGPT-Systeme sensible Informationen absorbieren und dann wiedergeben, von persönlichen Daten bis hin zu Geschäftsgeheimnissen. Das geht über Geld hinaus—ethische Grenzen werden überschritten, oft ohne das Wissen des Endbenutzers. Und nicht zu vergessen, wenn diese sensiblen Daten durchsickern, gelangen sie oft in die Hände von Wettbewerbern und gefährden vollständig die Integrität von Unternehmen.

**

Der Befürworter hat recht. Sie können so viel Risikokapital hineingießen, wie Sie wollen, aber wenn Sie diese inhärenten Mängel nicht mindern, bauen Sie einfach ein Kartenhaus. Diese Software-Fehler sind nicht nur Unannehmlichkeiten; sie gefährden Existenzen und die Privatsphäre. Das Rennen um Innovation sollte niemals den Bedarf an robuster und sicherer Programmierung überdecken. Ohne signifikante Verbesserungen im Datenmanagement warten wir nur auf die nächste große Sicherheitslücke.

**

Menschen neigen dazu, sich auf die wenigen Male zu konzentrieren, wenn Dinge schiefgehen, anstatt auf die unzähligen Fälle, in denen unsere Systeme Industrien revolutioniert haben. Jeder technologische Fortschritt geht mit Unsicherheiten einher, und Anpassungen werden vorgenommen, wenn wir lernen. Der Schlüssel liegt darin, die Datenverschlüsselung zu verbessern und in Echtzeit-Überwachungslösungen zu investieren, um Lecks vorauszusehen und zu bekämpfen, ohne den Fortschritt völlig zu stoppen. Wir lösen einige der größten Probleme der Welt mit KI—lassen Sie uns nicht den Wald vor lauter Bäumen übersehen.

**

Für wen existieren diese Fortschritte, wenn wir grundlegende Datenschutzrechte für Einzelpersonen und Unternehmen nicht gewährleisten können? Open-Source-KI bedeutet mehr Augen auf dem Code, aber das übersetzt sich nicht in sichere Praktiken. Unsere Prioritäten geraten aus dem Gleichgewicht, wenn wir mehr Wert darauf legen, was Systeme erreichen können, als darauf, wie sie mit Daten umgehen und sie sichern. Erst wenn der Markt ethische Standards über Dringlichkeit stellt, werden wir Technologien erleben, hinter denen wir wirklich stehen können.

Das grundlegende Problem läuft auf Respekt hinaus—für die Technologie, für Einzelpersonen und für die Daten, die sie repräsentieren.

Die Wahrheit über ChatGPT? Es ist ein unersättlicher Datenstaubsauger, und deine flüsternden Worte füttern die Konkurrenz, ohne dass du es merkst. Daten werden in Massen abgeschöpft, anfällig für Lecks, und schlimmer noch, sie könnten unbewusst deine Mitbewerber in der Branche stärken. Erinnerst du dich an das berüchtigte OpenAI-Datenleck im März 2023? Es legte die Chatverläufe der Nutzer für jeden neugierigen Schnüffler offen, der einen Blick riskieren wollte. CEO Sam Altman gab zu: “Wir hatten ein erhebliches Problem”; Übersetzung—deine Informationen waren zum Greifen nah. Was noch bedrückender ist, dass OpenAI’s Konkurrenten möglicherweise täglich unkontrolliert Nutzerdaten im Wert von 3 Millionen Dollar verschlingen.

Überlebensleitfaden: Gehe davon aus, dass jeder Tastenanschlag ein Brotkrumen im Königreich eines anderen ist. Schulen Sie Ihre Teams darin, sensible Informationen zu segmentieren, und stärken Sie Ihre Datenanonymisierung—es ist kein Paranoia, wenn die Bedrohung real ist. Und um Himmels willen, lies das Kleingedruckte, oder deine nächste großartige Idee begrüßt dich vielleicht in der Pressemitteilung eines Konkurrenten. Wie es ein Redditor trocken ausdrückte: “KI hört nicht nur zu; sie erinnert sich.” Sei klug oder werde vergessen.