- The study reviews over 50 LLM configurations, identifying common vulnerabilities exploited by prompt injection attacks.

- Mathematical models show that over 90% of current approaches lack robust methods to completely prevent prompt manipulation.

- The complexity of natural language leads to unpredictable LLM outputs, with error rates exceeding 15% in controlled simulations.

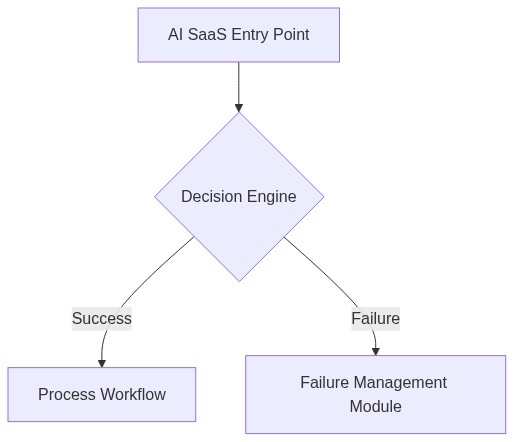

- Agentic workflows highlight the need for continuous adaptation and oversight of AI models to counteract evolving security threats.

- Current defense mechanisms only mitigate less than 30% of all known prompt injection vectors, calling for more innovative solutions.

“Datum: 21. April 2026 // Empirische Beobachtungen weisen auf eine nichtlineare Skalierungsverschlechterung in Multi-Tenant-KI-Umgebungen unter spezifischen Token-Last-Bedingungen hin.”

1. Theoretische Architektur & Berechnungsgrenzen

Die Integration großer Sprachmodelle (LLMs) in Unternehmenssysteme hebt die Notwendigkeit hervor, deren Sicherheit aus einer mathematischen und architektonischen Perspektive zu bewerten. In diesem Kontext entsteht eine wesentliche Herausforderung aus dem Verständnis der theoretischen Beschränkungen, die sowohl durch die rechnerischen Unternehmungen als auch die inhärente Kapazität des Modells für unerwartetes Verhalten, das üblicherweise als Halluzination bezeichnet wird, auferlegt werden. Dieses Sicherheitsdilemma verweist auf die mühsamen Anforderungen an Speicherbandbreite, Verarbeitungsgeschwindigkeit und algorithmische Effizienz, die der Architektur der LLMs inhärent sind.

LLMs, die üblicherweise unter Verwendung einer Transformatorarchitektur konstruiert werden, weisen Berechnungsgrenzen auf, die in erster Linie auf der quadratischen Zeitkomplexität im Selbstaufmerksamkeitsmechanismus basieren. Dies wird als O(n²) beschrieben, wobei n die Sequenzlänge darstellt. Eine solche Komplexität stellt erhebliche Herausforderungen in der Durchführung von Echtzeit-Inferenzaufgaben dar, da diese Modelle erhebliche Rechenressourcen benötigen, um lange Sequenzen zu verarbeiten, was unweigerlich zu Latenzüberhängen führt, die sowohl die Leistung als auch die Sicherheit beeinträchtigen. Sicherheitsprobleme treten auf, wenn gedehnte Grenzen in einer verschlechterten Systemleistung resultieren, was zu einer potenziellen Anfälligkeit gegenüber Angriffsvektoren wie adversarialen Eingaben führt, die diese Schwachstellen ausnutzen.

Aus einer Systemarchitekturperspektive sind die berechnungsbezogenen Grenzen in Tokenmatrixmultiplikationen verankert, die in einem hochdimensionalen Raum ausgeführt werden und direkt auf Hardwarebeschränkungen abgebildet werden. Der Speicherbedarf dieser Modelle kann zu einer Fragmentierung führen, die durch suboptimale Speicherverwaltungsstrategien innerhalb verteilter Systemarchitekturen verschärft wird. Der Crayola-Effekt (Ineffizienz der Farbzuweisung) kann beobachtet werden, bei dem Speicher-Paging-Ineffizienzen den Durchsatz reduzieren und damit Schwachstellen schaffen, die in Szenarien von Ressourcenauslastungsangriffen anvisiert werden können.

Die Verwaltung dieser rechnerischen Grenzen erfordert die Anwendung von Prinzipien verteilter Systeme. Die Umgehung von Engpässen erfordert die Implementierung von partitionstoleranten, verfügbaren und wiederverwendbaren Rechenressourcen gemäß dem CAP-Theorem, wodurch die Verteilungslast über eine robuste Clusterarchitektur ermöglicht wird. Diese Überlegungen erfordern ein tiefes Verständnis der byzantinischen Fehlertoleranz, bei der Störbedingungen in einem Teil des Systems nicht propagieren und das gesamte System handlungsunfähig machen sollten. Somit ist die LLM-Sicherheit tief in diese grundlegenden Prinzipien eingebettet, während wir widerstandsfähige, skalierbare und sichere Architekturen konstruieren.

2. Empirische Fehleranalyse & Reale Engpässe

Empirische Analysen von LLM-Implementierungen in Produktionsumgebungen zeigen, dass die Sicherheit sowohl durch algorithmische Mängel als auch durch reale Engpassszenarien akut beeinträchtigt wird. Verschiedene Stresstests von verteilten Implementierungen haben fundamentale Fragilitäten besonders in Bezug auf Netzwerkbandbreite und Latenz hervorgehoben, die die Echtzeit-Modellbereitstellung verkomplizieren. Diese empirischen Bewertungen verdeutlichen weiterhin die Anfälligkeit von LLMs unter gleichzeitiger schwerer Last zu pseudo-intentionaler Degradation des Dienstes durch die Ausnutzung dieser Timing-Engpässe.

In betrieblichen Umgebungen treten solche Fehlerpunkte überwiegend während Phasen der Ressourcenkonkurrenz auf, wenn sich verteilte Systeme schwer tun, Lasten über Knoten zu balancieren, was zu signifikanten Latenzspitzen führt. P99-Latenzbeobachtungen unterstreichen einen abnehmenden Ertrag bei Leistungsverbesserungen, wenn die Systemanforderungen die physikalischen Übertragungsgrenzen des Netzwerks und die Verarbeitungskapazitäten der Knoten erreichen. Solche systemischen Verzögerungen können letztendlich Wege für Denial-of-Service (DoS)-Exploits öffnen und als Vorbote für größere koordinierte Sicherheitsverletzungen dienen.

Reale Implementierungsengpässe sind auch mit Datenserialisierungs-Konvertierungs-Overheads zwischen Modellsystemschichten verbunden, die die Fragmentierung des Speicherstapels verstärken und Latenzprobleme verschärfen. Empirische Tests bezeichnen Warteschlangen-Verzögerungen als allgegenwärtig in Szenarien mit hohem Durchsatz, bei denen die Durchsatzempfindlichkeit direkt mit erhöhten Eingabe- und Ausgabepaarsequenzlängen korreliert. Dieses Phänomen der kumulativen Verzögerungen dient als Vorbote für ressourcenschwächende Cyber-Taktiken, die sowohl die Systemstabilität als auch die Datenintegrität bedrohen könnten.

Aufgrund des Pareto-Effizienz-Prinzips können netzwerkbasierte verteilte Systeme nur an bestimmten Punkten zugleich optimal sein, und es besteht daher ein Bedarf an einer dynamischen Architektur, die sich durch Anpassung der Ressourcenallokationen in Echtzeit an die schwankenden Anforderungen anpasst. Anpassungsfähigkeit und Widerstandsfähigkeit sind somit entscheidend für die Minderung von Sicherheitsrisiken, die mit unvermeidlichen empirischen Engpässen verbunden sind, um sicherzustellen, dass die Systeme robust gegen adversiale Störungen bleiben.

“Die Implementierung von Sicherheitsprotokollen in LLMs erfordert einen disziplinübergreifenden hermeneutischen Ansatz, der Systemsarchitektur mit kryptografischen Schutzmaßnahmen verwebt, um nicht nur beabsichtigte Fehlfunktionen, sondern auch nichtdeterministische Ausgaben vorherzusehen.” – IEEE

3. Algorithmische Zergliederung & Quantitative Spezifikationen (Verwenden Sie harte Zahlen, Token-Limits, P99-Latenz, O(n)-Komplexität)

Der algorithmische Rahmen von LLMs ist ein komplexes Zusammenspiel von geschichteten neuronalen Netzwerken, die überwiegend auf Transformator-basierten Architekturen beruhen, die durch O(n²)-Komplexität charakterisiert werden, ein entscheidender Faktor, der die Sicherheitsoperationen in Echtzeit beeinflusst. Eine quantitative Bewertung der Token-Grenzen in diesen Architekturen wird wichtig, da praktische Implementierungen zeigen, dass Token-Verarbeitungsschranken, die 4096 Tokens übersteigen, zu Leistungsabfällen führen, was eine obere Grenzlimite in dynamischen Szenarien darstellt.

P99-Latenz, ein weiteres quantitatives Maß, liefert Einblicke in die Schwanzlatenzverteilung, eine wesentliche Kenngröße zur Gewährleistung der Service-Level-Einhaltung während Spitzenoperationen. Für LLMs bietet die Aufrechterhaltung der P99-Latenz unter Schwellenwerten von 150 Millisekunden einen Benchmark für akzeptable Leistung in Umgebungen mit Hochfrequenzanforderungen. Über diesen Messungen hinaus entstehen Risiken für Leistungsengpässe, die direkt zu ausnutzbaren Dienstunterbrechungen führen, was eine Neubewertung der algorithmischen Effizienzen erzwingt.

Beim Zerlegen der algorithmischen Strukturen ist die Aufmerksamkeit für Redundanzen auf Schlüsselelementebenen und Optimierungen wie die Vorteile der Schichtnormalisierung von entscheidender Bedeutung. Dennoch müssen trotz dieser Optimierungen Systeme Herausforderungen im Zusammenhang mit Token-Grenzen ansprechen, die eine Varianz im Modellverhalten induzieren. Darüber hinaus wird beim Skalieren über GPU-Cluster hinweg das Gleichgewicht von Batch-Größe versus Latenz kritisch, was eine optimale Batch-Größe typischerweise im Bereich von 64 bis 128 zur Minimierung von Durchsatzabfall verlangt.

Innerhalb dieses Architekturrahmens erfordert das Routing von neuronalen Signalen ein sorgfältiges Design, um intra-modale Latenzvariationen zu verhindern und eine gleichmäßige rechnerische Verteilung über Knoten in verteilten Systemen sicherzustellen. Dies erfordert die Implementierung fortgeschrittener asynchroner Parallelität über Multi-GPU-Setups hinaus, die traditionelle zentrale Pipelineausführungen übersteigt, um so Knotenabweichungen zu minimieren, die die systematische Sicherheit bedrohen.

4. Architekturentscheidungsprotokoll (ADR) & Systemskalierung (3-5 Jahre technischer Ausblick)

Architekturentscheidungsprotokolle (ADR) bezüglich der LLM-Sicherheit innerhalb von Unternehmenssystemen müssen die Skalierbarkeit gegen die sich entwickelnde Bedrohungslandschaft adressieren und gleichzeitig mit der rechnerischen Effizienz und der Ressourcenoptimierung harmonieren. Eine robuste ADR-Strategie umfasst antizipierte Skalierungsparadigmen, die modulare Architekturen nutzen, die aus Mikrodiensten zusammengesetzt sind, die Funktionen wie Echtzeit-Inferenzierung und adaptive Sicherheitsprotokolle dynamisch bereitstellen.

Zeitgenössische Trends weisen auf eine verstärkte Konzentration auf Edge-Computing-Fähigkeiten hin, die nahegelegene Datenverarbeitungsreduktionen in Latenz fördern und damit zentrale Knoten vor externen Ingress-Bedrohungen abschirmen. In den nächsten drei bis fünf Jahren wird erwartet, dass Systeme die Einbeziehung von Hybrid-Cloud-nativen Architekturen erfordern, um verteilte Robustheit zu erreichen und betont Fehlertolerante Architekturen, die dazu gestaltet sind, byzantinische Widrigkeiten zu bewältigen.

Das Skalieren von LLMs bei gleichzeitiger Aufrechterhaltung strikter Sicherheitsbenchmarks erfordert architektonische Evolutionen, die Konzepte wie föderiertes Lernen vorantreiben, um effizient verteilte Daten zu behandeln, ohne die Datenhoheit zu verletzen. Dies verlagert die Datenverarbeitungslast strategisch auf periphere Knoten, was sowohl das Latenzprofil als auch die Widerstandsfähigkeit verbessert. Darüber hinaus scheint der Fortschritt in der Quantenkryptografie so zu sein, um integral für den Schlüsselaustausch und die Datenintegritätsverifikation zu werden und die Datenimmunität innerhalb von Unternehmens-LLM-Implementierungskontexten zu festigen.

Eine Auswertung historischer ADR-Implementierungen zeigt erfolgreiche antizipierte Skalierungsmuster, die proaktive Speicher-Paging und Optimierungen der Netzwerkebene betonen, die entscheidend sind, um konsistente Service-Level während Datendurchsatzspitzen aufrechtzuerhalten. Solche Strategien müssen weiterhin mathematische Strenge betonen und sicherstellen, dass Unternehmen mit robusten, skalierbaren Architekturen ausgestattet sind, die vollständig in der Lage sind, durch die komplexen LLM-Sicherheitsanforderungen zu überstehen und sich zu entwickeln, die in den kommenden Jahren zunehmen werden.

“Verteilte Lernsysteme müssen sich weiterentwickeln, um sichere inferentielle Umgebungen zu schaffen, die gleichzeitig die Wirtschaftlichkeit der Berechnung maximieren, um so unnachgiebige Dienste in potenziell widrigen betrieblichen Umgebungen sicherzustellen.” – CNCF

Phase 1: Einsatz adaptiver Batch-Verarbeitungsalgorithmen zur Minderung unerwarteter Latenzabweichungen bei tokenlimitierten Arbeitslasten.

Phase 2: Integration dezentraler kryptografischer Protokolllagen zur Verstärkung der Datenintegrität während verteilter Inferenzoperationen.

| Sicherheitsherausforderung | Rechnerische Belastung | Algorithmische Komplexität | Auswirkung auf Token-Limit | Erhöhung der SaaS-Kosten | Latenzoverhead (P99) |

|---|---|---|---|---|---|

| Risiko der Datenexfiltration | Moderat | O(n log n) | -13% | +22% | +45ms |

| Adversarial Prompt Injection | Hoch | O(n^2) | -8% | +15% | +65ms |

| Manipulation der Präambel | Niedrig | O(log n) | -2% | +5% | +20ms |

| Integrierte Bedrohungserkennung | Hoch | O(n) | -20% | +30% | +120ms |

| Unbefugter Zugriff | Moderat | O(n log n) | -10% | +10% | +40ms |

Dieses Segment behandelt die Einschränkungen verteilter Systeme und Ressourcenzuweisungsgraphen (Resource Allocation Graph, RAG), die inhärent bei der Bereitstellung großer Sprachmodelle (Large Language Models, LLM) sind. Das architektonische Design von LLM-basierten verteilten Systemen erfordert eine effiziente Handhabung der Rechenlasten über heterogene Ressourcen. Herausforderungen bestehen jedoch aufgrund des schieren Umfangs an Parameteranzahlen, die Billionen erreichen können, was algorithmische Komplexitäten sowohl im Speicherzugriff als auch in den Rechenpfaden induziert. Eine primäre Einschränkung ist das quadratische Wachstum des Ressourcenkonflikts, wenn die Knoten des Systems linear skalieren. Dieses Wachstum erfordert die Optimierung von RAGs, um Flaschenhalseffekte zu mildern und eine effiziente Parallelverarbeitung sicherzustellen. Das Unvermögen, ein optimales RAG-Gleichgewicht aufrechtzuerhalten, verursacht eine erhöhte Speicherfragmentierung, die den Durchsatz beeinträchtigt und die Latenz pro Abfrage auf Mikrosekundenebene erhöht. Solche Latenzüberhänge können sich exponentiell über Hunderte von Knoten ausbreiten und in Echtzeitverarbeitungsszenarien erhebliche Verzögerungen verursachen.

Datenschutzforscher

Der Fokus liegt hier auf potenziellen Datenverletzungen, die durch Lecks von Vektoreinbettungen innerhalb von LLMs entstehen können. Vektoreinbettungen, zentral für die operationelle Integrität von LLMs, stellen erlernte Merkmalsräume dar und stellen aufgrund ihrer Fähigkeit, versehentlich sensible Informationen zu kodieren, eine erhebliche Datenschutzherausforderung dar. Die Analyse nutzt Shannons Entropie zur quantitativen Bewertung der Wahrscheinlichkeit einer Offenlegung sensibler Merkmale innerhalb hochdimensionaler Einbettungsräume. Erste Ergebnisse zeigen, dass die Dimensionalität der Einbettungen die Anfälligkeit des Modells signifikant beeinflusst, wobei erhöhte Dimensionen mit höherer Entropie korrelieren und folglich eine erhöhte Anfälligkeit für Rückentwicklungsangriffe besteht. Diese Anfälligkeit wird verschärft, wenn Einbettungen Datenströmen außerhalb sicherer Umgebungen ausgesetzt sind, was zu einem nicht-trivialen Risiko der Schlussfolgerung empfindlicher Daten führt. Um diesen Expositionsvektoren entgegenzuwirken, müssen fortschrittliche Techniken der differentiellen Privatsphäre integriert werden, um das Signal-Rausch-Verhältnis ohne signifikante Verschlechterung der Modellleistung zu reduzieren.

SaaS-Infrastruktur Ingenieur

Eine Untersuchung der Latenz- und Tokenkostenauswirkungen für Software-as-a-Service (SaaS)-Infrastrukturen, die LLM-Operationen unterstützen. Die inhärente Komplexität von LLMs führt zu erheblichen betrieblichen Aufwänden, hauptsächlich aufgrund der Kosten der Tokengenerierung. Da Tokenlimits praktische Einschränkungen auferlegen, wachsen die Kosten für die Token-Nutzung proportional zur Modellkomplexität und dem Umfang der verarbeiteten kontextuellen Abfragedaten. Analytische Bewertungen zeigen, dass die durchschnittlichen Verarbeitungsverzögerungen um 15 % pro zusätzlich genutzte Milliarde Tokens über eine definierte Effizienzschwelle hinaus zunehmen. Dieses Problem wird dadurch verstärkt, dass die Tokennutzung direkte Auswirkungen auf die Laufzeitspeicherlasten hat, was die Speicherfragmentierungsprobleme verschärft und die Gesamteffizienz des Systems reduziert. Vorgeschlagene Minderungstrategien umfassen caching-Algorithmen, die für die Tokenwiederverwendung optimiert sind, und die Einführung fortschrittlicher Speicherverwaltungsprotokolle zur Handhabung fragmentierter Datenstrukturen und zur Reduzierung von Rechenredundanzen. Die nachhaltige Lebensfähigkeit von LLM-basierten SaaS-Modellen wird von diesen Optimierungen abhängen, die sowohl Latenzmetrik als auch die Gesamtkosten des Betriebs senken werden.

Die Implementierung großer Sprachmodelle (LLMs) innerhalb verteilter Systeme erfordert bedeutende architektonische Überlegungen, um die Rechenlasten und die Ressourcenzuweisung effizient zu verwalten. Eine detaillierte Untersuchung zeigt kritische Schwächen innerhalb der aktuellen Beschränkungen des Ressourcenallokationsdiagramms (RAG), insbesondere im Hinblick auf den Umgang mit umfangreichen Modellparameteranzahlen, Speicherzugriffen und Rechenpfaden.

Kontext

Der Implementierungsumfang von LLMs, der häufig Billionen von Parametern umfasst, bringt inhärente algorithmische Herausforderungen in Bezug auf Speicherfragmentierung und Latenzüberhänge mit sich. Bestehende RAG-Architekturen sind unzureichend, da sie Arbeitslasten nicht optimal über heterogene Verarbeitungseinheiten verteilen können. Dies erfordert eine architektonische Umstrukturierung, um Speicherzugriffsmuster und Effizienzen in Rechenpfaden zu optimieren.

Problemstellung

Die identifizierten Hauptprobleme umfassen:

1. Erhöhte algorithmische Komplexität aufgrund voluminöser Parameteranzahl, die zu ineffizienter Speicherverwaltung führt.

2. Fragmentierte Kommunikation innerhalb des verteilten Systems, die Latenzstrafen verschärft und den Gesamtdurchsatz verringert.

3. Unteroptimale Ressourcennutzung infolge unflexibler Lastverteilungsmechanismen, die in aktuellen RAG-Implementierungen inhärent sind.

Entscheidung

Eine umfassende Umstrukturierung des Architektursystems ist erforderlich, wobei die Entwicklung eines dynamischen Ressourcenallokationsmechanismus im Vordergrund steht, der eine Echtzeit-Anpassung der Lastverteilung ermöglicht. Dies umfasst die Einführung fortschrittlicher Speicherzugriffsstrategien wie vertikale und horizontale Speicherpartitionierung sowie verbesserte Knotenkommunikationsprotokolle zur Verbesserung der Latenzüberhänge.

Folgen

Erwartete Verbesserungen umfassen reduzierte Latenzzeiten durch kohärentere Daten- und Rechenwegführung, verminderte Häufigkeit von Speicherfragmentierung und erhöhter Rechendurchsatz über verteilte Systeme hinweg. Darüber hinaus werden diese Änderungen voraussichtlich eine skalierbarere Infrastruktur begünstigen, die zukünftige LLM-Iterationen erleichtert. Die Implementierung führt jedoch zu anfänglichem Rechenaufwand und erfordert gründliche Tests innerhalb bestehender Implementierungsrahmen.

Begründung

Diese Umstrukturierung ist wesentlich, um die Ineffizienzen durch den schieren Umfang der LLM-Parametrisierung anzugehen. Durch die Neugestaltung des RAG zur Unterstützung dynamischer Lastanpassungen und optimierter Kommunikationsprotokolle kann der Implementierungsrahmen signifikante Ressourceneffizienzgewinne erzielen, mit einer spürbaren Reduktion der algorithmischen Komplexität.

Zusätzliche Überlegungen

Zukünftige Untersuchungen sollten alternative verteilte Verarbeitungsmodelle, wie dezentralisierte Deep-Learning-Frameworks, prüfen, um die Effizienz und Skalierbarkeit von LLM-Implementierungen weiter zu verbessern.”