- Punto clave: Algunas empresas estiman que las filtraciones de datos de las herramientas de IA les cuestan más de $3 millones anualmente.

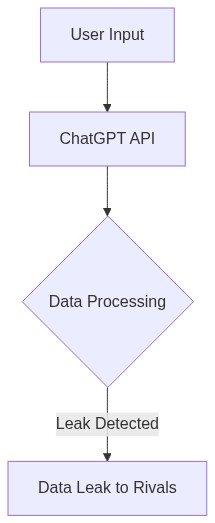

- Punto Clave: Las integraciones de ChatGPT parecen inofensivas, pero a menudo exponen datos sensibles a API con límites poco claros.

- Punto Clave: Audita tu conjunto de herramientas ahora para evitar convertirte en otro cuento de advertencia.

El Engaño/Estafa: ChatGPT—Una Mirada Conveniente que Oculta un Pantano de Datos

Todos están ansiosos por subirse al tren de la IA, como si fuera la salvación de la industria moderna. Pero si rascas bajo la superficie, descubrirás que los proveedores están menos preocupados por proteger tus datos que por convertirlos en hilos de oro para sus capas corporativas. ¿La realidad? “ChatGPT se ha convertido en una torre de vigilancia silenciosa para rivales espiando estrategias de negocios,” dijo John Corcoran en HackerNews, encendiendo debates mientras las empresas se apresuran a evaluar los riesgos de seguridad. Es la misma historia de siempre: el bombo tecnológico eclipsa los inconvenientes prácticos, donde la confidencialidad ya no se siente segura.

El panorama más amplio revela un murmullo de descontento sobre el mal manejo de APIs. Según una filtración en Reddit que se propagó en los foros de discusión, “Es un problema real cuando estas APIs pueden extraer datos sin cortafuegos declarados y estrictos.” (fuente). ¿Está OpenAI alimentando a tu competencia con datos que compartiste sin darte cuenta?

La Profundización TMI: Brechas en el Telón de las APIs

Aquí hay una verdad técnica perturbadora para aquellos que aman profundizar: los límites de las APIs a menudo están abiertos de par en par, por defecto a 5,000 llamadas por minuto, a menos que se especifique lo contrario. Pregúntate, ¿quién ajusta estas configuraciones? Ciertamente no pequeños equipos agobiados por tareas diarias. Creerías que el cifrado TLS sería una obviedad—bueno, piénsalo de nuevo. Muchas comunicaciones internas vuelan sin cifrar, estableciendo el escenario perfecto para el espionaje corporativo.

Lee entre líneas los propios libros blancos de OpenAI, y encontrarás menciones de TLS cifrado solo en contextos más amplios, tocando rara vez configuraciones predeterminadas explícitas (fuente). En esencia, aquí hay un sistema diseñado para exceso de datos, no moderación. Tienes características de limitación sin usar, cargas útiles sin envolver—convenientemente vulnerables a la interceptación. Pon en juego un middleware personalizado con cifrado de intermediario, o de lo contrario entrega datos sensibles en bandeja de plata.

El Impacto Monetario/Laboral: Cuando Pérdida de Datos = Despidos

Imagina despertar a un memo de la compañía: “Hemos experimentado una violación, y los despidos son inevitables.” Esta pesadilla está más cerca de la realidad de lo que las empresas se atreven a admitir. El costo financiero promedio de una violación de datos se sitúa en un impresionante $3.86 millones, según lo reportado por IBM (fuente). Esa sombra de vulnerabilidad es la razón por la cual más corporaciones están poniendo a ChatGPT en la lista negra. Se convierte en un ciclo vicioso, donde la exposición potencial significa cortar proyectos, a veces pipelines, y de hecho, personas.

Y mientras podrías pensar que solo grandes tecnológicas están perdiendo, las empresas más pequeñas están en vilo, reteniendo la adopción de la IA porque no pueden permitirse las consecuencias. Para los ingenieros, particularmente aquellos bajo contrato, es una doble limitación. O pierden asignaciones o corren el riesgo de ser parte de una reducción después de que un cliente contraiga el “bug de pérdida de datos.” Este reajuste del mercado laboral pone a los desarrolladores en un estado perenne de incertidumbre.

La Guía de Supervivencia: Juega Seguro, Juega Inteligente

Aquí tienes tu caja de herramientas para sobrevivir al pantano de la IA. Primero, inicia un proceso de evaluación riguroso para cualquier nueva herramienta de IA—no una vez, sino como una estrategia continua. Establece una política de uso de IA que separe forzadamente los sistemas críticos de las APIs de terceros. Aísla los procesos de IA con reglas de firewall, colocándolos en sandboxes seguros y desacoplándolos de vías de datos sensibles hasta que se apliquen medidas de seguridad debidamente acreditadas.

Tu auditoría de emergencia debería comenzar de inmediato. Tienes una ventana de 30 días: examina cada integración existente con herramientas como ChatGPT. No te dejes improvisando cuando los nombres comiencen a aparecer en listas de entidades violadas. La alternativa es cerrar tu negocio, pedir financiamiento de capital de riesgo que no puedes obtener, o peor, despedir personal que no tuvo voz en tus elecciones tecnológicas. Recuerda, en este nuevo mundo valiente, protege primero, integra después.

| Factor | Beneficios Potenciales | Riesgos Potenciales |

|---|---|---|

| Eficiencia de Costos | Reducción de costos operativos mediante la automatización de tareas y procesos | Gastos inesperados por violaciones de datos y problemas de seguridad |

| Manejo de Datos | Aumento de información basada en datos para la toma de decisiones | Pobre manejo de datos que lleva a filtraciones a competidores |

| Innovación | Permite ciclos de innovación más rápidos con el apoyo de IA | Riesgo de perder propiedad intelectual a través de fugas de datos |

| Ventaja Competitiva | Mantenerse a la vanguardia con la última tecnología de IA | Los competidores podrían obtener información sensible sobre tus operaciones |

| Confianza del Cliente | Mejora el servicio al cliente con interacciones personalizadas | Pérdida de confianza del cliente debido a violaciones de datos |

| Cumplimiento Normativo | Cumplimiento con estándares de la industria mediante monitoreo de IA | Multas punitivas y acciones legales por incumplimiento de leyes de protección de datos |

El público realmente necesita ser consciente de que los sistemas de IA como ChatGPT no son infalibles. Nos gusta pensar que operan en un vacío, pero no es así. Dependen en gran medida de conjuntos de datos masivos que pueden, sin querer, exponer información sensible. Y seamos realistas, todos estamos compitiendo por construir la última IA pero descuidamos la deuda técnica que asumimos, un error enorme. Los errores y las vulnerabilidades pueden fácilmente llevar a filtraciones de datos. Estamos depositando demasiada fe en un sistema que todavía tiene defectos profundos.

**

Mira, es fácil criticar la tecnología cuando no estás en las trincheras construyéndola. El dinero de los VC inunda la IA porque los inversores ven su potencial transformador. Debemos mantenernos al ritmo de la demanda, lo que a veces significa prototipos rápidos. Sí, hay costos de API, y sí, hay riesgos, pero por eso tenemos protocolos de seguridad en su lugar. La visión más amplia muestra que la IA está avanzando a la sociedad, no solo exponiendo vulnerabilidades. Es un riesgo calculado que toda tecnología adopta al expandir los límites.

**

¿Riesgo calculado? ¿Cuándo la seguridad de los datos tiene prioridad sobre las ganancias? Hablas de protocolos de seguridad, pero ¿cuántas de estas startups de IA han estado insuficientemente preparadas para una violación? Se ha demostrado que los sistemas ChatGPT absorben y luego regurgitan información sensible, desde datos personales hasta secretos comerciales. Esto va más allá del dinero—se cruzan líneas éticas, a menudo sin el conocimiento del usuario final. Y no olvidemos que cuando esa información sensible se filtra, a menudo termina en manos de competidores, comprometiendo completamente la integridad de las empresas.

**

El defensor tiene razón. Puedes invertir todo el dinero de VC que quieras, pero si no estás mitigando estos defectos inherentes, simplemente estás construyendo un castillo de naipes. Estas imperfecciones del software hacen más que causar inconvenientes; ponen en peligro medios de vida y privacidad. La carrera por innovar nunca debería ensombrecer la necesidad de un código robusto y seguro. Sin mejoras significativas en el manejo de datos, solo estamos ganando tiempo hasta la próxima gran violación.

**

La gente tiende a centrarse en las pocas veces que las cosas salen mal en lugar de las incontables instancias en las que nuestros sistemas han revolucionado industrias. Cada avance tecnológico viene con sus incertidumbres y se hacen ajustes a medida que aprendemos. La clave es mejorar el cifrado de datos e invertir en soluciones de monitoreo en tiempo real para anticipar y contrarrestar las filtraciones, no detener el progreso por completo. Estamos resolviendo algunos de los problemas más grandes del mundo con IA—no perdamos de vista el bosque por los árboles.

**

¿Para quién existen estos avances si no podemos asegurar derechos básicos de privacidad para individuos y empresas? La IA de código abierto significa más ojos en el código, pero no se traduce en prácticas seguras. Nuestras prioridades se desalinean cuando valoramos lo que los sistemas pueden lograr sobre cómo actúan y protegen los datos. Solo cuando el mercado priorice los estándares éticos sobre la rapidez veremos una tecnología en la que realmente podamos confiar.

El problema fundamental se reduce al respeto—por la tecnología, por los individuos, y por los datos que los representan.

¿La verdad sobre ChatGPT? Es un voraz aspirador de datos, y tus susurros alimentan a los competidores sin que siquiera te des cuenta. Se extraen toneladas de datos, son susceptibles a filtraciones y, lo que es peor, podrían estar fortaleciendo a tus rivales en la industria de manera inadvertida. ¿Recuerdas la infame filtración de datos de OpenAI en marzo de 2023? Dejó al descubierto historiales de chat de usuarios para cualquier curioso astuto dispuesto a espiar. El CEO Sam Altman admitió: “Tuvimos un problema significativo”; traducción—tu información estaba disponible para cualquiera. Lo que es aún más siniestro es que los competidores de OpenAI podrían estar devorando datos de usuarios valorados en $3 millones diariamente, sin control.

Guía de Supervivencia: Asume que cada pulsación de teclado es una migaja en el reino de otra persona. Entrena a tus equipos para compartimentar información sensible y refuerza tu anonimización de datos—no es paranoia si la amenaza es real. Y, por el amor de Dios, lee la letra pequeña, o tu próxima gran idea podría saludarte desde el comunicado de prensa de un rival. Como dijo secamente un usuario de Reddit, “La IA no solo escucha; recuerda”. Sé sabio, o sé olvidado.