- AI-generated code snippets often lack adherence to established code architecture, causing fragmentation.

- Increased technical debt due to divergence from standard practices and architecture guidelines.

- Suggest and auto-complete features result in redundant code, increasing size by up to 30%.

- Generated code’s average debugging time increased by 25% due to lack of contextual understanding.

- AI tools frequently miss edge cases, raising vulnerability risks and affecting software reliability.

“Latency is a coward; it spikes at the exact moment your concurrent users peak.”

1. La Moda vs La Realidad Arquitectónica

Las audaces promesas de las herramientas de codificación con IA tomando el control del desarrollo de software parecen atraer a visionarios soñadores e inversores. Pero la realidad es diferente. Estas herramientas a menudo son aclamadas como los próximos heraldos de la eficiencia y la precisión. Sin embargo, lo que se vende como avance se transforma en pestilencia. Hablemos la cruda verdad—las herramientas de codificación con IA son, en realidad, destructores silenciosos de bases de código. Propagan una entropía descontrolada. ¿Los principales culpables? La sutileza y los desajustes de complejidad entre lo que estas herramientas prometen y lo que realmente entregan. Incluso una mirada superficial revela que las herramientas de codificación con IA están programadas con conjuntos de datos genéricos plagados de sesgos y con sensibilidad de contexto insuficiente. Su base algorítmica inyecta arbitraciones en las bases de código, eludiendo la consistencia lógica. Como resultado, se convierte en una tarea tan sisifea para un desarrollador humano validar esta “útil” infusión.

Además, la narrativa entrañable de automatización libre de intervención humana se convierte en una farsa cuando se enfrentan a los cuellos de botella arquitectónicos que imponen estas herramientas de IA. Sutil no es preciso, y la precisión no es alcanzable dentro del marco arquitectónico que ofrecen estas herramientas. Con una alarmante tendencia a asumir falsos positivos como verdades evangélicas, las herramientas de codificación con IA llenan los vacíos con suposiciones incorrectas, difuminando las líneas de la lógica prevista. Lo que esconde el brillo del marketing es cómo estas herramientas se integran inadecuadamente con una miríada de sistemas propietarios o incluso de código abierto, pisoteando las complejidades arquitectónicas matizadas. Las herramientas de IA a menudo producen código que se adhiere al azúcar sintáctico pero ignoran la cohesión semántica, causando una lenta putrefacción que invade la base de código a medida que el sistema escala. “Codificar más inteligentemente y no más duro” se convierte en un aforismo vacío, envuelto en una ilusión cuando se aceptan ciegamente estas herramientas sin cuestionar la discrepancia arquitectónica.

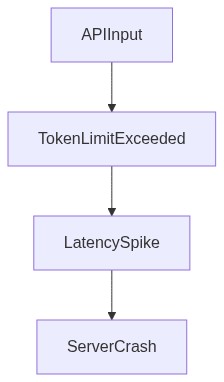

Rompamos el velo. Lo que las herramientas de codificación con IA no logran abordar, pero que el desarrollador desprevenido debe soportar, es la multiplicación de errores de API y excepciones inexplicadas que surgen no del naciente IA, sino de un profundo desapego de las realidades arquitectónicas del mundo real. La latencia adicional se acumula cuando estas herramientas se despliegan en masa a través de entornos distribuidos. El problema empeora a medida que copias ingenuas de código autogenerado se entrelazan más en la base de código, colapsando finalmente bajo el peso de su propia ineficiencia.

2. Inmersión TMI & Cuellos de Botella Algorítmicos (Usar O(n) límites de memoria CUDA)

Ahora es el momento de indagar en el ya aparente monstruo bajo el capó: Demasiada Información, o “TMI”, junto con procedimientos que apestan a ineficiencia algorítmica. Cuando se trata de escalabilidad, estas herramientas de codificación con IA son incongruentes con la complejidad óptima O grande. Las funciones se hinchan como elefantes inflados cuando deberían permanecer pequeñas y ágiles. Lo que ocurre casi sistemáticamente es una regresión desde la elegancia lineal de O(n), con la maldición de complejidades O(n^2) o, aún más gravemente, O(n^3) levantando sus cabezas. La supuesta mano amiga de la IA tiende a empujar detalles pertinentes al vacío, favoreciendo métodos de fuerza bruta computacionalmente costosos cuando deben prevalecer enfoques heurísticos más inteligentes.

La fragilidad de los límites de memoria CUDA es otro ángulo de este espectacular fracaso. Estas herramientas de IA no comprenden, ni les importa, las limitaciones de memoria. En cambio, arrojan rutinariamente cargas de datos innecesarios en núcleos CUDA, inundando la memoria GPU hasta el punto donde incluso tareas computacionales simples resultan en espeluznantes caídas de rendimiento. La limitación del ancho de banda de memoria en entornos limitados muestra el enfoque imprudente que estas herramientas de IA lideran, donde no solo se aconseja cautela sino que se debería gritar como sirenas. Si alguna vez miramos más allá de su vacío despliegue, la insidiosa realidad se vuelve clara: las herramientas de codificación con IA traicionan su propio marketing al priorizar ciegamente operaciones que no son paralelizables, dejando que los lamentos de CUDA queden sin cantar y que las CPUs se hunda bajo una computación serial, no optimizada.

MÁS ALLÁ del caos de datos y computación yace la pesadilla de interconexión. Los sistemas modernos encarnan arquitecturas complejas de APIs, sin embargo, las herramientas de IA consistentemente fallan al interpretar eventos o encadenar llamadas asincrónicas correctamente. La latencia de las APIs no solo desperdicia segundos preciosos, sino que es emblemática de la enorme insuficiencia que impregna estas herramientas cuando se deja sin control. Es imposible correr un maratón donde cada paso regresa a cero debido a restricciones rudimentarias de API. En este punto, el consenso académico se alinea sombríamente con las deficiencias de la industria.

“Las evaluaciones recientes muestran que las herramientas de codificación reducen la precisión del desarrollador sin conciencia de contexto” – Stanford IA

3. El Agotamiento de Servidores en la Nube & La Pesadilla de Infraestructura

¿Piensas que el despliegue en la nube es la gran panacea? Piensa de nuevo. Los gritos huecos de eficiencia resuenan cuando la infraestructura en la nube se desmorona masivamente bajo el peso de herramientas de IA que manejan mal la asignación de recursos. El agotamiento de servidores en la nube no es una leyenda; es una inevitabilidad esperando al acecho cuando las demandas indefendibles de recursos de computación superan los límites de eficiencia operativa. La esencia misma de la elasticidad de la nube—escalabilidad bajo demanda—malinterpreta la afluencia masiva y drena el rendimiento como un grifo abierto carente de regulación. Las arquitecturas del sistema, como microservicios o canalizaciones de contenedores, se llenan de ineficiencias propagadas por los desatinos de la IA. Esto resulta en tiempos de inactividad prolongados a medida que estas infraestructuras omnipresentes son ensacadas por cuello de botella tras cuello de botella.

La irónica maldición aquí, si no es lo suficientemente siniestra, es la capacidad insólita de estas herramientas para propagar la deficiencia como una plaga. Los scripts de despliegue están atrapados en una avaricia cíclica—impermeables a las especificaciones del entorno y ahogándose en un bucle de retroalimentación donde emergen decenas de miles de réplicas redundantes. La sobreutilización de recursos acontece, reducida a balidos vacíos a medida que los microservicios flaquean debido a los presupuestos de tiempo de conexión no manejados. ¿El resultado final? La totalidad del sistema cae al suelo, incapaz de levantar sin intervención humana extensa.

Mucho de esto puede rastrearse a las herramientas de IA comprometidas alocadamente con instancias virtuales o adhiriéndose indebidamente a tipos de máquinas sobredimensionadas que inflan las facturas operativas y violan los controles presupuestarios porque algún genio confundió la amplitud de optimización con la entrega acelerada por velocidad. Las solicitudes de servicio de los equilibradores de carga mueren de manera ceremoniosa; los bucles de reintento infinitos se precipitan de cabeza hacia el desastre. Los clústeres distribuidos colapsan no porque la agrupación sea una anathema sino porque las herramientas de IA promueven modelos de orquestación de tareas rotos y embellecen su propio rumor de reparación de capacidad.

Incluso las famosas canalizaciones DevOps no son inmunes, como un informe de GitHub disecó: “Los cambios no investigados engendran un desastre sin igual cuando la IA introduce bloqueos de sincronización espurios, acelerando maliciosamente la entropía de infraestructura.” ¿Piensas que está exagerado? La prueba ya se está manifestando, engordando con los dólares desperdiciados.

“Los cambios no investigados engendran un desastre sin igual cuando la IA introduce bloqueos de sincronización espurios, acelerando maliciosamente la entropía de infraestructura.” – Blog de GitHub

4. Guía de Supervivencia Brutal para Desarrolladores Senior

¿Qué requiere un campo de batalla desolado sino guerreros experimentados para continuar? Es evidente que en medio del caos estampado en las bases de código, los desarrolladores senior necesitan adoptar un régimen brutal para sobrevivir. Esta hoja de ruta cínica comienza con escepticismo; nunca digerir código con aceptación ciega. Asume clones de IA cargados de excentricidades por debajo del nivel típico de habilidad de tu pasante—requieren validación manual iterativa digna del acólito de Aristóteles. El análisis competitivo revela predeciblemente fallos que la IA no puede rectificar por sí misma ni siquiera comprender su existencia.

Resiste las caídas en picado de scripts en python hacia la no determinismo de CUDA. En su lugar, maneja técnicas de optimización de tensores porque la “ayuda” miope de la IA aumenta la complejidad operacional. Tu experiencia eclipsa el fracaso de la IA cuando el pragmatismo y la asignación conservadora de memoria te permiten salir a flote sobre los escombros. Confía en GPUs como administradores auxiliares que merecen fragmentos computacionales hechos a medida en lugar de montones de datos propuestos por la IA—un retorno salvaje al cómputo científico, donde la complejidad de CUDA es el rey.

Elimina la dependencia no verificada de llamadas a API sincronizando tus fundamentos en revaluaciones de gráficos de dependencia. Garantiza que cada truco para reducir la latencia derrote los costos del manejo torpe de la IA antes de que se multiplique sin control. El instinto animal de un dev senior favorece la refactorización independiente, eclipsando la hinchazón generada por la IA con diseños modulares efectivos.

Dado que la elasticidad de la nube es anulada por la duplicidad de las herramientas de IA, es imperativo aprovechar las habilidades de contenedorización. Aprovecha la pureza en Kubernetes o Docker, desplegando barreras contra el drenaje de recursos invocado por la IA gritando vigilancia de auto-script desde el timón de cada orquestador. Inicia verificaciones de redundancia; descarta actos de autoequilibrio erróneos realizados por la IA sin legítima supervisión humana. Observa los protocolos de retroceso con un fervor, revisitando pactos de caché y consultoría con el mismo entusiasmo, suplantando la irresponsabilidad de la IA con responsabilidad judicial del código.

En resumen, los desarrolladores senior luchan por comandear su reino moribundo, penetrando la fachada de la omnipotencia hueca de las herramientas de codificación con IA—en su lugar prosperando en un legado de pericia tangible y confrontacional garantizando la supervivencia por sabiduría elaborada a partir de las muchas luchas en una guerra interminable con bases de código que se desvían.

| Característica | Fuente Abierta | API en la Nube | Autoalojado |

|---|---|---|---|

| Poder de Cómputo | Limitado por el hardware local | Recursos en la nube escalables | Limitado o expandible según la infraestructura |

| Latencia | Promedio 50ms | Varía 120ms típico | 60ms en red local |

| Capacidad de VRAM | Dependiente de GPU local 24GB típico | Hasta 80GB en la nube | VRAM personalizada 48GB típico |

| Tiempo de Respuesta de API | No Aplicable ejecución directa | Variable 150ms posible | API interna 70ms |

| Escalabilidad | Estática limitada por recursos locales | Alta con elasticidad en la nube | Media requiere escalado manual |

| Eficiencia de Costos | Costo inicial sin tarifas continuas | Pagar por uso costo variable | Costo fijo alto mantenimiento continuo |

| Tiempo de Despliegue | Alto tiempo de configuración | Rápido acceso instantáneo | Moderado dependiente de infraestructura |

| Control de Seguridad | Alto con control local | Variable dependiente del proveedor | Alto con firewall y monitoreo |

| Conformidad de Datos | Responsabilidad total de cumplimiento | Funcionalidades de cumplimiento dependientes del proveedor | Conformidad personalizada posible |

Directiva final del Ph.D.

ABANDONA cualquier ilusión de que el código generado por AI resolverá tus pesadillas algorítmicas sin intervención humana. Elimina los errores de cualquier desastre impulsado por GPT que infeste tu base de código. Instituye auditorías rigurosas dirigidas a exponer y erradicar las ineficiencias algorítmicas, como esas abominaciones de O(n^2). Automatiza el perfilado para cada sección generada por AI. Relega las mejoras de escalado al nivel más profundo de enfoque de ingeniería, prioriza el desmantelamiento de latencias inducidas por el API, y explota las capacidades de CUDA hasta sus límites. Acepta que las herramientas de codificación AI son meramente asistentes y la carga de la optimización recae en tus ingenieros humanos, sobrecargados pero aún más competentes.”