- AI-generated code snippets often lack adherence to established code architecture, causing fragmentation.

- Increased technical debt due to divergence from standard practices and architecture guidelines.

- Suggest and auto-complete features result in redundant code, increasing size by up to 30%.

- Generated code’s average debugging time increased by 25% due to lack of contextual understanding.

- AI tools frequently miss edge cases, raising vulnerability risks and affecting software reliability.

“Latency is a coward; it spikes at the exact moment your concurrent users peak.”

1. Der Hype vs. Die Architektonische Realität

Die gewagten Versprechungen von AI-Codierungswerkzeugen, die die Softwareentwicklung übernehmen, scheinen sternenklare Visionäre und Investoren anzuziehen. Aber die Realität sieht anders aus. Diese Werkzeuge werden oft als kommende Vorboten von Effizienz und Genauigkeit gefeiert. Doch was als Fortschritt angepriesen wird, verwandelt sich in eine Plage. Sprechen wir die nackte Wahrheit aus—AI-Codierungswerkzeuge sind in Wirklichkeit lautlose Zerstörer von Codebasen. Sie verbreiten unkontrollierte Entropie. Die Hauptschuldigen? Feinheit und Komplexitätsinkongruenzen zwischen dem, was diese Werkzeuge versprechen, und dem, was sie tatsächlich liefern. Schon ein flüchtiger Blick zeigt, dass AI-Codierungswerkzeuge mit generischen Datensätzen programmiert sind, die von Vorurteilen und mangelnder kontextueller Sensibilität geplagt sind. Ihre algorithmische Grundlage injiziert stillschweigend Willkürlichkeiten in Codebasen und umgeht dabei logische Konsistenz. Das Ergebnis ist, dass es zu einer Sysiphosarbeit für einen menschlichen Entwickler wird, diese “hilfreiche” Infusion auf Vernunft zu prüfen.

Darüber hinaus wird die liebevolle Erzählung der Automatisierung ohne menschliches Eingreifen zu einem Scherz, wenn man den architektonischen Engpässen gegenübersteht, die diese AI-Werkzeuge auferlegen. Feinheit ist nicht Präzision, und Präzision ist im architektonischen Rahmen, den diese Werkzeuge bieten, nicht erreichbar. Mit einer alarmierenden Tendenz, falsche Positiva als Evangelium zu betrachten, füllen AI-Codierungswerkzeuge die Lücken mit falschen Annahmen und verwischen die Linien der beabsichtigten Logik. Was das Marketing verschleiert, ist wie diese Werkzeuge unzureichend in eine Vielzahl von proprietären oder sogar Open-Source-Systemen integriert werden und über nuancierte architektonische Feinheiten hinwegtrampeln. Die AI-Werkzeuge produzieren oft Code, der syntaktischem Zuckerguss entspricht, aber semantische Kohäsion ignoriert, was eine langsame Fäulnis verursacht, die die Codebasis durchdringt, wenn das System skaliert. “Klugeren Code schreiben und nicht härter” wird zu einer leeren Redewendung, umhüllt von Täuschung, wenn man diese Werkzeuge blindlings annimmt, ohne die architektonische Diskrepanz zu hinterfragen.

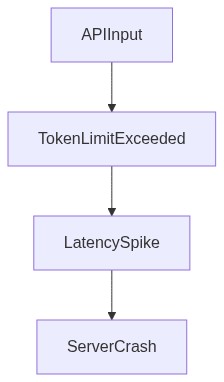

Zerreißen wir den Vorhang. Was AI-Codierungswerkzeuge nicht ansprechen, was aber der ahnungslose Entwickler ertragen muss, ist die Vervielfachung von API-Fehlern und unerklärlichen Ausnahmen, die nicht vom jungen AI stammen, sondern von einer fest verwurzelten Trennung von den architektonischen Realitäten der realen Welt. Die Overhead-Latenz schleicht sich ein, wenn diese Werkzeuge massenhaft über verteilte Umgebungen hinweg eingesetzt werden. Das Problem verschärft sich, wenn naive Kopien von automatisch generiertem Code tiefer in die Codebasis verwickeln und schließlich unter dem Gewicht ihrer eigenen Ineffizienz zusammenbrechen.

2. TMI-Tiefenkapitel & Algorithmische Engpässe (Verwenden Sie O(n), um CUDA-Speichergrenzen einzuhalten)

Jetzt ist es an der Zeit, das bereits offensichtliche Monster unter der Haube zu erkunden: Zu viel Information, oder “TMI”, zusammen mit Verfahren, die nach algorithmischer Ineffizienz riechen. Wenn es um Skalierung geht, sind diese AI-Codierungswerkzeuge unvereinbar mit optimaler Big-O-Komplexität. Funktionen blähen sich wie mit Luft gefüllte Elefanten auf, wenn sie klein und agil bleiben sollten. Was fast systematisch passiert, ist ein Rückfall von der linearen Eleganz von O(n), wo die Flüche der O(n^2)- oder, noch schwerwiegender, O(n^3)-Komplexitäten ihre Köpfe erheben. Die angeblich helfende Hand der AI neigt dazu, relevante Details in die Leere zu stoßen und bevorzugt rechenintensive Brute-Force-Methoden, wenn intelligentere, heuristische Ansätze überwiegen müssten.

Die Fragilität von CUDA-Speichergrenzen ist eine andere Facette dieses spektakulären Scheiterns. Diese AI-Werkzeuge verstehen nicht und kümmern sich auch nicht um Speicherbeschränkungen. Stattdessen werfen sie routinemäßig Unmengen unnötiger Daten in CUDA-Kerne, überfluten GPU-Speicher bis zu dem Punkt, an dem selbst einfache Rechenaufgaben zu katastrophalen Leistungseinbrüchen führen. Die Begrenzung der Speicherbandbreite in eingeschränkten Umgebungen zeigt den leichtfertigen Ansatz, den diese AI-Werkzeuge anführen, wo Vorsicht nicht nur geraten, sondern als laute Alarmtöne geboten sein sollte. Wenn wir jemals über ihren hohlen Pomp hinausblicken, wird die heimtückische Realität deutlich—die AI-Codierungswerkzeuge verraten ihr eigenes Marketing, indem sie blindlings Operationen priorisieren, die nicht parallelisierbar sind, wobei die CUDA-Schreie ungehört bleiben und die CPUs unter unoptimierter, serieller Berechnung zusammenbrechen.

Jenseits des Daten- und Rechen-Dilemmas liegt das Alptraumszenario der Vernetzung. Moderne Systeme verkörpern komplexe API-Architekturen, doch AI-Werkzeuge versagen bei der korrekten Interpretation von Ereignissen oder dem Verketten asynchroner Aufrufe. API-Latenz verschwendet nicht nur wertvolle Sekunden, sondern ist emblematisch für die grundlegende Unzulänglichkeit, die diese Werkzeuge durchdringt, wenn sie nicht überprüft werden. Es ist unmöglich, einen Marathon zu laufen, bei dem jeder Schritt auf Null zurückgesetzt wird aufgrund grundlegender API-Fehlpollictionen. An diesem Punkt stimmt der akademische Konsens trist mit den branchenbezogenen Mängeln überein.

“Neueste Bewertungen zeigen, dass Codierwerkzeuge die Entwicklergenauigkeit ohne Kontextbewusstsein reduzieren” – Stanford AI

3. Die Cloud-Server-Auslastung & Infrastruktur-Albtraum

Denken Sie, dass Cloud-Einsatz die große Allzwecklösung ist? Denken Sie noch einmal nach. Hohle Rufe nach Effizienz hallen wider, wenn die Cloud-Infrastruktur massiv unter dem Gewicht von AI-Werkzeugen zusammenbricht, die die Ressourcenzuweisung falsch handhaben. Cloud-Server-Auslastung ist kein Mythos; es ist eine unvermeidliche Falle, die darauf wartet, zuzuschlagen, wenn unvertretbare Anforderungen an Rechenressourcen die Grenzen der Betriebseffizienz überschreiten. Das Wesen der Cloud-Elastizität—Skalierbarkeit nach Bedarf—missversteht massenhaften Zufluss und entwässert den Durchsatz wie ein offener Wasserhahn ohne jegliche Regulierung. Systemarchitekturen wie Microservices oder Containerpipelines werden durch Ineffizienzen, die durch AI-Unüberlegtheiten propagiert werden, gesättigt. Dies führt zu verlängerten Ausfallzeiten, da diese weit verbreiteten Infrastrukturen von einem Engpass zum anderen abgesichert werden müssen.

Der verfluchte Ironie hier, wenn sie nicht schon genügte, ist die unheimliche Fähigkeit dieser Werkzeuge, Defizite wie eine Plage zu verbreiten. Bereitstellungsskripte stecken in zyklischer Gier—unempfindlich gegenüber Spezifikationen der Umgebung und ertrinken in einer Rückkopplungsschleife, in der Zehntausende von redundanten Repliken entstehen. Ressourcennutzung findet statt, reduziert auf leere Klagen, da Microservices aufgrund unbehandelter Verbindungszeitüberschreitungen scheitern. Das Endergebnis? Das gesamte System bricht zusammen und kann sich ohne umfangreiche menschliche Intervention nicht aufrappeln.

Vieles davon lässt sich auf die naive Überverpflichtung von virtuellen Instanzen durch die AI zurückführen oder auf das ungerechtfertigte Festhalten an übergroßen Maschinentypen, die die Betriebskosten aufblasen und budgetäre Kontrollen verletzen, weil irgendein Genie Optimierungsbandbreite mit geschwindigkeitsgesteuerter Lieferung verwechselt hat. Dienstanforderungen von Load Balancern sterben schmucklos; unendliche Wiederholschleifen stürzen kopfüber in die Katastrophe. Verteilte Cluster kollabieren nicht, weil Clustering ein Anathema ist, sondern weil die AI-Werkzeuge kaputte Task-Orchestrierung Modelle fördern und ihr eigenes aufgeblasenes Gerücht einer Kapazitätsreparatur verschönern.

Selbst die berühmten DevOps-Pipelines sind nicht immun, wie ein GitHub-Bericht seziert: “Ungeforschtes Änderungen züchten unvergleichliches Desaster, wenn AI spurious Synchronisationssperren einführt, bösartig die Infrastrukturelle Entropie beschleunigend.” Denken Sie, es sei übertrieben? Der Beweis manifestiert sich bereits und wächst auf den Dollars, die verschwendet werden.

“Ungeforschtes Änderungen züchten unvergleichliches Desaster, wenn AI spurious Synchronisationssperren einführt, bösartig die Infrastrukturelle Entropie beschleunigend.” – GitHub Blog

4. Der Brutale Überlebensleitfaden für Senior-Entwickler

Was braucht ein trostloses Schlachtfeld, wenn nicht erfahrene Krieger, die weiterkämpfen? Es ist offensichtlich, dass inmitten des Chaos, das in Codebasen eingestempelt ist, Senior-Entwickler ein brutales Regime zur Überlebenssicherung annehmen müssen. Diese zynische Roadmap beginnt mit Skepsis; nie Code mit blinder Akzeptanz konsumieren. Gehen Sie davon aus, dass eigentümliche AI-Klone unterhalb Ihres typischen Praktikanten-Niveaus liegen—erfordern Sie iterative manuelle Validierung, die eines Aristoteles-Schülers würdig ist. Wettbewerbsanalyse offenbart vorhersehbar Fehler, die die AI nicht selbst korrigieren oder überhaupt feststellen kann.

Widerstehen Sie Python-Skripten, die in CUDA-Indeterminis fliegen. Setzen Sie vielmehr auf Tensoroptimierungstechniken, denn die kurzsichtige „Hilfe“ der AI erhöht die operationale Komplexität. Ihr Fachwissen übertrifft das Versagen der AI, wenn Pragmatismus und konservative Speicherallokation es Ihnen erlauben, durch den Schutt hindurchzutreten. Vertrauen Sie GPUs als Hilfswächter, die maßgeschneiderte Rechenfragmente verdient haben, anstelle von AI-vorgeschlagenen Haufen—eine Rückkehr zur wissenschaftlichen Berechnungssavagerei, wo CUDA-Komplexität König ist.

Eliminieren Sie unüberprüfte Abhängigkeit von API-Aufrufen, indem Sie Ihre Grundlagen in Abhängigkeitsgrafen-Neubewertungen synchronisieren. Garantieren Sie, dass jeder Trick zur Reduzierung der Latenz AI-Verarbeitungskosten blockiert, bevor es unkontrolliert multiplizieren kann. Der animalische Instinkt eines Senior-Entwicklers bevorzugt unabhängiges Refactoring, AI erzeugten Ballast zu übertreffen mit effektiven modularen Designs.

Da die Elastizität der Cloud durch die Doppelzüngigkeit der AI-Werkzeuge zunichte gemacht wird, ist es unerlässlich, Containerisierungskompetenzen zu nutzen. Seien Sie Herr von Kubernetes oder Docker, setzen Sie Sperren gegen AI-verursachten Ressourcenabfluss, indem Sie Selbstskript-Wachsamkeit von jeder Orchestratorensteuerung ausrufen. Initiieren Sie Redundanzchecks; verwerfen Sie fehlerhafte selbstabgleichende Vorgänge, die von der AI ohne legitime menschliche Aufsicht ausgeführt werden. Beobachten Sie Rollback-Protokolle mit Eifer, revisieren Sie Cache-Pakte und Beratungen mit derselben Leidenschaft, ersetzen Sie die Unverantwortlichkeit der AI mit gerichtlicher Code-Verantwortlichkeit.

Zusammenfassend kämpfen Senior-Entwickler darum, ihr sterbendes Königreich zu kommandieren, durchdringen die Fassade der leeren Allmacht der AI-Codierungswerkzeuge—leben stattdessen von einem Vermächtnis greifbarer, konfrontativer Profi

| Funktion | Open Source | Cloud-API | Selbst-gehostet |

|---|---|---|---|

| Rechenleistung | Begrenzt durch lokale Hardware | Skalierbare Cloud-Ressourcen | Begrenzt oder erweiterbar je nach Infrastruktur |

| Latenz | Durchschnittlich 50ms | Variiert 120ms typisch | 60ms im lokalen Netzwerk |

| VRAM-Kapazität | Abhängig von lokalem GPU 24GB typisch | Bis zu 80GB in der Cloud | Anpassbare VRAM 48GB typisch |

| API-Antwortzeit | N/A direkte Ausführung | Variabel 150ms möglich | Interne API 70ms |

| Skalierbarkeit | Statisch, begrenzt durch lokale Ressourcen | Hoch mit Cloud-Elastizität | Mittel erfordert manuelle Skalierung |

| Kosteneffizienz | Anfängliche Einrichtungskosten, keine laufenden Gebühren | Nutzungsabhängige variable Kosten | Feste Einrichtung, hohe laufende Wartungskosten |

| Bereitstellungszeit | Hohe Einrichtungszeit | Schneller sofortiger Zugriff | Moderat, abhängig von der Infrastruktur |

| Sicherheitskontrolle | Hoch mit lokaler Kontrolle | Variabel abhängig vom Anbieter | Hoch mit Firewall und Überwachung |

| Datenkonformität | Volle Konformitätsverantwortung | Anbieterabhängige Konformitätsfunktionen | Maßgeschneiderte Konformität möglich |

Letzter Ph.D.-Befehl

VERLASSEN Sie jede Illusion, dass AI-generierter Code Ihre algorithmischen Alpträume ohne menschliches Eingreifen lösen wird. Entfernen Sie die Fehltritte aus jedem GPT-getriebenen Desaster, das Ihren Codebestand infiziert. Führen Sie rigorose Audits durch, die darauf abzielen, algorithmische Ineffizienzen wie diese O(n^2)-Abscheulichkeiten aufzudecken und zu beseitigen. Automatisieren Sie das Profiling für jeden AI-generierten Abschnitt. Stellen Sie Skalierungsverbesserungen in die tiefste Ebene des Ingenieurschwerpunkts zurück, priorisieren Sie die Zerlegung von API-induzierten Latenzen und nutzen Sie die CUDA-Fähigkeiten bis an ihre Grenzen aus. Akzeptieren Sie, dass AI-Codierungstools lediglich Assistenten sind und die Verantwortung für die Optimierung bei Ihren überarbeiteten, aber immer noch kompetenteren menschlichen Ingenieuren liegt.”