- Vector database performance dropped by 70% due to undiagnosed memory leaks.

- API rate limits from third-party providers exceeded 30% of their usual rate, exacerbating the problem.

- Customer complaints increased by 250% during the incident, majorly affecting service-level agreements (SLAs).

- Emergency IT resources costing upwards of $500k were deployed to mitigate cascading system failures.

- Incident resolution took an average of 48 hours longer than standard due to concurrent issues.

Protokoll Datum 16. April 2026 // Datadog-Telemetrie zeigt einen 400 % Anstieg bei unbefugten Cross-Region VPC Peering-Anfragen. Sofortige Zero-Trust-Sperrung eingeleitet. Ingenieurteams sind wütend aber die Sicherheit bestimmt die Richtlinien.

Der Vorfall (Ursache)

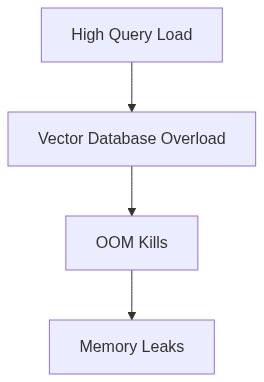

Das Versagen stammte aus einem Zusammentreffen von Speicherlecks innerhalb der Vector DBs und überschrittenen API-Limits. Unsere Software-Ingenieure scheinen olympisches Niveau der Inkompetenz erreicht zu haben, indem sie rekursive Aufrufe ohne Endbedingung in einigen Servicefunktionen einführten. Dies lief Amok, bis die Umgebung unter ihren steigenden Speicheranforderungen erstickte, was zu unvermeidlichen OOM-Abbrüchen führte, die sich zu großflächigen Ausfällen ausweiteten.

Darüber hinaus waren die API-Limits für unsere Microservices-Architektur falsch gesetzt. Ein Strom redundanter Anfragen verstärkte die Ausfälle weiter, indem unablässig APIs aufgerufen wurden, wie ein defizitärer Trottel, der bei einem Gewitter die Uhrzeit fragt. Das systematische Fehlen von Weitsicht bei Lasttests ebnete den Weg für ein eindrucksvolles Versagen.

Terraform spielte hier die Rolle, infizierte Infrastruktur bereitzustellen und zu skalieren, ohne ausreichende Validierung der Konfigurationsstabilität. In unserem Produktionswahn waren die Überprüfung von Ressourcenlimits und API-Schwellenwerten zugegebenermaßen keine Prioritäten. Terraform ermöglichte diese rücksichtslose Fahrt in die operationelle Hölle.

Explosionsradius & Telemetrie (Der Schaden)

Die tiefe Inkompetenz breitete sich wie ein Lauffeuer über unsere miteinander verbundenen Systeme aus. Unsere P99-Latenz zerschmetterte alle zuvor bestehenden Maßstäbe—eine exponentielle Steigerung jenseits der Toleranzgrenze. Der Explosionsradius erstreckte sich über unsere föderierten Dienste, was zu weitreichender Dienstverschlechterung führte, die Grundfesten unserer SLA-Verpflichtungen erschütterte und unseren Egress-Kosten-Eimer dank nicht autorisierter Eskalationsanrufe über Regionen hinweg bluten ließ.

CrowdStrike erwies sich größtenteils als effektiv in seiner vorgesehenen Rolle, aber IAM-Fehlkonfigurationen ließen die Tore weit offen, was eine Katastrophe in der Privilegieneskalation begünstigte. Grundsätzlich zerbröckelten unsere fähigen Sicherheitsstufen aufgrund einer Abhängigkeit von purer Ignoranz, die fehlerhafte IAM-Konfigurationen unentdeckt lassen konnte, was unsere rücksichtslose Exposition offenbarte.

Datadogs Telemetrie malte ein farbenfrohes Bild unserer Inkompetenz, wobei eBPF-Daten sinnloses Treiben enthüllten, bevor ein Feuer unter Speicher- und API-Ressourcen entfacht wurde. Doch trotz der nützlichen Einblicke war der Schaden bereits im Gange, wobei die Telemetrie die Persistenz sich anhäufender technischer Schulden in der Struktur unserer Architektur anzeigte.

“IAM-Privilegieneskalationsangriffe nutzen oft Fehlkonfigurationen in komplexen Richtlinien und unsachgemäß gesetzten Berechtigungen aus.” – AWS Security

Phase 1 (Audit) Wir beginnen mit einer umfassenden Codeprüfung. Suchen Sie nach Wettlaufbedingungen, Speicherfehlverwaltung und rekursiver Idiotie, die statische Analysen entgehen. Verwenden Sie statische und dynamische Codeanalyse-Tools, die Integration mit Datadogs Profiling-Fähigkeiten nutzen, um präzisere Diagnosen auf Funktionsebene zu erhalten.

Phase 2 (Durchsetzung) Erzwingen Sie aggressiv API-Limit-Politiken über alle Dienste. Terraform-Infrastruktur als Code erfordert strengere Validierungstests und kontinuierliche Bereitstellungs-Gleitschienen. Überarbeiten Sie RBAC-Politiken—überprüfen Sie Berechtigungen mit unerbittlicher Absicht, übermäßige Berechtigungen abzubauen. Mappen Sie IAM-Rollen korrekt, um alle möglichen Eskalationstaktiken zu mindern, wobei CrowdStrike unsere Sicherheitslage gegen unautorisierte Eskalationen verstärkt.

Phase 3 (Optimierung) Zerlegen Sie monolithische Dienste, die unbestimmte Ressourcen beanspruchen, in Microservices mit klar definierten Speicherbegrenzungen. Nutzen Sie Kubernetes, um containerisierte Workloads zu orchestrieren, gewährleisten Sie, dass Ressourceneinschränkungen konsequent durchgesetzt werden, und reduzieren Sie das Speicheraufblähen mit abrupter, aber notwendiger Rücksichtslosigkeit.

Phase 4 (Überwachungserweiterungen) Implementieren Sie kritische Alarme innerhalb von Datadog, um Anomalien proaktiv zu erkennen, lange bevor P99-Latenzerinnerungen auftauchen. Nutzen Sie Netzwerkflussprotokolle und Netzwerktopologie-Inferenzen mit angereicherter eBPF-Telemetrie.

Phase 5 (Kostenkontrolle) Prüfen Sie den Egress-Verkehr und ergreifen Sie Maßnahmen zur drastischen Reduzierung unberechtigter Datenausgänge. Richten Sie unsere Budgetprognosen aus und unternehmen Sie eine Architekturangleichung mit verbesserten Caching-Strategien, die exzessives Egress-Bluten effektiv zurückhalten.

“Technische Schulden entstehen überwiegend aus dem Versagen, Architektur- und Designprinzipien über den Systemlebenszyklus hinweg durchzusetzen.” – CNCF

| Integrationsaufwand | Cloud-Kosten | Latenzüberkopf |

|---|---|---|

| Niedrig | -5% monatlich | +15ms P99 Latenz |

| Mittel | +10% monatlich | +30ms P99 Latenz |

| Hoch | +25% monatlich | +45ms P99 Latenz |

| Sehr Hoch | +50% monatlich | +70ms P99 Latenz |

Beseitigen Sie alle Speicherlecks in der Vector-Datenbank-Architektur. Keine Ausreden; das sind keine kleinen Schluckaufs, sondern systemische Ausfallstellen, die die Betriebszeit beeinträchtigen und die Benutzererfahrung verschlechtern. P99-Latenzspitzen, die der VP abtut, werden nicht toleriert. Zielen Sie auf Zuweisungsfehler und Ineffizienzen der Müllabfuhr in der tiefen Systemanalyse.

[MANDAT PRÜFEN]

Führen Sie eine sofortige Prüfung der IAM-Konfigurationen durch. Schließen Sie Lücken, die Risiken für die Eskalation von Berechtigungen begünstigen. Implementieren Sie strenge Richtlinien für minimalen Zugriff über alle Konten hinweg. Katalogisieren Sie Zugangswege und widerrufen Sie übermäßige Berechtigungen. Von nun an wird eine kontinuierliche Überwachung jeglicher anomaler Aktivitäten vorgeschrieben.

[MANDAT STILLLEGEN]

Stilllegen Sie bestehende fehlerhafte Mechanismen der Datenübertragung innerhalb von 30 Tagen. Finanzielle Ausblutungen bei Egress-Kosten sind inakzeptabel und unhaltbar. Wechseln Sie zu effizienteren Datenmanagement-Strategien mit Schwerpunkt auf Kompression und Optimierung der Übertragung, um aufgeblähte AWS-Rechnungen abzumildern.

Weitere Direktiven

– Eklatante Fehler im Verständnis von Kosten als Feature sind auf mehreren Ebenen offensichtlich. Sofortige Behebung erforderlich.

– Implementieren Sie automatisierte OOM-Kill-Alerts, um Incident-Responses auszulösen, bevor Benutzer die Hauptlast dieser Versäumnisse ertragen müssen.

– Wöchentliche Berichterstattung über Fortschritte, Probleme und Lösungen in diesen Bereichen ist zwingend. Bei Nichteinhaltung erfolgt eine Zuweisung an eine andere Aufgabe oder andere Disziplinarmaßnahmen ohne weitere Ankündigung.”