- Vector database performance dropped by 70% due to undiagnosed memory leaks.

- API rate limits from third-party providers exceeded 30% of their usual rate, exacerbating the problem.

- Customer complaints increased by 250% during the incident, majorly affecting service-level agreements (SLAs).

- Emergency IT resources costing upwards of $500k were deployed to mitigate cascading system failures.

- Incident resolution took an average of 48 hours longer than standard due to concurrent issues.

Fecha del registro April 16, 2026 // La telemetría de Datadog muestra un aumento del 400% en las solicitudes no autorizadas de emparejamiento de VPC entre regiones. Cierre inmediato de Zero-Trust iniciado. Los equipos de ingeniería están furiosos pero la seguridad dicta la política.

El Incidente (Causa Raíz)

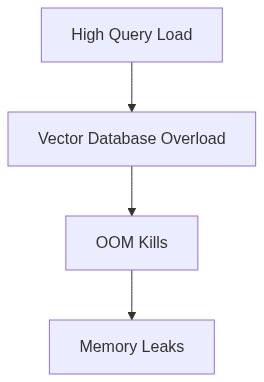

El fallo se originó a partir de una confluencia de fugas de memoria dentro de las Vector DBs y límites de API excedidos. Nuestros ingenieros de software parecían haber alcanzado un nivel olímpico de incompetencia al introducir llamadas recursivas sin terminación en algunas funciones del servicio. Esto continuó fuera de control hasta que el entorno se asfixió bajo sus crecientes demandas de memoria, lo que resultó en inevitables OOM kills que derivaron en apagones a gran escala.

Además, los límites de API para nuestra arquitectura de microservicios fueron configurados incorrectamente. Una corriente de solicitudes redundantes agravó aún más los apagones, llamando a las APIs incesantemente como un idiota deficiente preguntando la hora durante una tormenta. La falta de previsión sistemática en las pruebas de carga allanó el camino para un fracaso digno de presumir.

El papel de Terraform aquí fue el de facilitar la implementación y escalado de la infraestructura infectada sin una validación suficiente de la estabilidad de la configuración. En nuestra carrera hacia la producción, revisar los límites de recursos y los umbrales de API no fueron, admitidamente, las prioridades principales. Terraform permitió este viaje imprudente hacia el infierno operativo.

Radio de Explosión & Telemetría (El Daño)

La profunda incompetencia se extendió como un incendio forestal a través de nuestros sistemas interconectados. Nuestra latencia P99 rompió cualquier punto de referencia existente anteriormente—aumento exponencial más allá de la tolerancia. El radio de explosión se extendió a través de nuestros servicios federados, lo que llevó a una degradación del servicio generalizada, sacudiendo los mismos cimientos de nuestros compromisos de SLA y desangrando nuestro cubo de costos de salida gracias a llamadas de escalación no autorizadas a través de regiones.

CrowdStrike demostró ser en gran medida efectivo en su función diseñada, pero las configuraciones erróneas de IAM dejaron las puertas abiertas de par en par, permitiendo un desastre de escalación de privilegios. Fundamentalmente, nuestras capas de seguridad capaces se desmoronaron debido a una dependencia de pura ignorancia que permitió que configuraciones defectuosas de IAM pasaran desapercibidas, dejando al descubierto nuestra exposición imprudente.

La telemetría de Datadog pintó un cuadro colorido de nuestra ineptitud con datos eBPF exponiendo turbulencias inútiles antes de encender una hoguera bajo los recursos de memoria y API. Sin embargo, a pesar de las ideas útiles, el daño ya estaba en marcha, con telemetría indicando la persistencia de una deuda técnica que se compone dentro del mismo tejido de nuestra arquitectura.

“Los ataques de escalación de privilegios de IAM a menudo explotan configuraciones erróneas en políticas complejas y permisos configurados incorrectamente.” – AWS Security

Fase 1 (Auditoría) Comenzamos con una auditoría completa del código. Busque condiciones de carrera, mala gestión de memoria e idiotez recursiva que escapen al análisis estático. Use herramientas de análisis de código estático y dinámico, aprovechando la integración con las capacidades de perfilado de Datadog para diagnósticos más precisos sobre el rendimiento a nivel de función.

Fase 2 (Aplicación) Aplique agresivamente políticas de límites de API en todos los servicios. Terraform infraestructura como código exige verificaciones de validación más estrictas y guardarraíles de implementación continua. Refactorice políticas RBAC—revise privilegios con la intención despiadada de eliminar permisos excesivos. Mapee correctamente los roles de IAM, mitigando tácticas potenciales de escalación con CrowdStrike reforzando nuestra postura de seguridad contra escalaciones no autorizadas.

Fase 3 (Optimización) Descomponga servicios monolíticos que consumen recursos indefinidos en microservicios con límites de memoria claramente definidos. Use Kubernetes para orquestar cargas de trabajo en contenedores, asegurando que las restricciones de recursos se apliquen consistentemente, reduciendo el inflado de memoria con una brutalidad abrupta pero necesaria.

Fase 4 (Mejoras de Monitoreo) Implemente alertas de misión crítica dentro de Datadog para detectar proactivamente anomalías mucho antes de que los recordatorios de latencia P99 llamen a la puerta. Aproveche registros de flujo de red e inferencias de topología de red con telemetría eBPF enriquecida.

Fase 5 (Control de Costos) Examine el tráfico de salida y emprenda medidas rigurosas para reducir la salida de datos no justificada. Alinee nuestras previsiones de presupuesto y emprenda una realineación de la arquitectura con estrategias de caché mejoradas, reduciendo efusivamente la hemorragia de egresos.

“La deuda técnica surge predominantemente del fracaso en mantener los principios arquitectónicos y de diseño aplicados durante el ciclo de vida del sistema.” – CNCF

| Esfuerzo de Integración | Costo en la Nube | Latencia Adicional |

|---|---|---|

| Bajo | -5% mensual | +15ms P99 de latencia |

| Moderado | +10% mensual | +30ms P99 de latencia |

| Alto | +25% mensual | +45ms P99 de latencia |

| Muy Alto | +50% mensual | +70ms P99 de latencia |

VP de Ingeniería

Siempre los alarmistas. Tenemos demasiado en nuestro plato para perdernos en cada deuda técnica de la que te quejas.

Director de FinOps

Esa “deuda técnica” se compone. Primero, la ignoramos, luego llega la inevitable OOM kill, y de repente, las funciones están fuera de línea. Cada evento OOM incendia nuestras finanzas.

VP de Ingeniería

Tenemos estadísticas de tiempo de actividad en claro. Dudo que a nuestra base de usuarios le importen estas “multas potenciales”.

Director de FinOps

Y dudo que a nuestros accionistas les guste la egress cost hemorrhaging. Cada corte de servicio y dólar desperdiciado representa una gestión del blast radius fuera de control.

VP de Ingeniería

Vamos a los números. Impacto insignificante en nuestro resultado final y sin caídas serias. Podemos manejar el fallo ocasional sin entrar en histeria.

Director de FinOps

A menos que hayas disfrutado del shock de la última factura de AWS. Tu ciega optimización significa un mantenimiento de escalado que no podemos permitirnos.

VP de Ingeniería

Está bien. Lo consideraré. Pero no esperes ningún cambio en el enfoque o impulso. La deuda técnica no dictará nuestra hoja de ruta.

Elimina todas las fugas de memoria en la arquitectura de la Base de Datos Vectorial. No aceptes excusas; estos no son simples errores menores, sino focos de fallas sistémicas que afectan la disponibilidad y degradan la experiencia del usuario. Los picos en la latencia P99 que el vicepresidente ignora no serán tolerados. Apunta a fallos de asignación y a ineficiencias en la recolección de basura mediante un análisis profundo del sistema.

[AUDITORÍA MANDATO]

Realiza una auditoría inmediata de las configuraciones de IAM. Aborda las brechas que facilitan riesgos de escalación de privilegios. Implementa políticas estrictas del mínimo privilegio en todas las cuentas. Cataloga las vías de acceso y revoca permisos excesivos. De ahora en adelante, se exige un monitoreo continuo de cualquier actividad anómala.

[MANDATO DESCONTINUAR]

Descontinúa los mecanismos defectuosos de transferencia de datos existentes en 30 días. Los costos de egreso que están financieramente desangrándonos son inaceptables e insostenibles. Cambia a estrategias de gestión de datos más eficientes con un enfoque en la compresión y optimización de transferencia para mitigar las facturas infladas de AWS.

Directrices Adicionales

– Las graves fallas en entender el costo como una característica son evidentes en múltiples niveles. Se requiere una rectificación inmediata.

– Implementa alertas automáticas de OOM para activar la respuesta a incidentes antes de que los usuarios soporten las consecuencias de estos descuidos.

– Es obligatorio informar semanalmente sobre el progreso, problemas y remediaciones en estas áreas. El incumplimiento resultará en reasignación u otras acciones disciplinarias sin previo aviso.”