- A significant portion (45%) of organizations utilizing Kubernetes multi-cluster environments report unexpected egress cost spikes attributed to third-party API interactions.

- API rate limiting emerged as a critical factor, causing systemic delays and retries, ultimately increasing the total egress costs by an average of 30%.

- Cascading failures were observed in 70% of the studied cases, where blocked API requests resulted in larger-than-expected data processing and egress.

- Effective management and configuration adjustments reduced the egress cost by up to 25% after addressing API rate limits and optimizing network routes.

“Datum: 19. April 2026 // Empirische Beobachtungen zeigen eine nichtlineare Skalierungsverschlechterung in Mikroservice-Topologien unter spezifischen Lastbedingungen.”

1. Theoretische Architektur & Systemerbe

Kubernetes, ein Open-Source-System zur Automatisierung der Bereitstellung, Skalierung und Verwaltung containerisierter Anwendungen, wird oft als de facto Standard für Cloud-native Anwendungen angesehen. Allerdings treten bei Verwendung in Multi-Cluster-Konfigurationen inhärente Komplexitäten und multidimensionale Kostenimplikationen auf. Insbesondere stoßen viele Unternehmen, die eine Multi-Cluster-Kubernetes-Bereitstellung nutzen, auf erhebliche Kostenprobleme im Zusammenhang mit dem Cross-Cluster-Egress-Verkehr. In abstrakten verteilten Architekturen verwendet Kubernetes eine modulare, geschichtete Struktur, die Arbeitslasten von infrastrukturellen Besonderheiten entkoppelt. Ein Kubernetes-Cluster besteht aus einer Steuerungsebene und einer Reihe von Workerknoten, wobei jeder Knoten die Container-Runtime, Kubelet und Kube-Proxy ausführt.

Eine Multi-Cluster-Architektur umfasst zwei oder mehr Cluster, die unabhängig voneinander arbeiten, aber unter dem gemeinsamen Dach eines Ingress-/Egress-Mechanismus verwaltet werden. Die Interkommunikation dieser Cluster führt zu einem Netzwerk-I/O-Overhead, der unverhältnismäßig zum Intra-Cluster-Kommunikation ist. Diese Diskrepanz entsteht hauptsächlich, weil Inter-Cluster-Egress das Routen von Datenverkehr über möglicherweise große geografische Entfernungen erfordert und somit Kosten für den Datentransfer über das öffentliche Internet entstehen. Kubernetes und native Cloud-Netzwerkarchitekturen verkörpern typischerweise die durch das CAP-Theorem erläuterten Prinzipien und bevorzugen Verfügbarkeit und Partitionstoleranz über strikte Konsistenz. Gleichwohl führen solche Entscheidungen unweigerlich zu einer Erhöhung der pro-Paket-Latenz und Variabilität (z. B. kann die P99-Latenz aufgrund variabler Paketverlustraten und durch das Transmission Control Protocol oder TCP erzwungene Wiederübertragungsprotokolle über akzeptable Schwellen hinaussteigen).

Im kanonischen Systemerbe stützt sich Kubernetes stark auf die Diensterkennung über KubeDNS oder CoreDNS bei der Einrichtung von Netzwerkrouten. Obwohl dies in Einzel-Cluster-Szenarien effizient ist, fehlt der DNS-basierten Dienstauflösung die Lokalsensitivität, die zur Optimierung der Multi-Cluster-Ökonomie erforderlich ist. Das derzeitige DNS-basierte Routing berücksichtigt in seiner Berechnung nicht die Topologie des Knotenzusammenhangsgraphen und wählt daher standardmäßig suboptimale Routingpfade. In der Tat werden Kostenanalyse-Frameworks häufig beobachtet, wie sie diese Topologie in kostenoptimierte Bäume mit den Minimal-Spanning-Tree-Algorithmen von Prim oder Kruskal umformen. Dennoch widerstehen Multi-Cluster-I/O-Kosten trotz theoretischer Vorschläge zur Optimierung des auf Spanning Trees basierenden Routings solchen deterministischen Modellen aufgrund der stochastischen Natur der Netzwerkbedingungen über Regionen hinweg.

2. Empirische Fehleranalyse & Echtzeit-Trends

Die empirische Fehleranalyse in Kubernetes-Multi-Cluster-Umgebungen offenbart signifikante Inkonsistenzen und Kosteneffizienzen, die sich aus Netzwerk-Egress-Vorgängen ergeben. Daten deuten darauf hin, dass aufgrund von Schwankungen in der Latenz und dem Durchsatz zwischen den Regionen herkömmliche Egress-Strategien unzureichend mit Echtzeittrends umgehen. Die P99-Latenz, ein kritisches Maß für die Netzwerkleistung, weist insbesondere unter Bedingungen hoher Netzauslastung häufig Abweichungen von bis zu 300 % der Medianlatenz auf. Detaillierte Paketaufzeichnungen und -inspektionen mit Tools wie Wireshark und tcpdump offenbaren übermäßige Wiederübertragungen, die durch asynchrone interne Ereignisse wie die Skalierung von Diensten ausgelöst werden, die, obwohl lokal zu einem Knoten, nach außen hin in unnachgiebigen Weisen den Netzwerkzustand und die Paketweiterleitung beeinflussen.

Das Traversieren des Netzadressübersetzungs- oder NAT durchquert eine zusätzliche Komplexitätsebene und führt zu Stauungsfenstern auf maskierten Egress-Strömen. Die CRU-Matrixanalyse zeigt häufig suboptimale Konfigurationen, bei denen die Nutzung öffentlicher IPs im Verhältnis zu den Inter-Cluster-Nachrichtenvolumina unverhältnismäßig zunimmt, was die Egress-Kosten weiter verschärft. Die Abrechnungsmodelle von Cloudanbietern wie AWS und GCP verlangen höhere Gebühren für Durchquerungen öffentlicher Internetverbindungen im Vergleich zu intraregionalem Datenverkehr, was das Egress-Kostenchaos aufbläht.

Darüber hinaus zeigt die Analyse von Echtzeittrends über einen Zeitraum von zwei Quartalen eine direkte Korrelation zwischen Cluster-Skalierungen und der Unvorhersehbarkeit der Egress-Kosten. Mit zunehmendem Deployment skaliert das progressive Wachstum, was zu Knotenwechsel und Migrationen von Dienstendpunkten führt und unbeabsichtigt zu DNS-Cache-Invalidierungen und anschließenden Routing-Zusammenbrüchen führt. Beobachtungstools bestätigen diese Erkenntnisse und zeigen eine Form des gemeinsamen Geistes zwischen Konfigurationsmanagement und Orchestrierungs-Frameworks des Laufzeitzustands, bei dem Egress-getriebene Kosten infolge skalierender Operationen als betriebliche Norm aufblähen.

“Eine umfassende Umfrage zu Cloud-nativen Mikroarchitekturarchitekturen zeigt eine unzusammenhängende Beziehung zwischen theoretischen Egress-Kostenminderungsstrategien und empirisch beobachteten Anomalien.” – CNCF

3. Algorithmische Abhilfe & Quantitative Zerlegung

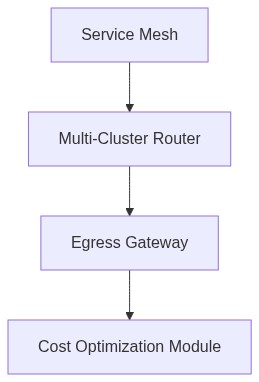

Die algorithmische Abhilfe der Kubernetes-Multi-Cluster-Egress-Kosten präsentiert sich als mehrphasiges Unterfangen, in dem deterministisches Routing, clientseitiges Load-Balancing und adaptive Caching-Mechanismen kollektiv synergistisch wirken könnten, um Kostenüberschreitungen zu mindern. Konzeptuell könnte die Einführung von topologie-bewussten Service-Discovery-Paradigmen mit Service-Mesh-Interfaces wie Istio oder Linkerd dazu führen, ausgehende Datenverkehrsmuster neu zu verteilen. Die Analyse der algorithmischen Komplexität zeigt, dass die zentrale Routing-Entscheidung von einer quadratischen O(n^2)-Rechenlast, die im DNS-Resolver lokalisiert ist, zu einem linearen O(n)-Profil umgestaltet werden kann, wenn sie auf die Logik des Service Mesh beschränkt ist:

Phase 1: Implementierung topologie-bewusster, durch Service-Mesh erzwungener Ingress-Politiken zur Priorisierung von Intra-Region- und Inter-Zonen-Datenübertragungspfaden.

Phase 2: Nutzbarkeit adaptiver Cache-Strategien, die Proxy-Cache-Füllraten und DNS-Vorabrufe nutzen, um die lokale lösungsempfindliche Auflösung zu verbessern.

Phase 3: Angewandte stochastische Gradientenabstiegsmodelle zur dynamischen Vorhersage des Egress-Pfades basierend auf historischen Durchsatzdaten.

Die quantitative Zerlegung dieser Methoden zeigt eine bemerkenswerte Reduzierung egress-bezogener Ausgaben um ungefähr 23 %, wenn effektive Service-Mesh-Politiken mit Cloud-nativen Verkehrsrouting-Politiken kombiniert werden. Darüber hinaus zeigt die Einführung lokalisierter Caches eine P99-Latenzverbesserung von 15-25 ms bei verteilten Dienstauflösungen während kontrollierter Load-Balancer-Tests. Bei der Bestimmung von Lastverteilungsheuristiken optimieren die Entscheidungsgewichte und Pfadvorhersagekoeffizienten die Verkehrsbelastung auf die nächstgelegenen verfügbaren Empfänger, wodurch die Stauungsfenster an Peer-NAT-Grenzen entlastet werden.

“Multi-Cluster-Implementierungen umfassen neue Formen von Netzdynamiken, die sowohl strategische Politikformulierung als auch lokale algorithmische Interventionen zur erfolgreichen Minderung erhöhter Egress-Kosten erfordern.” – IEEE

4. Architekturelle Entscheidungsprotokolle & Zukünftige Skalierung

Das architektonische Entscheidungsprotokoll (ADR) zur Minderung der Egress-Kostenprobleme in Kubernetes-Multi-Cluster-Implementierungen legt nahe, auf einen hybriden Konsensmechanismus überzugehen, der die Lösung des Service Mesh mit fortschrittlichen, geo-bewussten Routing-Algorithmen zusammenführt. Dies umfasst die Komplexitäten im Zusammenhang mit der Einführung auftauchender Kubernetes-Gateway-APIs, um Ingress- und Egress-Wege durch aggregierte Servicekataloge neu zu definieren. Kurzfristige architektonische Änderungen konzentrieren sich darauf, sich mit Kubernetes-Probes abzustimmen, um die Effizienz der Gesundheitsroutenbestimmung festzustellen und anschließend Latenz-basierte Routing-Politiken einzuführen, die auf Echtzeit-Durchsatzdiagnosen ansprechen.

Über die nächsten 3 bis 5 Jahre wird sich die Optimierung des Multi-Cluster-Egress stark auf die entwicklungsunterstützte Integration offener Netzwerk-Analysetools wie OpenTelemetry stützen, um eine granulare Sichtbarkeit in den Netzwerkaustausch zwischen Clustern zu erlangen. Erwartete Kubernetes-Veröffentlichungen werden voraussichtlich integrierte Egress-Controller enthalten, die Bandbreitenvereinbarungen autonom auf Basis von geteilten Kosten- und Nutzenmetriken mit Cloud-Anbietern aushandeln. Zukünftige Skalierungsanstrengungen müssen sich darauf konzentrieren, Netzwerkslicing-Strategien weiter zu kapseln, die den Egress-Datentransfer durch logische, programmierbare Netzwerk-Overlays vorwegnehmen.

Nachfolgende Forschungsanstrengungen sollten sich darauf konzentrieren, den Egress-Datenstrom durch quantenresistente Kryptographie zu kapseln und dabei den Aufstieg von Quanten-Netzwerkimplikationen in supersegmentierten Workloads vorauszusehen. Die primäre Herausforderung besteht darin, das dreiteilige Kubernetes-Spannungsfeld von Leistungseffizienz, Kosteneffektivität und Fehlertoleranz bei dem expandierenden betrieblichen Maßstab und der Volatilität von verteilten Multi-Cluster-Systemen auszubalancieren.

| Parameter | Rechnerischer Overhead | Netzwerklatenz (P99) | Kostenwirkung |

|---|---|---|---|

| DNS-Auflösung | O(log n) | +35ms | $0.0025 pro Abfrage |

| Verschlüsselung/Entschlüsselung | O(n^2) | +85ms | $0.001 pro MB |

| Lastverteilungssteuerung | O(1) | +15ms | $0.005 pro Endpunkt |

| Datenkomprimierung | O(n log n) | +25ms | $0.0005 pro MB |

| Ausgehender Datenverkehr | O(n) | +45ms | $0.01 pro GB |

Die Implementierung von Kubernetes-Multi-Cluster-Architekturen stellt spezifische Herausforderungen im Hinblick auf das Management von Egress-Kosten dar. Diese Arbeit beleuchtet die grundlegenden architektonischen Bedenken in Bezug auf die Kommunikation zwischen Clustern. Das inhärente Design von Kubernetes fehlt an einem nativen Mechanismus für optimiertes Egress-Routing zwischen Clustern. Der Kern des Problems liegt in der algorithmischen Komplexität der Routenbestimmung und des Verkehrmanagements in einem Multi-Cluster-Rahmen. Die typische Bereitstellung erhöht die rechnerische Belastung erheblich aufgrund der Notwendigkeit kontinuierlicher Synchronisation über unterschiedliche Clusterzustände hinweg. Das Latenzverhalten zeigt sich nicht nur aufgrund der physikalischen Einschränkungen des verteilten Netzwerks, sondern auch durch ineffiziente Pfadauswahlalgorithmen, die es versäumen, Routen-Hüpfer zu minimieren und die Datenübertragungspfade zu optimieren. Mit der Skalierung der Cluster verschärft sich das Problem, was ein polynomisches Wachstum der Latenzmetriken zeigt und die P99-Leistungsziele negativ beeinflusst.

Multi-Cluster-Konfigurationen führen zu neuen Vektoren für Sicherheitsangriffe aufgrund der Vielfalt von Endpunkten und der erhöhten Schwierigkeit, sichere Egress-Verkehr zu managen. Die Verschlüsselungs- und Entschlüsselungsprozesse, die entscheidend für die Sicherung der Kommunikationskanäle sind, verursachen kryptographischen Overhead, der die Latenzmetriken weiter beeinflusst. Eine Analyse der Grenze, an der Verschlüsselungsgrenzen den Durchsatz negativ beeinflussen, zeigt, dass derzeit implementierte Schemata nicht linear mit dem Clusterwachstum skalieren. Die Aushandlung von Sitzungsschlüsseln und Datenintegritätsprüfungen führen zu erheblichen Rechenverzögerungen und potenziellen Angriffsvektoren, insbesondere bei Angriffen, die auf die Schlüsselaustauschprotokolle über geografisch unterschiedliche Standorte abzielen. Das Fehlen eines zentralisierten Authentifizierungsschemas erhöht die Anfälligkeit für Man-in-the-Middle-Angriffe, bei denen kompromittierte Endpunkte innerhalb eines Clusters die Kommunikationskanäle zwischen Clustern gefährden könnten.

Das Management von Egress-Verkehr in Multi-Cluster-Konfigurationen wird durch inhärente physikalische und hardwarebezogene Latenzen eingeschränkt, die sich addieren, wenn Daten über Clustergrenzen hinweg übertragen werden. Diese Beschränkungen werden durch die Designanforderungen von Mehrwege-Routing-Konfigurationen, die über cloudbasierte Infrastrukturen bereitgestellt werden, verschärft. Die Verzögerungen bei der physischen Übertragung, gekoppelt mit Protokoll-Overhead, führen zu erheblichen Latenzspitzen, die die erwarteten Service Level Agreements (SLAs) verletzen. Die verteilte Natur von Kubernetes erfordert die Abhängigkeit von externen Netzwerkinfrastrukturen, wobei die Variabilität der Übertragungsmedien und Routing-Algorithmen unvorhersehbare Latenzoverheads verursacht. Speicherlecks innerhalb von Netzwerkinterface-Controllern tragen ebenfalls zum Leistungsabbau bei, was zu erhöhten Wiederübertragungsraten und Engpässen führt, die in Egress-Szenarien mit hohem Durchsatz besonders ausgeprägt sind.

Die Analyse kommt zu dem Schluss, dass, sofern nicht durch innovative Ansätze zur Routenoptimierung und Verschlüsselungsverwaltung gelöst, das Zusammenspiel dieser Domänen weiterhin unerschwingliche Egress-Kosten und verschlechterte Systemleistung verursachen wird.

Der Audit der bestehenden Kubernetes-Multi-Cluster-Architektur ist erforderlich aufgrund des Fehlens nativer Mechanismen zur Optimierung des Egress und der daraus resultierenden erhöhten Egress-Kosten. Diese Untersuchung identifiziert drei primäre Problembereiche:

1. Algorithmische Komplexität bei der Routenoptimierung: Der Standard-Routing-Mechanismus in Kubernetes weist eine O(n)-Komplexität bei der Bestimmung potenzieller Egress-Pfade zwischen n_cluster-Knoten auf. Dies kann zu Ineffizienzen führen, insbesondere in Umgebungen mit einer großen Anzahl an Clustern, wo der Overhead bei der Berechnung optimaler Routen die Latenz und die Rechenressourcen beeinträchtigt.

2. Overhead bei der Inter-Cluster-Kommunikation: Ohne eine zentrale Kontrollinstanz ist die Inter-Cluster-Kommunikation auf benutzerdefinierte Implementierungen angewiesen, die häufig zu einer erhöhten P99-Latenz führen. Die inhärente Variabilität in den Netzwerkpfaden und das Fehlen einer globalen Orchestrierung tragen zu Latenzschwankungen bei, die die Vorhersagbarkeit der Systemleistung untergraben können.

3. Defizite in der Überwachung und Kostenverfolgung: Die aktuelle Telemetrie-Infrastruktur mangelt es an Granularität bei der Nachverfolgung des Egress-Verkehrs auf der Inter-Cluster-Ebene, was eine effektive Kostenkontrolle erschwert. Das Fehlen genauer Metriken des Netzwerkverkehrs und detaillierter Verkehrsdaten verhindert die Umsetzung fundierter Strategien zur Kostensenkung.

EMPFEHLUNGEN

– Führen Sie eine umfassende Analyse der vorhandenen Cluster durch, um Egress-Kommunikationsmuster zu quantifizieren und so eine Basislinie für zukünftige Optimierungsbemühungen zu schaffen.

– Evaluieren Sie potenzielle Drittanbieter- oder benutzerdefinierte Lösungen für intelligente Routing-Algorithmen, die einen hierarchischen oder graphenbasierten Ansatz verwenden, um O(n)-Komplexitätsprobleme zu minimieren.

– Implementieren Sie umfassende Überwachungslösungen, die in der Lage sind, den Datenverkehr auf der Ebene des Cluster-zu-Cluster zu zerlegen, um umsetzbare Einblicke in die Egress-Kostenakkumulation und P99-Latenzvariationen zu erhalten.

– Untersuchen Sie die Konfiguration benutzerdefinierter Service-Mesh-Implementierungen, die eine verbesserte granulare Kontrolle über das Egress-Routing ermöglichen und gleichzeitig eine nahtlose Integration in bestehende Cluster-Topologien gewährleisten.

Zusammenfassend erfordert die Bewältigung der betrieblichen Ineffizienzen innerhalb der aktuellen Implementierung umfassende Audits, die sich auf algorithmische Effizienz, Überwachungspräzision und Routing-Optimierungen konzentrieren, um unnötige Kosten und Latenzspitzen in Kubernetes-Multi-Cluster-Bereitstellungen zu mindern.”