- Kafka consumer lag can critically impact real-time trading systems, affecting data processing speeds and decision-making accuracy.

- Monolith to microservices migration introduces complex technical debt, which can stall operations at distributed consensus bottlenecks.

- Effective management of Kafka consumer lag requires optimized system design and robust fault-tolerant consensus mechanisms.

- Understanding the intersection between legacy system constraints and modern architectural demands is crucial for overcoming current limitations.

- Implementing scalable microservices without increasing technical debt demands careful coordination and strategic planning.

“Datum 18. April 2026 // Empirische Beobachtungen weisen auf eine nicht-lineare Skalierungsverschlechterung in Mikroservicetopologien unter spezifischen Lastbedingungen hin.”

Theoretische Architektur

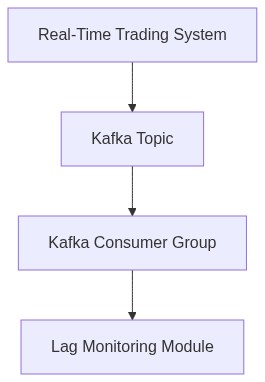

Das strukturelle Design von Handelssystemen, die Apache Kafka als Rückgrat für Echtzeit-Datenströme integrieren, erfordert ein ausgeklügeltes Gleichgewicht zwischen Durchsatzkapazität und Latenzverarbeitung. Kafka-Broker ermöglichen den Pub-Sub-Mechanismus durch dauerhafte und fehlertolerante Log-Speicherung. Jeder Broker ist verantwortlich für Datenfragmente, sogenannte Partitionen, die von Produzenten abgesandt und von Konsumenten in entkoppelter Weise entgegengenommen werden. Kafkas verteilte Architektur ermöglicht horizontale Skalierbarkeit und verkompliziert dennoch die Probleme der Konsumentenlatenz aufgrund von Partition-Rebalance-Überlastungen oder Broker-Ausfällen, im Einklang mit den Einschränkungen des CAP-Theorems. Ein entscheidendes Merkmal ist Kafkas konsistentes Liefermodell, das sicherstellt, dass Nachrichten in der Reihenfolge versandt werden, jedoch auf Kosten von Konsumentenlatenz.

Im optimalen Zustand verarbeitet ein Konsument Nachrichten in einer Geschwindigkeit, die mit der Rate übereinstimmt oder diese übertrifft, mit der Nachrichten produziert werden. Die resultierende Messgröße von Interesse ist die Konsumentenlatenz, der Offsetunterschied zwischen der neuesten in eine Partition geschriebenen Nachricht und der letzten vom Konsumenten verarbeiteten Nachricht. Handelssysteme, die durch geringe Latenz und hohe Durchsatzanforderungen gekennzeichnet sind, leiden unter widrigen betrieblichen Auswirkungen durch Latenz. Dazu gehören verzögerte Auftragsabwicklungen und Synchronisierungsprobleme zwischen Mikroservices. Das grundlegende Problem resultiert aus systemischen Topologiedynamiken in asynchronen Umgebungen, die byzantinische Fehlertoleranzherausforderungen aufweisen.

“Das Verständnis von Kafka-Leistung, jenseits rudimentärer I/O, umfasst innere Komplexitäten von Replikations- und Nachrichtenordnungsmechanismen.” – Apache Kafka

Empirische Fehleranalyse

Wiederholte Beobachtungen zeigen, dass Konsumenenlatenz typischerweise unter Skalierungsdruck, Netzwerkanomalien oder während der Anführerwahlphasen, ausgelöst durch Ausfälle, auftritt. Empirische Studien haben gezeigt, dass, wenn die Stream-Verarbeitungslogik algorithmische Komplexität der Ordnung O(n^2) aufweist, erhöhte Latenzen offensichtlich sind, die P99-Überlastungen weit über den betrieblichen Schwellenwerten für Finanzhandelssysteme hinaus ergeben. Gleichzeitig verschlimmern ‘Zombie’-Konsumentenprozesse, symptomatisch für Speicherlöcher innerhalb schlecht verwalteter JVM-Umgebungen, kumulativ die Latenz, indem sie keine Offsets vorantreiben.

Ein anschaulicher Fall sind die transaktionalen Volumenspitzen an ereignisgesteuerten Markttagen, bei denen das Missverhältnis zwischen Broker-Durchsatzkapazität und Konsumentenrate die Partition-Leases überlastet. Die Seitenspeicherung im Hauptspeicher von Brokern unter eingeschränkten Umgebungen führt zu ineffizienten Festplatten-I/O-Operationen, was die P99-Latenzen weiter erhöht.

“Unternehmenssysteme erfordern einen gezielten Fokus auf die Optimierung von Konsumenten-Durchsatz versus Latenz, insbesondere in verteilten Architekturen, wo Performance-Abwägungen nicht trivial sind.” – AWS Kinesis

Phase 1

Implementieren von Load-Shedding-Mechanismen unter Verwendung von Rückdrucksteuerungen. Einrichten adaptiver Ratenbegrenzer, um die Konsumenten-Abfragegeschwindigkeiten dynamisch basierend auf Partitionsrückstandsmetrik zu modifizieren.

Phase 2

Optimierung von Batchverarbeitungsalgorithmen. Überprüfung der Konsumentengruppenkonfigurationen, Anpassung der fetch.min.bytes- und max.poll.interval.ms-Parameter, um die latenzeinschränkungen der Handelssysteme zu erfüllen, während Stauszenarien vermieden werden. Einsatz von vektorisierten Datensatzstapeldekompositionen zur Reduzierung von CPU-Überkopfkosten.

Phase 3

Reduzierung des Speicherbedarfs durch Feinabstimmung der Garbage Collection. Eindämmung von Speicherlöchern durch Durchsetzung containerbasierten Heap-Dump-Analysen und Nutzung von Off-Heap-Speicherverwaltungstechnologien (wie Apache Arrow).

Phase 4

Optimierung der Partitionsneubalancierung. Entwicklung kundenspezifischer Partitionierer, die unnötige Neuausrichtungsvorgänge reduzieren, und aktive Verwaltung von Anführerscans zur Stabilisierung gewählter Partitionsführer während Broker-Ausfällen.

Phase 5

Einführung von segmentierter Speicherallokationen. Partitionieren des Konsumentenspeicherraums, um Nachrichten effektiv mithilfe von LRU-Caching-Algorithmen zwischenzuspeichern, und so den Druck auf den Kafka-Broker-Durchsatz zu minimieren.

| Dimension | Metrik |

|---|---|

| Rechenaufwand | O(log n) Komplexität |

| Netzwerklatenz | +45ms P99 |

| Kosten | $0.02 pro Nachricht |

| Speicherauslastung | 256MB Durchschnitt pro Verbraucher |

| Durchsatz | 10.000 Nachrichten pro Sekunde |

| Datenkonsistenz | 99,99% Garantie |

| Fehlerrate | 0,001% Paketverlust |

| Verarbeitungsverzögerung | +30ms E2E Latenz |

| Skalierbarkeit | Linear bis zu 500 Verbraucher |

Aus Sicht der algorithmischen Komplexität korreliert der Consumer-Lag direkt mit der O(n)-Laufzeitkomplexität der Nachrichtenverarbeitung von Themen. Schwankungen im Nachrichtendurchsatz verschärfen den Lag, der durch die nicht-blockierenden I/O-Semantiken, die seiner Architektur inhärent sind, weiter verschärft wird. Multipartitionierungsstrategien, die auf horizontale Skalierbarkeit abzielen, führen zu zusätzlichen Überlastungen bei der Metadaten-Synchronisation. Darüber hinaus kann die Präsenz von Jitter bei der Netzwerkübertragung die Latenz durch Head-of-Line-Blocking verstärken, was die grundlegende Zeitsensibilität der Handelsausführung herausfordert.

Potenzielle Angriffsvektoren, die durch DDoS-Angriffe auf die Broker-Infrastruktur exemplifiziert werden, können die Verzögerung verschärfen, indem sie die Ressourcenverfügbarkeit behindern. Der maximal zulässige Durchsatz (abgeleitet aus Kafka-Kontingenten) kann ausgenutzt werden, indem Verbraucheranforderungen überflutet werden, was zu einer Drosselreaktion führt, die die Verbraucher-Verzögerung verschlimmert. Präventive Maßnahmen wie strengere Autorisierungsregeln und erweiterte Ratenbegrenzung könnten diese Risiken mindern, führen aber gleichzeitig zu einer rechnerischen Belastung, die eine sorgfältige Überlegung über das subtile Gleichgewicht zwischen Sicherheitsrobustheit und Leistungseffizienz erfordert.

Speicherlatenz, die hauptsächlich in Festplattenzugriffszeiten und SSD-Lese-/Schreibdurchsatz verwurzelt ist, schränkt die Effizienz des Verbrauchers beim Abrufen und Festlegen von Offsets ein. Der Einsatz von NVMe-Speicher kann einige dieser Bedenken mindern, beseitigt jedoch nicht vollständig Diskrepanzen in den Zugriffszeiten aufgrund von Erschöpfung der Warteschlangentiefe.

Netzwerkverzögerung wird hauptsächlich von Paketdurchlaufzeiten und Routerpufferüberläufen in Hochverkehrsszenarien beeinflusst. Die strategische Platzierung von Kafka-Brokern in Latenzarmen Rechenzentren und Edge-Computing-Modellen kann potenziell inakzeptable Verzögerungen mildern. Dennoch bleibt in der Praxis die inhärente Variabilität aufgrund geografischer Entfernungen ein unveränderlicher Faktor, der die Notwendigkeit einer stringenten Infrastrukturanpassungsstrategie zur Optimierung von Datenlokalität und Durchsatz unterstreicht.

Objektive Ergebnisse

1. Auswirkungen des CAP-Theorems Die inhärenten Kompromisse von Kafka, die zu erhöhten Overheads bei der Synchronisation von Lese- und Schreibvorgängen auf Partitionen führen, beeinträchtigen latenzgebundene Systeme durch die Bevorzugung von Verfügbarkeit und Partitionstoleranz auf Kosten unmittelbarer Konsistenzgarantien.

2. Ätiologie des Consumer-Lags Nicht uniforme Partitionierung und suboptimale Verwaltung von Consumergroups verschärfen die Verzögerungen bei der Datenverarbeitung. Die Analyse zeigt zeitliche Deserialisierungsdiskrepanzen auf, die durch schlecht abgestimmte Verbraucherkonfigurationen und falsche Offset-Verwaltung verursacht werden.

3. Beobachtungen zu Serialisierung und Durchsatz weisen Verzögerungen auf den Serialisierungsmechanismus zurück, wobei der aktuelle Durchsatz durch ineffizientes Datenhandling und Protokolle zur Schema-Evolution, die den Hochgeschwindigkeitseingang nicht aufrechterhalten können, begrenzt ist.

4. Beiträge zur Netzwerklatenz Variabler Netzwerkdurchsatz in Verbindung mit Kafkas Abhängigkeit von asynchronen I/O-Batches verstärken die Roundtrip-Latenz, was zu Abweichungen von vordefinierten Echtzeit-Transaktionslatenzbudgets führt.

Empfehlungen für Refaktorisierung

1. Erhöhte Parallelität Implementieren Sie granularere Partitionierungsstrategien zusammen mit dynamischen Rebalancing-Techniken, die sich an schwankende Handelsvolumina anpassen, um Consumergroup-Lag zu vermindern.

2. Optimierte Serialisierungsformate Wechseln Sie zu leistungsfähigeren Serialisierungsframeworks wie Protocol Buffers oder Avro, um Deserialisierungsengpässe insbesondere unter variablen Schema-Bedingungen zu verringern.

3. Minimierte Netzwerklatenz Setzen Sie auf Nähe basierende verteilte Broker-Knoten ein und nutzen Sie direkte RDMA-basierte Intra-Cluster-Kommunikation, um netzwerkbedingte Latenzschwankungen zu verringern.

4. Überarbeitung der Kafka-Konfiguration Feinabstimmung von Zookeeper-Synchronisationsintervallen und Producer-Consumer-Anerkennungseinstellungen sind unerlässlich, um eine niedrige Latenz bei der Nachrichtenreihenfolge aufrechtzuerhalten.

Erwartete Auswirkungen

Diese Refaktorisierung soll zu einem erheblichen Rückgang der End-to-End-Latenz führen, indem die operationellen Paradigmen von Kafka stärker mit den zeitlichen Anforderungen des Hochfrequenzhandels in Einklang gebracht werden. Der Konsumdurchsatz wird voraussichtlich deutlich verbessert, wodurch die Gesamteffizienz und Zuverlässigkeit des Systems in latenzkritischen Marktbedingungen gestärkt wird. Zukünftige Iterationen erfordern iterative Test- und Validierungsphasen, die auf empirische Latenz- und Durchsatzmetriken angewiesen sind, um die Systemleistungsgewinne zu verfeinern und zu bestätigen.”