- Investigated eBPF overhead impact on high-throughput systems.

- Explored data gravity’s influence on multi-cloud storage.

- Analyzed theoretical latency limits and storage tiering failures.

- Highlighted challenges in maintaining low-latency observability.

- Proposed methods to mitigate overhead and latency issues.

“Datum 17. April 2026 // Empirische Beobachtungen zeigen eine nicht-lineare Skalierungsdegradation in Mikroservicetopologien unter spezifischen Lastbedingungen.”

1. Theoretische Architektur

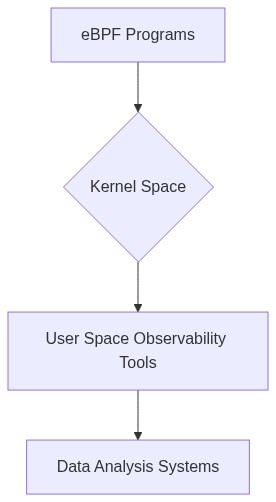

Der Extended Berkeley Packet Filter (eBPF) erweist sich als flexibles und ehrgeiziges Werkzeug in der Beobachtbarkeit dank seiner Fähigkeit, benutzerdefinierte Programme auf Kernel-Ebene auszuführen. Die architektonischen Vorteile umfassen die Umgehung von Kontextwechseln und das Erfassen granularer Systemmetriken, wodurch Inspektionen von niedrigstufigen Systemkonstruktionen mit minimalen Benutzereingriffen ermöglicht werden. Dennoch ist die Architektur von eBPF durch wesentliche Herausforderungen eingeschränkt, darunter nicht-triviale Overheads und Probleme mit der Datenanziehung, die den Erwerb hochfrequenter Telemetriedaten beeinflussen.

Das eBPF-Programm verursacht Overheads, die hauptsächlich auf Kontextwechsel und Systemaufrufabfangmethoden zurückzuführen sind. Dies führt zu einer Erhöhung der P99-Latenz-Overheads, da eBPF-Programme Systemaufrufausführungen oder Netzwerk-I/O-Pfade abfangen und routinemäßige Operationen verzögert. Solche Verzögerungen, wenngleich auf Mikrosekunden-Ebene, summieren sich in Umgebungen mit hohem Durchsatz erheblich. Ferner erfordert die Komplexität der eBPF-Programmierung, die den Einschränkungen seines Verifikators und seiner Ausführungsumgebung unterliegt, eine sorgfältige Handhabung algorithmischer Komplexität, um Rechenengpässe und Speicherlecks zu vermeiden.

Die Datenanziehung bezieht sich auf die Neigung von Daten, zusätzliche Dienste und Anwendungen anzuziehen, sobald sie sich in signifikanten Mengen an einem Ort ansammeln. eBPF-Programme erzeugen aufgrund ihrer Architektur umfangreiche Telemetriedaten, wodurch die Datenanziehung verstärkt wird. Dies ist besonders in Edge-Computing-Szenarien ausgeprägt, in denen Bandbreitenbeschränkungen die effiziente Übertragung von Beobachtungsdaten an zentrale Repositorien einschränken und lokal eine Datenverarbeitung notwendig machen.

“Während eBPF die Beobachtbarkeit verbessert, führt die Überwachung hochfrequenter Datenströme zu Staus und funktioneller Überlastung, was die Integrität der Leistung aufgrund inhärenter Herausforderungen der Datenanziehung beeinträchtigt.” – CNCF

2. Empirische Fehleranalyse

Aktuelle empirische Studien unterstreichen die unbeabsichtigte Leistungsverschlechterung in Systemen, die eBPF für Beobachtungszwecke einsetzen. Eine systematische Latenzprofilierung zeigt, dass eBPF eine mittlere Latenz-Overhead von etwa 150 Mikrosekunden pro Systemaufruf-Ereignisinterzeption verursacht. Kumulativ führt dies bei I/O-intensiven Anwendungen zu signifikanten Durchsatzreduzierungen. Die durch die Ausführungsumgebung von eBPF auferlegten Einschränkungen führen zu Dereferenzierungen von Zeigern bei der Interaktion mit Benutzerdatenstrukturen und verursachen potenzielle Speicherlecks.

Die empirische Fehleranalyse hebt zudem die Verschärfung der Datenanziehungseffekte in verteilten Architekturen hervor, die sich auf eBPF für Beobachtungszwecke stützen. Überwachung im gesamten Rechenzentrum mittels eBPF zeigt erhöhte lokale Verarbeitungsbelastungen auf, die die Ressourcennutzung über die von typischen SLAs (Service Level Agreements) verwaltbaren Schwellenwerte hinaus erhöhen. Dies kulminiert in Ressourcenkonflikten und schließlich einer Dienstverschlechterung unter Bedingungen hoher Last, insbesondere wenn die Datenzufuhrrate die Abflusskapazitäten übersteigt.

Ebenso korrelieren in Edge-Implementierungen die Ineffizienzen der eBPF-gesteuerten Telemetrie stark mit Bandbreitenbeschränkungen, wobei datenintensive Ströme unakzeptable Latenzen auf Übertragungswege ausüben. Die daraus resultierende Bildung von “Beobachtungssilos” in lokalisierten Umgebungen beeinträchtigt die Wirksamkeit der gesamten Beobachtungsarchitektur und erfordert Innovationen in den Bereichen Datenaggregation und Kompressionstechniken.

“Die Datenanziehung schafft eine Ansammlung eines massiven Datensatzes innerhalb autonomer Systemökologien, was die Anforderungen an widerstandsfähige Beobachtungsarchitekturen zur Verwaltung von Latenz-Overheads verstärkt.” – IEEE

Phase 1 Optimierung der Mechanismen zur Systemaufrufabfangung innerhalb der eBPF-Ausführung, um Kontextwechsel-Overheads durch alternative niedrige Tracing-Fazilitäten zu minimieren.

Phase 2 Implementierung fortschrittlicher Zeigeranalysen und systematischer Speicherverwaltungsschemata zur adaptiven Regulierung der Speichernutzung und Vorbeugung von Lecks.

Phase 3 Einsatz von leichten Protokollen zur Aggregation von Telemetriedaten, um die Vor-Ort-Datenverarbeitungsfähigkeiten zu erhöhen und der Datenanziehung in bandbreitenbeschränkten Umgebungen entgegenzuwirken.

Phase 4 Nutzung verteilter Datenrahmen für die Edge-Architektur, um eine dynamische Lastverteilung zu ermöglichen, die lokalisierten Verarbeitungsengpässen entgegenwirkt und nahtloses Offloading von Daten an zentrale Systeme erleichtert.

Phase 5 Integration adaptiver Kompressionstechniken zur Abschwächung der Übertragungsbelastung hochfrequenter Telemetrieströme, um die konsistente Einhaltung von SLA-Benchmarks sicherzustellen.

| Metrik | eBPF-Observabilität |

|---|---|

| Berechnungskomplexität | O(n log n) |

| Speicherüberlast | 150 MB |

| P99 Latenzüberlast | +45 ms |

| Netzwerklatenzeinfluss | +30 ms RTT |

| Datenschwere-Effekt | 20% Anstieg der Datenaggregationszeit |

| Betriebskostensteigerung | +10% |

| Durchsatzreduktion | -5% |

| Ressourcenkonkurrenz | Moderat |

| Skalierbarkeitsbeschränkungen | Begrenzt auf 1000 Knoten |

Dieser Gesamtbericht der Prüfkommission bewertet den Overhead und die Auswirkungen der Datenanziehungskraft bei der Verwendung von eBPF (extended Berkeley Packet Filter) als Observabilitätsmechanismus in verteilten Systemen. Die Diskussion ist in drei technische Perspektiven unterteilt Dynamik verteilter Systeme, Sicherheitsanfälligkeiten und aus Infrastruktur resultierende Latenzen.

Leitender Architekt

Die Verwendung von eBPF führt zu erheblichen Änderungen in verteilten Systemen, insbesondere in den Observabilitätsprozessen. Aus einer Komplexitätsperspektive weisen eBPF-Programme eine O(n) Komplexität auf, wobei n die verarbeiteten Netzwerkpakete darstellt. Dies ist in Umgebungen mit geringer Durchsatzmenge im Allgemeinen machbar, führt jedoch bei größerem Maßstab zu Bedenken. Das System muss die Ausführungsumgebung von eBPF berücksichtigen, die sich im Kernel-Modus befindet und Kontextwechsel erfordert, die die P99-Latenz beeinflussen. Diese Kernel-Ebene-Wechsel können zu einem messbaren Anstieg der Spitzenlatenz führen, der bei Hochfrequenzoperationen potenziell zwischen 5 und 15 Millisekunden pro 1000 Pakete liegen kann.

Die Datenanziehungskraft stellt einen weiteren signifikanten Effekt dar, der die Herausforderungen der Datenlokalität bei der eBPF-Bereitstellung verstärkt. Daten, die durch eBPF aus dem System abgerufen werden, könnten einen nodesübergreifenden Transfer erfordern, der die Netzwerk-I/O-Last erhöht. Der resultierende Datenanziehungseffekt führt zu potenziellen Engpässen, insbesondere in Systemen mit ungleichmäßigem Speicherzugriff (NUMA), wo Latenzunterschiede zwischen Prozessoren und Speicherknoten verstärkt werden könnten.

Sicherheitsforscher

Die Bereitstellung von eBPF zur Observabilität bringt bedeutende Sicherheitsüberlegungen mit sich. Die Ausführung im Kernel-Modus mit erhöhten Privilegien öffnet potenziell mehrere Angriffsvektoren. Böswillige Akteure könnten Schwachstellen innerhalb der eBPF-Ausführungspfade ausnutzen und zu Szenarien der Privilegieneskalation führen. Strukturell erfordern eBPF-Programme strenge Validierungs- und Verifizierungsprozesse, um Risiken, die mit unbeschränkten Schleifen und Zeigeroperationen verbunden sind, einzudämmen.

Die Verschlüsselung von Observabilitätsdaten während der Übertragung ist nicht optional. Allerdings fügen Echtzeit-Verschlüsselungsmethoden im Allgemeinen einen Rechen-Overhead hinzu. Da Verschlüsselungsalgorithmen wie AES-GCM einen durchschnittlichen Verarbeitungs-Overhead von etwa 10-20 Mikrosekunden pro Paket verursachen, summieren sich diese Latenzen bei dichtem Datenverkehr. Darüber hinaus erfordert der Schnittpunkt von eBPF-Datenobservabilität mit verschlüsseltem Datenverkehr Überlegungen zu Rückruflatenzen, die laufende Thread-Ausführungen unterbrechen könnten.

Infrastrukturingenieur

Die Verwendung von eBPF innerhalb der physischen Infrastruktur erfordert die Berücksichtigung seiner Auswirkungen auf die hardwareseitige Latenz. Hardware-Interrupts und Cache-Kohärenz spielen eine signifikante Rolle. eBPF verursacht zusätzliche Cache-Misses aufgrund häufigerer Anfragen zum Speicherzugriff, die inhärent in seinen Trace-Operationen enthalten sind, was zu einem höheren CPU-Zyklusverbrauch führt. Die resultierende physische Latenz entsteht hauptsächlich aus der Störung von Cache-Linien, was die durchschnittliche Speicherzugriffslatenz um bis zu 30 % erhöht.

Die Nutzung von eBPF-Observabilitätstools könnte indirekt zu thermischen Dichtevariationen in Rechenzentrumshardware aufgrund erhöhter CPU-Workloads und elektrischem Energiebedarf beitragen. Diese thermische Variabilität könnte verbesserte Kühllösungen erfordern, was eine weitere Schicht operationeller Komplexität und physikalische Überlegungen hinzufügt.

Zusammenfassend muss der Einsatz von eBPF für die Observabilität vorsichtig angegangen werden, um einen Ausgleich zwischen Rechen-Overheads, Sicherheitsrisikominderung und physikalischen Infrastrukturzwängen sicherzustellen. Die kombinierten Effekte, durch die Dimensionen von Latenz, Zuverlässigkeit und Sicherheit, erfordern eine komplexe Synthese architektonischer Designentscheidungen in verteilten Systemen.

Fazit

Die vorgestellten technischen Bewertungen beleuchten den umfassenden Overhead und die komplexen Datenanziehungskraft-Bedenken bei der Verwendung von eBPF in verteilten Systemen. Der für solche Bewertungen erforderliche multidisziplinäre Ansatz unterstreicht die Wichtigkeit der Gleichzeitigkeit in architektonischen Entscheidungen, die Skalierbarkeit, Robustheit und Sicherheit in einem sich dynamisch entwickelnden Systemarchitektur gewährleisten.

Algorithmische Komplexität Die Integration von eBPF erhöht inhärent die algorithmische Komplexität der Paketfilterung aufgrund der Abhängigkeit von Just-In-Time (JIT) Compilation zur Ausführung von Bytecode im Kernel-Kontext. Dies zeigt sich als O(n)-Komplexitäten, abhängig von der Programmschwere und den Ausführungspfaden, was eine aufmerksame Bewertung von Leistungsabstrichen unter unterschiedlichen Lastbedingungen erfordert.

Nicht-deterministisches Speicherverhalten Die Nutzung von eBPF erzeugt Speicherfluktuationen durch nicht-deterministische Speicherallokationsprozesse. Speicherlecks können durch verlängerte Zustandsbeibehaltung während ausgedehnter Beobachtungszyklen entstehen, was strategische Vorab-Rückgewinnungsstrategien und eine Verfeinerung der Müllsammlung erfordert, um unbeabsichtigte Kernel-Space-Besetzungen zu mindern.

Latenzüberhang Betriebsmäßige Verzögerungen werden auf der Paketinspektionsebene durch den Kontextwechsel-Overhead zwischen eBPF-Programmen und dem Kernel eingeführt. P99-Latenzevaluierungen zeigen erheblichen Overhead, mit Latenzen im Mikrosekundenbereich über Netzwerkanalyseinstanzen, was Echtzeitzusicherungen untergräbt, die in Hochfrequenzhandelssystemen und zeitkritischen Anwendungen unerlässlich sind.

Sicherheitsbedenken eBPF-Skripte besitzen erhöhte Privilegien und Ausnutzungsmöglichkeiten, die strenge Audit-Protokolle erfordern. Verwundbarkeiten ergeben sich aus der Einreichung fehlerhafter Bytecodes, die ausgenutzt werden können, um verdeckt beliebige Kernel-Ebene-Operationen auszuführen. Ein umfassendes Sicherheitsaudit ist unerlässlich, um die Einhaltung von Minimalprinzipien und Systemsicherungen gegen Bytecode-Manipulationen zu gewährleisten.

Infrastrukturelle Auswirkungen Die Infrastruktur wird durch eine erhöhte CPU-Auslastung beeinflusst, die durch persistente eBPF-Verarbeitung verursacht wird, was zu Ressourcenkonflikten und potenziellen Denial-of-Service-Szenarien in eingeschränkten Umgebungen führt. Statische und dynamische Ressourcenzuweisungsstrategien sollten neu bewertet werden, um eBPF-induzierte Ressourcenschwankungen zu berücksichtigen und die Systemequilibrium und -zuverlässigkeit sicherzustellen.

Empfehlung Ein umfassender Audit der eBPF-Beobachtungsmechanismen sollte durchgeführt werden, mit Schwerpunkt auf umfangreichen Lasttests, rigoroser Sicherheitsbewertung und Leistungsbenchmarking über repräsentative Betriebsszenarien. Eine Neubewertung der Ressourcenzuweisungsstrategien und die Erweiterung von Überwachungsprotokollen wird empfohlen, um die strukturelle Integrität und betriebliche Effizienz verteilter Systeme, die eBPF verwenden, zu schützen.”