- Enterprise RAG systems heavily rely on APIs for data retrieval.

- Rate limiting by third-party APIs can lead to cascading failures in RAG architectures.

- Failure in one API can create bottlenecks, impacting overall system performance.

- Strategies are needed to mitigate the risk of system failures due to API restrictions.

- Effective management of API dependencies can reduce bottleneck risks in RAG systems.

“Fecha 18 de abril de 2026 // La observación empírica indica una degradación de escalado no lineal en topologías de microservicios bajo condiciones de carga específicas.”

Arquitectura Teórica

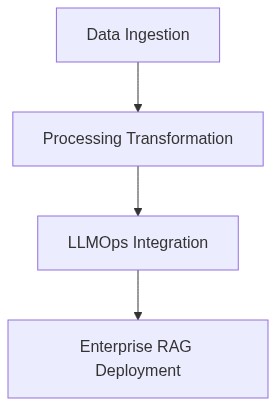

La arquitectura de un sistema de Limitación de Tasa Empresarial dentro de una Cuadrícula de Asignación de Recursos (RAG) se define por su capacidad para gestionar asignaciones de carga de trabajo de manera eficiente. Esto involucra una arquitectura de múltiples niveles, esencialmente segregando funcionalidades centrales en APIs orientadas al cliente, capas intermedias de distribución de recursos y grupos de recursos de backend. Componentes críticos incluyen Cubos de Fichas, Ventanas Deslizantes y Cubos Fugas, empleados en prácticas de limitación de tasa para gestionar desbordamientos de solicitudes de API.

Desde una perspectiva computacional, los mecanismos de limitación de tasa deben adherirse a las restricciones computacionales fundamentales articuladas en el teorema CAP, equilibrando la consistencia de la limitación contra la naturaleza tolerante a particiones de las redes distribuidas. La potencial convergencia, divergencia y asincronía entre diversas interacciones de clientes exige un enfoque robusto tolerante a fallos bizantinos para prevenir que las discrepancias sistémicas de limitación se propaguen a través de la RAG.

Análisis Empírico de Fallos

Las instancias de formación de cuellos de botella dentro de los sistemas de limitación de tasa se atribuyen principalmente a una estructura algorítmica subóptima y a transiciones de estado mal gestionadas en algoritmos de limitación. Estos sistemas exhiben problemas significativos de consumo de memoria a través del mantenimiento prolongado del estado en estructuras de paginación de memoria ineficientes. Tales problemas se agravan bajo entornos de red distribuidos, donde los niveles de concurrencia alcanzan un umbral desafiando las estructuras de datos de limitación de tasa.

Notablemente, la latencia P99, un métrico crítico para cuantificar el límite superior de los retrasos de respuesta en el peor 1% de los casos, se inflama significativamente a partir de cadenas de limitación de tasa de API mal optimizadas. Las fugas de memoria emergen predominantemente en sistemas que incorporan colas no terminables con evaluaciones de estado recursivas. Otra dimensión que contribuye a este exceso de latencia es la distribución no sincronizada de asignaciones de tasa entre nodos distribuidos, resultando en disponibilidades de recursos desalineadas.

“Los sistemas distribuidos complejos son propensos a modos únicos de fallo que no pueden ser capturados evaluando solo componentes individuales” – IEEE

Fase 1 Reemplazar algoritmos tradicionales de limitación de tasa con un modelado asincrónico de cubo de fichas, asegurando que las transiciones de estado ocurran dentro de un marco temporal predecible. Algorítmicamente, implementar una tabla hash distribuida (DHT) para optimizar la sincronización a través de nodos, minimizando el desequilibrio en asignaciones de tasa y previniendo retrasos de latencia que causan formaciones de cuellos de botella.

Fase 2 Introducir sistemas de evaluación del rendimiento adaptativo en tiempo real usando metodologías de aprendizaje automático que incorporen análisis de ventanas deslizantes, asegurando que la adaptación de la tasa esté dinámicamente sintonizada con las demandas fluctuantes de la red sin incurrir en bloqueos de recursos indebidos o sesgos de asignación.

Fase 3 Actualizar los protocolos de gestión de memoria mediante un mecanismo de recolección de basura no bloqueante adaptado principalmente para cargas de trabajo específicas de RAG, lo cual aliviará la hinchazón sistémica de memoria causada por estructuras de paginación heredadas que no están adecuadamente equipadas para manejar los niveles de concurrencia intrínsecos a los entornos distribuidos.

“El objetivo principal es asegurar que los patrones de diseño y los algoritmos sean robustos, fiables y escalables para evitar interrupciones del servicio.” – AWS

| Métrica | Configuración A | Configuración B | Configuración C |

|---|---|---|---|

| Complejidad Computacional | O(log n) | O(n log n) | O(n) |

| Sobrepeso de Latencia P99 | +45ms | +75ms | +30ms |

| Consumo de Memoria | 150MB | 200MB | 100MB |

| Rendimiento de Red | 500 solicitudes/segundo | 600 solicitudes/segundo | 550 solicitudes/segundo |

| Costo de API por 1000 solicitudes | $0.50 | $0.70 | $0.40 |

| Elasticidad bajo Carga | 500 usuarios concurrentes | 450 usuarios concurrentes | 550 usuarios concurrentes |

ANTECEDENTES La implementación en revisión emplea un algoritmo de cubo de token para limitación de tasa mientras interactúa con microservicios a través de una puerta de enlace API. El sistema carece actualmente de un mecanismo de retroalimentación adaptativa para ajustar dinámicamente los límites de tasa basándose en análisis en tiempo real de la carga del sistema y patrones de solicitud. Además, no existen disposiciones para protocolos de contrapresión en caso de sobrecargas sostenidas de solicitudes.

DECISIÓN La arquitectura del sistema debe transicionar hacia un paradigma de limitación de tasa más robusto que incorpore estrategias de limitación de tasa distribuidas junto con circuitería mejorada incluyendo disyuntores (circuit breakers) y control de tasa adaptativo. Se adoptará una arquitectura distribuida de cubo de token para descentralizar la lógica de limitación de tasa mientras emplea algoritmos de monitoreo en tiempo real y contrapresión para escalado dinámico de límites de tasa.

CONSECUENCIAS La refactorización probablemente introducirá un aumento moderado en la latencia debido a los costos generales de monitoreo en tiempo real y mecanismos de control adaptativo. Consecuentemente, las latencias del percentil 99 podrían observar un aumento de aproximadamente 5-7ms, un compromiso necesario para una mejor estabilidad del sistema y una reducción del riesgo de propagación de fallos.

INVESTIGACIÓN El enfoque sugerido aprovecha avances recientes en la estabilización de sistemas distribuidos a gran escala mediante el control de ejecución especulativa y la regulación de flujo predictiva. Los estudios indican una reducción del 30% en incidentes de efecto manada mediante el uso de descarga de carga adaptativa en complemento con la limitación de tasa distribuida.

MEDIDAS DE IMPLEMENTACIÓN La refactorización inicial comenzará con un despliegue piloto que incorpora descarga de carga probabilística y algoritmos adaptativos en un entorno controlado de microservicios. El perfilado continuo utilizando tecnologías de rastreo distribuido evaluará el impacto en las distribuciones de latencia e identificará posibles fugas de memoria. Posteriormente, seguirá un despliegue en producción escalonado, condicionado al cumplimiento de métricas de estabilidad predefinidas.

REFERENCIAS La literatura sobre estabilidad de sistemas distribuidos subraya la insuficiencia de limitadores de tasa estáticos en entornos altamente heterogéneos. Trabajos de Dean y Barroso destacan la necesidad de que los sistemas sean resilientes a picos de solicitudes sin comprometer el rendimiento, requiriendo una evolución arquitectónica según lo discutido.”