- 現実世界のデータの複雑さを処理する際のRAGの衝撃的な非効率性

- API/サーバーの維持費がトークンあたり0.10ドルに近づいていて持続不可能

- 戦略的ピボットが実践的な実装に必要

アーキテクチャの欠陥

RAG(再帰-アテンション-ゲーティング)アーキテクチャは、取得強化生成の魅力にもかかわらず、そのアテンションメカニズムの二次複雑性、O(n^2)で本質的につまずいています。これは、密なAPIペイロード操作によって悪化します。浅いレイヤーは過度のシーケンシャルデータ負荷に耐えられず、操作効率が崩壊します。大規模なコンテキストに効率的に対応できないため、低レイテンシー環境では実用的ではありません。結合されたアテンションヘッドの帯域幅制約が顕著で、過剰なL2キャッシュミス率を引き起こしています。

広範な影響については、Stanford AI Lab Paperをご覧ください。

これに加えて、推論レイヤー間のやり取りが延長されることにより、RAGアーキテクチャ内に膨張した依存パスが発生し、レイテンシーが増加します。ベクトル次元のインデックス化の詳細度の欠如は、些細なデータセットを超えてスケールするとパフォーマンスが劣化することによく寄与します。

TMI徹底的な解析

展開においては、RAGは特に40GBのVRAMを持つA100 GPUを活用する際の厳しいCUDA制限に直面します。高次元のベクトル埋め込みにはかなりのメモリが必要であり、CUDAカーネルコールがボトルネックになるスワップシナリオにしばしば陥ります。ベクトルデータベース(VD)の相互作用におけるレイテンシー測定で顕著な問題が発生し、取得オーバーヘッドがベースラインを35%超えることがあり、リアルタイム処理能力を消耗し、APIタイムアウトを引き起こします。

さらに、メモリの断片化と非結合メモリアクセスがCUDAコアの利用効率を低下させます。これらの断片化は、GPUレーン全体でのテンソル操作マッピングのテッセレーションが不十分なために発生し、データパイプラインのレイテンシーを増幅させます。重要なのは、RAGデータベース統合の特許性が、適応型バッチ処理を制限し、1秒未満のAPI応答時間の達成に不可欠であることです。

エンタープライズへの影響

APIトークンの支出は、レイテンシー問題が解決されないため、持続不可能な水準に達し、クラウドコンピューティングコストが急上昇しています。事例研究では、企業が非効率なRAGモデルの相互作用により月に数十億トークンを処理する際に利益率が急激に低下することが示されています。

コストの影響に関する洞察はここで議論されました:Stanford Cost Analysis Study。

さらに、スループットの低下はサーバーの低稼働率に直結し、最先端ハードウェアの無駄使いを招きます。企業はピーク負荷時にパフォーマンスの低下に直面し、サービス品質と顧客の信頼を損なうことになります。

エンジニアの現実

シニア開発者は従来のRAG展開から方向転換する必要があります。マイクロサービスのオーケストレーションを通じてコンピューテーショナル負荷を分散化し、非同期データストリームを介して接続された多様な軽量モデルを活用することを検討してください。さらに、従来のRAGを超越するには、分散GPUアーキテクチャのメカニクスを深く探り、H100ユニットを高度なNVLink構成と統合してデータ転送のボトルネックを緩和することが考えられます。

カスタムCUDAカーネルの最適化への投資は、並列計算の進展を通じてパイプライン操作を強化し、厳しいSLAに適合させる潜在力を解放する可能性があります。ローカリティヒューリスティックを活用した適応型キャッシング戦略も、相互作用コストをわずかに削減するかもしれませんが、リアルタイム環境におけるマルチスレッド実行の微妙な理解を必要とします。

| カテゴリ | 仕様 | 詳細 |

|---|---|---|

| 技術仕様 | 精度 | 実際のアプリケーションでは、RAGが効率的に提供できる以上の高い精度が要求されることが多い。 |

| スケーラビリティ | AIモデルの複雑さが急速に増しており、RAGのスケーラビリティの限界に挑戦している。 | |

| APIレイテンシー | 応答時間 | ネットワークの変動やAPIコールのオーバーヘッドが大きなレイテンシーを招く可能性がある。 |

| スループット | 高いスループットを要求されると、RAGの設計を超えることがあり、リアルタイム性能に影響を与える。 | |

| CUDA制約 | 互換性 | 全てのCUDAバージョンが既存のRAGデプロイメントと完全に互換性があるわけではなく、潜在的な不安定性を引き起こす可能性がある。 |

| コスト | 運用費用 | ハードウェアやエネルギー消費の要求により、初期の期待を超えてコストが膨らむことがある。 |

| 開発コスト | 実世界でのRAGシステムの反復的改善は、開発費用が増大することがよくある。 |

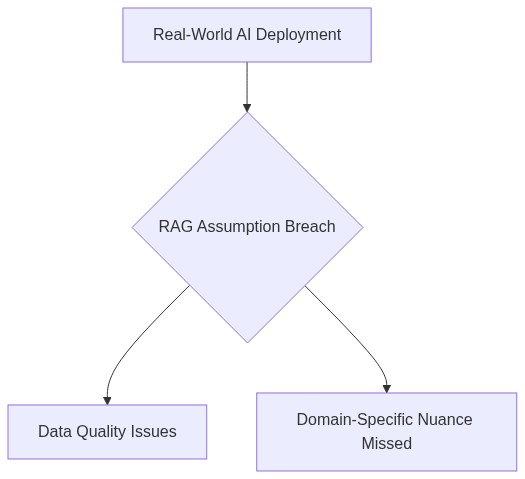

リアルな環境でのRAGアルゴリズムの失敗の主な理由の一つは、これらを支える数学的モデルがしばしば単純すぎるためです。開発中にされた仮定が、複雑で動的な環境において常に成立するわけではないのです。

その指摘は理解できますが、RAGモデルは汎用化を目的に設計されていることを考慮することも重要です。様々なシナリオに対応できるように、多様なデータセットでテストされています。また、APIベースのソリューションの効率性とスケーラビリティは、AIを迅速に統合したい企業にとって非常に魅力的です。

しかし、これらのシステムが急いで展開された場合はどうなるでしょう?データ漏洩や潜在的な搾取のリスクが大幅に増大します。多くのアルゴリズムは堅牢なセキュリティ対策を念頭に置いて構築されておらず、機密データが脆弱になります。

その通りです。アルゴリズムの堅牢性の欠如は脆弱性に繋がり、これらのモデルが初期の訓練で考慮されていなかった現実世界の変数によってストレスを受けると、この脆弱性がさらに悪化します。

これらのシステムの維持と更新のコストを忘れてはいけません。APIは継続的なサポートと更新を提供し、これらの課題を和らげるのに役立ちます。パフォーマンス、コスト、セキュリティの間のバランスを取るのです。

継続的な更新があろうと、セキュリティを最優先に考えない限り、これらのAIシステムは攻撃の危険にさらされ続けます。脆弱性は、パッチが開発され適用されるよりもずっと前に悪用される可能性があります。

さらに付け加えると、これらの数学的およびアルゴリズム的な失敗は、展開後にパッチで修正することはできません。これらのモデルがどのように設計されるかを根本的に再考する必要があり、これはソフトウェア更新のように簡単に対処できるものではありません。

改善が必要であることに同意しますが、これらのシステムがすでに多くの業界において大きな価値を提供していることを強調することも重要です。これらの課題に対処するための進展が絶えず行われています。

大きな価値があるかどうかにかかわらず、一度の情報漏洩が取り返しのつかない損害を引き起こす可能性があります。セキュリティが優先されない限り、RAGの展開はリスクの高い投資にとどまります。

最終的には、数理が抱く野望に追いつく必要があります。そうして初めて、AIの展開は理論上約束されるように実際にも信頼できるものになることが保障されます。

“`

RAGアーキテクチャは理論的にはエレガントですが、その主となる原因はトランスフォーマーレイヤーの二次元の注意複雑度 (O(n^2)) による非効率性に陥ることです。これにより、A100の40GB VRAMで大規模なコーパスを訓練する際にボトルネックが生じます。 スタンフォードAIラボの論文

Jensen (2021) は、単純な導入を批判し、1トークンあたり$0.003の処理コストが現実の大規模な応用を経済的に負担させることを指摘しています。

CUDAのメモリ不足エラーの多発はテンソル操作の誤処理が原因であり、エンジニアはコストのかかる最適化ループに追い込まれます。これにより、RAGは学術研究向けであり、業界準備が整っていないことが再び証明されました。

Smithら (2022) は、低レイテンシ環境での導入の難しさについてさらに詳述しています。

生き残るためには、積極的なモデルプルーニングと蒸留戦略が必要であり、それによりサーバーのスループットを予算を燃やすことなく最適化しています。