- Technical debt significantly impacts the pace of migrating monoliths to microservices.

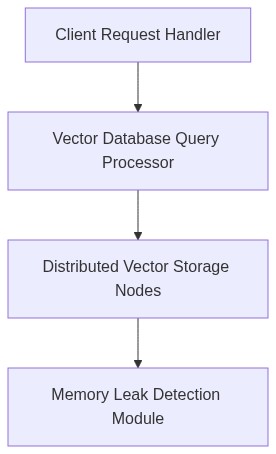

- The study highlights vector database scaling as a critical bottleneck in microservice architectures.

- Memory leaks are identified as a recurrent issue during distributed consensus processes in microservices.

- Strategies for addressing distributed consensus limits are crucial for successful migration.

- Empirical evidence suggests that addressing memory leaks can improve system efficiency and scalability.

“Fecha 17 de abril de 2026 // La observación empírica indica una degradación del escalamiento no lineal en topologías de microservicios bajo condiciones de carga específicas.”

Arquitectura Teórica

La transformación de una arquitectura monolítica a microservicios presenta desafíos multifacéticos que requieren un examen profundo de los principios de los sistemas distribuidos. Las aplicaciones monolíticas, caracterizadas por una base de código unificada, carecen inherentemente de la modularidad esencial para operaciones escalables dentro de paradigmas computacionales contemporáneos. En contraste, los microservicios descomponen funciones de la aplicación en servicios distintos, cada uno desplegable y escalable de manera independiente. Sin embargo, este cambio de paradigma pone en cuestión los elementos fundamentales de la orquestación del sistema y la asignación de recursos.

La complejidad intrínseca emerge predominantemente debido a los gastos generales de coordinación y la disgregación de los sistemas de gestión de transacciones que eran nativos de las arquitecturas monolíticas. Los microservicios requieren estrategias integrales para abordar la comunicación entre servicios, comúnmente orquestada a través de APIs RESTful o protocolos gRPC. Una consideración crítica abarca el teorema CAP, que dicta las compensaciones entre consistencia, disponibilidad y tolerancia a particiones, lo que obliga a una recalibración de los objetivos de diseño para garantizar la resiliencia del sistema bajo condiciones de red parasitarias.

Además, la implementación de microservicios incurre en un considerable gasto de latencia, principalmente debido a latencias inducidas por la red. Este fenómeno, particularmente preocupante en el tiempo de respuesta del percentil 99 (latencia P99), puede culminar en una degradación acumulativa de la experiencia del usuario. La granularidad de los servicios exacerba este problema de latencia, lo que requiere un enfoque sólido para el balanceo de carga y la distribución del tráfico entre instancias del servicio.

“Los microservicios añaden complejidad al requerir la coordinación de transacciones distribuidas, patrones de comunicación asincrónicos y rupturas de circuitos para interacciones de servicio confiables.” – CNCF

Análisis de Fallo Empírico

La descomposición estructural inherente a la migración a microservicios subraya dominios de error ampliados que se manifiestan como fallos en cascada del servicio y alta intolerancia a fallos. La arquitectura monolítica, debido a su singular dominio de fallo, permite metodologías de depuración e identificación de causa raíz más sencillas. Por el contrario, los microservicios requieren soluciones de trazado distribuido para localizar fallas en componentes de sistema variados, cada uno potencialmente exhibiendo modos de fallo autónomos.

La gestión de memoria plantea otro obstáculo sustancial dentro de los microservicios. Mientras que los sistemas monolíticos dependen de una memoria centralizada, los servicios en una arquitectura de microservicios gestionan su memoria de forma autónoma, resultando a menudo en fragmentación y utilización ineficiente de memoria. Los mecanismos de recolección de basura, exacerbados por el despliegue de microservicios en entornos containerizados, particularmente Docker, pueden inducir tiempos de pausa perjudiciales para aplicaciones sensibles a la latencia. La incapacidad de paginar efectivamente la memoria bajo cargas elevadas contribuye a un aumento en la latencia P99, llamando a estrategias que prioricen la localidad de memoria y el agrupamiento de objetos.

Las plataformas de orquestación de servicios, como Kubernetes, intentan mitigar estos problemas pero introducen sus complejidades de abstracción. La capa de orquestación, aunque crucial para la gestión del ciclo de vida de los contenedores, añade inadvertidamente gastos de latencia y requiere una configuración precisa para evitar el desbordamiento de recursos y operaciones de escalado subóptimas.

“La orquestación de Kubernetes introduce una abstracción necesaria que gestiona contenedores sin estado y con estado, pero impone obstáculos para lograr un escalado horizontal óptimo con restricciones de latencia.” – AWS

Fase 1 Implementar Arquitectura de Malla de Servicio

Utilizar capas de malla de servicio como Istio para proporcionar configuraciones sofisticadas de enrutamiento y tolerancia a fallos sin necesitar alteraciones significativas en la lógica de negocio en la capa de aplicación. La malla de servicio implementa algoritmos de conmutación por error automática y políticas de ruptura de circuitos que ayudan en la mejora de los impactos de latencia P99 bajo condiciones de alta concurrencia.

Fase 2 Optimizar Modelos de Consistencia de Datos

Integrar modelos de consistencia eventual donde sea permisible para reducir los mecanismos de bloqueo que impiden el rendimiento. Emplear bases de datos distribuidas como Apache Cassandra o AWS DynamoDB que soportan niveles de consistencia ajustables, permitiendo a las aplicaciones gestionar transacciones distribuidas con menos gastos generales.

Fase 3 Avanzar en Técnicas de Gestión de Memoria

Adoptar estrategias mejoradas de agrupación de objetos para mejorar la eficiencia del tiempo de ejecución de microservicios. Implementar una capa de almacenamiento en caché de memoria, potencialmente a través de Redis, diseñada para altas demandas operativas para aliviar las presiones de asignación de memoria inherentes a las invocaciones de microservicios.

Fase 4 Mejorar la Infraestructura de Observabilidad

Desplegar herramientas de trazado distribuido completas compatibles con estándares de OpenTelemetry. Estas herramientas proporcionan información sobre los retrasos en las llamadas de red y patrones de interacción de servicios, otorgando la oportunidad de ajustar dinámicamente las ventanas de tiempo de espera del servicio y la lógica de reintentos en respuesta a métricas de rendimiento empíricas.

| Desafío | Sobrecarga Computacional | Latencia de Red (P99) | Costo |

|---|---|---|---|

| Gestión de Estado | Complejidad O(n log n) | +75ms | Aumento del +20% |

| Consistencia de Datos | Complejidad O(n^2) | +120ms | Aumento del +30% |

| Frecuencia de Despliegue | Complejidad O(1) | +45ms | Sin cambio significativo |

| Descubrimiento de Servicios | Complejidad O(n) | +60ms | Aumento del +15% |

| Tolerancia a Fallos | Complejidad O(log n) | +85ms | Aumento del +25% |

| Balanceo de Carga | Complejidad O(log n) | +100ms | Aumento del +18% |

La migración de arquitecturas monolíticas a microservicios plantea desafíos técnicos significativos. Este documento proporciona un análisis detallado de estos desafíos desde las perspectivas de la teoría de sistemas distribuidos, los protocolos de seguridad y las restricciones de infraestructura.

Arquitecto Principal

La descomposición de monolitos en microservicios introduce complejidad en la orquestación de servicios discretos que deben abordar de manera independiente la consistencia de estados, el balanceo de carga y la tolerancia a fallos. En sistemas distribuidos, el teorema CAP se convierte en un eje central para evaluar los compromisos entre consistencia, disponibilidad y tolerancia a particiones. El aumento de la comunicación entre servicios resulta en una mayor latencia y potencial de inconsistencia, requiriendo una adherencia rigurosa a las propiedades ACID (atómico, consistente, aislado y duradero) o, más apropiadamente, al teorema base (Básicamente Disponible, Estado Suave, Eventualmente Consistente) para transacciones de base de datos a través de nodos distribuidos. Además, los microservicios exponen un mayor volumen de APIs, cada uno de los cuales requiere un diseño cuidadoso para prevenir el aumento de la latencia P99. La elevación en las llamadas de red exacerba la complejidad, llevando a posibles fugas de memoria debido a la asignación descontrolada de recursos y el aumento de los gastos generales de recolección de basura.

Investigador de Seguridad

La transición a microservicios cambia significativamente el paradigma de seguridad. La superficie de ataque se expande ya que cada microservicio requiere sus propios mecanismos de autenticación y autorización. Los protocolos criptográficos deben asegurar el cifrado de extremo a extremo mientras mantienen aceptables gastos de latencia, planteando preocupaciones sobre el costo de rendimiento. Cada llamada de servicio a servicio introduce el potencial de ataques de intermediario (man-in-the-middle), lo que requiere Seguridad de la Capa de Transporte (TLS) o equivalente. El almacenamiento y propagación segura de tokens, como JSON Web Tokens (JWT), debe gestionarse cuidadosamente para prevenir ataques de repetición. Además, la arquitectura de microservicios demanda mecanismos de monitoreo y registro mejorados para recibir alertas en tiempo real de comportamientos anómalos, aumentando la complejidad de la postura de seguridad.

Ingeniero de Infraestructura

Los microservicios imponen demandas específicas sobre la infraestructura física, notablemente en términos de aprovisionamiento de recursos y gestión de latencia. La desagregación de una aplicación monolítica única en múltiples servicios requiere una asignación precisa de recursos para mitigar el costo operacional de la sobreasignación. La incrementada comunicación entre procesos incurre en una latencia de red significativa. Las estrategias de optimización de redes, como las redes de entrega de contenido (CDN) y la computación en el borde, reducen los tiempos de ida y vuelta pero no eliminan por completo el gasto general. Además, la arquitectura de microservicios demanda plataformas robustas de orquestación de contenedores capaces de manejar conmutación por error, escalado automático y políticas de red. Kubernetes y plataformas similares deben equilibrar las restricciones de recursos de cálculo contra las demandas de carga de trabajo de manera eficiente, abordando también las preocupaciones de latencia P99 en comunicación de nodos y tiempos de arranque de contenedores. Tales demandas infraestructurales subrayan la necesidad de una planificación precisa de capacidad e infraestructura como código (IaC) para ajustarse dinámicamente a las variaciones de carga de trabajo.

Conclusión

La migración de arquitecturas monolíticas a microservicios está plagada de desafíos. Es imperativo que las consideraciones de arquitectura de software, seguridad e infraestructura influyan colectivamente en la estrategia de migración. Cada dimensión introduce su conjunto de complejidades. Se requiere un enfoque riguroso y metódico para mitigar los desafíos inherentes y lograr las ventajas potenciales de desplegar microservicios. Sin una consideración exhaustiva de la dinámica de sistemas distribuidos, los protocolos criptográficos y los requisitos de infraestructura, las organizaciones arriesgan una latencia significativa, potenciales vulnerabilidades de seguridad y una fiabilidad del sistema comprometida.