- Technical debt significantly impacts the pace of migrating monoliths to microservices.

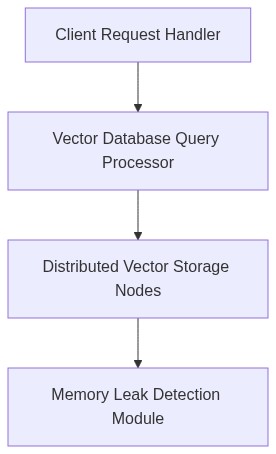

- The study highlights vector database scaling as a critical bottleneck in microservice architectures.

- Memory leaks are identified as a recurrent issue during distributed consensus processes in microservices.

- Strategies for addressing distributed consensus limits are crucial for successful migration.

- Empirical evidence suggests that addressing memory leaks can improve system efficiency and scalability.

“Datum 17. April 2026 // Empirische Beobachtungen weisen auf eine nicht-lineare Skalierungsverschlechterung in Mikroservicetopologien unter spezifischen Lastbedingungen hin.”

Theoretische Architektur

Die Transformation von monolithischen zu Microservices-Architekturen präsentiert vielseitige Herausforderungen, die eine tiefgehende Untersuchung der Prinzipien verteilter Systeme erfordern. Monolithische Anwendungen, gekennzeichnet durch einen einheitlichen Code, fehlen von Natur aus die Modularität, die für skalierbare Operationen innerhalb zeitgenössischer Rechenparadigmen essenziell ist. Im Gegensatz dazu zerteilen Microservices Anwendungsfunktionen in einzelne Dienste, die jeweils unabhängig bereitgestellt und skaliert werden können. Allerdings fordert dieser Paradigmenwechsel die grundlegenden Elemente der Systemorchestrierung und der Ressourcenzuweisung heraus.

Die inhärente Komplexität entsteht überwiegend durch den Koordinationsaufwand und die Auflösung von Transaktionsmanagementsystemen, die in monolithischen Architekturen nativ sind. Microservices erfordern umfassende Strategien zur Bewältigung der inter-service Kommunikation, die üblicherweise über RESTful APIs oder gRPC-Protokolle orchestriert wird. Eine kritische Überlegung umfasst das CAP-Theorem, das die Abwägungen zwischen Konsistenz, Verfügbarkeit und Partitionstoleranz diktiert und eine Neukalibrierung der Designziele erzwingt, um die Systemresilienz unter parasitären Netzwerkbedingungen sicherzustellen.

Darüber hinaus führt die Implementierung von Microservices zu einem beträchtlichen Latenzaufwand, der hauptsächlich durch netzwerkinduzierte Verzögerungen verursacht wird. Dieses Phänomen ist insbesondere in Bezug auf die Latenzzeit im 99. Perzentil (P99-Latenz) kritisch, da es in einer kumulativen Verschlechterung der Benutzererfahrung gipfeln kann. Die Granularität der Dienste verschärft dieses Latenzproblem, was einen robusten Ansatz für das Lastenausgleich und die Verteilung des Datenverkehrs über Dienstinstanzen erfordert.

“Mikroservices erhöhen die Komplexität durch die erforderliche Verteilungstransaktionskoordinierung, asynchrone Kommunikationsmuster und Circuit-Breaking für zuverlässige Dienstinteraktionen.” – CNCF

Empirische Fehleranalyse

Die strukturelle Dekomposition, die mit der Migration zu Microservices einhergeht, betont verstärkte Fehlerdomänen, die sich als Dienstkaskadenfehler und hohe Fehlerintoleranz manifestieren. Die monolithische Architektur ermöglicht aufgrund ihrer singulären Fehlerdomäne einfachere Debugging- und Ursachenbestimmungsmethoden. Im Gegensatz dazu erfordern Microservices verteilte Tracing-Lösungen, um Fehler in unterschiedlichen Systemkomponenten zu lokalisieren, die jeweils autonome Fehlermodi aufweisen können.

Das Speichermanagement stellt eine weitere erhebliche Hürde innerhalb von Microservices dar. Während monolithische Systeme auf zentralisierten Speicher angewiesen sind, verwalten Dienste in einer Microservices-Architektur ihren Speicher autonom, was häufig zu Fragmentierung und ineffizienter Speichernutzung führt. Garbage-Collection-Mechanismen, die durch den Einsatz von Microservices in containerisierten Umgebungen, insbesondere Docker, verstärkt werden, können Pausenzeiten verursachen, die für latenzempfindliche Anwendungen nachteilig sind. Die Unfähigkeit, Speicher bei hoher Last effektiv zu paginieren, trägt zur erhöhten P99-Latenz bei und erfordert Strategien, die Speicherlokalität und Objektpools priorisieren.

Service-Orchestrierungsplattformen wie Kubernetes versuchen, diese Probleme zu mildern, führen jedoch ihre eigenen Abstraktionskomplexitäten ein. Die Orchestrierungsschicht, die entscheidend für das Lebenszyklusmanagement von Containern ist, fügt unbeabsichtigt Latenzaufwände hinzu und erfordert eine präzise Konfiguration, um Ressourcenschwankungen und suboptimale Skalierungsoperationen zu umgehen.

“Die Orchestrierung durch Kubernetes führt notwendige Abstraktionen ein, die stateless und stateful Container verwalten, stellt jedoch auch Herausforderungen bei der Erreichung optimaler horizontaler Skalierung unter Latenzbeschränkungen dar.” – AWS

Phase 1 Implementierung von Service-Mesh-Architektur

Nutzen Sie Service-Mesh-Schichten wie Istio, um ausgeklügelte Routing- und Fehlertoleranzkonfigurationen bereitzustellen, ohne wesentliche Änderungen an der Geschäftslogik auf Anwendungsebene. Service-Mesh implementiert automatische Failover-Algorithmen und Circuit-Breaking-Politiken, die zur Minderung der P99-Latenzauswirkungen bei hoher Parallelität beitragen.

Phase 2 Optimierung der Datenkonsistenzmodelle

Integrieren Sie, wo immer möglich, eventual Consistency-Modelle, um die Sperrmechanismen zu reduzieren, die den Durchsatz behindern. Nutzen Sie verteilte Datenbanken wie Apache Cassandra oder AWS DynamoDB, die abstimmbare Konsistenzgrade unterstützen, um Anwendungen eine elegante Handhabung verteilter Transaktionen mit reduziertem Aufwand zu ermöglichen.

Phase 3 Fortgeschrittene Speicherverwaltungstechniken

Adoptieren Sie verbesserte Objektpoolsstrategien zur Verbesserung der Laufzeiteffizienz von Microservices. Implementieren Sie eine Zwischenspeicherschicht für den Speicher, möglicherweise über Redis, die für hohe Betriebsanforderungen ausgelegt ist, um den Druck bei der Speicherzuweisung, die für Microservice-Aufrufe inhärent ist, zu mindern.

Phase 4 Verbesserung der Observability-Infrastruktur

Setzen Sie umfassende verteilte Tracing-Tools ein, die mit OpenTelemetry-Standards kompatibel sind. Diese Tools bieten Einblicke in Netzwerkverzögerungen und Dienstinteraktionsmuster und gewähren die Möglichkeit, Timeout-Fenster und Wiederholungslogik von Diensten dynamisch anzupassen, basierend auf empirischen Leistungskennzahlen.

| Herausforderung | Rechenaufwand | Netzwerklatenz (P99) | Kosten |

|---|---|---|---|

| Zustandsverwaltung | O(n log n) Komplexität | +75ms | +20% Anstieg |

| Datenkonsistenz | O(n^2) Komplexität | +120ms | +30% Anstieg |

| Bereitstellungshäufigkeit | O(1) Komplexität | +45ms | Keine signifikante Änderung |

| Service-Entdeckung | O(n) Komplexität | +60ms | +15% Anstieg |

| Fehlertoleranz | O(log n) Komplexität | +85ms | +25% Anstieg |

| Lastverteilung | O(log n) Komplexität | +100ms | +18% Anstieg |

Fazit

Die Migration von monolithischen Architekturen zu Microservices ist mit Herausforderungen behaftet. Es ist unerlässlich, dass Softwarearchitektur, Sicherheit und Infrastrukturüberlegungen gemeinsam die Migrationsstrategie beeinflussen. Jede Dimension bringt ihren eigenen Satz von Komplexitäten mit sich. Ein rigoroser, methodischer Ansatz ist erforderlich, um die inhärenten Herausforderungen zu mindern und die potenziellen Vorteile der Implementierung von Microservices zu realisieren. Ohne eine umfassende Berücksichtigung der Dynamik verteilter Systeme, kryptografischer Protokolle und Infrastrukturanforderungen riskieren Organisationen bedeutende Latenz, potenzielle Sicherheitslücken und eine beeinträchtigte Systemzuverlässigkeit.