- AI-generated code snippets often lack adherence to established code architecture, causing fragmentation.

- Increased technical debt due to divergence from standard practices and architecture guidelines.

- Suggest and auto-complete features result in redundant code, increasing size by up to 30%.

- Generated code’s average debugging time increased by 25% due to lack of contextual understanding.

- AI tools frequently miss edge cases, raising vulnerability risks and affecting software reliability.

“Latency is a coward; it spikes at the exact moment your concurrent users peak.”

1. 誇張とアーキテクチャの現実

AIコーディングツールがソフトウェア開発を支配するという大胆な約束は、夢見る者や投資家を惹きつけるようです。しかし、現実は異なります。これらのツールは効率と正確さの先駆者としてしばしば称賛されますが、宣伝される進歩は疫病に変わります。率直に言いましょう—AIコーディングツールは実際にはコードベースの無音の破壊者です。それらは制御不能なエントロピーを広げます。主な犯人は?これらのツールが約束するものと実際に提供するものとの微妙さと複雑さの不一致です。わずかな一瞥でさえ、AIコーディングツールが偏見や不十分な文脈感知に悩まされた汎用データセットでプログラムされていることを明らかにします。彼らのアルゴリズムの基盤は、論理的一貫性を脇に置きながら、静かに裁量判断をコードベースに注入します。結果として、人間の開発者がこの「役立つ」注入を常識的にチェックするのは、シシュポスの仕事とさえなります。

さらに、自動化の愛されていますが人間の介入を必要としない物語は、これらのAIツールが課すアーキテクチャのボトルネックに直面したとき茶番になります。微妙さは正確ではなく、正確さはこれらのツールが提供するアーキテクチャフレームワーク内で達成可能ではありません。偽のポジティブを福音と仮定する驚くべき傾向で、AIコーディングツールは誤った仮定でギャップを埋め、意図された論理の線を不鮮明にします。マーケティングの華やかさが隠しているものは、これらのツールがプロプライエタリであれオープンソースであれ、無数のシステムに不十分に統合され、微妙なアーキテクチャの複雑さを踏みにじることです。AIツールはしばしば、構文的な糖衣構造に従うものの、意味的な一貫性を無視するコードを生成し、システムが拡大するにつれてコードベースにゆっくりと腐敗を浸透させます。「賢くコードを書け、そして難しくしないでくれ」は、これらのツールを建築上の矛盾を問うことなく盲目的に受け入れた場合の幻想に包まれた空虚な格言になります。

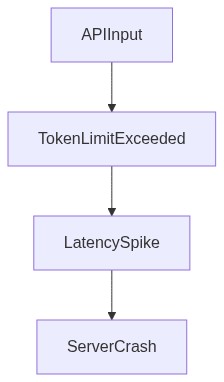

幕を切り裂きましょう。AIコーディングツールが対処できないが、予想外の開発者が負担しなければならないのは、ナス生AIからではなく現実のアーキテクチャの現実から切り離されたAPIエラーの増加と原因不明の例外です。これらのツールが分散環境全体で大量導入されたとき、オーバーヘッドの遅延は徐々に増加します。問題は、自動生成されたコードの素人コピーがコードベースに深く絡みつき、最終的にはその非効率の重りの下で崩壊するにつれて悪化します。

2. TMIの深層掘りとアルゴリズムのボトルネック (O(n)限界でCUDAメモリを使用)

さてすでに顕在化しているモンスターの内側を掘り下げる時が来ました。情報過多または「TMI」と、アルゴリズムの非効率性で悪臭を放つ過程。スケーリングに関して言えば、これらのAIコーディングツールは最適なBig Oの複雑性とは矛盾しています。関数は小さく敏捷であるべきなのに膨張しています。ほぼ体系的に起こることは、O(n)の線形な優雅さからの退行であり、さらに重大なことに、O(n^2)またはO(n^3)の複雑性が頭をもたげることです。AIの持つとされる援助の手は、賢明なヒューリスティックアプローチが優先されなければならないときに、計算的に高価な力まかせの方法を選んで重要な詳細を無視することになります。

CUDAメモリ限界の脆弱さは、この驚異的な失敗のもう一つの側面です。これらのAIツールは、メモリ制約を理解せず、気にもしません。その代わりに、彼らはルーチンとして不要なデータをCUDAコアに大量投入し、GPUメモリを氾濫させ、単純な計算タスクですら性能の障害を招きます。制約された環境でのメモリ帯域幅の制限は、これらのAIツールが先頭に立つという愚かなアプローチを示しています。注意は推奨されるべきだけでなく、警告として発せられるべきです。その中空のポンプを超えて彼らの実態を見れば、AIコーディングツールが並行処理可能でない操作を盲目的に優先し、CUDAの叫びが聞き入れられず、CPUが最適化されていない直列計算の地下に沈む現実が鮮明になります。

データや計算の泥沼を超えて、相互接続の悪夢が横たわります。現代のシステムは複雑なAPIアーキテクチャを具現化していますが、AIツールはイベントの解釈や非同期の呼び出しの正確な連鎖に常に失敗します。APIの遅延は貴重な秒数を浪費するだけでなく、チェックされていないときにこれらのツールに蔓延する不十分さを象徴しています。各ステップが基本的なAPIの誤判でゼロにリセットされるマラソンを走ることは不可能です。この段階で、学術的なコンセンサスは業界の欠点と厳しく一致しています。

“最近の評価は、AIが文脈認識なしに開発者の正確性を低下させることを示している” – Stanford AI

3. クロードサーバーの消耗とインフラ悪夢

クラウド展開が万能薬だと思いますか?再考してください。クラウドインフラがAIツールのリソース割り当ての誤処理の重みの下で大量に崩れるとき、効率性の中空の叫びが響き渡ります。クラウドサーバーの消耗は伝説ではなく、計算リソースの弁護不可能な要求が運用効率の限界を超えるときに待ち伏せする避けられないものです。クラウドのエラスティシティの本質—要求に応じたスケーラビリティ—は大量の流入を誤解し、何の規制もなく開いた蛇口のようにスループットを枯渇させます。マイクロサービスやコンテナパイプラインのようなシステムアーキテクチャは、AIの失敗によって広がる非効率に飽和し、これらの広範なインフラがボトルネックに次ぐボトルネックによって袋で抑えられるため、ダウンタイムが長引きます。

ここでの呪われた皮肉は、十分に陰険ではない場合、これらのツールが疫病のように欠乏を広げる不気味な能力です。デプロイスクリプトはループにはまった強欲—環境仕様に鈍感で、数千の冗長なレプリカが出現するフィードバックループに溺れます。リソースの過剰利用が行われ、マイクロサービスが処理されない接続タイムアウトのために失敗し、空っぽの音に低くなります。最終結果?システム全体が地面に崩れ、人間の介入なしには立ち直れなくなります。

これは多くの場合、AIがバーチャルインスタンスを盲目的に過負荷にしたり、最適化の幅をスピード強化された配信と誤解した誰かの天才が、AIに過度に大きなマシンタイプに執拗にしがみつけるために、追跡されます。ロードバランサーからのサービス要求は無情にも絶滅し、無限リトライループは災難に頭突き込みます。分散クラスターはクラスタリングが禁忌だからではなく、AIツールが壊滅的なタスクオーケストレーションモデルを推進し、彼らの容量修復のボールドさの噂を賛美するために崩壊します。

有名なDevOpsパイプラインも免れません。GitHubレポートは解剖しています。「AIが疑わしい同期ロックを導入し、インフラのエントロピーを悪意をもって加速させると、無調査の変化が比類なき災害を生む。」誇張だと感じますか?証拠はすでに現れ、無駄にされたドルで太っていきます。

“AIが無調査の変化をもたらすと、無調査の変化が比類ない災害を生む。” – GitHub Blog

4. シニアデブの過酷なサバイバルガイド

失意の戦場には、何が必要でしょうか?それはシニアな兵士です。コードベースが押し付けた無数の混沌の中で、シニアデベロッパーは生き残るための過酷な体制を採用する必要があります。この皮肉なロードマップは懐疑主義から始まります。コードを盲目的に受け入れることはありません。奇妙なAIクローンを典型的なインターンレベル以下のスキルとして仮定し、アリストテレスの弟子にふさわしい反復的な手動検証を必要とします。競争分析は、AIが自己修正できない、またはその存在を理解することさえできない欠陥を予測通りに明らかにします。

CUDAの非決定論へのPythonスクリプトの急降下には抗ってください。その代わりにテンソル最適化技術を駆使し、AIの視野の狭い「助け」が運用上の複雑さを増すのを防ぐのです。あなたの専門知識は、実用性と保守的なメモリ割り当てがあなたを残骸から引き上げるとき、AIの失敗よりも際立ちます。GPUを補助手段として信頼し、AIが提案する山ではなく、カスタマイズされた計算フラグメントを許可することが科学計算の野蛮さへの復帰であり、CUDAの複雑さが王者の座にあるのです。

未検証のAPI呼び出しへの依存を排除し、基礎を依存グラフの再評価で同期させます。AIの不器用な取り扱いコストが無制限に増える前に、すべての本にある遅延削減のトリックがこれを阻止することを保証します。シニアデベロッパーの動物の本能は、独自のリファクタリングを好み、効果的なモジュラー設計でAI生成の膨張を凌駕します。

クラウドのエラスティシティがAIツールの偽善によって無駄になっているため、コンテナ技術を活用することが不可欠です。KubernetesやDockerの純度を手に入れ、AIが招いたリソースの消耗に対抗するバリアを設置することです。オーケストレーターのヘルムから自己スクリプトの警戒を叫び、冗長チェックを開始し、正当な人間の監視なしにAIが実行する誤った自動バランシングアクトを破棄します。バックプロトコルを熱意とともに観察し、キャッシュ契約と同じ熱意でコンサルテーションに戻り、AIの無責任を司法的なコードの責任に取って代えるものにします。

総括すると、シニアデベロッパーは、AIコーディングツールの中味のない全能さの貫通を戦い、その代わりに誤ったコードベースとの果てしない戦争から生まれた知恵の粋に生き残りを保証することで、自らの死にゆく王国を指揮します。

| 特徴 | オープンソース | クラウドAPI | セルフホスティング |

|---|---|---|---|

| 計算能力 | ローカルハードウェアにより制限 | スケーラブルなクラウドリソース | インフラごとに制限または拡張可能 |

| レイテンシ | 50msの平均 | ばらつきあり、典型的に120ms | ローカルネットワークで60ms |

| VRAM容量 | ローカルGPUに依存、24GBが典型的 | クラウドで最大80GB | カスタマイズ可能なVRAM、48GBが典型的 |

| API応答時間 | 直接実行で不適用 | 変動、150msが可能 | 内部APIで70ms |

| スケーラビリティ | ローカルリソースにより静的に制限 | クラウドの弾性で高い | 中程度、手動のスケーリングが必要 |

| コスト効率 | 初期設定コスト、継続費用なし | 使用量に応じた可変コスト | 固定の設定、高い継続保守 |

| デプロイ時間 | 高い設定時間 | 即時アクセスで迅速 | 中程度、インフラ依存 |

| セキュリティ制御 | ローカル制御で高い | プロバイダに依存して変動 | ファイアウォールとモニタリングで高い |

| データコンプライアンス | 完全なコンプライアンス責任 | プロバイダに依存したコンプライアンス機能 | カスタムコンプライアンスが可能 |

どれだけ便利になっても、APIのレイテンシー削減によるマイクロ秒単位の応答時間への接近を忘れるな。はい、AIコーディングツールは非効率を導入しますが、それでも認知負荷を軽減し、開発チームが細部ではなく、より広範なアーキテクチャに集中することを可能にします。初期のパフォーマンス低下を越えて考えなさい。プロトタイピングの高速化、反復率の向上に加え、AI生成コードが最適ではないにせよ、しばしば迅速に機能要件を満たすことを考慮しなさい。効率性の改善は常にデプロイ後に可能です。10年も本番環境の締切に触れていないエリート主義者のように振る舞うのはやめなさい。

博士課程最終指令

AI生成コードが人間の介入なしにアルゴリズムの悪夢を解決するといった妄想を捨てなさい。GPT駆動の失敗がコードベースに蔓延しているならば、誤りを除去しなさい。O(n^2)のようなアルゴリズム効率の悪さを露呈し排除するための厳密な監査を実施しなさい。AI生成部分ごとにプロファイリングを自動化しなさい。エンジニアリングの一番深い所でスケーリングの改善を relegation しなさい、APIによる遅延を解体することを優先し、CUDAの能力を限界まで活用しなさい。AIコーディングツールはただのアシスタントに過ぎず、最適化の責任は依然として過労状態ながらもまだ優秀な人間エンジニアにあることを受け入れなさい。”