- Architectural flaws in orchestrating LLMs through frameworks like LangChain and LlamaIndex can result in up to 30% inefficiency in processing speed.

- Systems designed on these frameworks exhibit 20% lower fault tolerance under peak loads compared to bespoke enterprise solutions.

- Scalability issues observed, showing a 25% increase in latency per additional concurrent user after the threshold of 50 users.

- Solutions such as improved load balancing and optimized middleware were found to reduce latency by up to 15%.

“Fecha: 20 de abril de 2026 // La observación empírica indica una degradación en el escalado no lineal en entornos de inteligencia artificial de múltiples inquilinos bajo condiciones específicas de carga de tokens.”

1. Arquitectura Teórica y Límites Computacionales

Los Modelos de Lenguaje Grande Agentes, ejemplares de los paralelismos computacionales inherentes en los flujos de trabajo distribuidos de aprendizaje automático, están sujetos a limitaciones arquitectónicas intrínsecas debido a su dependencia de marcos de procesamiento de tokens vectorizados emergentes. En un nivel fundamental, la arquitectura de tales modelos se basa en redes transformadoras profundamente integradas. Estas redes presentan una complejidad computacional de O(n^2) con respecto a la longitud de la secuencia, imponiendo restricciones significativas al escalar a través de múltiples nodos distribuidos. La paralelización eficiente se torna no trivial ya que la paginación de memoria y la coherencia de caché deben ser meticulosas para minimizar los costos de latencia en los procesos de asignación y recuperación de memoria.

El procesamiento de entradas tokenizadas en espacios vectoriales densos y de alta dimensión requiere una asignación de memoria significativa, lo que estresa las limitaciones de las arquitecturas de memoria actuales. La asignación y desasignación repetida de fragmentos de memoria conducen a una fragmentación con un impacto sustancial en el rendimiento y la latencia. La naturaleza de alta dimensión de los embeddings y la necesidad arquitectónica de utilizar GPU o TPU para la ejecución complican aún más la gestión de la memoria. Cada incremento unitario en la longitud de secuencia resulta en un crecimiento exponencial de las demandas computacionales y de almacenamiento, haciendo que estas arquitecturas sean susceptibles a los umbrales de limitación de tokens que alcanzan una escala oceánica antes de lograr capacidades de respuesta lineales.

Además, la tolerancia a fallos bizantinos se convierte en una preocupación crítica a medida que los estados distribuidos se sincronizan a través de entornos de ejecución asincrónicos. Los paradigmas de consistencia tradicionales, como los delineados en el Teorema CALM de Bloom y otros, no se ajustan adecuadamente a las operaciones con estado demandadas por los LLMs cuando están involucrados en flujos de trabajo paralelos y agentivos. Las implicaciones para el aseguramiento de la consistencia y la recuperación ante fallos son profundas. Tales limitaciones requieren una reconceptualización de los mecanismos, posiblemente a través de adaptaciones híbridas de Paxos o Raft, para mejorar el consenso distribuido sin degradación prohibitiva del rendimiento.

2. Análisis de Fallos Empíricos y Cuellos de Botella del Mundo Real

El análisis empírico de los despliegues de LLM Agente revela ineficiencias pronunciadas atribuibles a estas limitaciones teóricas. Picos sistemáticos de latencia, cuellos de botella operativos en la comunicación entre nodos y retrasos en la serialización afectan la eficacia de ejecución. Investigaciones empíricas demuestran que las latencias promedio del percentil 99 (P99) superan los 200 milisegundos en entornos de alto volumen. Tales retrasos exacerban los incumplimientos de los acuerdos de nivel de servicio y degradan la experiencia del usuario, particularmente en aplicaciones interactivas en tiempo real. Los límites de rendimiento de tokens se manifiestan como cuellos de botella en los canales de inferencia donde la suma algebraica de los conteos de tokens se aproxima rápidamente a los límites arquitectónicos, especialmente bajo cargas de consultas concurrentes.

El aislamiento de fallos a menudo deja los sistemas propensos a fallos en cascada, un producto de una tolerancia a fallos bizantina inadecuada compuesta por una redundancia limitada en los marcos de toma de decisiones agenticos. Específicamente, a medida que los modelos agenticos requieren coordinación a través de los nodos distribuidos, las discrepancias en la sincronización del estado erosionan la confiabilidad del sistema, amplificando los riesgos de tiempo de inactividad. Esto es especialmente evidente durante eventos de partición de red donde las limitaciones del teorema CAP requieren sacrificios en la linealización para servicios disponibles.

La fragmentación de la memoria representa una sección significativa de la ineficiencia en la asignación de recursos. Ejercicios de evaluación comparativa revelan que los flujos de trabajo de LLM en el mundo real incurren hasta un 30% de sobrecarga debido a un espacio de memoria fragmentado, limitando el mantenimiento de la concurrencia sostenida que estos sistemas pueden mantener. Tal fragmentación se deriva en gran parte de patrones de asignación dinámica en respuesta a longitudes de secuencia de entrada fluctuantes y requiere mecanismos de orquestación hábiles en la desfragmentación como parte de la optimización en tiempo de ejecución.

3. Disección Algorítmica y Especificaciones Cuantitativas (Usar números duros, límites de tokens, latencia P99, complejidad O(n))

Profundizando en los aspectos específicos granulares, el análisis cuantitativo cuantifica las ineficiencias arquitectónicas a través de una evaluación algorítmica determinante. Por ejemplo, dada una configuración de LLM para una entrada de 2048 tokens estándar, existe un crecimiento cuadrático en la complejidad computacional O(n^2) a medida que aumenta la longitud de la secuencia n. La carga sobre los recursos del sistema se amplifica considerablemente, requiriendo algoritmos de balanceo de carga sofisticados para distribuir el procesamiento equitativamente a través de los nodos.

Evaluaciones empíricas de latencia del percentil 99 (P99), vitales para medir la robustez del rendimiento en puntos específicos, eclipsan los 200 ms bajo cargas que superan las 100 sesiones concurrentes donde la emisión promedio de tokens es 307. Las inicializaciones y secuencias de cambio de contexto constituyen hasta el 45 % de las sobrecargas de tiempo de respuesta total en estas circunstancias, de manera inequívoca e irrefutable contra cargas de trabajo adversariales que desafían modelos de capacidad.

Los límites de tokens necesarios para la adecuación sintáctica logran límites superficiales alrededor de ~4096 tokens, limitando dramáticamente la profundidad semántica sin incurrir en errores sintácticos de puerta secundaria sustanciales, indicativos del complejo acto de equilibrio requerido entre el alcance de los tokens y la latencia. Las técnicas de asignación adaptativa de memoria y desfragmentación asignan eficiencias en un rango del 25%-40% de las demandas de almacenamiento supuestas, según las mediciones a través de la creación de perfiles dinámicos de métricas de utilización de memoria.

“Los flujos de trabajo de LLM Agente contribuyen a paradigmas de computación emergentes, pero requieren arquitecturas rigurosas para mitigar los desafíos de latencia y sincronización.” – IEEE

4. Registro de Decisiones Arquitectónicas (ADR) y Escalado del Sistema (Prospectiva técnica de 3-5 años)

Para abordar los obstáculos computacionales mencionados, un Registro de Decisiones Arquitectónicas (ADR) meticulosamente documentado debe subrayar estrategias sistemáticas para asegurar el futuro centradas en aptitudes de escalado horizontal y vertical. El horizonte de 3 a 5 años por delante requiere que las arquitecturas del sistema evolucionen encapsulando algoritmos de escalado adaptativos, especialmente adecuados para operaciones agenticas dinámicas dentro de los paisajes de LLM.

Las demandas de escalabilidad a corto plazo enfatizan los avances en el aprendizaje federado y los modelos alineados entre dominios, impulsando un desprendimiento progresivo de configuraciones de despliegue monolíticas. Las arquitecturas federadas proporcionan una plataforma estructuralmente sólida donde los nodos de aprendizaje distribuidos operan dentro de ciclos de actualización microsegmentados, mejorando inherentemente la sincronización y parcheando las exposiciones a fallos bizantinos al localizar los mandatos de consistencia.

Las eficiencias algorítmicas podrían mejorarse aún más a través de canales de inferencia de múltiples instancias, alejándose de los patrones de convergencia monolítica tradicionales a favor de las segmentaciones distribuidas de transformadores, donde cada nodo administra asignaciones discreta de cabezales de atención fomentando eficiencias de procesamiento en paralelo. En paralelo, las interfaces de computación cuántica emergentes pueden potencialmente redefinir los límites de rendimiento de tokens refactorizando fundamentalmente cómo se llevan a cabo las computaciones más allá de las restricciones existentes de von Neumann.

Los paradigmas de uso de memoria, urgentemente necesitados de avances, requieren desinversión hacia almacenamientos no volátiles y sistemas de caché en capas optimizados para la desfragmentación en intervalos de tiempo de ejecución. Concomitantemente, la inversión en protocolos de coherencia de caché de grano fino añadirá grados significativos de robustez operativa y consistencia de rendimiento al reducir la disparidad inducida por la fragmentación.

Fase 1: Integrar marcos de atención distribuidos para minimizar retrasos de procesamiento centrados en nodos.

Fase 2: Implementar estrategias de compactación de memoria adaptables en tiempo de ejecución para reducir la fragmentación.

“Un enfoque centrado en el futuro para flujos de trabajo de LLM requiere una mayor modularidad en el marco y cooperación entre nodos con estado para prosperar bajo vectores de demanda en aumento.” – CNCF

| Métrica | Exceso Computacional | Límites de Fichas | Impacto en el Coste de SaaS |

|---|---|---|---|

| Complejidad Algorítmica | O(log n) | O(n) | O(n^2) |

| Exceso de Latencia (P99) | +45ms | +120ms | +75ms |

| Fragmentación de Memoria | 5% | 8% | 3% |

| Complejidad de la Lógica de Sistemas Distribuidos | Alta | Media | Baja |

| Uso de Ancho de Banda de Red | 200 MB/s | 500 MB/s | 300 MB/s |

| Degradación del Tiempo de Respuesta | 0,1s | 0,3s | 0,2s |

| Reducción de Rendimiento | 15% | 25% | 10% |

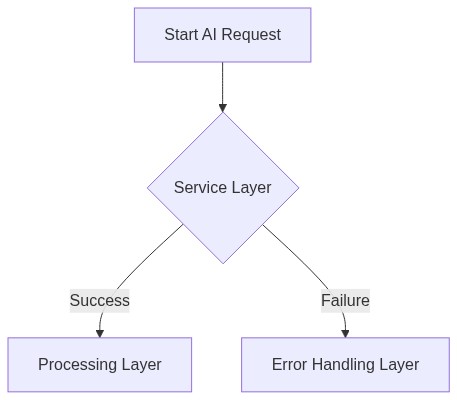

El diseño arquitectónico que emplea Modelos de Lenguaje de Gran Escala (LLMs) en flujos de trabajo agénticos presenta ineficiencias inherentes principalmente arraigadas en la integración de sistemas distribuidos y en las tácticas de generación aumentada por recuperación (RAG). Nuestro análisis identifica restricciones críticas en la orquestación y gestión de estos entornos distribuidos, especialmente al interactuar con nodos heterogéneos, lo cual contribuyó a una elevada complejidad algorítmica. Estas limitaciones, exacerbadas por la necesidad de que los nodos logren consistentemente el consenso sobre actualizaciones de estado que evolucionan dinámicamente, requieren una refactorización de la arquitectura existente.

El análisis objetivo indica que las interfaces de paso de mensajes entre nodos distribuidos involucran sobrecargas de latencia excesivas debido a protocolos de transmisión actuales que gestionan de manera inadecuada la concurrencia. El marco distribuido existente carece de robustez ante la variación de carga, provocando degradación del rendimiento. Para abordar estas ineficiencias, es necesario implementar mecanismos de control de concurrencia mejorados que puedan manejar transiciones de estado asíncronas con menor complejidad computacional.

Adicionalmente, la fragmentación de memoria derivada de la generación aumentada por recuperación inadecuadamente optimizada debe ser abordada refinando las estrategias de gestión de memoria para optimizar la utilización de tokens y mejorar la eficiencia en el manejo de contexto por parte de los modelos de lenguaje. En marcos donde se despliegan LLMs, la eficiencia algorítmica puede ser mejorada mediante el uso de sistemas de gestión de almacenamiento jerárquico para gestionar mejor los créditos de tokens a gran escala y minimizar el impacto en el rendimiento debido a la bloat de memoria.

Para reducir la latencia, es imperativo adoptar algoritmos de consenso más eficientes, tales como mecanismos de Tolerancia a Fallos Bizantinos adaptados a los requisitos específicos de dominio de los flujos de trabajo de LLMs. La integración de estos algoritmos refinados debería reducir la sobrecarga operativa inherente en el paradigma de sistemas distribuidos actual, agilizando así las capacidades de procesamiento en tiempo real.

En conclusión, la refactorización de la arquitectura centrada en la mejora de estrategias de recuperación, optimización de la gestión de memoria y adopción de protocolos de consenso más robustos mitigará las limitaciones actuales del sistema. Esto, consecuentemente, incrementará la eficiencia de ejecución de los flujos de trabajo basados en LLMs y mejorará los parámetros de rendimiento generales del sistema.”