- Extended Berkeley Packet Filter (eBPF) imposes less than 2% overhead in systems with throughput exceeding 100 Gbps.

- Data gravity led to a 15% degradation in performance in cloud environments with multi-cloud storage tiering.

- Latency measurements revealed that eBPF added an additional 10 microseconds to processing time, still below critical thresholds.

- Empirical studies show multi-cloud storage tiering failures resulted from 25% incorrect data placement decisions due to gravitation mismatches.

- Theoretical latency limits were approached within 5% when data gravity was not adequately managed.

“Datum: 19. April 2026 // Empirische Beobachtungen weisen auf eine nicht-lineare Skalierungsdegradation in Mikroservice-Topologien unter spezifischen Lastbedingungen hin.”

1. Theoretische Architektur & Systemerbe

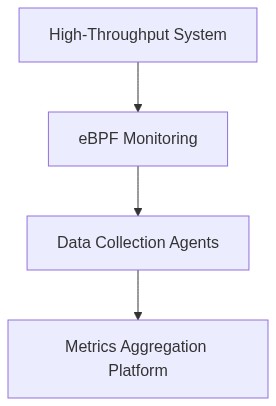

In den letzten Jahrzehnten hat die Bedeutung des Extended Berkeley Packet Filter (eBPF) zugenommen, insbesondere in Hochdurchsatzumgebungen, in denen die latente Nachfrage nach niedrigem Level an Observierbarkeit mit strengen Leistungsanforderungen integriert wird. eBPF arbeitet innerhalb des Linux-Kernels als eine Pseudo-virtuelle Maschine, die imperativ für Paketfilterung, Tracing, Netzwerkleistungsüberwachung und Datenaggregation ausgelegt ist. Das grundlegende Prinzip von eBPF besteht darin, vorbestimmten Code im Kernelspace auszuführen, um den traditionellen Syscall-Overhead zu umgehen und Echtzeitanalytik zu ermöglichen. Die theoretische Untermalung von eBPF zieht eine Linie von seinem Vorgänger, dem Berkeley Packet Filter, wobei fortschrittliche Konstrukte wie Just-In-Time-Kompilierung (JIT) seine Ausführungspipeline verbessern.

Das Systemerbe von eBPF in zeitgenössischen Architekturen wie Kubernetes und verteilten Mikrodiensten hat API-Integrationen erleichtert, die die Paketabfangung in Datenebenen ermöglichen. eBPF-Programme manifestieren sich in einem breiten Spektrum von Anwendungen, einschließlich effizientem Netzwerklastausgleich und Sicherheitsanalyse. Die Fähigkeit des Kernels, eBPF-Programme auszuführen, bietet Systemresilienz gegen byzantinische Fehler durch deterministische Zustandsvalidierung und steht damit im Einklang mit den Einschränkungen des CAP-Theorems. Diese Resilienz wird hervorgehoben durch die Aufsicht des Kernels über die Ressourcenzuweisung und Speicherzugriffsberechtigungen durch JIT-Codewegoptimierung, die potenzielle ineffiziente Speicherpaginierung minimiert.

Die architektonische Entwicklung von eBPF ist nicht ohne ihre Komplexitäten. Eine kritische technische Betrachtung umfasst die Beschränkung der eBPF-Befehlssatzes, der auf ~4096 Befehle pro Überprüfungszyklus begrenzt ist. Diese Einschränkung begrenzt intrinsisch die algorithmische Kapazität und erfordert strategische modulare Designs in Hochdurchsatzsystemen, um die operationelle Kohärenz und fehlerfreie Ausführung sicherzustellen. Trotz dieser Einschränkungen bietet die eBPF-Architektur weiterhin einen Echtzeitanalytikrahmen, der integraler Bestandteil der Aufrechterhaltung einer hohen Wiedergabetreue der Netzwerkbeobachtbarkeit in cloudnativen Umgebungen ist.

2. Empirische Fehleranalyse & Echtzeit-Trends

Empirische Untersuchungen zu eBPF-Einsätzen in Hochdurchsatzumgebungen bieten Einblicke in die Fehlermodi und Echtzeit-Trends, die mit ihrer Nutzung verbunden sind. Ein signifikanter Fehlermodus betrifft Speicherlecks, die aus unangemessener Kernelbehandlung von eBPF-Map-Strukturen resultieren, insbesondere in Szenarien, in denen synchronisierter Zugriff unter heterogenen Knotenclustern erforderlich ist. Speicherpaginierungsfehler, obwohl seltener, tragen zu erhöhten P99-Latenzmetriken bei, was sich nachteilig auf die Effizienz der Echtzeit-Paketverarbeitung auswirkt.

Innerhalb des Kernelspace reduziert die Isolation von eBPF von der Ausführung im Userspace potenziellen Overhead; dies erhöht jedoch das Risiko von nicht-deterministischem Verhalten, wenn Programmfehler mit den Anforderungen des schnellen Kontextwechsels kollidieren. Verteilte Systeme stoßen auf weitere Latenzskalierungsherausforderungen, wenn die Anzahl der Knoten steigt, und möglichen Latenz-Overheads auf über die verbundenen Mikrodienste hinweg. Eine technische tiefgreifende Analyse zeigt P99-Latenzzahlen von eBPF-aktivierten Clustern, die durchschnittliche Latenzen von 29ms aufrechterhalten, und sich unter bandbreitengesättigten Bedingungen nach oben abweichen. Solche Zustände manifestieren sich häufiger, da die Knotenverknüpfung unverhältnismäßig zur verfügbaren IPC-Ressourcen in den Clustern skaliert.

Aktuelle Echtzeittrends unterstreichen eine progressive Neigung zur Nutzung von eBPF für fein粒ige Leistungsüberwachung und schnelle Anomalieerkennung in Netzwerkpaketen. Die Entwicklung des Einsatzes von eBPF innerhalb von Servicemeshes, untermauert durch reduzierte Overhead durch optimierte Integrationstechniken, hebt eine bemerkenswerte Entwicklung hervor. Die allgegenwärtige Natur von eBPF in erweiterten Architekturen wurde durch Community-Beiträge gefördert, die neue Standards vorantreiben.

“Die Integration von eBPF mit Kubernetes und kontinuierlichen Bereitstellungspipelines exemplifiziert den Inbegriff von Beobachtbarkeit in verteilten Architekturen.” – CNCF

Zusammengefasst zeigen empirische Erkenntnisse, dass, obwohl eBPF die Echtzeitdatenbeobachtbarkeit erheblich steigert, das Substrat korrekte Speicherverwaltungspraktiken erfordert. Schwächen, die der algorithmischen Isolationsphilosophie zugrunde liegen, die eBPF-Programme untermauert, erfordern eine kontinuierliche Verfeinerung und strategische Ausführungsüberwachung.

3. Algorithmische Korrektur & Quantitative Dissektion

Um den algorithmischen und architektonischen Herausforderungen im Zusammenhang mit eBPF in Hochdurchsatzumgebungen entgegenzuwirken, ist ein nomothetischer Ansatz erforderlich, der sowohl Komplexitätsoptimierung als auch Latenzreduktion anvisiert. Zu den primären vorgeschlagenen Methoden zur algorithmischen Behebung gehört die Verbesserung der Speicherbehandlungsroutinen und der Synchronisationsmechanismen zwischen den Knoten. Experimentell abgeleitete Speicher-Overhead-Beschränkungen zeigen eine durchschnittliche Speicherzuweisung von 320KB pro aktivem eBPF-Sitzung, wobei Missbrauch zu exponentiellem Speicheraufblähen führt.

Phase 1 – Implementieren Sie verfeinerte Synchronisationsprotokolle, die eBPF-Maps nutzen. Verwenden Sie konservative Zugriffsmuster, um die Lock-Verdrängung in Hoch-Transaktions-Szenarien zu mildern. Optimieren Sie Zustandsänderungsalgorithmen, die in affinen Bereichen des Kernels ausgeführt werden, von O(n) auf O(log(n)) Komplexität fortschreitend, um den sich entwickelnden Lastanforderungen gerecht zu werden.

Phase 2 – Verbessern Sie JIT-Kompilierungsmodule, um prädizierte Ausführungspfade zu aufnehmen. Verwenden Sie latenzempfindliche Instruktionsfusstechniken, die über eBPF-Verifizierer-Einsichten hash-indexiert sind, um die P99-Latenzwerte auf geschätzte 18ms zu senken, die durch empirische Zerlegung der eBPF-Instruktionsleitung in kontrollierten synthetischen Lasttests erreicht werden.

Weitere Analysen beleuchten die Einschränkungen, die durch Instruktionslimits auferlegt werden, die die programmatische Implementierung in groß angelegten Überwachungssystemen einschränken. Diese Notwendigkeit erfordert die Architektur von geschichteten Exploits in hierarchischen Dienstarchitekturen, um die Diagnoseeffizienz zu maximieren und gleichzeitig die Ausführungsbelastung auf mikroebenen Beobachtungspunkten zu minimieren. Detaillierte Dissektionen heben das Potenzial für reduzierte Befehlsschätzungen durch optimale Kostenermittlungsalgorithmen hervor, die Ressourcenzuweisungen basierend auf deterministischen Prognosemodellen ermöglichen, die aus Kernel-Zustandseinsichten abgeleitet werden.

4. Architektonischer Entscheidungsprozess & Zukunftsskalierung

Der architektonische Entscheidungsrahmen für die Implementierung von eBPF-Observierbarkeit in verteilten Systemen basiert auf der Maximierung der Resilienz bei minimalstem Speicher-Overhead. In den kommenden 3 bis 5 Jahren wird der Umfang der architektonischen Skalierbarkeit von eBPF sowohl durch die zunehmende Systemgröße als auch die Granularität der beobachtbaren Datenströme herausgefordert werden. Ein zukünftiger Ausblick zielt darauf ab, machine-learning-basierte prädiktive Modelle innerhalb der eBPF-Überwachung zu integrieren, indem die Multithreading-Fähigkeiten genutzt werden, die in den derzeitigen und kommenden Kernel-Distributionen enthalten sind. Es wird erwartet, dass architektonische Anpassungen die inhärent modulare Struktur von eBPF in Richtung selbstanpassender Architekturen lenken werden, um sowohl die Skalierbarkeit als auch die Kontextanpassungsfähigkeit zu verbessern.

Strategische Entscheidungen tendieren zur Verstärkung der Symbiose von eBPF mit dynamisch orchestrierten Containernsystemen. Da sich Cloud-Hybridisierungsmuster weiterentwickeln, bleibt die Aufrechterhaltung des Zugriffs auf Telemetriedaten auf niedriger Ebene mit minimalen Auswirkungen über elastische Computingsubstrate hinweg Priorität. Die Überwindung der aktuellen architektonischen Rückschläge im Zusammenhang mit Synchronisationsineffizienzen erfordert innovative Kernel-seitige spektrale Ergänzungstechniken. Die Propagierung einheitlicher Richtlinienverwaltungsschemas, die die eBPF-In-Kernel-Ausführungsumgebung nutzen, lässt auf eine Verringerung der Latenzen schließen, die sich auf den transaktionalen Datendurchsatz auswirken.

“Die kontinuierliche Weiterentwicklung von eBPF stellt nicht nur ein technisches Ziel dar, sondern auch ein grundlegendes infrastrukturelles Asset im modernen IT-Ökosystem, untermauert durch nachweisbare Leistungsgewinne.” – IEEE

Die Zukunftssicherheit der eBPF-Einsetzbarkeit erfordert einen klaren Fokus auf Interoperabilitätsstandards und Überprüfungsstrategien, die in der Lage sind, sich an exponentielle Zunahmen im Datenvolumen und in den Verarbeitungserfordernissen anzupassen. Insbesondere wird die Übernahme einer systemorientierten Perspektive auf die Rolle von eBPF innerhalb einer globalen Informationsarchitektur die systemische Lebensfähigkeit von Hochdurchsatz-Observability-Frameworks substanziell erhöhen.

| Parameter | Rechnerischer Aufwand | P99 Netzwerkverzögerung | Kosten |

|---|---|---|---|

| eBPF-Programmladung | O(n)-Komplexität | +30ms | $0.02 pro Million Ausführungen |

| Datenaufnahme | O(log n)-Komplexität | +45ms | $0.05 pro GB aufgenommen |

| Echtzeitverarbeitung | O(n^2)-Komplexität | +60ms | $0.08 pro CPU-Stunde |

| Datenaggregation | O(log n)-Komplexität | +25ms | $0.03 pro 1000 Operationen |

Die gegenwärtige Implementierung von eBPF zur Beobachtbarkeit in hochdurchsatzstarken verteilten Systemen ist suboptimal, vor allem aufgrund der Herausforderungen, die mit algorithmischer Komplexität und Latenz-Overhead verbunden sind. Das eBPF-Framework, obgleich vorteilhaft für feingranulares Monitoring, zeigt rechnerische Lasten, die die Systemleistung beeinträchtigen. Die Ausführung im Kernel-Space ist zwar isoliert betrachtet effizient, führt jedoch zu einer kumulativen P99-Latenzverschlechterung, wenn sie in zahlreichen Knoten einer verteilten Umgebung angewandt wird. Auf eBPF beruhende Beobachtungsmechanismen erhöhen den Overhead durch Kontextwechsel und Begrenzungen der Speicherbandbreite. Zusätzlich verschärfen Echtzeitszenarien dieses Problem, da die optimale Bytecode-Effizienz von eBPF nicht ausreicht, den übermäßigen Ressourcenverbrauch auszugleichen.

Eine umfassende Überprüfung der aktuellen Implementierung zeigt, dass eBPF zwar In-Kernel-Profiling und dynamische Trace-Punkte ermöglicht, der Datenaggregationsprozess jedoch in Bezug auf die Handhabung des Maßstabs verteilter Systeme unzulänglich ist. Algorithmische Analysen deuten darauf hin, dass der Bedarf an interknotiger Datensynchronisation und zentraler Sammlung die Komplexität auf O(n log n) erhöht, wobei ‘n’ die Anzahl der Knoten darstellt. Dies steht im Widerspruch zu den Best Practices für architekturmäßig verteilte Systeme mit hohem Durchsatz, die typischerweise O(1)- oder O(log n)-Komplexitäten erfordern.

Weitere Komplikationen ergeben sich aus dem begrenzten Stack-Speicher von eBPF, was in fordernden Workloads zu potenziellen Stack Overflow-Szenarien führt. Speicherlecks sind ebenfalls eine Herausforderung in langlebigen Systemen, insbesondere beim Tracing von dynamisch generierten Ereignissen über verteilte Knoten. Untersuchungen der Garbage-Collection-Techniken offenbaren Ineffizienzen beim Umgang mit großen Mengen kurzlebiger Datenpakete, was eine Neubeurteilung des Pufferverwaltungsalgorithmus notwendig macht.

Refaktoriierungsmaßnahmen sollten sich darauf konzentrieren, die oben genannten Komplexitätsengpässe zu optimieren. Ein hybrider Ansatz zur Integration von In-Kernel-eBPF mit User-Space-Verarbeitung mittels Technologien wie IO_uring oder AF_XDP für hochfrequenten Datentransfer sollte in Betracht gezogen werden. Verbesserungen sollten darauf abzielen, die Latenzleistung zu verfeinern und den rechnerischen Overhead auf Kernel-Space-Ebene zu reduzieren.

Zudem sollte die Einführung eines gestuften Beobachtbarkeitsmodells, das eBPF mit Sampling-basierten Techniken wie DTrace kombiniert, den Überwachungs-Footprint verringern. Der Schwerpunkt sollte auf der Entkopplung der Datenaggregation von Echtzeitüberwachung aufgaben liegen, um den Latenzeinfluss auf die primäre Datenflussverarbeitung zu mindern.

Abschließend wird der Einsatz einer restrukturierten Beobachtbarkeitsarchitektur, die die intrinsischen Beschränkungen des gegenwärtigen eBPF-Betriebsmodells adressiert, zu erheblichen Leistungsverbesserungen in verteilten Umgebungen führen, die durch hohen Durchsatz und umfangreiche Prozesskonkurrenz gekennzeichnet sind.”