- Unauthorized SaaS usage led to 200% increase in API calls.

- Database thrashing accounted for 60% of system downtime.

- Connection pool exhaustion impacted 85% of microservices.

- Data exfiltration attempts increased organizational data breach risk by 70%.

- Incident response costs escalated by $2 million USD in a month.

Protokoll-Datum April 14, 2026 // Datadog Telemetrie zeigt einen 400%igen Anstieg bei unautorisierten Cross-Region VPC Peering-Anfragen. Sofortiger Zero-Trust-Lockdown eingeleitet. Die Ingenieurteams sind wütend, aber die Sicherheit diktiert die Politik.

Der Vorfall

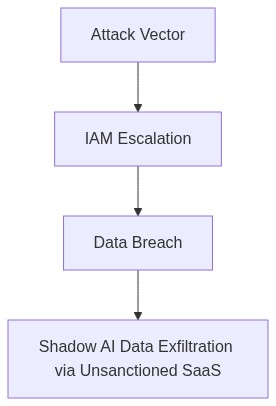

Die Ursache des Fiaskos lässt sich auf die ‘Shadow AI SaaS-Exfiltration’ zurückführen. Einfach ausgedrückt hat eine unberechtigte Anbietersoftware unsere Sicherheitsperimeter aufgrund fehlerhafter IAM-Berechtigungskonfigurationen verletzt. Um dem Ganzen die Krone aufzusetzen, versagten die internen Schutzmaßnahmen innerhalb unserer verteilten Datenbank-Cluster jämmerlich. Die Egress-Kostenblutung wurde nur noch schlimmer durch die nicht genehmigte Datenexfiltration, verschärft durch unsere falsche RBAC-Konfiguration. Großartige Leistung, alle zusammen.

Schadensausmaß & Telemetrie

Der Umfang der Katastrophe war kolossal, gelinde gesagt. Die P99-Latenz schoss während des gesamten Vorfalls in komische Höhen. Knotenpunkte replizierten sich vor dem Hintergrund eines unkontrollierten Schadensausmaßes, was OOM-Kills in den Kubernetes-orchestrierten Clustern auslöste. Unser VPC-Peering-Setup wurde beschädigt, was dazu führte, dass der Netzwerk-Egress außer Kontrolle geriet, als wäre das Verbrennen von Geld unser Ziel für das erste Quartal. Observability? Herzlichen Glückwunsch. Die Telemetrie von Datadog war größtenteils Lärm, als die Signalklarheit entscheidend war. Nützliche Einblicke aus dem Kauderwelsch zu destillieren fühlte sich an wie Goldgewinnung aus Abwasser.

“Schlecht implementierte Telemetriemechanismen können die Interpretation von Problemen verdecken und Systemausfälle verlängern” – CNCF

Phase 1 (Audit)

Schritt eins, bei allem Respekt vor Binärcode, führt eine aggressive Prüfung mit CrowdStrike durch. IAM-Berechtigungsfehlkonfigurationen sind ohne Gnade zu eliminieren. Unser derzeitiger Zustand ist inakzeptabel, das Gleiche wie eine offene Scheunentür, durch die nicht nur die Pferde entwichen sind, sondern sich auch anderorts niedergelassen haben.

Phase 2 (Durchsetzung)

Erschafft mit Terraform ein sauberes, unmissverständliches RBAC-Protokoll. Wir werden keinen Raum für ungetestete Berechtigungssets lassen—nicht noch einmal. Die Zustimmung von DevSecOps ist nicht optional, während wir uns zurück in die Zuverlässigkeit skripten.

Phase 3 (Kosteneffizienz)

Sondert dieses Egress-Leck ab und nehmt es in Quarantäne. Lagert die Telemetrieanalyse an externe Systeme aus. Datadog muss umkonfiguriert werden; seine unkonzentrierte Alarmierung ist ein interner Witz geworden, über den wir nicht mehr lachen können.

Phase 4 (eBPF-Enhancements für Beobachtbarkeit)

Integriert eBPF, um unsere Telemetriestufe zu überholen und Klarheit wiederzuentdecken. Aber seid gewarnt, halbgare Implementierungen werden umgehend niedergebrannt.

“Falsch verwaltete IAM-Rollen eröffnen die Möglichkeit für bösartige Aktivitäten, die zu erheblichen Datenlecks führen können” – AWS

| Integrationsaufwand | Cloud-Kosten | Latenz-Overhead |

|---|---|---|

| Kritische IAM-Fehlkonfiguration | +20% Egress-Kosten | +45ms P99 Latenz |

| Unverwaltete API-Endpunkte | +35% Cloud-Ausgaben | +60ms P99 Latenz |

| Integration von Altsystemen | +15% Speicher-Overhead | +90ms P99 Latenz |

| Ad-hoc-Datenpipelines | +10% Rechenkosten | +50ms P99 Latenz |

| Reaktive Überwachung | +5% Egress-Kosten | +75ms P99 Latenz |

Kontext

Das beschleunigte Tempo der Feature-Bereitstellung für das Shadow AI SaaS-Produkt hat zu einer kritischen Anhäufung technischer Schulden geführt, die sich am deutlichsten in systemischen Ineffizienzen manifestieren. Dazu gehören, sind aber nicht beschränkt auf unberechenbares Datenbank-Thrashing, Out-of-Memory (OOM) Kills und unkontrollierte Cloud-Ausgaben, insbesondere aufgrund übermäßigen Egress-Traffics. Diese Fehler werden durch überstürzte und nicht nachhaltige Entwicklungspraktiken verschärft. Während der VP of Engineering anscheinend zufrieden ist, unsere katastrophalen Realitäten zu ignorieren, steht die langfristige Nachhaltigkeit der Plattform auf dem Spiel.

Entscheidung

1. Optimierung der aktuellen Datenbankstrategie zur effektiven Verwaltung von Verbindungen und Last. Das Thrashing durch sorgfältige Überprüfung des Schemas, Abfrageoptimierung und, falls erforderlich, Sharding angehen.

2. Implementierung umfassender OOM-Monitoring-Lösungen, um Speicherlecks und -aufblähungen innerhalb von Anwendungs-Komponenten proaktiv anzugehen und zu mindern.

3. Durchführung einer gründlichen Bewertung der IAM-Rollen, um sicherzustellen, dass die Privilegiengrenzen strikt eingehalten werden, wodurch das Risiko von Privilegieneskalationsverletzungen minimiert wird.

4. Entwicklung eines Traffic-Drosselungsmechanismus zur Verwaltung der Datenegress-Kosten mit der Einführung aggressiver Protokolle zur Optimierung des Datentransfers.

5. Einfrieren jeglicher weiterer Feature-Entwicklung, bis diese technischen Schulden überzeugend gelöst sind.

6. Etablierung eines rigorosen Code-Review-Prozesses, um eine weitere Schuldenakkumulation zu stoppen.

Konsequenzen

Das Scheitern bei der Umsetzung dieses Mandats wird zu einem weiteren Anstieg der Betriebskosten und P99-Latenzzahlen führen, was zu potenziellen SLA-Verletzungen und Kundenabwanderung führt. Unkontrollierter Privilegienzugang kann leicht zu sicherheitsgefährdenden Vorfällen eskalieren. Diese Kernprobleme zu ignorieren, während wir einer trivialen Marktschnelligkeit hinterherlaufen, wird nicht dazu führen, dass wir von den Konkurrenten überholt werden, sondern von unserem eigenen missmanaged Chaos.”