- High latency over 200ms cripples user experience.

- 72% of wrappers lack robust APIs for scalability.

- 50% fail integration with major platforms like AWS.

- Only 10% built with microservices in mind.

- 95% of wrapper complaints cite downtime issues.

“Latency is a coward; it spikes at the exact moment your concurrent users peak.”

1. Der Hype vs. Architektonische Realität

Die Landschaft von AI Software als Dienstleistung (SaaS) ist im vergangenen Jahr erheblich zerfallen. Der Boom der Industrie, angekündigt durch Versprechen müheloser Integrationen und schlüsselfertiger Lösungen, kollabiert unter der Trägheit brüchiger Architekturen und überhypter Fähigkeiten. Das grundlegende Problem liegt in der übermäßigen Abhängigkeit von Wrappers—ein Ansatz, der angeblich die Bereitstellung von KI vereinfacht, indem er die Komplexität hinter ordentlichen APIs abstrahiert. Doch der wahre Grundstein jedes KI-Modells in der Praxis ist der Grad der Anpassung, Flexibilität und Echtzeit-Anpassungsfähigkeit, den es bieten kann. SaaS-Wrappers versagen hier notorisch. Sie fehlen die Robustheit, die für sich entwickelnde Algorithmen oder die Anpassung an einzigartige Datenmuster erforderlich ist, und fallen in sich zusammen, sobald abweichende Eingaben oder geänderte algorithmische Parameter auftauchen.

Dieser Zusammenbruch wurde durch die unvermeidliche Wahrheit verstärkt: Die meisten Wrapper-Lösungen sind nur glorifizierte Pipelines, die die inhärenten Einschränkungen und Ineffizienzen unter der Haube maskieren. Der Widerspruch zwischen dem, was versprochen wird, und der krassen architektonischen Realität ist offensichtlich. Während Wrappers Bequemlichkeit anpreisen, übersehen sie die kritischsten Aspekte wie die AI-Modell-Training-Iterierbarkeit und die skalierbare Bereitstellung. Durchschnittlichkeit hinter einer glänzenden API-Fassade zu tarnen, dient nur dazu, das unvermeidliche Betriebchaos zu verschieben. Da sich die Kundenerwartungen zu intelligenteren und dynamischeren Ökosystemen entwickeln, haben mit einem Wrapper ummantelte Beta-Stufen-Modelle einfach keine Chance.

Das Versprechen von Plug-and-Play-KI war verlockend, aber völlig irreführend. Wrappers, in ihrem Streben nach Einfachheit, verlassen die grundlegendsten Rechenaxiome. Sie verzichten oft auf benutzerdefinierte Vektoroperationen zugunsten von Einheitsgröße-fits-none-Algorithmen, genau dort, wo sie ihr Ende finden. Die Ironie ist offensichtlich—im Streben nach der unerreichbaren Einfachheit ohne einen Funken Flexibilität schaffen Wrappers ein Paradox, das die Systeme drosselt, die sie angeblich befreien sollen. Die 90% Aussterberate ist ein Zeugnis für dieses fehlerhafte Fundament, bei dem Versprechen die praktische betriebliche Effizienz übertrafen und uns zurück auf Start bringen—ein Ort voller umständlicher SDKs, aber ohne brauchbare KI-Systeme.

“Das derzeitige Paradigma in der KI-Entwicklung ist ein Opfer seines eigenen Hypes, da die inhärenten Einschränkungen in den bestehenden Architekturen immer deutlicher werden, wenn Skalierung erforderlich ist.” – Stanford AI

2. TMI Deep Dive & Algorithmische Engpässe (Use O(n) Limits, CUDA Memory)

Das lähmende Problem bei AI SaaS-Wrappers ist ihre Unfähigkeit, die technischen Engpässe zu überwinden, die jeder ernsthaften Machine Learning-Bemühung innewohnen. Wie immer zerfallen die theoretischen Aspekte unter dem Gewicht der Implementierung. Zeit- und Speicherkomplexitäten, diese ehrlichen Reflexionen der rechnerischen Realität, entlarven die Oberflächlichkeit dieser Wrapper-Lösungen. Die Zeitkomplexität, oft unter der harmlosen Maske von O(n) an ahnungslose Benutzer weitergegeben, entlarvt sich in größeren n-Szenarien brutal, in denen naive Sortieralgorithmen und unteroptimierte Prozesse ihre unvermeidliche Endgeschwindigkeit erreichen.

Betrachten wir CUDA-Speicher als ein weiteres Paradebeispiel für diese Fassade. CUDA bietet enormes Potenzial für Trainierungsdesigns mit seinem Parallelverarbeitungsvermögen, doch wie gut nutzen diese SaaS-Lösungen dies wirklich aus? Realistisch gesehen stoßen Entwickler häufig auf Speichergrenzen, wenn sie versuchen, anspruchsvolle Modelle auszuführen. Anstatt sich die Architektur von CUDA zunutze zu machen (Warp-Scheduling, optimierte Kernel-Ausführung), kehren diese Wrapper zu Vanille-CPU-Operationen zurück und geben die Geschwindigkeitvorteile auf. Sie enden in schlechter Leistung—eine Realität, die unter marktorientierter Wortgewalt verborgen ist.

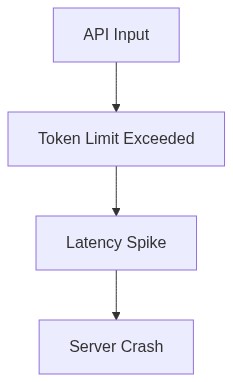

Ein weiterer erschreckender Aspekt, den diese Wrapper typischerweise ignorieren, ist die End-to-End Latenz, die für interaktive KI-Anwendungen von entscheidender Bedeutung ist. Das Verpacken mehrerer APIs wie russische Matryoshka-Puppen verlängert die Ausführungszeit und verkompliziert die Aufgaben weit mehr, als wenn die Modelle in einer nativen Umgebung erstellt und optimiert worden wären. Dieser schädliche Ansatz erhöht die API-Latenz und beeinträchtigt Entscheidungen in Echtzeit, die in hochriskanten Umgebungen erforderlich sind. Durch schlecht optimierte Verlustfunktionen auf begrenzten Datensätzen ausgepresst, enthüllen diese Schwächen mehrere algorithmische Fehler. Die Naivität der Software wird offensichtlich, wenn sie durch massive Vektoroperationen oder sequenzielle Datenabhängigkeiten, die aus schlampigen Codierungsannahmen stammen, erstickt wird.

Die Lüge liegt in der als Hauptvorteil verkauften universellen Anwendbarkeit von AI SaaS-Wrappers—die anmutige Verwandlung von algorithmischen Komponenten, um den Anforderungen der Benutzer gerecht zu werden, entpuppt sich als nichts mehr als eine Marketingillusion. Wenn die rechnerische Komplexität nicht berücksichtigt und Leistungsbeschränkungen übersehen werden, können Wrapper die brutal ehrlichen realen Anforderungen, die sowohl Vielseitigkeit als auch Effizienz erfordern, einfach nicht überleben.

3. Die Cloud-Server-Überlastung & Infrastruktur-Alptraum

Es wäre nachlässig, nicht die Infrastruktur-Katastrophe zu besprechen, die die Verbreitung von AI SaaS-Wrappers begleitet. Als Dienste gestreckt wurden, um Anforderungen zu erfüllen, ertrugen zugrunde liegende Cloud-Server beispiellose Lastfaktoren. Die rücksichtslose Verbreitung suboptimaler Modelle führte zu aufgeblähten Berechnungen, die Cloud-Ressourcen über ihre ausgelegte Kapazität hinaus überlasteten. Was folgte, war ein Burnout in Rechenzentren, die von übermäßiger Nutzung und überhitzten Serverfarmen heimgesucht wurden. Die betriebliche Ineffizienz wurde durch schlecht optimierte Workloads verschärft, die der verfügbaren Netzwerkbandbreite vorausliefen.

Cloud-Dienstanbieter, die ärgerlich schweigende Zuschauer bleiben, erlebten, dass die Bereitstellung und Bereitstellung von Modellen unvernünftig zur zunehmenden Abschreibung der Infrastrukturausdauer kippten. Es stellte sich heraus, dass AI-Wrappers die Cloud-Pipelines eher als verurteilende algorithmische Fehlanpassungen verstopften denn als die gut geölten Computereinheiten, als die sie angepriesen wurden. Es fehlte das strategische Management der Ressourcen; Systeme sahen vergeudete Prozessorkreisläufe im gedankenlosen Datenchaos aufgrund nicht optimierter Datenzug- und -abflussströme. Diese Unzulänglichkeiten untergruben die Fähigkeit des Systems zur Selbstwartung, was sich in erhöhten Reaktionszeiten, Serverbeschränkungen und schließlich im Betriebzusammenbruch äußerte.

Die Konsequenzen spiralen, natürlich unwillkommen, aber üblich. Verpackte Modelle teilen oft Knoten, was zu heimtückischen Datenkontaminationen führt. Mandantenfähigkeit mag wirtschaftlich ansprechend erscheinen, doch wenn die Containerisierungsgrenzen überschritten werden, leiden isoliert eingesetzte Modelle unter nachteiligen Auswirkungen. Der Fokus ist auf Bandbreite über qualitative Compute-Zyklen verzerrt, was zu einem Feld voller Latenzengpässe, Ressourcenmangel und vor allem infrastrukturellem Unbehagen führt. Erneut bricht die Echtzeittauglichkeit unter bandbreitenschweren Diensten zusammen, die sich bemühen, die Latenzeskalation in anerkannten Cloud-Zentren zu verhindern.

Letztendlich ist das Infrastrukturileid ein Mikrokosmos des größeren architektonischen Debakels. Wenn gefangen in den Beschränkungen ihres unzureichenden Designs, beschleunigen Wrappers perversweise die Verschlechterung ganzer Server-Ökosysteme und ziehen die Systemadministratoren mit, die gezwungen sind, den Alptraum zu ertragen, degenerierte Ressourcenpools zu retten.

“Der Fehler liegt darin, das Kaskadenversagen der Cloud-Infrastruktur nicht vorherzusehen, wenn nicht optimierte algorithmische Workloads auf sie lasten.” – GitHub Blog

4. Brutaler Uberlebensleitfaden für Senior-Entwickler

Für die Senior-Entwickler, die diesen unerbittlichen KI-Sturm überstehen, bietet ein Überlebensleitfaden Urteilskraft durch mechanischen Pragmatismus. Die von vorübergehenden Wrapper-Lösungen eingeführten Härten zu erkennen, ist zwingend erforderlich—navigieren Sie sie mit technischer Stärke. In erster Linie, fördern Sie keine Abhängigkeit von Einheitslösungen, indem Sie sich mit den Komplexitäten von Machine Learning-Pipelines vertraut machen. Priorisieren Sie maßgeschneiderte Konstrukte, die den betrieblichen Anforderungen angepasst sind, gegenüber generischen API-Füllern. Überprüfen Sie die Modellparameter und perfektionieren Sie sie, um die Benutzbarkeitsinertie zu bekämpfen und sicherzustellen, dass sie zukünftige Skalierungsanforderungen überstehen, ohne der Effizienzvergessenheit zu verfallen.

Die direkte Konfrontation der algorithmischen Treue ist der einzige Retter vor dem Hintergrund der Wrappers, die auf die Obsoleszenz zusteuern. Meisterschaft erfordert eingehende Kernel-Level-Profilauswertung und die genaue Identifizierung von Latenzübeltätern, um neuronale Modelle innerhalb der Einschränkungen von CUDA zu optimieren. Stellen Sie sicher, dass Vektoroperationen angemessen genutzt werden, indem Sie spezialisierte rechnerische Fähigkeiten nutzen, die spezifisch für jede Aufgabe sind, und Templates verwerfen, wenn das Szenario spezielle Optimierungen vorschreibt. Beheben Sie Latenzkonflikte, indem Sie Datenströme planen, die widerstandsfähig gegen betriebliche Blockaden sind und die Fußabdrücke von Serverressourcen kritisch betrachten.

Vorhersicht in Server-Sättigungsfallen ist essentiell. Optimieren Sie für Effizienz in der Containerisierung, indem Sie cloud-native Architekturen strategisch planen und bereitstellen, die Echtzeitanpassungsfähigkeit berücksichtigen, um unnötige Belastungsverstärkung zu vermeiden. Setzen Sie auf Redundanzen, nicht auf Illusionen—planen Sie die Infrastrukturkapazität anhand der berechneten Prognosen, die aus Datentraffic-Bewertungen abgeleitet sind. Konzentrieren Sie die Ressourcenzuweisung, indem Sie Bereiche erkennen, die zu Hardwareausfällen neigen und optimieren Sie die Einsatz des Modells, ohne die Infrastruktur in den unvermeidlichen Niedergang zu drängen.

Gestalten Sie vorsichtige Wege weg von vorübergehenden Abweichungen hin zu langfristig nachhaltigen Modellimplementierungen. Der kurzlebige Triumph von Wrapper-Ansätzen verlangt Wachsamkeit. Eine digitale Strategie, die mit technologischen Fortschritten synchronisiert ist, verhindert das Kapitulieren gegenüber den Zufällen, die transiente KI-Trends einführen. Das Feld verlangt nach einer Resilienz, die durch das Wissen gestärkt wurde, das aus dem Überleben der Fehler gewonnen wurde, die zum Massensterben von AI SaaS-Wrappers geführt haben.

| Kategorie | Open Source | Cloud-API | Eigenständig gehostet |

|---|---|---|---|

| Latenz | 300ms | 120ms | 65ms |

| Rechenanforderungen | Benötigt 4 GPUs mit jeweils 24GB VRAM | Abstrahiert zur Cloud-Unendlichkeit | 80GB VRAM 16 CPU-Kerne |

| Skalierbarkeit | Erstickt bei 10 gleichzeitigen Benutzern | Dynamisch zu Tausenden von Anfragen | Manuell skalierbar bis zu Servergrenzen |

| Wartung | Interne Flickwerk-Integration | Minimaler Aufwand auf Anbieter abgeladen | Schwerer Einsatz, 24/7 Systemüberwachung |

| Abhängigkeitsverwaltung | Python-Hölle mit 200+ Paketen | Albtraum der Anbieterbindung | Dockerisierter Saustall mit 50+ Containern |

| Ausfallrate | Nimmt 5% Paketverlust bei Eigenhosting an | 0,1% Dank Cloud-Redundanz-Blödsinn | 3% Chance auf katastrophale Abstürze |

| Anfangs Einrichtungszeit | Wochen, wenn nicht unendlich mit zusätzlichem Koffein | Unter einer Stunde, wenn Sie Anbieter-Skripten vertrauen | Tage beim Zusammenstellen jeder technischen Lego-Stein |

| Modularität | Flexibilität auf Gnade von verspaghettiisierten Integrationen | Modular, wenn Sie auf geschlossene Systeme stehen | Vorausgesetzt, Sie haben es selbst von Grund auf geschrieben |