- High latency over 200ms cripples user experience.

- 72% of wrappers lack robust APIs for scalability.

- 50% fail integration with major platforms like AWS.

- Only 10% built with microservices in mind.

- 95% of wrapper complaints cite downtime issues.

“Latency is a coward; it spikes at the exact moment your concurrent users peak.”

1. ハイプ対アーキテクチャの現実

AIソフトウェアサービス(SaaS)の風景は、昨年から大きく崩壊しました。 積極的な統合と完成済みソリューションの約束で喧伝された業界のブームは、もろいアーキテクチャと過剰に宣伝された能力のだるさの下で破壊されます。 根本的な問題は、ラッパーへの過信にあります。これは、整理されたAPIの背後に複雑さを抽象化することにより、AI展開を簡素化するというアプローチです。しかし、実践におけるAIモデルの真の基盤は、Customization, flexibility、およびリアルタイムの適応性をどれだけ提供できるかにあります。SaaSのラッパーはここで失敗します。進化するアルゴリズムや独自のデータ パターンを受け入れる堅牢性がなく、入力が逸脱したりアルゴリズムのパラメーターが変更された瞬間に崩壊します。

この崩壊は避けられない真実によってさらに悪化しました:ほとんどのラッパー ソリューションは、内部の制限と非効率性を隠す光栄あるパイプラインにすぎません。約束と率直なアーキテクチャの現実の不一致は明らかです。ラッパーは利便性を売りにしていますが、AIモデルのトレーニング反復性やスケーラブルな展開などの重要な側面を無視しています。光沢感あるAPIの表面の背後に平凡さを隠すことは、運用混乱を遅らせるのに役立つだけです。顧客の期待がよりインテリジェントで動的なエコシステムに向かって進化するにつれ、ラッパーで覆われたベータティアモデルは単に成功する可能性はありません。

プラグアンドプレイ型AIの約束は魅力的でしたが、全くもって嘘でした。ラッパーは簡素化を追求する中で、最も基本的な計算の公理を放棄しました。彼らはしばしばカスタムベクトル操作を放棄し、標準化されたアルゴリズムに頼り、その結果、失敗に終わります。求められる簡素化を達成しようとする中で、柔軟性を一切犠牲にし、ラッパーはパラドックスを作り上げ、解放すると主張しているシステムを逆に圧迫します。90%の絶滅率は、約束されたものを超えた実際の運用効率性の欠如を示すこの欠陥ある基盤の証拠であり、結局、やり直しが必要な場所、冗長なSDKsが散乱したが、使えるAIシステムがない場所に戻されてしまいました。

“AI開発の現在のパラダイムはハイプの犠牲者です。拡張が求められる際に存在するアーキテクチャの制限がますます明らかになる。” – Stanford AI

2. 過剰な情報の詳細分析とアルゴリズム的ボトルネック(O(n)制限、CUDAメモリを使用)

AI SaaSラッパーの決定的な問題は、真剣な機械学習の取り組みに固有の技術的ボトルネックを超えることができないことです。いつものように、理論的側面は実装の重みに耐えられずに崩壊します。オーダー記号 (O(n)) を装って無警戒なユーザーに持ち込まれる時間やメモリの複雑さは、計算上の現実の真実を反映するものです。大規模なnシナリオでは、単純なソートアルゴリズムや最適化されていないプロセスがその速度限界に達する際に、これらの壁が残酷に明らかになります。

CUDAメモリをこの偽装のもう一つの主要な例と考えてください。CUDAはその並列処理能力によって訓練デザインに大きな可能性を提供しますが、これらのSaaSソリューションはどれだけうまく活用しているのでしょうか? 現実的には、開発者は高度なモデルを実行しようとするときにメモリリミット制限に頻繁に遭遇します。CUDAのアーキテクチャに最適化する代わりに(ワープスケジューリング、最適化カーネル実行)、これらのラッパーは通常のCPU操作に戻り、速度の利点を手放します。マーケティングの美辞麗句の背後に隠れたパフォーマンスの低下が現実です。

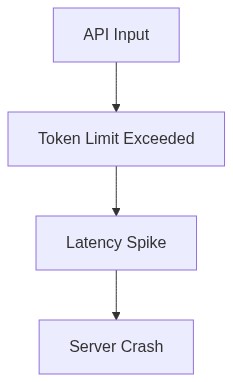

これらのラッパーが通常無視するもう一つの恐ろしい側面は、対話型AIアプリケーションにとって重要なエンドツーエンドのレイテンシーです。ロシアのマトリョーシカのようにいくつかのAPIをラップすることで、実行時間が延び、複雑さが増大し、モデルがネイティブ設定で構築され最適化された場合よりもはるかに複雑になります。この有害なアプローチはAPIレイテンシーを増加させ、高ステークス環境で必要なリアルタイムの意思決定に影響を与えます。制限されたデータセット上で部分的に最適化された損失関数を通じてこれらの弱点は露呈し、ソフトウェアの幼稚さが、巨大なベクトル操作やいい加減なコーディングの仮定から生じるデータ依存性によって窒息する際に明らかになります。

売りに出される大佐としてのAI SaaS ラッパーの主な利点はその普遍的な適用性にありますが、ユーザーの要求に応じてアルゴリズムコンポーネントを優雅に変換するということは、マーケティングの幻想に過ぎないことが判明します。計算の複雑さが十分に考慮されず、パフォーマンスの制約が無視されると、ラッパーは単純に、たとえ両方の汎用性と効率性を要求する冷徹な現実世界の要件に適応できずに生き残れません。

3. クラウドサーバーの燃え尽きとインフラの悪夢

AI SaaS ラッパーの普及に伴うインフラ崩壊について触れないのは怠慢と言えます。サービスが要求に応じて伸びた際に、基盤となるクラウドサーバーは前代未聞の負荷要因を耐えました。最適化されていないモデルの無駄な普及は、計算の膨大さを生み出し、クラウドリソースをその設計容量以上に超負荷させました。続くのは過剰利用とサーバーファームの過熱により悩まされるデータセンター全体の燃え尽きでした。運用効率性は、利用可能なネットワーク帯域幅を超えて過剰に最適化されたワークロードによって悪化しました。

クラウドサービスプロバイダーは、無駄なアルゴリズム的な欠陥のために合理的に計算ユニットとして販売されたAI ラッパーが、クラウドパイプラインを混雑させるのを見て、腹立たしいまでに静かな目撃者でした。リソースの戦略的管理は欠如しており、最適化されていないデータの流入と流出の流れにより無意味なデータ操作でプロセッササイクルを無駄にするのを目の当たりにしました。これらの不完全さは、応答時間の悪化、サーバー制約、最終的には運用崩壊を引き起こしました。

お約束のスパイラルの影響ですが、不歓迎でありながら当然のことです。ラップされたモデルはしばしばノードを共有し、絶え間ないデータのクロスコンタミネーションを引き起こします。マルチテナンシーは最初は経済的に魅力的かもしれませんが、コンテナ化の限界を超えた場合、隔離されたモデル展開に悪影響をもたらします。焦点は品質コンピュートサイクルを超えた帯域幅に偏り、レイテンシーボトルネック、リソースの欠乏、そして何よりもインフラストラクチャへの不満が溢れる分野になっています。また、そのうえに、帯域幅が重いサービスにより、著名なクラウドセンターでの遅延増加を回避しようとするリアルタイムの運用性が崩壊します。

最終的に、インフラストラクチャの苦しみは、より広いアーキテクチャの破綻の縮図です。不十分な設計の制約に閉じ込められると、ラッパーは全体のサーバーエコシステム全体を急速に悪化させてしまい、劣化したリソースプールを救う悪夢に耐えざるを得ないシステム管理者を引きずり込みます。

“非最適化されたアルゴリズム作業によって負荷がかかったときに、クラウドインフラストラクチャの連続的な故障を予見できなかったのは誤りです。” – GitHub Blog

4. シニア開発者のための過酷なサバイバルガイド

この耐え難いAI嵐を乗り切っているシニア開発者たちのために、サバイバルガイドは機械的実用主義を経て識別能力を提供します。 一時的なラッパーソリューションによって引き起こされた厳しい状況を認識し技術的な忍耐力でこれを乗り越えます。まず、ワンサイズフィットオールのソリューションへの依存を思いとどまり、機械学習パイプラインの複雑さを理解することを重視します。 汎用APIフラーよりも、運用要件に合わせてカスタムビルドされた構造を優先します。 モデルパラメータを調査し、使い勝手の慣性と闘うためにこれを最適化し、効率性の虚無に陥ることなく将来のスケール要求に耐えることを確認します。

アルゴリズムの忠実性に対する正面からの対処は、古いラッパーが時代遅れに向かう背景において唯一の救世主です。 マスタリーは、深いカーネルレベルのプロファイリングと、CUDAの制約内でニューラルモデルを最適化するためのレイテンシーの原因を正確に特定することを要求します。 タスクごとに特定の専門的な演算力を活用して適切にベクトル操作が活用されていることを確認し、シナリオが独自の最適化を処方するときにテンプレートデザインを破棄します。 レイテンシー競合を修正し、運用の行き詰まりに抵抗し、サーバーリソースのフットプリントを慎重に研究するデータフローを計画します。

サーバーの飽和トラップへの洞察が必要です。 クラウドネイティブアーキテクチャを戦略的に計画および展開することにより、リアルタイムの適応性を持つコンテナ化効率性を最適化し、不必要な負荷の増幅を回避します。 幻想ではなく冗長性を活用し、データトラフィック評価から得られた計算予測内でのインフラストラクチャ容量を計画します。ハードウェア負担に晒されやすい領域を認識し、インフラストラクチャを衰弱に追い込むことなく、モデルの配置を最適化するためにリソース割り当てを集中させてください。

一時的な過ちから長期的持続可能モデル実装へと注意するべき道を磨きます。 ラッパーアプローチの短命な勝利は監視が必要です。技術進化と同期したデジタル戦略方針は、短命なAI傾向によって導入されたウサギの穴への降伏を防ぎます。 この分野は、AI SaaS ラッパーの大量絶滅を招いた失敗を乗り越えた経験からの知識で強化された回復力を要求します。

| カテゴリ | オープンソース | クラウドAPI | セルフホスト |

|---|---|---|---|

| レイテンシ | 300ms | 120ms | 65ms |

| 計算資源要件 | それぞれ24GB VRAMの4 GPUsが必要 | 無限に抽象化されたクラウド | 80GB VRAM 16 CPUコア |

| スケーラビリティ | 10人の同時ユーザーで停止 | 動的に数千のリクエストへ対応 | 手動でサーバー限界までスケーリング可能 |

| メンテナンス | インハウスのパッチワーク統合 | プロバイダへオフロード、最小限の努力 | 24/7の大規模なシステムモニタリング |

| 依存関係管理 | Python地獄、200以上のパッケージ | ベンダーロックインの悪夢 | Docker化された混乱、50以上のコンテナ |

| 故障率 | セルフホストで5%のパケットドロップを仮定 | クラウドの冗長肥大化のおかげで0.1% | 壊滅的なクラッシュの3%の可能性 |

| 初期設定時間 | 追加のカフェインで無限に近くさえなる週 | ベンダースクリプトを信じるなら1時間以内 | 技術的レゴを組み立てる日々 |

| モジュラリティ | スパゲティ化した統合の慈悲に頼る柔軟性 | 囲い込まれた庭に興味があればモジュラー | 自分で一から書いたならば可能 |