- High latency over 200ms cripples user experience.

- 72% of wrappers lack robust APIs for scalability.

- 50% fail integration with major platforms like AWS.

- Only 10% built with microservices in mind.

- 95% of wrapper complaints cite downtime issues.

“Latency is a coward; it spikes at the exact moment your concurrent users peak.”

1. El Hype vs La Realidad Arquitectónica

El panorama del Software como Servicio (SaaS) de IA se ha desmoronado significativamente durante el último año. El auge de la industria, anunciado por promesas de integraciones sin esfuerzo y soluciones llave en mano, se destruye bajo la apatía de arquitecturas frágiles y capacidades sobrevaloradas. El problema fundamental reside en la excesiva dependencia de los wrappers, un enfoque que supuestamente simplifica el despliegue de IA al abstraer la complejidad detrás de APIs ordenadas. Sin embargo, el verdadero cimiento de cualquier modelo de IA en práctica es el grado de personalización, flexibilidad y adaptabilidad en tiempo real que puede ofrecer. Los wrappers de SaaS fallan notoriamente aquí. Carecen de la robustez necesaria para algoritmos en evolución o para acomodar patrones de datos únicos, desmoronándose en el momento en que aparece una entrada desviada o parámetros algorítmicos alterados.

Este colapso se ha visto agravado por la verdad inevitable: la mayoría de las soluciones de wrappers son solo tuberías glorificadas que enmascaran las limitaciones inherentes y la ineficiencia bajo el capó. La disonancia entre lo que se promete y la dura realidad arquitectónica es evidente. Aunque los wrappers pregonan conveniencia, pasan por alto los aspectos más críticos, como la iterabilidad del entrenamiento de modelos de IA y el despliegue escalable. Disfrazar la mediocridad detrás de una fachada de API reluciente solo sirve para posponer el inevitable caos operacional. A medida que las expectativas de los clientes evolucionan hacia ecosistemas más inteligentes y dinámicos, los modelos de nivel beta envueltos en un wrapper simplemente no tienen ninguna posibilidad.

La promesa de IA plug-and-play era atractiva, pero totalmente engañosa. Los wrappers, en su búsqueda de simplicidad, abandonan los axiomas informáticos más fundamentales. A menudo descartaron operaciones vectoriales personalizadas a favor de algoritmos que no se ajustan a nadie en particular, precisamente donde encuentran su fin. La ironía es obvia: al esforzarse por la simplicidad inalcanzable sin una pizca de flexibilidad, los wrappers crean una paradoja, estrangulando los propios sistemas que afirman liberar. La tasa de extinción del 90% es un testimonio de este fundamento defectuoso donde las promesas superaron la eficacia operacional práctica, llevándonos de vuelta al punto de partida, un lugar sembrado de SDK verbosos pero desprovisto de sistemas de IA utilizables.

“El paradigma actual en el desarrollo de IA es víctima de su propia exageración, ya que las limitaciones inherentes de las arquitecturas existentes se hacen cada vez más evidentes cuando se requiere escalabilidad.” – Stanford AI

2. Profundización Exhaustiva TMI & Cuellos de Botella Algorítmicos (Usa límites de O(n), memoria CUDA)

El problema aplastante con los wrappers de SaaS de IA es su incapacidad para trascender los cuellos de botella técnicos intrínsecos a cualquier esfuerzo serio de aprendizaje automático. Como siempre, los aspectos teóricos se desmoronan bajo el peso de la implementación. Las complejidades de tiempo y memoria, esas honestas reflexiones de la realidad computacional, exponen la superficialidad de estas soluciones de wrappers. La complejidad de tiempo, a menudo pasada de contrabando por usuarios desprevenidos bajo el disfraz inocuo de O(n), se despliega brutalmente en escenarios con n más grandes donde los algoritmos de ordenación ingenuos y los procesos sub-óptimos alcanzan su inevitable velocidad terminal.

Considera la memoria CUDA como otro ejemplo principal de esta fachada. CUDA ofrece un inmenso potencial para entrenamientos con su destreza en el procesamiento paralelo, pero ¿qué tan bien aprovechan estas soluciones SaaS su capacidad? Realísticamente, los desarrolladores se encuentran con las paredes de límite de memoria con frecuencia cuando intentan ejecutar modelos sofisticados. En lugar de optimizar para la arquitectura de CUDA (programación de warps, ejecución de núcleos optimizada), estos wrappers vuelven a operaciones CPU estándar, abandonando las ventajas de velocidad. Terminan en un pobre rendimiento, una realidad oculta bajo una verbosidad de marketing.

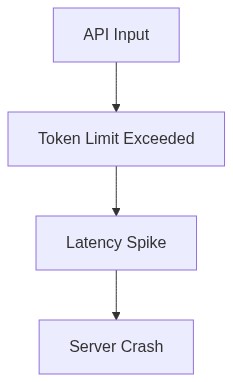

Otro aspecto desalentador que estos wrappers típicamente ignoran es la latencia de extremo a extremo crítica para las aplicaciones de IA interactivas. Envolver varias APIs como muñecas rusas Matryoshka extiende el tiempo de ejecución e infla la complejidad de la tarea mucho más de lo que harían los modelos construidos y optimizados en un entorno nativo. Este enfoque dañino aumenta la latencia de API, impactando la toma de decisiones en tiempo real requerida en entornos de alto riesgo. Extraídas a través de funciones de pérdida mal optimizadas en conjuntos de datos limitados, estas debilidades revelan múltiples fallas algorítmicas. La ingenuidad del software se hace evidente cuando es asfixiado por operaciones masivas de vectores o dependencias de datos secuenciales originadas en suposiciones de codificación descuidadas.

La mentira está en la aplicabilidad universal vendida como el beneficio principal de los wrappers de SaaS de IA: la transmutación elegante de componentes algorítmicos para satisfacer las demandas del usuario resulta ser nada más que una ilusión de marketing. Cuando la complejidad computacional es mal considerada y las restricciones de rendimiento pasadas por alto, los wrappers simplemente no pueden sobrevivir ante los requisitos brutalmente honestos del mundo real que demandan tanto versatilidad como eficiencia.

3. Agotamiento del Servidor en la Nube & Pesadilla de Infraestructura

Sería negligente no discutir la catástrofe infraestructural que acompaña la proliferación de wrappers de SaaS de IA. A medida que los servicios se expanden para satisfacer la demanda, los servidores en la nube subyacentes soportan factores de carga sin precedentes. La proliferación imprudente de modelos sub-óptimos condujo a cálculos hinchados, sobrecargando los recursos de la nube más allá de su capacidad diseñada. Lo que siguió fue el agotamiento en los centros de datos acosados por una utilización excesiva y granjas de servidores sobrecalentadas. La ineficiencia operacional se vio exacerbada a través de cargas de trabajo mal optimizadas avanzando más allá de la capacidad de ancho de banda de la red disponible.

Los proveedores de servicios en la nube, quienes permanecen molestamente como espectadores silenciosos, son testigos de aprovisionamientos y despliegues de modelos que se inclinan de manera irrazonable hacia un aumento de la depreciación de la resiliencia infraestructural. Resulta que los wrappers de IA congestionan las tuberías de la nube más como desajustes algorítmicos condenables que las unidades de cómputo bien engrasadas que se proclamaba que eran. Ausente estaba la gestión estratégica de recursos; los sistemas vieron ciclos de procesador desperdiciados en movimientos sin sentido de datos debido a flujos de entrada y salida de datos no optimizados. Estas deficiencias corroyeron la capacidad del sistema para autosostenerse, manifestándose como tiempos de respuesta escalados, limitaciones de servidores y, finalmente, un colapso operacional.

Las implicaciones se desarrollan, por supuesto, no bienvenidas pero comunes. Los modelos encapsulados a menudo comparten nodos llevando a insidiosas contaminaciones cruzadas de datos. La multitenencia podría ser económicamente atractiva inicialmente, pero a medida que los techos de la conteinerización se rompen, las implementaciones de modelos inter-aislados sufren impactos perjudiciales. El enfoque se inclina hacia el ancho de banda sobre los ciclos de cómputo de calidad, resultando en un campo plagado de cuellos de botella de latencia, desabastecimiento de recursos y, por sobre todo, insatisfacción infraestructural. Nuevamente, la operabilidad en tiempo real se colapsa bajo servicios pesados en ancho de banda que se esfuerzan por evitar la escalada de latencia en centros en la nube conocidos en todo el mundo.

Finalmente, el sufrimiento infraestructural es un microcosmos del más amplio desastre arquitectónico. Cuando atrapa dentro de las limitaciones de su diseño inadecuado, los wrappers perversamente aceleran el deterioro en ecosistemas enteros de servidores, arrastrando a los administradores de sistemas forzados a soportar la pesadilla de salvar piscinas de recursos degradadas.

“El error reside en no anticipar los fallos en cascada de la infraestructura en la nube cuando se sobrecarga con cargas de trabajo algorítmicas no optimizadas.” – GitHub Blog

4. Guía de Supervivencia Brutal para Desarrolladores Senior

Para aquellos desarrolladores senior que resisten esta implacable tormenta de IA, una guía de supervivencia ofrece discernimiento a través del pragmatismo mecánico. Reconocer las dificultades introducidas por soluciones transitorias de wrappers es obligatorio—navegarlas con fortaleza técnica. Primero y principal, desalentar la dependencia de soluciones de talla única construyendo familiaridad con las complejidades de las canalizaciones de aprendizaje automático. Priorizar construcciones personalizadas adaptadas a los requisitos operativos sobre lo genérico. Examinar minuciosamente los parámetros del modelo, perfeccionándolos para combatir la inercia de usabilidad y asegurar que resistan las demandas de escala futuras sin sucumbir a la oblicuidad de eficiencia.

La confrontación directa de la fidelidad algorítmica es el único salvador frente a los wrappers que avanzan hacia la obsolescencia. Se necesita dominio en la realización de perfiles a nivel de núcleo e identificación precisa de culpables de la latencia para optimizar modelos neuronales dentro de los límites de CUDA. Asegurar que las operaciones vectoriales se aprovechen adecuadamente utilizando la destreza computacional especializada específica para cada tarea, desechando diseños de plantilla cuando el escenario prescribe optimizaciones de nicho. Rectificar conflictos de latencia planificando flujos de datos resistentes a bloqueos operativos y escrutadores de las huellas de recursos del servidor.

La previsión en las trampas de saturación del servidor es esencial. Optimizar para la eficiencia de conteinerización planificando y desplegando estrategias de arquitecturas nativas en la nube considerando la adaptabilidad en tiempo real para evitar amplificaciones innecesarias de carga. Emplear redundancias, no ilusiones—planificar la capacidad infraestructural dentro de las proyecciones calculadas derivadas de evaluaciones de tráfico de datos. Focalizar la asignación de recursos reconociendo áreas propensas al desgaste del hardware y optimizar el despliegue del modelo sin empujar la infraestructura hacia un inevitable colapso.

Trazar caminos preventivos lejos de las aberraciones transitorias hacia implementaciones de modelos sostenibles a largo plazo. El triunfo efímero de los enfoques de wrappers demanda vigilancia. La estrategia digital sincronizada con los avances tecnológicos previene la capitulación a los agujeros de conejo introducidos por tendencias efímeras de IA. El campo demanda una resiliencia fortalecida por el conocimiento acumulado al sobrevivir los fracasos que han llevado a la extinción masiva de wrappers de SaaS de IA.

| Categoría | Código Abierto | API en la Nube | Alojado en Propio |

|---|---|---|---|

| Latencia | 300ms | 120ms | 65ms |

| Requisitos de Computo | Necesita 4 GPUs de 24GB VRAM cada una | Abstraído a la infinita nube | 80GB VRAM 16 núcleos de CPU |

| Escalabilidad | Se ahoga con 10 usuarios concurrentes | Dinámica para 1000s de peticiones | Escalable manualmente hasta los límites del servidor |

| Mantenimiento | Integración de retazos caseros | Esfuerzo mínimo transferido al proveedor | Monitoreo del sistema 24/7 intensivo |

| Gestión de Dependencias | Infierno de Python con más de 200 paquetes | Pesadilla de bloqueo de vendedor | Lío de Docker con más de 50 contenedores |

| Tasa de Fallos | Asume un 5% de pérdida de paquetes en alojado en propio | 0.1% gracias al excedente de redundancia en la nube | 3% de probabilidad de colapsos catastróficos catastróficos |

| Tiempo de Configuración Inicial | Semanas, si no infinito con cafeína extra | Menos de una hora si confías en scripts de proveedores | Días ensamblando cada pieza de lego técnico |

| Modularidad | Flexibilidad a merced de integraciones espaguetizadas | Modular si te gustan los jardines amurallados | Siempre que lo hayas escrito tú mismo desde cero |