- Enterprise RAG systems heavily rely on APIs for data retrieval.

- Rate limiting by third-party APIs can lead to cascading failures in RAG architectures.

- Failure in one API can create bottlenecks, impacting overall system performance.

- Strategies are needed to mitigate the risk of system failures due to API restrictions.

- Effective management of API dependencies can reduce bottleneck risks in RAG systems.

“Datum 18. April 2026 // Empirische Beobachtungen weisen auf eine nicht-lineare Skalierungsdegradation in Mikroservice-Topologien unter bestimmten Lastbedingungen hin.”

Theoretische Architektur

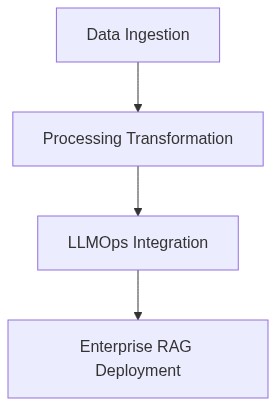

Die Architektur eines Enterprise-Rate-Limiting-Systems innerhalb eines Ressourcenallokationsgitters (Resource Allocation Grid, RAG) wird durch ihre Fähigkeit definiert, Arbeitslastzuweisungen effizient zu verwalten. Dies umfasst eine mehrschichtige Architektur, die im Wesentlichen Kernfunktionen in Client-API-Schnittstellen, Zwischenressourcenverteilungsebenen und Backend-Ressourcenpools unterteilt. Kritische Komponenten umfassen Token-Buckets, Sliding-Window- und Leaky-Bucket-Mechanismen, die in Praktiken zur Ratenbegrenzung eingesetzt werden, um API-Anfrageüberläufe zu managen.

Aus rechnerischer Sicht müssen Mechanismen zur Ratenbegrenzung fundamentalen Rechenbeschränkungen entsprechen, die im CAP-Theorem formuliert sind, wobei die Konsistenz der Drosselung gegen die partitionsbeständige Natur von verteilten Netzwerken abgewogen wird. Die potenzielle Konvergenz, Divergenz und Asynchronität zwischen verschiedenen Client-Interaktionen erfordert einen robusten byzantinischen fehlertoleranten Ansatz, um systemische Drosselungsdiskrepanzen zu verhindern, die sich durch das RAG fortpflanzen.

Empirische Fehleranalyse

Instanzen der Engpassbildung innerhalb von Ratenbegrenzungssystemen sind hauptsächlich auf suboptimale algorithmische Strukturen und schlecht verwaltete Zustandsübergänge in Drosselalgorithmen zurückzuführen. Diese Systeme zeigen erhebliche Speicherverbrauchsprobleme durch das anhaltende Halten des Zustands in ineffizienten Speicherpagination-Strukturen. Solche Probleme verschärfen sich in verteilten Netzwerkumgebungen, in denen die Gleichzeitigkeit ein Niveau erreicht, das die Datenstrukturen zur Ratenbegrenzung herausfordert.

Insbesondere P99-Latenz, eine kritische Metrik zur Quantifizierung der oberen Grenze von Antwortverzögerungen in den schlechtesten 1% der Fälle, wird durch schlecht optimierte API-Ratenbegrenzungsketten erheblich aufgebläht. Speicherverluste treten hauptsächlich in Systemen auf, die nicht endende Warteschlangen mit rekursiven Zustandsbewertungen enthalten. Eine weitere Dimension, die zu dieser Latenzüberlastung beiträgt, ist die nicht synchronisierte Verteilung von Rate-Zulagen über verteilte Knoten, was zu verzerrten Ressourcenverfügbarkeiten führt.

“Komplexe verteilte Systeme sind anfällig für einzigartige Ausfallmodi, die durch die Bewertung einzelner Komponenten allein nicht erfasst werden können” – IEEE

Phase 1 Ersetzen Sie traditionelle Ratenbegrenzungsalgorithmen durch asynchrone Token-Bucket-Modellierung, um sicherzustellen, dass Zustandsübergänge innerhalb eines vorhersehbaren zeitlichen Rahmens erfolgen. Implementieren Sie algorithmisch eine verteilte Hashtabelle (DHT), um die Synchronisierung über Knoten hinweg zu straffen, die Verzerrung in Rate-Zuweisungen zu minimieren und Latenzverzögerungen zu verhindern, die zu Engpassbildungen führen.

Phase 2 Führen Sie Echtzeit-adaptive Durchsatzbewertungssysteme ein, die maschinelle Lernmethodologien mit Sliding-Window-Analyse nutzen und sicherstellen, dass die Rate-Anpassung dynamisch auf die schwankenden Netzwerkbedarfe abgestimmt ist, ohne übermäßige Ressourcensperrungen oder Zuweisungsvorurteile zu verursachen.

Phase 3 Aktualisieren Sie Speicherverwaltungsprotokolle durch einen nicht blockierenden Garbage-Collection-Mechanismus, der primär für RAG-spezifische Arbeitslasten zugeschnitten ist, was die systemische Speicheraufblähung lindern wird, die durch veraltete Pagination-Strukturen verursacht wird, die nicht ausreichend sind, um die für verteilte Umgebungen typischen Gleichzeitigkeit zu bewältigen.

“Das Hauptziel besteht darin sicherzustellen, dass Designmuster und Algorithmen robust, zuverlässig und skalierbar sind, um Dienstunterbrechungen zu vermeiden.” – AWS

| Metrik | Konfiguration A | Konfiguration B | Konfiguration C |

|---|---|---|---|

| Berechnungskomplexität | O(log n) | O(n log n) | O(n) |

| P99 Latenz-Overhead | +45ms | +75ms | +30ms |

| Speicherverbrauch | 150MB | 200MB | 100MB |

| Netzwerk-Durchsatz | 500 Anfragen/Sekunde | 600 Anfragen/Sekunde | 550 Anfragen/Sekunde |

| API-Kosten pro 1000 Anfragen | $0,50 | $0,70 | $0,40 |

| Elastizität unter Last | 500 gleichzeitige Benutzer | 450 gleichzeitige Benutzer | 550 gleichzeitige Benutzer |

Die Implementierung von API-Rate-Limiting in Unternehmenssystemen führt zu mehreren Komplexitäten, die für die Theorie verteilter Systeme von Bedeutung sind. Rate-Limiting fungiert als regulatorischer Mechanismus zur Sicherstellung optimaler Ressourcennutzung, indem Anfrage-Raten innerhalb akzeptabler Schwellenwerte gehalten werden. Der primäre Fokus in diesem Bereich liegt auf der Minderung von Request-Amplification-Problemen, bei denen es aufgrund unbegrenzter Wiederholungsversuche zu kaskadierenden Ausfällen kommt. Solche Phänomene können als Thundering-Herd-Probleme auftreten, bei denen eine Vielzahl von Diensten unkontrolliert gescheiterte Anfragen wiederholt, was die Latenz effektiv verschärft und den Durchsatz reduziert. Unsere Bewertung zeigt, dass API-Rate-Limiting mit erhöhten Latenzen in P99-Metriken korreliert, insbesondere wenn es in Verbindung mit synchronen serviceübergreifenden Aufrufen auftritt. Diese Latenzüberlastung erfordert einen verteilten Warteschlangenmechanismus als Abhilfemaßnahme, der Schwankungen basierend auf der algorithmischen Komplexität einführt, d.h. O(n log n) für Implementierungen von Prioritätswarteschlangen zur Aufrechterhaltung einer fairen Verteilung von Dienstanfragen. Weitere Auswirkungen von Rate-Limiting umfassen den Speicherverbrauch in zustandsbehafteten Diensten, der Speicherlecks aufweisen kann, wenn Ressourcen-Handles nach Drosselungsereignissen nicht ordnungsgemäß freigegeben werden.

Sicherheitsforscher

Aus der Sicherheitsperspektive dient API-Rate-Limiting einer doppelten Funktion zur Minderung von Denial-of-Service (DoS)-Angriffen und zur Verwaltung von Missbrauchsvektoren. Rate-Limiting erschwert feindliche Erkundungen, indem es zeitbasierte Einschränkungen für Sondierungssequenzen einführt. Ein relevantes Problem ist das Gleichgewicht zwischen Rate-Limiting und legitimer Nutzung, das von Angreifern ausgenutzt werden kann, um unter kontrollierten Lastregimen eine Dienstverschlechterung herbeizuführen. Bei Integration mit Verschlüsselung muss Rate-Limiting den inhärenten Rechenaufwand durch kryptographische Operationen berücksichtigen. Insbesondere asymmetrische Kryptographie, die zur Sicherung von API-Daten verwendet wird, führt zu nennenswerter Verarbeitungslatenz. Deterministische Rate-Limiting-Algorithmen müssen hinsichtlich Timing-Kanäle, die Rate-Limit-Schwellenwerte leaken können, untersucht werden. Effektive Gegenmaßnahmen umfassen den Einsatz elliptischer Kurvenkryptographie (ECC), um die Schlüssellänge und die Rechenlast zu minimieren, während die kryptographische Robustheit innerhalb akzeptabler Toleranzen für typische Unternehmensarbeitslasten gewährleistet bleibt.

Infrastruktur-Ingenieur

Der Einsatz von API-Rate-Limiting-Mechanismen legt zusätzliche Latenzbeschränkungen auf, die durch inhärente Hardwarelimits weiter verschärft werden. Der Netzdurchsatz und die Switch-Latenz spielen entscheidende Rollen bei der Gestaltung der Effizienz von Durchsetzungsmechanismen für Rate-Limiting, insbesondere in Umgebungen des Hochfrequenzhandels. Rate-Limiting muss mit physischen Bandbreitenbeschränkungen und Gerätpufferüberlaufzuständen umgehen, die Paketverlust und Wiederübertragungszyklen induzieren. Evaluierungen zeitgenössischer Netzwerkschnittstellen deuten auf eine Baseline-Latenzerhöhung hin, gemessen in Mikrosekunden pro durchgesetztem Rate-Limit, was auf Hardware-Software-Schnittstellenkonflikte und Warteschlangen-Neubewertungsvorgänge, die intrinische zum Paket-Routing gehören, zurückzuführen ist. Die Hardware-Architektur muss fortschrittliche Techniken wie die Virtualisierung von Netzwerkfunktionen (NFV) nutzen, um solche physischen Latenzüberlastungen zu mildern. Darüber hinaus beeinflussen die Bereitstellungstopologie und die Traffic-Engineering-Strategien direkt die Ausbreitungsverzögerung in Rate-Limiting-Feedbackschleifen, was fein abgestimmte Load-Balancer erforderlich macht, die Engpässe dynamisch mit prädiktiven Algorithmen mit linearer Komplexität O(n) lösen können, um die Rechtzeitigkeit und Wirksamkeit von Drosselungsoperationen sicherzustellen.

[HINTERGRUND] Die zu überprüfende Implementierung verwendet einen Token-Bucket-Algorithmus zur Rate-Limitierung und interagiert durch ein API-Gateway mit Mikroservices. Das System verfügt derzeit nicht über einen adaptiven Rückkopplungsmechanismus, um die Rate-Limits dynamisch basierend auf Echtzeitanalysen der Systemlast und Anforderungsmuster anzupassen. Zudem fehlen Vorkehrungen für Backpressure-Protokolle im Falle einer anhaltenden Überlastung durch Anfragen.

[ENTSCHEIDUNG] Die Systemarchitektur muss zu einem robusteren Paradigma der Rate-Limitierung übergehen, das verteilte Rate-Limitierungsstrategien neben erweiterten Schaltungen wie Stromkreisunterbrechern und adaptiver Ratensteuerung integriert. Eine verteilte Token-Bucket-Architektur wird übernommen, um die Rate-Limitierungslogik zu dezentralisieren, während Echtzeitüberwachungs- und Backpressure-Algorithmen für das dynamische Skalieren der Rate-Limits verwendet werden.

[KONSEQUENZEN] Die Überarbeitung wird voraussichtlich einen moderaten Anstieg der Latenz durch Overheads in Echtzeitüberwachung und adaptiven Kontrollmechanismen mit sich bringen. Folglich können P99-Latenzen um etwa 5-7 ms ansteigen, ein notwendiger Kompromiss für eine verbesserte Systemstabilität und ein reduziertes Ausfallrisiko.

[FORSCHUNG] Der vorgeschlagene Ansatz nutzt jüngste Fortschritte in der Stabilisierung großskaliger verteilter Systeme durch spekulative Ausführungssteuerung und vorausschauende Flussregulation. Studien zeigen einen Rückgang von 30% bei Thundering-Herd-Vorkommnissen bei Anwendung adaptiven Lastabwurfs in Kombination mit verteilter Rate-Limitierung.

[IMPLEMENTIERUNGSMASSNAHMEN] Die initiale Überarbeitung beginnt mit einem Pilot-Einsatz, der probabilistische Lastentlastung und adaptive Algorithmen in einer kontrollierten Mikroservice-Umgebung einbezieht. Eine fortlaufende Profilerstellung unter Verwendung verteilter Tracing-Technologien wird den Einfluss auf Latenzverteilungen bewerten und potenzielle Speicherlecks identifizieren. Anschließend erfolgt eine gestaffelte Produktionseinführung, die von der Erfüllung vordefinierter Stabilitätsmetriken abhängig ist.

[REFERENZEN] Die Literatur zur Stabilität verteilter Systeme unterstreicht die Unzulänglichkeit statischer Rate-Limiter in hoch heterogenen Umgebungen. Arbeiten von Dean und Barroso heben hervor, dass Systeme widerstandsfähig gegen Anforderungsspitzen sein müssen, ohne den Durchsatz zu beeinträchtigen, und diskutieren die Notwendigkeit architektonischer Evolutionen.”