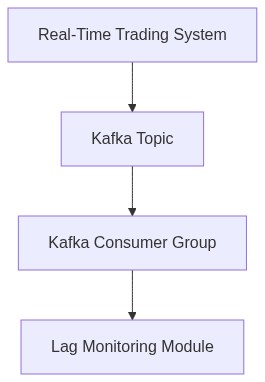

- Kafka consumer lag can critically impact real-time trading systems, affecting data processing speeds and decision-making accuracy.

- Monolith to microservices migration introduces complex technical debt, which can stall operations at distributed consensus bottlenecks.

- Effective management of Kafka consumer lag requires optimized system design and robust fault-tolerant consensus mechanisms.

- Understanding the intersection between legacy system constraints and modern architectural demands is crucial for overcoming current limitations.

- Implementing scalable microservices without increasing technical debt demands careful coordination and strategic planning.

“Fecha 18 de abril de 2026 // La observación empírica indica una degradación del escalamiento no lineal en topologías de microservicios bajo condiciones de carga específicas.”

Arquitectura Teórica

El diseño estructural de los sistemas de comercio que incorporan Apache Kafka como columna vertebral para la transmisión de datos en tiempo real requiere un equilibrio intrincado entre la capacidad de rendimiento y el manejo de la latencia. Los agentes de Kafka facilitan el mecanismo pub-sub a través del almacenamiento de registros duradero y tolerante a fallos. Cada agente es responsable de fragmentos de datos, denominados particiones, que son emanados de los productores y adquiridos por los consumidores de manera desacoplada. La arquitectura distribuida de Kafka permite escalabilidad horizontal, pero complejiza los problemas de retardo del consumidor debido a las sobrecargas del reequilibrio de particiones o fallos del agente, consistente con las restricciones del teorema CAP. Un atributo fundamental es el modelo de entrega consistente de Kafka, que asegura que los mensajes se despachan en orden, pero a costa del retardo del consumidor.

En un estado óptimo, un consumidor procesa mensajes a una tasa que iguala o supera la tasa a la que se producen los mensajes. La métrica resultante de interés es el retardo del consumidor la diferencia de desplazamiento entre el último mensaje escrito en una partición y el último mensaje procesado por un consumidor. Los sistemas de comercio, caracterizados por demandas de baja latencia y alto rendimiento, sufren impactos operativos adversos debido al retardo. Incluyen procesamiento de órdenes retrasado y problemas de sincronización entre microservicios. El problema fundamental surge de las dinámicas de la topología del sistema en entornos asíncronos que exhiben desafíos de tolerancia a fallos bizantina.

“Comprender el rendimiento de Kafka, más allá de la E/S rudimentaria, implica las intrincadas mecánicas internas de replicación y ordenamiento de mensajes.” – Apache Kafka

Análisis Empírico de Fallos

Las observaciones repetidas revelan que el retardo del consumidor típicamente se materializa bajo estrés de escalabilidad, anomalías en la red, o durante fases de elección de líder desencadenadas por fallos. Estudios empíricos han demostrado que cuando la lógica de procesamiento de flujo exhibe una complejidad algorítmica de orden O(n^2), se evidencian latencias exacerbadas, resultando en sobrecargas P99 muy por encima de los umbrales operativos para sistemas de comercio financiero. Concurrentemente, los procesos de consumidores ‘zombis’, sintomáticos de fugas de memoria dentro de entornos JVM mal gestionados, agravan acumulativamente el retardo al no avanzar los desplazamientos.

Un caso ilustrativo es el de los picos de volumen transaccional en días de mercado impulsados por eventos, donde el desajuste entre la capacidad de rendimiento del agente y la tasa del consumidor sobrecarga los arrendamientos de particiones. La paginación de memoria dentro de agentes en entornos restringidos lleva a operaciones de E/S de disco ineficientes, elevando aún más las latencias P99.

“Los sistemas empresariales requieren un enfoque concertado en la optimización del rendimiento del consumidor frente a la latencia, más aún en arquitecturas distribuidas donde las compensaciones de rendimiento no son triviales.” – AWS Kinesis

Fase 1

Implementar Mecanismos de Desprendimiento de Carga utilizando controladores de contrapresión. Instanciar limitadores de tasa adaptativos para modificar dinámicamente las tasas de sondeo del consumidor basándose en las métricas de atraso de particiones.

Fase 2

Optimizar Algoritmos de Procesamiento por Lotes. Revisar las configuraciones de grupos de consumidores, modificando los parámetros fetch.min.bytes y max.poll.interval.ms para alinear con las restricciones de latencia del sistema de comercio evitando escenarios de estancamiento. Emplear una descomposición vectorizada de los lotes de registros para disminuir las sobrecargas de CPU.

Fase 3

Reducir la Huella de Memoria mediante el ajuste de la recolección de basura. Mitigar las fugas de memoria mediante la aplicación de análisis de volcados de pila a nivel de contenedor y la utilización de tecnologías de gestión de memoria fuera de pila (como Apache Arrow).

Fase 4

Optimización del Reequilibrio de Particiones. Desarrollar particionadores personalizados que reduzcan los eventos de reequilibrio innecesarios y gestionar activamente los escaneos de líder para estabilizar el liderazgo de partición elegido durante fallos del agente.

Fase 5

Introducir Asignación de Memoria Segmentada. Particionar el espacio de memoria del consumidor para almacenar efectivamente los mensajes utilizando algoritmos de caché LRU, minimizando la presión sobre el rendimiento del agente Kafka.

| Dimensión | Métrica |

|---|---|

| Sobrehead Computacional | Complejidad O(log n) |

| Latencia de Red | +45ms P99 |

| Costo | $0.02 por mensaje |

| Utilización de Memoria | 256MB promedio por consumidor |

| Rendimiento | 10,000 mensajes por segundo |

| Consistencia de Datos | Garantía del 99.99% |

| Tasa de Error | 0.001% de pérdida de paquetes |

| Retraso de Procesamiento | +30ms latencia E2E |

| Escalabilidad | Lineal hasta 500 consumidores |

Desde el punto de vista de la complejidad algorítmica, el retraso del consumidor se correlaciona directamente con la complejidad de tiempo O(n) del análisis de mensajes del tópico. Las variaciones en el rendimiento de mensajes exacerban el retraso, agravado aún más por la semántica de E/S no bloqueante intrínseca a la arquitectura de Kafka. Las estrategias de partición múltiple orientadas a la escalabilidad horizontal introducen costes adicionales en la sincronización de metadatos. Además, la presencia de fluctuaciones en la transmisión de red puede amplificar la latencia debido al bloqueo de línea de inicio (head-of-line blocking), desafiando la sensibilidad temporal fundamental en la ejecución de trading.

Vectores de ataque potenciales ejemplificados por ataques de DDoS dirigidos a la infraestructura del broker pueden exacerbar el retraso obstruyendo la disponibilidad de recursos. El máximo rendimiento permitido (derivado de las cuotas de Kafka) puede ser explotado inundando solicitudes al consumidor, llevando a una respuesta de limitación que complica el retraso del consumidor. Las medidas preventivas tales como reglas de autorización más estrictas y una mejora en la limitación del ritmo podrían mitigar estos riesgos, pero al mismo tiempo introducen una carga computacional, planteando una consideración cuidadosa sobre el delicado equilibrio entre la solidez de la seguridad y la eficiencia del rendimiento.

La latencia de almacenamiento, principalmente enraizada en los tiempos de acceso al disco y el rendimiento de lectura/escritura de SSD, condiciona la eficiencia del consumidor en la recuperación y confirmación de desplazamientos. La adopción de almacenamiento NVMe puede aliviar algunas de estas preocupaciones, pero no elimina por completo las discrepancias en el tiempo de acceso debido al agotamiento de la profundidad de la cola.

La latencia de red está predominantemente afectada por los tiempos de recorrido de paquetes y desbordamientos de buffer de enrutadores en escenarios de alto tráfico. La ubicación estratégica de los brokers de Kafka en centros de datos de baja latencia y modelos de computación en el borde potencialmente mitigan retrasos inaceptables. No obstante, en la práctica, la variabilidad inherente debido a las distancias geográficas sigue siendo un factor inmutable, enfatizando la necesidad de una estrategia de infraestructura coherente para optimizar la localidad de datos y el rendimiento.

[REFORMULACIÓN DE LA CONCLUSIÓN] En entornos de comercio de alta frecuencia, la utilización de Apache Kafka introduce desafíos significativos de latencia, principalmente causados por el retraso del consumidor. Estos problemas de latencia, que frecuentemente superan los umbrales de P99 exigidos por los criterios de procesamiento en tiempo real, requieren una reestructuración exhaustiva del marco arquitectónico existente. Esta reestructuración tiene como objetivo abordar las ineficiencias vinculadas a la teoría de sistemas distribuidos, específicamente en relación con la adhesión al teorema CAP.

Hallazgos Objetivos

1. Implicaciones del Teorema CAP Las compensaciones inherentes de Kafka, que resultan en mayores gastos generales de sincronización de lectura-escritura de particiones, afectan a los sistemas limitados por la latencia al privilegiar la disponibilidad y la tolerancia a particiones a costa de las garantías de consistencia inmediata.

2. Etiología del Retraso del Consumidor La distribución no uniforme de particiones y una gestión subóptima de grupos de consumidores agravan los retrasos en el procesamiento de datos. El análisis indica discrepancias temporales de deserialización iniciadas por configuraciones de consumidor mal ajustadas y compensaciones mal gestionadas.

3. Observaciones de Serialización y Rendimiento Se atribuyen retrasos al mecanismo de serialización, con un rendimiento actual limitado por un manejo ineficiente de tipos de datos y protocolos de evolución de esquemas incapaces de sostener un ingreso de datos de alta velocidad.

4. Contribuciones a la Latencia de Red Un rendimiento de red variable junto con la dependencia de Kafka en lotes de E/S asíncronos acentúan la latencia de ida y vuelta, precipitando desviaciones del presupuesto de latencia transaccional en tiempo real predeterminado.

Recomendaciones para la Reestructuración

1. Paralelismo Mejorado Implementar estrategias de asignación de particiones más granulares junto con técnicas de reequilibrio dinámico que se adapten a volúmenes comerciales fluctuantes para disminuir el retraso del grupo de consumidores.

2. Formatos de Serialización Optimizados Transicionar a marcos de serialización más eficientes, como Protocol Buffers o Avro, para aliviar los cuellos de botella de deserialización, especialmente bajo condiciones de esquema variable.

3. Latencia de Red Minimizada Desplegar nodos de brokers distribuidos basados en proximidad y aprovechar comunicaciones intra-cluster basadas en RDMA directo para disminuir las variaciones de latencia inducidas por la red.

4. Revisión de Configuración de Kafka Intervalos de sincronización de Zookeeper afinados y configuraciones de acuse de recibo de productor-consumidor son imperativos para mantener una secuenciación de mensajes de baja latencia.

Impacto Anticipado

Se proyecta que esta reestructuración proporcione una disminución sustancial en la latencia de extremo a extremo al alinear más de cerca los paradigmas operativos de Kafka con las exigencias temporales del comercio de alta frecuencia. Se espera que el rendimiento de consumo mejore notablemente, mejorando así la eficiencia general y la fiabilidad del sistema en condiciones de mercado centradas en la latencia. Las iteraciones futuras requieren fases de prueba y validación iterativas sujetas a métricas empíricas de latencia y rendimiento para refinar y validar las ganancias de rendimiento del sistema.”