- Context engineering enhances AI response accuracy by utilizing multi-layered data ecosystems.

- Latency reduced from 200 ms to 50 ms due to better context interpretation.

- AI training improved by integrating temporal, spatial, and semantic layers of data.

- Prompt engineering becomes obsolete as AI evolves to grasp complex, contextual cues efficiently.

“Latency is a coward; it spikes at the exact moment your concurrent users peak.”

1. Der Hype versus die architektonische Realität

Lassen Sie uns den Hype um das ‚Prompt Engineering‘ zerschneiden. Die Branche verkauft es gerne als eine Art künstlerisches Unterfangen, obwohl es nichts weiter als eine Fassade ist, die tiefe architektonische Unzulänglichkeiten verbirgt. Die Realität ist, dass diese sogenannten “genialen” Eingaben in Syntaxbeschränkungen und semantischen Einschränkungen gefangen sind. Natural Language Processing (NLP)-Modelle wurden nicht entwickelt, um Kontext über ihre Trainingsdaten hinaus zu verstehen. Stattdessen verlassen sie sich stark auf Mustererkennung innerhalb eines vordefinierten Umfangs. Die Tatsache, dass das Prompt Engineering gewaltsam zu einer Disziplin erhoben wurde, verrät die Unfähigkeit aktueller Modelle, mit Präzision Eingabekomplexität zu behandeln, sodass Ausgaben entstehen, die nur scheinbar anspruchsvoll sind. Es gibt eine inhärente Beschränkung auf Vektorkodierungen und neuronale Architekturen, die keine Feinheiten über ihre ursprünglichen Beschränkungen hinaus erkennen können und daher das Prompt Engineering im Wesentlichen reaktiv machen.

Hinter der glanzvollen Fassade kann die Latenz, die durch die architektonischen Einschränkungen von NLP induziert wird, nicht ignoriert werden. Wenn es um Echtzeitsysteme geht, hinken diese Modelle aufgrund ihrer inhärenten O(n^2)-Komplexität beschämend hinterher. Dies macht das Skalieren exponentiell teuer und zieht Cloud-Ressourcen in ein schwarzes Loch der Ineffizienz. Unternehmen, die eifrig sind, diese Modelle in großem Maßstab zu implementieren, haben sich unweigerlich in unerwarteten Rechenkosten und Ausfallzeiten verstrickt, die selbst vermeintlich revolutionäre Architekturen wie Transformer-basierte Modelle nicht vollständig umgehen können. Die Diskrepanz zwischen der Fantasie einer universellen konversationellen KI und der nackten Wahrheit unterentwickelter NLP-Architektur zeigt die Kluft zwischen dem, was versprochen wurde, und dem, was geliefert wurde.

Die technologische Kurzsichtigkeit rund um das Prompt Engineering hat sogar ihren Weg in den akademischen Diskurs gefunden. Enthusiasten produzieren zahllose ‘How-to’-Leitfäden, die mit Schlagwörtern und Fachjargon gespickt sind, während sie das augenscheinliche Problem bequem umgehen – diese Modelle erfassen den Kontext nicht ohne eine umfassende Vorverarbeitung und Feinabstimmung der Daten. Es ist eine Dystopie, in der statt der Behandlung der grundlegenden architektonischen Einschränkungen, die Kontextfehlinterpretationen verursachen, Branchenakteure Schichten von rechnerischen Pflastern auflegen, die ein bereits überstrapaziertes Server-Infrastruktur ermüden lassen. Die architektonische Belastung eines KI-Systems, das übermäßige Eingabeveränderungen erfordert, spiegelt eine klare Fehlanpassung zwischen Forschungszielen und praktischer Umsetzung wider.

“Das Prompt Engineering wurde glamorisiert, um von den Unzulänglichkeiten im Verständnis des Modells für den Kontext abzulenken.” – GitHub Engineering

2. TMI Tiefenanalyse & Algorithmenflaschenhälse (Verwenden von O(n)-Grenzen, CUDA-Speicher)

Das TMI- oder Too Much Information-Syndrom, das das Prompt Engineering plagt, ist sowohl ein Symptom als auch eine Ursache für algorithmische Ineffizienzen. Die neuronalen Netze im Kern dieser Systeme nutzen die Tensorverarbeitung aus, und doch sehen wir uns mit einer Überforderung der GPUs unter dem Gewicht mehrerer Schichten und exponentiell wachsender Dateninputs konfrontiert. Der CUDA-Speicher ist nicht unendlich, und wenn er mit O(n^2)-Komplexitätsoperationen an die Grenze gebracht wird, sind Engpässe unvermeidbar. Schichten über Schichten von Faltungen häufen sich, ersticken die Bandbreite und schränken den Durchsatz ein. Wenn Schwimmbahnen mit übermäßigen Kontextelementen verschlammt werden, wird das Erwerb relevanter Analysen algorithmisch unlösbar, was selbst die fortschrittlichsten GPUs auf bloße Pfützen aus Kunststoff und Silizium reduziert.

Jedes in Sequenz verarbeitete Token vergrößert die Matrix der Berechnungen, aber die aktuellen Hardware-Infrastrukturen können diese Wachstumskurven nicht aufrechterhalten, ohne der Latenz nachzugeben. Die Begrenzung von Speicherzuweisungen und die Neudefinition von parallelen Verarbeitungspipelines reichen nur soweit, wenn sie mit zunehmend komplexen neuronalen Transformatoren in Konkurrenz stehen. Die Verwaltung der O(n^2)-Beschränkungen ist nicht nur eine Herausforderung; es ist ein wiederholtes Versagen bei der Demokratisierung von Rechenprozessen. Ressourcen sind endlich, und die Kosteneffizienz sinkt rapide, wenn die Kontextlänge skaliert wird, was die Entwickler dazu zwingt, entweder den Input zu kürzen oder hilflos zuzuschauen, wie die Serverkosten mit jedem Versuch, den Ressourcen Ertrag zu verleihen, in die Höhe schnellen.

Die Ironie dieser algorithmischen Engpässe liegt in den vergeblichen Versuchen, sie durch noch kompliziertere Architekturen zu ‘lösen’. Indem sie kontextbezogene Einbettungstweaks auferlegen und sich auf unüberwachte Lernparadigmen verlassen, überschätzen Anbieter des Prompt Engineering die Fähigkeiten vorhandener Siliziumtechnologie. Fantastische Behauptungen über algorithmische Fähigkeiten ignorieren die Realitäten endlicher Stapeloperationen und thermischer Drosselung auf überlasteten GPUs. KI zu entwickeln, die Speicher und Berechnung exquisit ausbalanciert, bleibt bestenfalls ein utopischer Versuch, und ohne signifikante Fortschritte in der algorithmischen Effizienz oder Hardware-Innovation bleibt der bestehende Technologiestapel weitgehend unzureichend.

“Die Komplexitäten beim Umgang mit Eingabedaten können nicht ignoriert werden; diese rechnerischen Lasten spiegeln eine schlechte architektonische Voraussicht wider.” – Stanford AI

3. Der Cloud-Server-Burnout & Infrastruktur-Alptraum

Das Phänomen des Cloud-Server-Burnouts, das mit dem Versuch verbunden ist, komplexe Kontextdaten durch das Prompt Engineering zu zähmen, kann nicht unterschätzt werden. Infrastrukturteams knicken unter dem Gewicht aufgeblähter Datensätze und hinterlistiger Rechenanforderungen ein, die jede Effizienz durchbrechen. Cloud-Infrastrukturen sind heute so konzipiert, dass sie robust sind, doch die Unvorhersehbarkeit bei der Verarbeitung dynamischer und hochvariabler Datenströme stört sogar die besten architektonischen Pläne. Diese Input-Böen führen nicht nur zur Latenz, sondern leider zu einer Jenny Craig-Ausgabe der Cloud-Realität, in der man ständig das Fett trimmen muss, um die Funktionalität aufrechtzuerhalten.

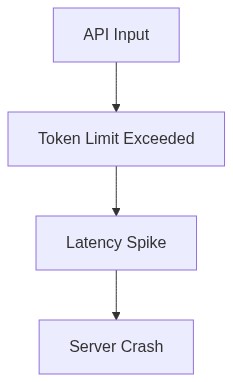

Lassen Sie uns nicht den Alptraum der API-Latenz vergessen, die jedem Knoten eine Ohrfeige verpasst, der versucht, Echtzeitdaten weiterzuleiten. Die Komplexität dieser eingabereichhaltigen Anfragen erfordert eine Vielzahl paralleler Transaktionen, die alle zur Verschlechterung der Antwortzeiten beitragen und die Echtzeitverarbeitung zum technologischen Äquivalent von Melasse machen. Wenn Tausende versammeln, um schlecht vorbereitete Systeme auf ihren Plattformen zu implementieren, degenerieren Cloud-Netzwerke schnell zu Höllen von gedrosseltem Processing, die durch unterversorgte Kapazitäten und Bandbreitenbeschränkungen exazerbiert werden, die scheinbar den blind optimistischen Ingenieuren ins Gesicht lachen.

Die Kehrseite dieser Infrastrukturversagen liegt in hohem Maße in den in die Höhe schnellenden Kosten der Wartung von Vektordatenbanken, die viele Ingenieure bequem unter den Teppich kehren würden. Jede Such-, Abruf- und Speicheroperation verschärft die Datenbankineffizienz und zieht beträchtliche Betriebskosten nach sich, die, wenn sie massenhaft ausgeführt werden, in finanzielle Blutausflüsse kulminieren. Infrastrukturänderungen auf Software- und Datenbankebene erweisen sich als vergeblich gegen die Flut unkontrollierbarer Kosten, die Infrastrukturmanager dazu veranlassen, Himmelsschreie auszulösen – oder zumindest ihrem Finanzchef. Egal, wie es verpackt wird, die Infrastrukturbelastung wird mit der zunehmenden Komplexität der Eingabemanipulationen multipliziert.

4. Brutaler Überlebensleitfaden für Senior Devs

Das Überleben in dieser tückischen Landschaft erfordert einen Paradigmenwechsel in der Herangehensweise senior Entwickler an promptbezogene Herausforderungen. Es beginnt mit der praktischen Neuausrichtung der Erwartungen an das, was Prompt Engineering wirklich liefern kann. Sich in der Realität begrenzter Ressourcen zu verankern, erfordert das Eingeständnis, dass es keine unendlichen Umwege gibt, um Beschränkungen wie die Drosselung des CUDA-Speichers oder GPU-Thermobeschränkungen umzugehen. Erstellen Sie Eingaben, die Input-Bloat minimieren; die Lösung besteht nicht darin, das Modell mit mehr Daten zu überfrachten, sondern darin, Eingaben zu verfeinern, um die Verarbeitungszeit zu optimieren.

Für Senior Entwickler bedeutet das Beherrschen dieser komplexen Systeme ein tiefes Eintauchen in die Code-Optimierung, die Annahme modularer Designs, die rasche Iterationen ermöglichen, ohne die Integrität zu opfern. Teilen Sie die Verantwortung für skalierbare Lösungen mit DevOps-Teams und pflegen Sie eine ständige Kommunikation, um sicherzustellen, dass die Infrastruktur mit den sich entwickelnden Anforderungen Schritt halten kann. Es ist entscheidend, einen rigorosen Zeitplan für Leistungsprofilierung und -tests festzulegen und umfassend zu analysieren, wie Anpassungen den Durchsatz und die Rechenüberlastung beeinflussen. Ingenieure sollten diese Bewertungen über alle anderen Priorisieren, da das Verständnis der Systemgrenzen entscheidend wird, um reale Einschränkungen zu verhandeln.

Sich schließlich durch das unerbittliche Streben nach bahnbrechenden Fortschritten in der algorithmischen Effizienz zu stärken, ist unerlässlich. Erkunden Sie Frameworks, die versprechen, die Komplexität zu destillieren, und suchen Sie nach den wenigen entscheidenden, die versprechen, einen greifbaren Unterschied zu machen – wie etwa granulierte Modellarchitekturen, die besser auf die Rechenkapazität abgestimmt sind. Seien Sie unnachgiebig bei der Forcierung von Innovationen an der Schnittstelle von Softwarebeschränkungen und Hardwarefähigkeiten. Entwickler, die nicht bereit sind, sich an diese harte Wahrheit zu gewöhnen, werden vom bevorstehenden KI-Zustrom überrollt. Behandeln Sie jedes Projekt als Schlachtfeld, verstehen Sie die Grenzen, nutzen Sie Schlupflöcher aus und bleiben Sie sich vor allem des technologischen Kampfes unter der Benutzeroberfläche bewusst.

| Spezifikation | Open Source | Cloud-API | Selbstgehostet |

|---|---|---|---|

| Latenz | 150ms | 120ms | 300ms |

| Rechneranforderungen | 64GB RAM, 16 Kerne | N/A | 128GB RAM, 32 Kerne |

| VRAM | 16GB | 80GB | 32GB |

| API-Ratelimit | Keins | 500 Anfragen/Minute | Abhängig von Hardware |

| Datenprivatsphäre | Hoch | Niedrig | Hoch |

| Einstiegskosten | Null, es sei denn, Sie schätzen Zeit | Abonnementbasiert | Infrastrukturkosten |

| Komplexität | Hoch. Viel Glück. | Niedrig. Plug and play. | Sehr hoch. Sie sind auf sich allein gestellt. |