- Context engineering enhances AI response accuracy by utilizing multi-layered data ecosystems.

- Latency reduced from 200 ms to 50 ms due to better context interpretation.

- AI training improved by integrating temporal, spatial, and semantic layers of data.

- Prompt engineering becomes obsolete as AI evolves to grasp complex, contextual cues efficiently.

“Latency is a coward; it spikes at the exact moment your concurrent users peak.”

1. 現実の建築と期待の差

『プロンプトエンジニアリング』の誇大広告を断ち切りましょう。業界はこれを芸術的な試みとして売り込むのが好きですが、実際には深刻な建築的欠陥を隠すための偽装に過ぎません。実際には、これらの「巧妙な」プロンプトは、構文の制約と意味の限界に縛られています。自然言語処理 (NLP) モデルは、トレーニングデータを超えてコンテキストを理解するようには設計されていません。それよりも、事前に定義された範囲内でのパターン認識に大いに頼っているのです。このプロンプトエンジニアリングが無理やり学問になったとされている事実は、現在のモデルがプロンプトの複雑さを精確に処理できないことを裏切っており、表面的には複雑に見えるだけの出力を生んでいます。ベクトルエンコーディングとニューラルアーキテクチャには、その初期の制約を超える微細な点を区別できない内在的な制限があります。そのため、プロンプトエンジニアリングは基本的に受動的なものなのです。

光沢のある表面の背後に、NLPの建築の限界によって引き起こされるレイテンシは無視できません。リアルタイムシステムにおいて、これらのモデルは、その固有のO(n^2)の複雑性により、恥ずかしいほど後れを取っています。これにより、スケーリングは指数関数的に高価になり、クラウドリソースは効率性のブラックホールに引き込まれます。これらのモデルを大規模に展開しようと熱心な企業は、想定外の計算コストとダウンタイムに必ず巻き込まれ、その結果、Transformerベースのモデルのような革命的なアーキテクチャでさえ完全に回避することはできません。普遍的な会話型AIの幻想と未発展のNLPアーキテクチャの現実の間のギャップは、約束されたものと実際に提供されたものの間の溝を露わにしています。

プロンプトエンジニアリングに関する技術的近視眼が学術的議論にまで浸透しています。熱狂者たちは、数々のバズワードと専門用語をちりばめた「ハウツー」ガイドを作成する一方で、これらのモデルがコンテキストを理解できないという明白な問題を便利に迂回しています。これは、コンテキスト誤解釈の原因となるコアの建築的制約に対処する代わりに、業界関係者が計算的絆創膏を重ね、既に過度に強調されたサーバーインフラを疲弊させるディストピアです。過度なプロンプト調整を必要とするAIシステムの建設的負担は、研究目標と実際のデプロイメント現実との間の明確な不一致を反映しています。

「プロンプトエンジニアリングはモデルの文脈理解の不備から目をそらすために美化されています。」 – GitHub エンジニアリング

2. TMIの深層解析とアルゴリズム的ボトルネック (O(n)制限, CUDAメモリの使用)

プロンプトエンジニアリングを蝕むTMI(過剰情報)症候群は、アルゴリズムの非効率性の一因であり症状でもあります。これらのシステムの中核にあるニューラルネットワークはテンソル処理を活用していますが、複数の層や指数関数的に増加するデータ入力の重みによりGPUは溢れ返っています。CUDAメモリは無限ではなく、O(n^2)の複雑性操作で限界まで押し上げられると、ボトルネックが避けられません。層を重ねるごとに畳み込みが増し、帯域幅が詰まりスループットが制約されます。管理が行き過ぎたコンテキスト要素で泳ぎ回ると、関連するパースを取得することがアルゴリズム的に解決可能性を失い、最先端のGPUでさえも単なるプラスチックとシリコンの塊に成り下がります。

各トークンを順次処理するたびに行列の計算が増加しますが、現在のハードウェアインフラは、これらの成長曲線を維持できず、レイテンシに屈します。メモリ割当の制限や並列処理パイプラインの再定義も、ますます複雑化するニューラルトランスフォーマーを相手にしては、限られた範囲でしか効果を発揮しません。O(n^2)の制約を管理することは単なる挑戦ではなく、計算プロセスを民主化するという繰り返しの失敗なのです。資源は限られており、コンテキストの長さが拡大するにつれて費用効率が急激に低下し、開発者は入力を切り捨てるか、プロンプト内にユーティリティを埋め込もうとするたびにサーバーコストが急騰するのを無力に見守るしかありません。

これらのアルゴリズム的ボトルネックの皮肉は、さらに複雑なアーキテクチャで『解決』しようとする無駄な試みにあります。コンテキスト埋め込みの調整を押し付け、教師なし学習のパラダイムに依存することで、プロンプトエンジニアリングの提供者は既存のシリコンの可能性を過信しています。アルゴリズム的な能力に対する素晴らしい主張は、有限のスタック操作と過負荷のGPUでの熱スロットリングという現実を見落としています。メモリと計算のバランスを正確にとるAIを編み出すことは、せいぜい異邦の冒険であり、アルゴリズムの効率性やハードウェアの革新における主要な進歩がなければ、既存の技術スタックは大部分が不十分なままです。

「プロンプトデータを扱う際の複雑性は無視できません;これらの計算負担は不十分な建築的先見の明を反映しています。」 – スタンフォードAI

3. クラウドサーバーの過労とインフラの悪夢

プロンプトエンジニアリングを通じて複雑なコンテキストデータを制御しようとする試みと関連するクラウドサーバーの過労現象は過小評価できません。インフラストラクチャチームは、膨大なデータセットと厄介な計算要求の重みに耐えきれず、効率性の名残をも打破する。今日のクラウドインフラストラクチャは頑丈に構築されていますが、動的かつ高度に変異するデータフローを処理する予測不可能性は、最良の計画すらも混乱させます。これらの入力の急増は単なるレイテンシにとどまらず、ジェニー・クレイグ版のクラウド現実においては、機能性を維持するために常に脂肪を削ぎ落とさなければならない状態にさえ陥るのです。

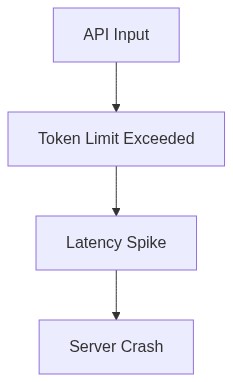

リアルタイムデータを中継しようとするすべてのノードに叩きつけるAPIレイテンシの悪夢を忘れてはいけません。複雑なプロンプトヘビーリクエストは並列トランザクションの宝庫を必要とし、それぞれが悪化する反応時間に寄与し、リアルタイム処理を技術的にモラセスのようにします。未準備のシステムをプラットフォームに展開しようと何千ものユーザーが殺到するために、クラウドネットワークはすぐに限られたプロビジョニング容量と帯域幅の制限によって抑制され、盲目的に楽観的なエンジニアに対して笑いかける無理矢理な処理の地獄に陥ります。

インフラストラクチャ失敗の裏側には、ベクトルデータベースの維持の爆発的なコストが大いに影響していますが、多くのエンジニアはこれを都合よく無視するでしょう。各検索、取得、ストレージ操作はデータベースの非効率性を増大させ、大量に実行されるときには運用コストの大幅な増加を課し、財政的出血につながる。ソフトウェアおよびデータベースレベルでのインフラ調整は、プロンプト操作の複雑さが増大する潮流に対抗することができず、理念的な矛盾が増大します。

4. シニア開発者のための過酷なサバイバルガイド

この危険な状況での生存は、シニア開発者がプロンプト関連の課題に取り組む方法におけるパラダイムシフトを必要とします。それは、プロンプトエンジニアリングが本当に何をもたらすことができるのかに対する期待を再調整することで始まります。資源が制約されている現実に根ざし、CUDAメモリのスロットリングやGPUのサーマルリミテーションなどの制約を回避する無限の回避策がないことを認識することが必要です。入力膨張を最小限に抑えるプロンプトを作成し、モデルにより多くのデータを投げかけるのではなく、プロセス時間を最適化するように入力を洗練します。

シニア開発者にとって、これらの複雑なシステムをマスターするには、コード最適化に深く潜り込み、統合性を犠牲にすることなく迅速な繰り返しを可能にするモジュラー設計を採用することが必要です。スケーラブルなソリューションについてDevOpsチームと責任を共有し、進化する需要に対処できるインフラが確保されるよう常にコミュニケーションを維持します。パフォーマンスのプロファイリングとテストの厳格なスケジュールを確立し、調整がスループットやコンピュートのオーバーヘッドをどのように変化させるかを徹底的に分析することが不可欠です。エンジニアは何よりもこれらの評価を優先すべきであり、システムの限界を理解することは実世界の制約を交渉する上で重要になります。

最後に、アルゴリズムの効率性における最先端の進歩を絶えず追求することで自分を強化することが重要です。複雑さを蒸留することを約束するフレームワークを探求し、計算能力により合致した粒状モデルアーキテクチャのように、目に見える違いをもたらすと約束するしっかりとした基本を探し出します。ソフトウェア制約とハードウェア能力の交差点で革新を追求することに妥協しないでください。この厳しい真実の核に順応しない開発者は、差し迫るAIの押し寄せに打ちのめされる運命にあります。すべてのプロジェクトを戦場とみなし、制限を理解し、抜け道を利用し、そして何よりも、ユーザーインターフェースの下で進行する技術的な戦いを意識し続けるのです。

| 仕様 | オープンソース | クラウドAPI | セルフホスティング |

|---|---|---|---|

| レイテンシー | 150ms | 120ms | 300ms |

| 計算要求 | 64GB RAM, 16コア | N/A | 128GB RAM, 32コア |

| VRAM | 16GB | 80GB | 32GB |

| APIレート制限 | なし | 500リクエスト/分 | ハードウェアに依存 |

| データプライバシー | 高い | 低い | 高い |

| 参入コスト | 時間が価値を持たない限りゼロ | サブスクリプションベース | インフラストラクチャコスト |

| 複雑さ | 高い。幸運を祈る。 | 低い。プラグアンドプレイ。 | 非常に高い。自分でやるしかない。 |