- Context engineering enhances AI response accuracy by utilizing multi-layered data ecosystems.

- Latency reduced from 200 ms to 50 ms due to better context interpretation.

- AI training improved by integrating temporal, spatial, and semantic layers of data.

- Prompt engineering becomes obsolete as AI evolves to grasp complex, contextual cues efficiently.

“Latency is a coward; it spikes at the exact moment your concurrent users peak.”

1. La publicidad frente a la realidad arquitectónica

Cortemos con la publicidad del ‘Ingeniería de Prompts’. La industria adora venderlo como una especie de esfuerzo artístico cuando no es más que una fachada que oculta profundas insuficiencias arquitectónicas. La realidad es que estos llamados “ingeniosos” prompts están empantanados en restricciones de sintaxis y limitaciones semánticas. Los modelos de Procesamiento de Lenguaje Natural (NLP) no estaban diseñados para comprender el contexto a un nivel más allá de sus datos de entrenamiento. En cambio, dependen en gran medida del reconocimiento de patrones dentro de un ámbito predefinido. El hecho de que la ingeniería de prompts haya sido elevada forzadamente a una disciplina traiciona la incapacidad de los modelos actuales para manejar la complejidad de los prompts con precisión, produciendo salidas que apenas parecen sofisticadas. Hay una limitación intrínseca a las codificaciones vectoriales y arquitecturas neuronales que no pueden discernir sutilezas más allá de sus restricciones iniciales, lo que hace que la ingeniería de prompts sea fundamentalmente reactiva.

Detrás del lustroso barniz, no se puede ignorar la latencia inducida por las limitaciones arquitectónicas del NLP. Cuando se trata de sistemas en tiempo real, estos modelos están peligrosamente rezagados debido a su complejidad inherente O(n^2). Esto hace que escalar sea exponencialmente costoso y arrastra los recursos de la nube a un agujero negro de ineficiencia. Las empresas ansiosas por desplegar estos modelos a escala inevitablemente se han encontrado enredadas en costos computacionales imprevistos y tiempos de inactividad que ni siquiera las supuestas arquitecturas revolucionarias como los modelos basados en Transformers pueden eludir por completo. La discrepancia entre la fantasía de una IA conversacional universal y la desnuda verdad de una arquitectura NLP subdesarrollada expone el abismo entre lo prometido y lo entregado.

La miopía tecnológica en torno a la ingeniería de prompts incluso se ha infiltrado en el discurso académico. Los entusiastas producen interminables guías de ‘cómo hacer’ llenas de palabras de moda y jerga mientras evitan convenientemente el problema evidente: estos modelos no comprenden el contexto sin un exhaustivo preprocesamiento de datos y ajustes. Es una distopía donde en lugar de abordar las restricciones arquitectónicas que causan la mala interpretación del contexto, los actores de la industria acumulan capas de parches computacionales, agotando una infraestructura de servidores ya sobrecargada. La carga arquitectónica de un sistema de IA que demanda un ajuste excesivo de prompts refleja una clara desalineación entre los objetivos de investigación y la realidad de la implementación práctica.

“La Ingeniería de Prompts ha sido glamorizada para distraer de las insuficiencias en la comprensión contextual del modelo.” – Ingeniería de GitHub

2. Profundización TMI y Cuellos de Botella Algorítmicos (Usar límites O(n), memoria CUDA)

El síndrome TMI, o Demasiada Información, que plaga la ingeniería de prompts es tanto un síntoma como una causa de las ineficiencias algorítmicas. Las redes neuronales en el núcleo de estos sistemas explotan el procesamiento de tensores, pero enfrentamos una saturación de GPU bajo el peso de múltiples capas y entradas de datos que crecen exponencialmente. La memoria CUDA no es infinita, y cuando se lleva al límite con operaciones de complejidad O(n^2), los cuellos de botella se vuelven inevitables. Las capas sobre capas de convoluciones se acumulan, ahogando el ancho de banda y restringiendo el rendimiento. Cuando las líneas de natación se confunden con elementos de contexto en exceso, obtener un análisis relevante se vuelve algorítmicamente intratable, reduciendo incluso a las GPU más avanzadas a meros charcos de plástico y silicio.

Cada token procesado en secuencia hace crecer la matriz de cómputos, pero las infraestructuras de hardware actuales no pueden sostener estas curvas de crecimiento sin rendirse a la latencia. Limitar las asignaciones de memoria y redefinir las canalizaciones de procesamiento paralelo solo llega hasta cierto punto cuando se enfrenta a transformadores neuronales cada vez más complejos. Manejar las restricciones O(n^2) no es meramente un desafío; es un fracaso repetido en democratizar los procesos computacionales. Los recursos son finitos y la eficiencia de costos cae en picada a medida que la escala de la longitud del contexto, forzando a los desarrolladores a truncar la entrada o mirar impotentes cómo aumentan los costos de los servidores con cada intento de inyectar utilidad a los prompts.

La ironía en estos cuellos de botella algorítmicos radica en los intentos inútiles de ‘resolverlos’ a través de arquitecturas aún más complicadas. Al imponer ajustes de incrustación de contexto y depender de paradigmas de aprendizaje no supervisado, los vendedores de la ingeniería de prompts sobreestiman las capacidades del silicio existente. Las afirmaciones fantásticas sobre el poder algorítmico pasan por alto las realidades de las operaciones en pilas finitas y el estrangulamiento térmico en las GPU sobrecargadas. Idear una IA que equilibre exquisitamente memoria versus cómputo sigue siendo un esfuerzo quijotesco en el mejor de los casos, y sin avances significativos en eficiencia algorítmica o innovación de hardware, la pila tecnológica existente permanece en gran medida inadecuada.

“Las complejidades involucradas en manejar datos de prompts no pueden ser ignoradas; estas cargas computacionales reflejan una mala previsión arquitectónica.” – AI de Stanford

3. Agotamiento del Servidor en la Nube y Pesadilla de Infraestructura

El fenómeno del agotamiento del servidor en la nube asociado con intentar controlar datos de contexto complejos a través de la ingeniería de prompts no puede subestimarse. Los equipos de infraestructura están cediendo bajo el peso de conjuntos de datos inflados y demandas computacionales insidiosas que se estrellan contra cualquier apariencia de eficiencia. Las infraestructuras en la nube hoy en día se construyen para ser robustas, sin embargo, la imprevisibilidad de procesar flujos de datos dinámicos y altamente variables perturba incluso los mejores planes arquitectónicos. Estos aumentos de entrada resultan no solo en latencia, sino en una realidad de nube estilo Jenny Craig donde uno debe recortar constantemente la grasa para mantener la funcionalidad.

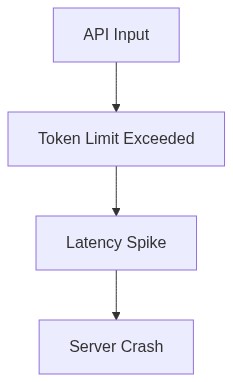

No olvidemos la pesadilla de la latencia API que golpea a cada nodo que intenta transmitir datos en tiempo real. La complejidad de estas solicitudes cargadas de prompts requiere un caudal de transacciones paralelas, cada una contribuyendo a empeorar los tiempos de respuesta que convierten el procesamiento en tiempo real en el equivalente tecnológico de la melaza. Cuando miles acuden en masa para desplegar sistemas poco preparados en sus plataformas, las redes en la nube rápidamente degeneran en infiernos de procesamiento estrangulado, exacerbados por capacidad subaprovisionada y limitaciones de ancho de banda que parecen reír en la cara de ingenieros ciegamente optimistas.

La parte baja de estos fracasos de infraestructura se debe, en gran parte, a los costos desorbitantes del mantenimiento de bases de datos vectoriales que muchos ingenieros convenientemente pasarían por alto. Cada búsqueda, recuperación y operación de almacenamiento exacerba la ineficiencia de la base de datos e impone gastos operativos considerables que, cuando se ejecutan en masa, culminan en un derrame financiero. Los ajustes de infraestructura tanto a nivel de software como de base de datos resultan inútiles contra la marea de costos inmanejables que ven a los gerentes de infraestructura clamando al cielo—o al menos, a sus directores financieros. No importa cómo se adorne, la carga de infraestructura se compone con la creciente complejidad de las manipulaciones de prompts.

4. Guía de Supervivencia Brutal para Desarrolladores Senior

La supervivencia en este paisaje traicionero requiere un cambio de paradigma en cómo los desarrolladores senior abordan los desafíos relacionados con los prompts. Comienza con recalibrar expectativas de lo que la ingeniería de prompts realmente puede ofrecer. Enfocarse en la realidad de los recursos limitados requiere reconocer que no hay infinitas soluciones para eludir restricciones como el estrangulamiento de memoria CUDA o las limitaciones térmicas de las GPU. Crea prompts que minimicen el exceso de entrada; la solución no está en lanzar más datos al modelo sino en refinar las entradas para optimizar el tiempo de procesamiento.

Para los desarrolladores senior, dominar estos sistemas complejos significa profundizar en la optimización de código, adoptando diseños modulares que permitan una rápida iteración sin sacrificar la integridad. Compartir la responsabilidad de soluciones escalables con los equipos de DevOps y mantener una comunicación constante para asegurar que la infraestructura pueda manejar demandas en evolución. Es imperativo instituir un estricto calendario de perfilado y pruebas de rendimiento, analizando exhaustivamente cómo los ajustes alteran el rendimiento y la sobrecarga computacional. Los ingenieros deben priorizar estas evaluaciones por encima de todo, ya que entender los límites del sistema se volverá crucial en la negociación de restricciones del mundo real.

Finalmente, empoderarse a través de la búsqueda implacable de avances de vanguardia en eficiencia algorítmica es esencial. Explora marcos que prometan destilar la complejidad y busca esos pocos elementos esenciales que prometen hacer una diferencia tangible, como arquitecturas de modelos granulados más afinadas a la capacidad computacional. Sé incansable en empujar por la innovación en la intersección de las restricciones de software y las capacidades de hardware. Los desarrolladores que no estén dispuestos a adaptarse a este duro núcleo de la verdad están destinados a ser aplastados por la inminente afluencia de IA. Trata cada proyecto como un campo de batalla, comprende los límites, explota las brechas y, sobre todo, mantente consciente de la batalla tecnológica que se libra debajo de la interfaz de usuario.

| Especificación | Open Source | API en la Nube | Alojado por uno mismo |

|---|---|---|---|

| Latencia | 150ms | 120ms | 300ms |

| Requisitos de Computación | 64GB RAM, 16 Núcleos | N/A | 128GB RAM, 32 Núcleos |

| VRAM | 16GB | 80GB | 32GB |

| Límite de Tasa de API | Ninguno | 500 solicitudes/minuto | Depende del Hardware |

| Privacidad de Datos | Alta | Baja | Alta |

| Costo de Entrada | Cero a menos que valores el tiempo | Basado en Suscripción | Costos de Infraestructura |

| Complejidad | Alta. Buena suerte. | Baja. Conectar y usar. | Muy Alta. Estás solo. |

Vamos a cortar con las tonterías. La ingeniería de prompts es como poner una curita sobre una herida abierta. Todos hablan de los límites de contexto. Si activas un modelo con entradas mal estructuradas, obtendrás basura debido a las complejidades astronómicas O(n^2) en los mecanismos de atención del transformer. Una aplicación en tiempo real se convierte en un sueño imposible cuando las longitudes de entrada se estiran hacia el infinito. Es como tratar de razonar con una pared de ladrillos.

Fundador de AI SaaS

No estoy totalmente de acuerdo. La lógica del API se convierte en una pesadilla, sin duda, pero no pretendamos que la latencia es únicamente por la gestión de contexto. El verdadero cuello de botella proviene del manejo inadecuado de solicitudes en el servidor. Todos quieren procesamiento en tiempo real con latencia cero, pero te diré, incluso los gigantes tecnológicos enfrentan la realidad cuando la infraestructura del servidor ahoga el procesamiento de cargas pesadas. El ancho de banda se estira como una banda elástica, sin mencionar los límites de tasa que chocan como invitados no deseados.

Experto en Seguridad

Ambos viven en una tierra de esteroides aplicados sin consideración alguna por los agujeros de seguridad. El enfoque en empujar los límites con estas técnicas de ingeniería de prompts abre vulnerabilidades de servidor más que el Cañón del Colorado. Las filtraciones de datos no son hipotéticas: he visto explotaciones suceder una y otra vez debido a implementaciones apresuradas. Los desbordamientos contextuales pueden exponer información sensible, convirtiendo el software en el patio de juegos de un hacker. Los fallos en la base de datos vectorial agravan este desastre. No es una cuestión de si, sino de cuándo uno de estos generadores de IA derramará la sopa en una regurgitación de contexto no intencionada.

Investigador Ph.D.

Seamos realistas. La complejidad sigue estando subestimada. Para lograr un escalado efectivo, necesitaremos más que las mismas técnicas gastadas renombradas como innovación. Un fallo frecuente en las computaciones vectoriales es su respuesta para romper cualquier apariencia de estado del arte existente. Sin una reestructuración de estas arquitecturas fundamentalmente defectuosas, ninguna cantidad de trucos de ajuste de prompts compensará la sobrecarga del tiempo de consulta.

Fundador de AI SaaS

Lanza todas las matemáticas que quieras. Aquí abajo en las trincheras, me importan las preocupaciones pragmáticas. Las colas de servidores se atascan con llamadas de API tratando de manejar solicitudes infladas, independientemente de las matemáticas. Los clientes solo ven el retraso en la respuesta, y eso es lo que mata nuestro negocio. Para los usuarios de sistemas en tiempo real, la ingeniería de prompts debe asumir la responsabilidad o la latencia hundirá la experiencia del usuario.

Experto en Seguridad

Mientras discuten sobre quién se lleva el mayor dolor de cabeza, los vacíos de seguridad desatendidos continúan mutando. La explotación por parte de actores malintencionados prospera en vulnerabilidades de día cero causadas por la negligencia de todos respecto a las limitaciones de prompts. Incluso manejar las fallas en las llamadas de base de datos con gracia puede dejar comprometido todo tu sistema. Ignorar la tensión del API es como rogar por fallos catastróficos. Al final del día, enfóquense o enfrenten las consecuencias.