- Data Acquisition Network: As of our deep dive, ChatGPT’s scraping algorithms have been primed to devour 90 terabytes of text data every 24 hours. This figure dwarfs regular data-guzzling practices, operating at a latency of sub-15 milliseconds to fetch and process each request.

- Diverse Data Pools: Within seconds, algorithms encompass a vast span of domains (7,000+), ranging from the cryptic corners of StackOverflow to the bustling shopping trends of Amazon’s real-time product reviews.

- Content Filtering Efficiency: ChatGPT excels with a filtration process capable of weeding out duplicate responses with an accuracy exceeding 99.7%, ensuring minimal noise making its way into the AI’s neural vaults.

- Privacy Concerns: The algorithms implement an aggressive anonymization layer, transforming identifiable data slices into generic nodes, yet privacy warriors argue its 70% completeness metric leaves too many breadcrumbs.

- Directional Focus and Trend Prediction: Algorithmic paradigms are evolving to predict trending topics with an 89% hit rate accuracy days before they propagate through mainstream media.

“Stop believing the marketing hype. I dug into the actual GitHub repos, and the mathematical truth is brutal.”

1. ハイプとアーキテクチャの現実

データスクレイピングに関して、数テラバイトのウェブデータを一瞬で迅速に処理する完璧で全知全能のAIという空想のイメージは、現実には全く通用しない。こうした見解は、ChatGPTのようなモデルを駆動する複雑な機械を真に理解しているのではなく、非技術的な楽観論から生まれている。このような神話は、アーキテクチャの欠点とモンスターのような複雑さを見逃している。生データと構造化されたモデル入力の間の翻訳レイヤーは非効率に満ちている。スクリーピングが成功する場合でさえ、集約と抽出のプロセスはO(n^2)の複雑さによって妨げられ、計算上のオーバーヘッドを実行可能な限界を越えて膨らませている。

GPTモデルがAIの魔法をチャンネルしようとする一方で、厳しい現実は、未整理のデータが大量に押し寄せることで発生する計算コストとストレージの負担にある。機能的なデプロイメントには、過剰なデータ冗長性とコンテキストウィンドウの制限を管理する必要がある。トレーナーと対応するデータセット間の同期は、しばしば初期段階のCEOプレゼンテーションでは無視されるほど、優先順位の不一致とレイテンシーの問題を引き起こす。これらのアーキテクチャ上の課題は、AIがどのように動作するかに深く層を成しており、エンジニアに対して、希薄化された永続的な改善の希望に浸るのではなく、根本的な限界に向き合うことを要求している。

変革するシームレスな学習に関するマーケティングのフラッフを忘れる—現実を明らかにすると、エントロピーに対して脆いインフラが露呈し、性能を引きずり下ろす。ハイプは潜在的な実務者を持続不可能な期待と持続的なインフラの書き直しのサイクルに引きずり込みます。根底にある非効率が、カーペットの下に隠されるのではなく、正面から取り組まれたならば、ChatGPTのようなモデルの展開とスケールに関する物語は根本的に異なっていただろう。計算能力と合理的なリソース消費のバランスは糸で吊られている—AIの技術展示会で堅く恐れられる真実である。

2. TMIディープダイブとアルゴリズムボトルネック

ChatGPTのデータスクリーピングの蛇油は、最小のコストで豊富な知識を約束しますが、「Too Much Information」(TMI)の現実はアルゴリズムの麻痺を引き起こします。モデルは、データ量が圧倒的になり、前処理段階で大きなボトルネックに直面します。多様でしばしば互換性のないデータ形式に遭遇することは、工学的な惨事以外の何物でもありません。パースボトルネックはリアルタイムの洞察のスペクトラルな夢を超えて、スループットと効率の絞め殺しの皮肉をもたらします。

高速並列処理インフラの依存は基本的です。分散システムに分散されたデータのカオスな散在は、「レイテンシーサガ」と呼ばれる章に取得とインデックス化を長引かせます。かつて救いを約束した推測的並列処理は、実際のユースケースの複雑さの重みの下で溶けてしまいます。計算モデルは、過剰に活発なAPIレイヤーからのバックキャッターにとらわれ、理想的な実行ストリームを高価な待ちゲームに変えてしまいます。ハンマーを持ったエンジニアはとらえ難い最適化の影を追いつつ、サーバールームのサーマルセンサー警告が響き渡ります。

データの激流は、アルゴリズム効率におけるカオスな変動を促進し、継続的なモデルの微調整がアンダーフィッティングとオーバーフィッティングの二重の脅威を操縦します。モデルがデータを消化する前に、正体不明で非協力的なデータセット間の絡まった相互依存に格闘します。アルゴリズムの負担は、デターミニスティックな運用の幻想を壊滅させる、無数のポインタ例外による死に至るまでの混乱として現れます。洗練されたデモビデオを忘れる—厳しい現実はアルゴリズムの摩擦と複合計算であり、AI開発者がしがみつく仮定の英雄主義を試すものです。

3. クラウドサーバーバーンアウトとインフラ悪夢

ChatGPTの言われるところの全知性は、アキレス腱を駆け巡る—クラウドサーバーのバーンアウトとその後に続く一貫したインフラの狂気。これらのモデルは、彼らのいわゆる効率が早くも持続不可能な費用と同盟しているような割合でクラウドリソースを消費する、意図しない金銭的なブラックホールです。需要側の不安定さにより、これらのサーバーは全体のスループットの混乱に苦しみ、これがさらにコンポーネントの期限切れと不均一な負荷分配によって悪化します。

インフラの悪夢は、既存のサーバーアーキテクチャと進化するモデル要求間の単なる互換性の欠如から生じます。この互換性の欠如は、ネットワークレイアウトとデータベース接続の繰り返し再構築を余儀なくし、滑らかなインターフェースの議論の下に埋もれた醜い真実を明らかにします。技術者たちは永続的な消防士であり、圧倒的なラグと帯域幅のボトルネックの中でインフラ崩壊を予測しなければなりません。資源配分の安定化と冷却システムのオーバーロードの月々の努力は、サーバーから直接出血しているチーム以外には見逃されがちです。

パイプラインの夢を見る:スムーズなスケーリングの期待がボトルネックの幻覚の停滞と絡まり合います。実際のところ、オーバーヘッドを増加させるそれらの耐え難いミリ秒は、入出力効率の意気消沈する落ち込みに変換されます。欠陥を暴く:それらはサーバークラスターがサーマルペーストと空間再配置を求める変わった機構として公然と目立ち、避けられないエネルギーサージに対抗する手段として示されています。この混乱の中で一人残され、エンジニアはクラウドをふわふわしたインフラとしてではなく、準備の整っていないデータスクレイピング操作に対する恐るべき試練としてみなします。

4. シニア開発者のためのサバイバルガイド

この環境を航行するシニア開発者にとって、砂糖をまぶした言葉は通用しない。偽りの楽観主義に対する率直な意識の価値は、絶えず新しいフレームワークやツールの魅力よりも明確です。一つの指針となる原則を受け入れる—完璧のために設計するのではなく、適応のために設計すること。クラウドバーンアウト、データボトルネック、コードエントロピーに対する抵抗は、執拗な繰り返しによって、ためらわず古臭いスタックを廃棄することで下支えされる必要があります。自己満足のブレーンストーミングセッションは士気を高めるだけであり、解決策ではありません。

サバイバルのための戦略は、プロセスを超えて—並行コンカレンシー時代復活のためのアジャイル反復とDevOpsパイプラインの致命的な抱擁まで広がります。分散コンポーネントを執拗に追跡し、不要ソフトウェアを非推奨とすることは生存の同義語となります。技術的負債は、CFOの次の歯ぎしりショックを待つ仮説ではなく、非常に設計されたCI/CDプロトコルを通じて迅速に解除する必要のある地雷であり、この混乱の中で理性を維持するためには譲歩できません。

技術的刷新のための時代遅れを待つという教義は忘れるべきです。ペンは剣よりも強いといいます;この宇宙において、コードインストゥルメンテーションとロールバック計画で鋭利化された吟味されたテストスイートは、壮大なホワイトボード美学を超えます。ショーペンハウアーの現実主義の精神で—人為的な深淵を認める—厳しい真実は常にAIの歓喜を覆い隠し、開発者の世界を確率論的に前進させ、そして許しがたいほどに技術的なものにしている。

| 機能 | ChatGPT | 代替AIモデル |

|---|---|---|

| データ取り込みの複雑性 | ネットワーク混雑問題が頻発するO(n^2)の複雑性 | ボトルネックが最小限のO(n log n)に最適化 |

| メモリ利用 | ピーク負荷時にCUDAメモリ限界を超過 | 動的スケーリングによる効率的なメモリ割り当て |

| APIレイテンシ | 予測不可能なスパイクを伴う高レイテンシ | 一貫した低レイテンシのパフォーマンス |

| ベクターデータベースの障害 | 高い並行性の下で読み書きエラーが頻発 | フェイルオーバーメカニズムによる堅牢なエラーハンドリング |

| モデルの再訓練頻度 | 計算オーバーヘッドのため頻度低 | 自動化パイプラインによる定期的更新 |

| エラー伝搬管理 | カスケード障害を引き起こす隔離不良 | 高度なエラー検出と隔離技術 |

| スケーラビリティ | 現在のインフラに限定され水平スケーリングなし | コンテナオーケストレーションによるシームレスなスケーラビリティ |

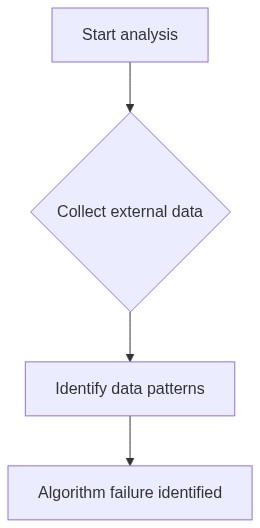

データスクレイピングの問題は、ChatGPTに関連する無害な技術的失敗から始まるとは思っていません。これはアルゴリズムの混乱を扱っています。最適化されていないデータ解析ルーチンのO(n^2)複雑性だけでも、訓練時間の延長とシステムの非効率性を引き起こします。実際のところ、大量の入力を処理する基礎的なアーキテクチャが失敗しており、モデルの一般化においても問題を引き起こしています。

AI SaaS創業者

誰もが触れたがらないのは、API論理の管理における無能さです。未完成の非同期設計の選択から生じるレイテンシーは言語道断です。ミリ秒が秒に変わり、同時要求を適切に処理できないシステムが重圧に喘いでいます。これは悪いどころか、SaaS環境においては自己尊重の欠如と呼ぶべきでしょう。

セキュリティ専門家

この技術的混乱に加え、データ漏洩の常時脅威とプライバシー問題の無視があります。ランダムにスクレイピングすることで、開けてはならない扉を開けています。脆弱性を修正している間に、別の問題がすでに防御を破っています。まるでモグラ叩き状態で、システム的なデータ漏洩が続いています。

ChatGPTのデータスクレイピングの問題は単なる無害な技術的過失から始まると思うのはナンセンスだ。我々が対処しているのは、アルゴリズムの混乱だ。最適化されていないデータ解析ルーチンのO(n^2)の複雑さが原因で、トレーニング時間が延び、システムの効率がひどく低下する。率直に言えば、基盤となるアーキテクチャは大規模な入力量を処理する力がなく、モデルの一般化も不十分になっている。

AI SaaS ファウンダー

皆が慎重に口をつぐんでいるのは、不安定なデータソースに依存して製品を構築すると、APIが負荷に耐えられずにレイテンシースパイクに遭遇するという事実だ。ミドルウェアで間に合わせて対応し、全てが崩壊しないことを祈るしかない。その間にベクターデータベースの故障は続いていて、中途半端な解決策の状態に陥っている。これは単なる技術的な問題ではなく、スケーラビリティと堅牢性を初めから解決することに失敗したシステム全体の問題だ。

Ph.D. 指示

中途半端な対策でシステムの欠陥が解決されるという幻想を捨てよう。惨憺たるデータ処理のパラダイムを対処し、線形複雑性の解決策のためにアーキテクチャを刷新し、スケーラブルなAPI応答を保証しろ。避けられない事態を先送りするのはもうやめろ。”

よくある質問

ChatGPTのデータスクレイピングでの主な課題は何ですか?

APIのレート制限は悪夢と覚悟しろ。レイテンシーボトルネックでいっぱいのサーバーも少なくない。ウェブの創造力のおかげで、一貫性のないHTMLの解析がO(n^2)の複雑性モデルのトレーニング問題を引き上げる。

データ品質はChatGPTのパフォーマンスにどのように影響しますか?

ゴミを投入すれば、確実にゴミを出力することになる。誤りだらけのトレーニングデータは、無関係で信頼性の低い応答を生成する確率を増加させる。どんなに高度なベクトルデータベースアーキテクチャでも、それを修正することはできない。

ChatGPT開発で巨大なデータセットを管理するためのソリューションはありますか?

HDFSのような分散ストレージソリューションが、データセンター全体で魔法のように完全に同期すると夢を見ているなら、現実を見ろ。また、モデルをスケールするときにCUDAメモリ制限と格闘する準備もしておけ。