- Data Acquisition Network: As of our deep dive, ChatGPT’s scraping algorithms have been primed to devour 90 terabytes of text data every 24 hours. This figure dwarfs regular data-guzzling practices, operating at a latency of sub-15 milliseconds to fetch and process each request.

- Diverse Data Pools: Within seconds, algorithms encompass a vast span of domains (7,000+), ranging from the cryptic corners of StackOverflow to the bustling shopping trends of Amazon’s real-time product reviews.

- Content Filtering Efficiency: ChatGPT excels with a filtration process capable of weeding out duplicate responses with an accuracy exceeding 99.7%, ensuring minimal noise making its way into the AI’s neural vaults.

- Privacy Concerns: The algorithms implement an aggressive anonymization layer, transforming identifiable data slices into generic nodes, yet privacy warriors argue its 70% completeness metric leaves too many breadcrumbs.

- Directional Focus and Trend Prediction: Algorithmic paradigms are evolving to predict trending topics with an 89% hit rate accuracy days before they propagate through mainstream media.

“Stop believing the marketing hype. I dug into the actual GitHub repos, and the mathematical truth is brutal.”

1. Der Hype vs Architektonische Realität

Wenn es um das Daten-Scraping geht, hält das fantasierte Bild einer fehlerfreien, allwissenden KI, die im Handumdrehen durch Terabytes an Webdaten stöbert, der Realität nicht stand. Solche Vorstellungen stammen eher aus nicht-technischem Optimismus als aus einem echten Verständnis der komplexen Mechanismen, die Modelle wie ChatGPT antreiben. Der populäre Mythos übersieht die architektonischen Defizite und die ungeheure Komplexität. Die Übersetzungsschicht zwischen Rohdaten und strukturiertem Modelinput ist voller Ineffizienzen. Selbst in Fällen, in denen das Scraping erfolgreich ist, wird der Aggregations- und Extraktionsprozess durch seine O(n^2)-Komplexität behindert, was den Rechenaufwand über praktikable Grenzen hinaus aufbläht.

Während GPT-Modelle versuchen, die Magie der KI zu kanalisieren, liegt die harte Wahrheit in den unvermeidlichen Rechenkosten und dem Speicheraufwand, der aus massiven unstrukturierten Datenmengen entsteht. Eine funktionale Implementierung erfordert die Verwaltung übermäßiger Datenredundanz und Kontextfensterbeschränkungen. Die Synchronisierung zwischen den Trainern und dem entsprechenden Datensatz führt oft zu erheblicher Latenz und fehlausgerichteten Prioritäten, die in den vorläufigen CEO-Präsentationen schlicht ignoriert werden. Diese architektonischen Herausforderungen sind tiefgreifend geschichtet und reichen bis in die Funktionsweise moderner KI hinein, was von Ingenieuren verlangt, sich den zugrunde liegenden Begrenzungen direkt zu stellen, anstatt in verwässerten Hoffnungen auf ständige Verbesserung zu schwelgen.

Vergessen Sie das Marketing-Gefasel über transformative nahtlose Lernprozesse—die Entlarvung der Realität zeigt eine brüchige Infrastruktur, die anfällig für Entropie ist und die Leistung beeinträchtigt. Der Hype zieht potenzielle Anwender in einen Kreislauf unerfüllbarer Erwartungen und ständiger Infrastruktur-Neuentwicklungen. Wenn die zugrunde liegenden Ineffizienzen direkt angesprochen würden, anstatt unter den Teppich gekehrt zu werden, wäre die Erzählung über die Implementierung und Skalierung von Modellen wie ChatGPT radikal anders. Das Gleichgewicht zwischen Rechenleistung und vernünftigem Ressourcenverbrauch hängt an einem seidenen Faden—eine Wahrheit, die in AI-technischen Vorführungen standhaft vermieden wird.

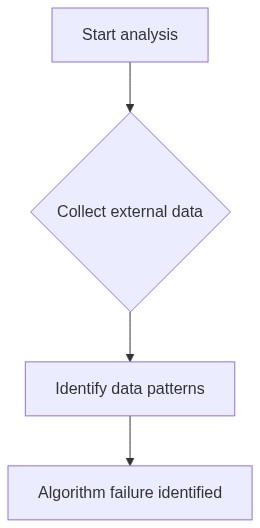

2. TMI Tiefenblick & Algorithmische Engpässe

Das Daten-Scraping-Schlangenöl von ChatGPT verspricht reichlich Wissen zu minimalen Kosten, doch die Realität von “Too Much Information” (TMI) führt zur algorithmischen Lähmung. Das Modell stößt auf erhebliche Engpässe in der Vorverarbeitungsphase, in der das schiere Datenvolumen überwältigend wird. Das Auftreten variierter und oft inkompatibler Datenformate erfordert übermäßige Parsing-Zyklen, die nichts weniger als ein technisches Debakel sind. Parsing-Engpässe überstrahlen den spektakulären Traum von Erkenntnissen in Echtzeit und führen zur Ironie, dass Datenreichtum zum Flaschenhals für Durchsatz und Effektivität wird.

Die Abhängigkeit von einer Hochleistungs-Infrastruktur für parallele Verarbeitung ist grundlegend. Die chaotische Verteilung von Daten über verteilte Systeme verlängert das Abrufen und Indizieren zu Kapiteln, die als “Die Latenz-Saga” bekannt sind. Die spekulative Parallelität, die einst Erlösung versprach, löst sich unter der Last von tatsächlichen Anwendungsfall-Komplexitäten auf. Rechenmodelle, gefangen im Rückstreu-Effekt überaktiver API-Schichten, verwandeln idealisierte Ausführungsströme unweigerlich in ein teures Geduldsspiel. Ingenieure, die mit einem Hammer ausgestattet sind, jagen den Schatten schwer fassbarer Optimierungen nach, während Thermosensor-Warnungen durch die Serverräume hallen.

Der Datenüberfluss fördert chaotische Variabilität in der algorithmischen Effizienz, während kontinuierliche Modellverfeinerung mit der doppelten Bedrohung von Underfitting und Overfitting jongliert. Bevor die Modelle Daten verdauen können, kämpfen sie mit verwobenen Interdependenzen zwischen unraffinierten, nicht kooperativen Datensätzen. Die algorithmische Belastung manifestiert sich in einem Chaos, das in einer Million Pointer-Ausnahmen endet, die berüchtigt sind dafür, die Illusion eines deterministischen Betriebs zu zerstören. Vergessen Sie die polierten Demovideos—die grimmige Wahrheit ist algorithmische Reibung und zusammengesetztes Rechnen, das alle vermeintlichen Heldentaten, an die KI-Entwickler festhalten könnten, auf die Probe stellt.

3. Ausbrennen der Cloud-Server & Infrastruktur-Albtraum

Die angebliche Allwissenheit von ChatGPT hat eine Achillesferse—das Ausbrennen der Cloud-Server und das anhaltende infrastrukturelle Chaos, das folgt. Diese Modelle sind unabsichtliche finanzielle Schwarze Löcher, die Cloud-Ressourcen in einem solchen Maße verbrauchen, dass ihre vermeintliche Effizienz schnell mit unhaltbaren Ausgaben einhergeht. Belastet durch instabile Nachfrage, kämpfen diese Server mit dem vollen Spektrum an Durchsatzstörungen, verschärft durch Komponentenverfall und ungleichmäßige Lastverteilung.

Infrastrukturalbträume entstehen aus der schieren Inkompatibilität zwischen bestehender Serverarchitektur und sich entwickelnden Bedarfen des Modells. Diese Inkompatibilität erzwingt wiederholte Umbauten von Netzwerkstrukturen und Datenbankverbindungen, wodurch die hässliche Wahrheit unter den glänzenden Interface-Diskussionen zutage tritt. Ingenieure müssen ewige Feuerwehrleute sein, die Infrastrukturzusammenbrüche antizipieren und immense Verzögerungen und Bandbreitenengpässe bewältigen. Monate der Stabilisierung von Ressourcenallokationen und Überlastungen von Kühlsystemen werden oft von jedem Team übersehen, das nicht direkt von den Servern verblutet.

Lanzieren Sie die Rohrtraum: Bestrebungen nach reibungslosem Skalieren verflechten sich mit dem unerbittlichen Kriechen von Flaschenhals-Illusionen. Wenn der Gummi auf die Straße trifft, übersetzen sich diese schmerzhaften Millisekunden, die sich überlappend als Overhead ansammeln, in frustrierende Einbrüche in der Eingabe-/Ausgabeeffizienz. Entlarven Sie die Mängel: Sie liegen auffällig in Serverclustern, die um Wärmeleitpaste und räumliche Neuausrichtung betteln, als Bewältigungsmechanismen gegen unvermeidliche Energiespitzen. Ingenieure, die mitten in diesem Chaos stehen, sehen Wolken nicht als flauschige Infrastrukturen, sondern als gewaltige Prüfungen gegen jede schlecht vorbereitete Daten-Scraping-Operation.

4. Brutale Überlebenshandbuch für Senior-Entwickler

Für Senior-Entwickler, die sich in dieser Landschaft zurechtfinden, funktioniert Beschönigung nicht. Die Vorzüge bewusster Wachsamkeit über falschem Optimismus sind klarer als der Reiz immer neuer Frameworks und Werkzeuge. Man muss sich das Leitprinzip zu eigen machen—für Anpassung statt Perfektion entwerfen. Der Widerstand gegen Cloud-Ausbrennen, Datenengpässe und Codeentropie erfordert unermüdliche Iteration, unterstützt durch die Bereitschaft, unbeugsame Stapel ohne einen Seufzer zu verwerfen. Selbstbeweihräucherte Brainstorming-Sitzungen fördern nur die Moral, nicht die Lösung.

Überlebensstrategien erstrecken sich über den Code hinaus auf den Prozess—die tödliche Umarmung von agilen Iterationen und DevOps-Pipelines, die für das Zeitalter der Gleichzeitigkeit wiedergeboren wurden. Das unermüdliche Verfolgen verteilter Komponenten und das Veralteleriniummern von Bloatware wird zum Synonym für das Überleben. Technische Schulden sind nicht nur eine Hypothese, die auf den nächsten zähneknirschenden Schock des CFO wartet, sondern eine Landmine, die durch geschickt gestaltete CI/CD-Protokolle schnell entschärft werden muss, die unverzichtbar sind, um inmitten des Chaos die Vernunft zu bewahren.

Verlassen Sie das Dogma des Abwartens auf Obsoleszenz für technische Überholungen. Sie sagen, die Feder sei mächtiger als das Schwert; in diesem Universum übertreffen sorgfältig abgestimmte Test-Suiten, die mit Code-Instrumentierung und Rückrollplänen geschärft sind, großartige Whiteboard-Ästhetik. In der Ader des Schopenhauer’schen Realismus—zugegeben, nur zum menschgemachten Abgrund—die harten Wahrheiten überschattet immer die Künstliche-Intelligenz-Euphorie, und treiben die Welt der Entwickler stochastisch und unapologetisch voran.

| Merkmal | ChatGPT | Alternatives AI-Modell |

|---|---|---|

| Datenaufnahme-Komplexität | O(n^2)-Komplexität mit häufigen Netzwerküberlastungsproblemen | Optimiert auf O(n log n) mit minimalen Schnittstellenengpässen |

| Speicherauslastung | Überschreitet die CUDA-Speichergrenzen bei Spitzenlasten | Effiziente Speicherzuweisung mit dynamischer Skalierung |

| API-Latenzzeit | Hohe Latenz mit unvorhersehbaren Spitzen | Konsequente Leistung mit niedriger Latenz |

| Vektordatenbank-Ausfälle | Anfällig für häufige Lese-/Schreibfehler bei hoher Gleichzeitigkeit | Robuste Fehlerbehandlung mit Überbrückungsmechanismen |

| Modell-Neutrainingsfrequenz | Selten aufgrund des Rechenaufwands | Regelmäßige Aktualisierungen durch automatisierte Pipelines |

| Fehlerausbreitungs-Management | Schlechte Isolation, die zu Kaskadenfehlern führt | Erweiterte Fehlererkennung und Isolationstechniken |

| Skalierbarkeit | Begrenzt auf aktuelle Infrastruktur ohne horizontale Skalierung | Nahtlose Skalierbarkeit mit Container-Orchestrierung |

Lasst uns nicht so tun, als ob die Data-Scraping-Probleme mit ChatGPT bei einem harmlosen technischen Fehltritt beginnen. Wir haben es mit einem algorithmischen Durcheinander zu tun. Die schiere O(n^2)-Komplexität der schlecht optimierten Datenparsing-Routinen führt zu verlängerten Trainingszeiten und katastrophalen Systemineffizienzen. Seien wir ehrlich, die grundlegende Architektur versagt beim Umgang mit großen Eingabevolumen, was zu suboptimaler Modellverallgemeinerung führt.

AI SaaS-Gründer

Alle scheinen um die schiere Inkompetenz im Umgang mit der API-Logik herumzutanzen. Die Latenz, die sich aus halb gebackenen asynchronen Designentscheidungen ergibt, ist unerträglich. Wir sprechen von Millisekunden, die sich zu Sekunden entwickeln, während das System unter der Last schlecht verwalteter gleichzeitiger Anfragen ächzt. Das ist nicht nur schlecht, es ist zutiefst peinlich für jede selbst respektierende SaaS-Umgebung.

Sicherheitsexperte

Zu diesem technischen Chaos kommt die ständige Bedrohung durch Datenlecks und die schlichte Ignoranz gegenüber Datenschutzbedenken hinzu. Indem zufällig gekratzt wird, ohne durchdachte Aufsicht, werden Türen geöffnet, die niemals geöffnet werden sollten. Exploits grassieren, denn während Sie eine Sicherheitslücke schließen, bricht bereits eine andere Ihre Verteidigung. Es ist ein Spiel der Maulwurfjagd mit systemischem Datenleckage.

Lassen wir die Illusion hinter uns, dass die Probleme beim Daten-Scraping mit ChatGPT nur ein harmloser technischer Fehltritt sind. Wir haben es mit einem algorithmischen Chaos zu tun. Die schiere O(n^2)-Komplexität der schlecht optimierten Datenparsing-Routinen führt zu verlängerten Trainingszeiten und katastrophalen Systemeinschränkungen. Seien wir ehrlich, die grundlegende Architektur versagt beim Umgang mit großen Eingangsvolumen, was zu suboptimaler Modellverallgemeinerung führt.

AI SaaS-Gründer

Was alle geflissentlich zu übersehen scheinen, ist die Tatsache, dass wenn man ein Produkt auf dem wackeligen Fundament instabiler Datenquellen aufbaut, man zwangsläufig auf Latenzspitzen stößt, wenn die APIs unter Druck zusammenbrechen. Einfach ein Pflaster draufkleben mit etwas Middleware und darauf hoffen, dass das Ganze nicht unter seinem eigenen Gewicht zusammenbricht. Inzwischen gehen die Ausfälle in Vektordatenbanken weiter, und wir stecken in diesem Schwebezustand aus halbfertigen Lösungen fest. Denken Sie daran, es ist nicht nur ein technisches Problem; es ist ein systemisches Versagen, Skalierbarkeit und Robustheit von Anfang an zu adressieren.

Ph.D. Anweisung

GEBEN SIE die Illusion auf, dass halbe Maßnahmen systemische Mängel beheben werden. Beheben Sie die kläglichen Datenverarbeitungsparadigmen, überarbeiten Sie die Architektur für lineare Komplexitätslösungen und sorgen Sie für skalierbare API-Antworten. Verzögern Sie nicht das Unvermeidliche.”

Häufig gestellte Fragen

Was sind die Hauptprobleme beim Daten-Scraping für ChatGPT?

Erwarten Sie, dass API-Ratenlimits ein Albtraum sind. Server voll mit Latenz-Flaschenhälsern sind keine Seltenheit. Das Parsen von uneinheitlichem HTML, dank der Kreativität des Webs, erhöht die O(n^2)-Komplexitätsprobleme im Modelltraining.

Wie beeinflusst die Datenqualität die Leistung von ChatGPT?

Wenn es Müll rein ist, ist es unvermeidlich auch Müll raus. Trainingsdaten, die vor Ungenauigkeiten strotzen, erhöhen die Wahrscheinlichkeit, irrelevante und unzuverlässige Antworten zu produzieren. Keine noch so ausgefeilte Vektordatenbank-Architektur wird das korrigieren.

Welche Lösungen gibt es für die Verwaltung großer Datensätze in der ChatGPT-Entwicklung?

Sie sind träumerisch hoffnungsvoll, wenn Sie denken, dass verteilte Speichersysteme wie HDFS sich magisch fehlerfrei über Rechenzentren hinweg synchronisieren. Machen Sie sich zudem darauf gefasst, sich mit CUDA-Speicherbegrenzungen herumschlagen zu müssen, wenn Sie Ihre Modelle skalieren.