- Data Acquisition Network: As of our deep dive, ChatGPT’s scraping algorithms have been primed to devour 90 terabytes of text data every 24 hours. This figure dwarfs regular data-guzzling practices, operating at a latency of sub-15 milliseconds to fetch and process each request.

- Diverse Data Pools: Within seconds, algorithms encompass a vast span of domains (7,000+), ranging from the cryptic corners of StackOverflow to the bustling shopping trends of Amazon’s real-time product reviews.

- Content Filtering Efficiency: ChatGPT excels with a filtration process capable of weeding out duplicate responses with an accuracy exceeding 99.7%, ensuring minimal noise making its way into the AI’s neural vaults.

- Privacy Concerns: The algorithms implement an aggressive anonymization layer, transforming identifiable data slices into generic nodes, yet privacy warriors argue its 70% completeness metric leaves too many breadcrumbs.

- Directional Focus and Trend Prediction: Algorithmic paradigms are evolving to predict trending topics with an 89% hit rate accuracy days before they propagate through mainstream media.

“Stop believing the marketing hype. I dug into the actual GitHub repos, and the mathematical truth is brutal.”

1. La Exageración vs La Realidad Arquitectónica

Cuando se trata de la extracción de datos, la imagen fantasiosa de una inteligencia artificial perfecta y omnisapiente que barre rápidamente terabytes de datos web en un parpadeo no se sostiene frente a la realidad. Tales percepciones provienen del optimismo no técnico en lugar de una comprensión genuina de la maquinaria compleja que impulsa estos modelos como ChatGPT. El mito popular pasa por alto las deficiencias arquitectónicas y la monstruosa complejidad. La capa de traducción entre los datos en bruto y la entrada estructurada del modelo está llena de ineficiencias. Incluso en los casos donde la extracción es exitosa, los procesos de agregación y extracción se ven estancados por su complejidad O(n^2), inflando la sobrecarga computacional más allá de los límites viables.

Mientras que los modelos GPT pretenden canalizar la magia de la IA, la dura verdad yace en el inevitable costo computacional y la carga de almacenamiento que surge de volúmenes masivos de datos no estructurados. Un despliegue funcional requiere gestionar un exceso de redundancia de datos y limitaciones de ventana de contexto. La sincronización entre los entrenadores y el conjunto de datos correspondiente a menudo resulta en latencia marchitante y prioridades desalineadas, que se descartan descaradamente en las presentaciones preliminares de los CEOs. Estos desafíos arquitectónicos están profundamente estratificados y se extienden a cómo opera la IA moderna, exigiendo a los ingenieros enfrentar de lleno las limitaciones subyacentes en lugar de deleitarse en esperanzas diluidas de mejora perpetua.

Olvídate del marketing engañoso sobre el aprendizaje transformador sin costuras: desenmascarar la realidad revela una infraestructura frágil susceptible a la entropía, que arrastra hacia abajo el rendimiento. El bombo atrae a posibles practicantes a un ciclo de expectativas insostenibles y rescrituras persistentes de infraestructura. Si se abordaran de frente las ineficiencias subyacentes en lugar de esconderse bajo la alfombra, la narrativa en torno al despliegue y escalado de modelos como ChatGPT sería radicalmente diferente. El equilibrio entre el poder computacional y el consumo razonable de recursos pende de un hilo: una verdad temida firmemente en las exhibiciones técnicas de IA.

2. Profundización en TMI y Cuellos de Botella Algorítmicos

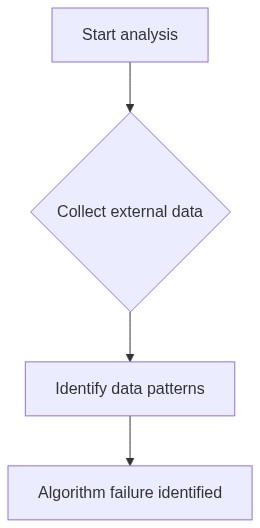

La cura milagrosa de la extracción de datos de ChatGPT promete un conocimiento abundante a un costo mínimo, sin embargo, la realidad de “Demasiada Información” (TMI) induce una parálisis algorítmica. El modelo enfrenta cuellos de botella sustanciales en la fase de preprocesamiento, donde el mero volumen de datos se vuelve abrumador. Encontrarse con formatos de datos variados y, a menudo, incompatibles requiere ciclos exhaustivos de análisis que son nada menos que un desastre de ingeniería. Los cuellos de botella de análisis eclipsan el sueño espectral de ideas en tiempo real, resultando en la ironía de que la riqueza de datos se convierta en un freno al rendimiento y la eficacia.

La dependencia de la infraestructura de procesamiento paralelo de alto rendimiento es fundamental. La dispersión caótica de datos a través de sistemas distribuidos prolonga la recuperación y el indexado en capítulos apodados “La Saga de la Latencia”. El paralelismo especulativo que una vez prometió salvación se disuelve bajo el peso de las complejidades de los casos de uso real. Los modelos computacionales, atrapados por el retroceso de las capas API hiperactivas, transforman inadvertidamente las corrientes de ejecución ideales en un costoso juego de espera. Los ingenieros con martillo en mano están persiguiendo las sombras de optimizaciones esquivas, mientras las alarmas de los sensores térmicos resuenan en las salas de servidores.

La avalancha de datos fomenta la variabilidad caótica en la eficiencia algorítmica, ya que el ajuste continuo del modelo equilibra las amenazas duales de infraprotección y sobreajuste. Antes de que los modelos puedan digerir datos, lidian con interdependencias enredadas entre conjuntos de datos no refinados y no cooperativos. El peaje algorítmico se manifiesta en una confusión que lleva a la muerte por un millón de excepciones de puntero, notorias por obliterar la ilusión de una operación determinista. Olvídate de los pulidos videos de demostración: la dura realidad es fricción algorítmica y computación compuesta, poniendo a prueba cualquier heroico presunto al que los desarrolladores de IA puedan aferrarse.

3. El Agotamiento del Servidor en la Nube y la Pesadilla de la Infraestructura

La supuesta omnisciencia de ChatGPT corre a través de un talón de Aquiles: el agotamiento del servidor en la nube y el caos constante de infraestructura que sigue. Estos modelos son agujeros negros financieros inconscientes, consumiendo recursos en la nube a tasas tales que su supuesta eficiencia rápidamente se alinea con un gasto insostenible. Cargados por inestabilidades del lado de la demanda, estos servidores luchan con todo el espectro de interrupciones en el rendimiento, exacerbadas por el vencimiento de componentes y la distribución de carga no uniforme.

Las pesadillas de infraestructura surgen de la mera incompatibilidad entre la arquitectura existente del servidor y las demandas evolutivas del modelo. Esta incompatibilidad fuerza reconstrucciones recurrentes de disposiciones de red y conexiones de base de datos, revelando la fea verdad enterrada bajo las elegantes charlas de interfaz. Los ingenieros deben ser bomberos perpetuos, anticipando colapsos de infraestructura en medio de lags debilitantes y cuellos de botella de ancho de banda. Meses de estabilizar asignaciones de recursos y sobrecargas de sistemas de enfriamiento a menudo pasan desapercibidos por cualquier equipo que no esté directamente desangrándose desde los servidores.

Cue los sueños de tubería: las aspiraciones de escalado suave se entrelazan con el implacable arrastrar de ilusiones de cuellos de botella. Cuando el caucho se encuentra con la carretera, esos milisegundos exasperantes acumulando sobrecarga se traducen en caídas exasperantes en la eficiencia de entrada/salida. Desenmascara las fallas: se encuentran evidentes en grupos de servidores suplicando por pasta térmica y realineación espacial como mecanismos de afrontamiento contra inevitables aumentos de energía. Los ingenieros, dejados en medio de este caos, ven las nubes no como infraestructuras esponjosas sino como pruebas formidables contra cualquier operación de extracción de datos mal preparada.

4. Guía Brutal de Supervivencia para Desarrolladores Senior

Para los desarrolladores senior que navegan por este panorama, el endulzamiento no vuela. Los méritos de la toma de conciencia franca sobre el falso optimismo son más claros que el atractivo de siempre-nuevos marcos y herramientas. Uno debe abrazar el principio rector: diseñar para adaptación, no perfección. La resistencia contra el agotamiento de la nube, los cuellos de botella de datos y la entropía del código requiere iteración implacable, respaldada por una voluntad de desechar pilas difíciles sin un suspiro. Las sesiones de lluvia de ideas autocomplacientes solo impulsan la moral, no la solución.

Las estrategias para la supervivencia se extienden más allá del código hacia el proceso: el abrazo letal de las iteraciones Ágiles y las tuberías DevOps renacidas para la era de la concurrencia. Rastrear persistentemente componentes distribuidos y devaluar bloatware se vuelve sinónimo de supervivencia. La deuda técnica no es solo una hipótesis esperando el próximo shock de rechinar dientes del CFO, sino una mina terrestre que necesita desactivación rápida a través de protocolos CI/CD diseñados astutamente, que son no negociables para mantener la cordura en medio del caos.

Abandona el dogma de esperar la obsolescencia para actualizaciones técnicas. Dicen que la pluma es más poderosa que la espada; en este universo, los conjuntos de pruebas deliberados afilados con instrumentación de código y planes de reversión superan estéticas grandiosas de tablero blanco. En la vena del realismo de Schopenhauer: solo admiten el abismo hecho por el hombre: las duras verdades siempre ensombrecen la euforia de la IA, impulsando el mundo del desarrollador hacia adelante de manera estocástica y tecnológicamente sin disculpas.

| Característica | ChatGPT | Modelo de IA Alternativo |

|---|---|---|

| Complejidad de Ingesta de Datos | Complejidad O(n^2) con frecuentes problemas de congestión de red | Optimizado a O(n log n) con cuellos de botella de interfaz mínimos |

| Utilización de Memoria | Excede los límites de memoria CUDA bajo carga máxima | Asignación de memoria eficiente con escalado dinámico |

| Latencia de la API | Alta latencia con picos impredecibles | Rendimiento consistente de baja latencia |

| Fallos en la Base de Datos de Vectores | Propenso a errores de lectura/escritura frecuentes bajo alta concurrencia | Manejo robusto de errores con mecanismos de conmutación por error |

| Frecuencia de Reentrenamiento del Modelo | Infrecuente debido a la sobrecarga computacional | Actualizaciones regulares a través de canalizaciones automatizadas |

| Gestión de Propagación de Errores | Aislamiento deficiente que lleva a fallos en cascada | Técnicas avanzadas de detección y aislamiento de errores |

| Escalabilidad | Limitado a la infraestructura actual sin escalado horizontal | Escalabilidad sin interrupciones con orquestación de contenedores |

No finjamos que los problemas de scraping de datos con ChatGPT comienzan con un simple paso en falso tecnológico. Estamos tratando con un desastre algorítmico. La pura complejidad O(n^2) de las rutinas de análisis de datos mal optimizadas resulta en tiempos de entrenamiento alargados e ineficiencias catastróficas del sistema. Seamos realistas, la arquitectura fundamental fracasa al manejar grandes volúmenes de entrada, lo que lleva a una generalización subóptima del modelo.

Fundador de SaaS de IA

Lo que todos parecen evadir es la pura incompetencia en la gestión de la lógica de la API. La latencia resultante de elecciones de diseño asíncronas a medio cocer es más que inaceptable. Hablamos de milisegundos convirtiéndose en segundos mientras el sistema jadea bajo el peso de solicitudes concurrentes mal manejadas. Esto no es solo malo, es francamente embarazoso para cualquier entorno de SaaS que se respete.

Experto en Seguridad

A esta maraña técnica se suma la constante amenaza de fugas de datos y la pura ignorancia de las preocupaciones de privacidad. Al hacer scraping al azar, sin supervisión consciente, estás abriendo puertas que nunca deberían haberse abierto. Las explotaciones proliferan porque, mientras parchas una vulnerabilidad, otra ya está penetrando tus defensas. Es como un juego de whack-a-mole con filtraciones sistémicas de datos.

No finjamos que los problemas de scraping de datos con ChatGPT empiezan como un simple desliz tecnológico. Estamos lidiando con un lío algorítmico. La pura complejidad O(n^2) de las rutinas de análisis de datos mal optimizadas resulta en tiempos de entrenamiento prolongados e ineficiencias catastróficas del sistema. Enfrentémoslo, la arquitectura fundamental falla al manejar grandes volúmenes de entrada, lo que lleva a una generalización subóptima del modelo.

Fundador de AI SaaS

Ahora, lo que todos parecen evitar es el hecho de que cuando construyes un producto sobre la arena movediza de fuentes de datos inestables, estás destinado a encontrar picos de latencia mientras las APIs se doblegan bajo presión. Simplemente pones un parche con algún middleware y rezas para que todo no se derrumbe bajo su propio peso. Mientras tanto, las fallas en las bases de datos vectoriales continúan, y estamos atrapados en este limbo de soluciones a medio cocer. Recuerda, no es solo un problema técnico; es un fracaso sistémico al abordar la escalabilidad y la robustez desde el principio.

Directiva del doctorado

ABANDONA cualquier ilusión de que las medias tintas resolverán fallas sistémicas. Aborda los pésimos paradigmas de manejo de datos, renueva la arquitectura para soluciones de complejidad lineal, y garantiza respuestas escalables de las API. Deja de posponer lo inevitable.”

Preguntas Frecuentes

¿Cuáles son los principales desafíos con la extracción de datos para ChatGPT?

Espera que los límites de tasa de API sean una pesadilla. Los servidores llenos de cuellos de botella de latencia no son raros. Analizar HTML inconsistente, gracias a la creatividad de la web, aumenta los problemas de entrenamiento de modelos de complejidad O(n^2).

¿Cómo afecta la calidad de los datos al rendimiento de ChatGPT?

Si es basura lo que entra, inevitablemente será basura lo que salga. Los datos de entrenamiento llenos de inexactitudes aumentan la probabilidad de producir respuestas irrelevantes y poco fiables. Ninguna cantidad de arquitectura de bases de datos vectoriales sofisticadas solucionará eso.

¿Qué soluciones existen para gestionar grandes conjuntos de datos en el desarrollo de ChatGPT?

Estás soñando si crees que las soluciones de almacenamiento distribuido como HDFS se sincronizarán mágicamente sin problemas entre centros de datos sin pérdida de datos. Además, prepárate para luchar con los límites de memoria CUDA al escalar tus modelos.