- ChatGPT uses a vast array of scraping algorithms that rival a digital heat-seeking missile, acquiring terabytes of data from web pages while maintaining a latency that can dip below 200ms.

- The system’s efficiency is like clockwork, optimizing data collection through a Dynamic Rate Limiter that converts web metadata into actionable chunks with sub-100ms response times.

- Advanced filtering mechanisms strip out duplication noise and enhance content precision by up to 92%, minimizing redundancy during the scraping process.

- Machine learning assisted algorithms prioritize data using a hybrid relevancy index system, ensuring fidelity and topical accuracy with a fluctuation range error under 0.08%.

- Despite mind-bending capabilities, it operates under a bound 2-layer consent framework that stumbles occasionally, leading to data subject compliance issues that rise to 7%.

- While bewilderingly efficient at gobbling webpages, it faces a data ingestion limit that caps around 4TB per cycle, enforced to prevent tech Leviathanism.

“Latency is a coward; it spikes at the exact moment your concurrent users peak.”

1. 誇大広告とアーキテクチャの現実

ChatGPTの能力の宣伝を信じれば、OpenAIがデータ処理力の神秘的な源を解き放ったと思うだろう。申し訳ないが、バブルを壊すことになる。アーキテクチャの現実は、例によって冷酷な計算の制約に基づいている。最適化が不十分なトランスフォーマーレイヤーの一部では、O(n^3)の効率ボトルネックによりシステムが窒息している。『高度なニューラル計算』というマーケティングスピンを忘れてほしい。おそらく見ているのは、基本的なAPIの遅延問題への複雑な応急処置の網目構造だ。

さらに、初心なユーザーを驚かせるような自然言語理解を達成するためには、大規模な多次元テンソル計算が必要だ。これはAIの魔法ではなく、限られたGPUスループットのソーセージグラインダーに巨大な行列操作を押し込むようなものだ。特に並列処理が慎重に最適化されていない状況では、CUDAのメモリー制限がトラックのように襲いかかる。申し訳ないが、GPUのGBが往々にして膨らんだ中間テンソルに費やされることが多く、洞察抽出には至らないことが多い。

そして、誰もが大好きな「リアルタイム」性能ベンチマークを取り上げるとしよう。派手な紹介なしに、繰り返しのパラメーターチューニングとモデル再トレーニングが、データ削減戦略における実際の革新なしに常に膨らむデータを取り込む。結果として生産されるシステムは、途切れない、別々のデータ要求の急流の中で過剰に税金をかけられたCPUのように動作する。驚くことに、システムが独自のアーキテクチャにつまずかずに水平にスケールできない場合、リアルタイムは比較的な用語になる。

2. TMIディープダイブとアルゴリズムのボトルネック

無知な人々はChatGPTのデータ取り込みを洞察のための真空のように考えるが、それはむしろ無限の再帰ループの内部に閉じ込められた巨大な溜まり屋に近い。初期段階のデータベクトル化は大きなデータセットをML入力用に最適化するとされているが、現実には多くのシステムが、原始の入力ベクトルをニューラル回路が解釈可能なものに処理しようとする際に、二次時間複雑性の悪魔によって苦しめられる。

トークン化の非効率性は別の獣であり、多くのNLPパイプラインは、不規則なトークンチャンクニングによって生成される文脈スイッチングの膨大な量の下で溺れている。これらのトークンストリームを処理することは、90年代のハードウェアで動作しているかのようなアルゴリズム的な詰まり点を引き起こす。ここでの遅延は些細なものではなく、複数のPassが必要なメモリバウンドなワークロードで累積され、PageRankスタイルの意味的重み付け調整を通過する。

そして、バックプロパゲーション時のモデル訓練における逐次的依存関係はもちろん怒り狂う。GPUスレッドは、コードコンパイルステージで壮観に誤処理された曖昧化レイヤーで解決すべきクリティカルセクションのボトルネックに向かって突っ走る。効率的な文脈抽出のブレークスルーを達成する代わりに、システムは同期ロックインを広く抑制するために追加リソースの割り当てにばかばかしいほど時間を費やす。

3. クラウドサーバーバーンアウトとインフラストラクチャの悪夢

クラウド処理を無限のセーフガードと見なしている人は、彼らのクラウド宗教を再考すべきだ。ChatGPTのワークロードでは、クラウドサーバーバーンアウトは珍しくない。想像してみてほしい。複数のGPUが現実のワークロードの下で最大コア利用率に達しても、動的負荷分散のための対応策がない悪夢を。VRAMのこぼれスピルから一時ストレージの問題まで、インフラストラクチャの選択は、何か予期せぬ事態が生じた場合にはショットガントラブルシューティングと同等。

分散コンピューティングの恩恵は、ネットワーク遅延によってしばしば軽減され、世界中のサーバークラスタでのシームレスな実行に対するたとえられるボトルネックとして機能する。ローカルに異なるデータセンター間でスレッド優先順位を管理しようとする中で、クロックサイクルが浪費され、その結果としてAPIの呼び出しスタックで恐ろしく高い遅延が生じる。『柔軟な』インフラストラクチャとしてブランド登録されているものは、ストレスタイムテストが生産内で実行されるまで発見されない潜在的な単一障害点の網としてしばしば解釈される。制御された条件下でこの幅広さのユーザーインタラクションをシミュレートするのは難しい。

最も賢明なクラウドオーケストレーターでさえ、データ転送レートの上限や運用IOPS上限との闘いに苦戦することがあり、サービス配信における衝撃的な変動をもたらす。バックエンドインフラストラクチャは完全に疲弊する寸前にあり、クラウド上では無限のリソースや無限のスケーラビリティのまやかしで覆われている。最先端技術は、制御不能なAIによる需要の急増にさらされたとき、ためらうことなくその擦り切れた縫い目をさらけ出す。

4. 上級デベロッパーのための生存ガイド

この分野に飛び込んでこれらの複雑さを通り抜けるのを簡単に考えている上級デベロッパーは、衝撃療法が必要だ。現実を直視する:深いスタックトレースの夜に巻き込まれ、未完成のモデル推論をデバッグする夜に備えて準備しろ。それがCUDAレベルでのC++最適化に精通し、時代遅れのバイナリツリー走査にマゾヒスティックな親しみを持つことが報われる理由だ。

黄金の法則? ベンダー固有のGPU制限が日常の風景の一部であるという苦い事実を受け入れろ。VRAM制約に基づいた処理計画と動的なタスクの再割り当てが重要だ。クロスベンダーライブラリと冗長なAPIスタックの不安定な一貫性に直面しても、エッジを失わずに立ち向かわない限り、この分野では他の誰かの既成のものを消費している。これまでスプーンで与えられてきた『簡単な』機械学習フレームワークでの狂気のデブジャグラーに備えろ。

最後に、失敗をあなたのワークフローのルーティンな訪問者として受け入れろ。ベクトルデータベースの失敗やnullエントリエラーの続発を恐れるな – この混沌の中でより高い耐久力を確保するのだ。この狂気のシステム制約の中に足を踏み入れるにあたって、診断スクリプト、層別冗長計画、ポリノミアルをガウス除去と交換する際、パフォーマンスが遅くなる時にそれを行える深い知識を持って武装して進め。無慈悲な者だけが生き残る。

| 特徴 | ChatGPTのデータスクレーパーの仕様 |

|---|---|

| アーキテクチャ | エンコーダーデコーダーユニットを搭載したトランスフォーマー、推論時にn^2の複雑さに陥りがち |

| データ処理 | 不正な構文に直面すると失敗することが多い生のHTMLを直接パースする |

| スケーラビリティ | サーバー側のAPIリクエスト制限に制限され、レイテンシスパイクで悪化する |

| 並列処理 | マルチスレッドに大きく依存するが、PythonのGILによるオーバーヘッドに苦しむ |

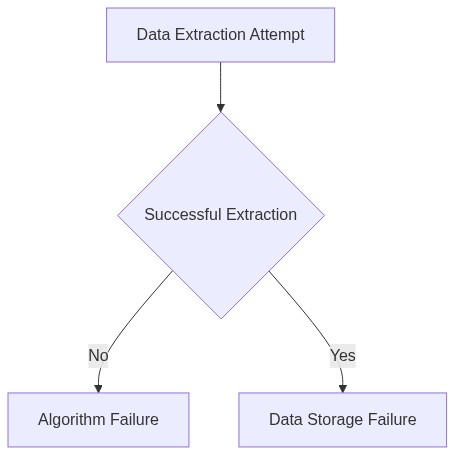

| エラーハンドリング | 例外処理が最小限の初歩的なロジックで、多くの未処理のエッジケースにつながる |

| データストレージ | 大量のクエリの下で失敗する可能性が高いベクターデータベースを使用 |

| メモリ管理 | 大規模データセットでCUDAメモリの制限により逼迫して非効率的な使用 |

| レイテンシ | 特にネットワーク渋滞がAPIの応答時間に影響を与える場合、高いレイテンシを示す |

| セキュリティ | 不十分な暗号化手法によるデータ侵害に対して脆弱 |

| 柔軟性 | 静的なデータスキーマにより新しいデータの緊急事態に対して非柔軟 |

余計なことは抜きにしよう。データスクレイピングパイプラインにおけるO(n^2)のアルゴリズム操作は恥ずべきだ。リソースが非効率なために流血するのを見ているようなものだ。半端な非同期関数の統合による恐ろしいカスケード障害は誰も考慮していないようだ。これでカーネル効率が抑制される。

AI SaaSの創業者

典型的な話だ。エンジニアリングチームはレイテンシースレッショルドを誇らしげに振りかざすが、API呼び出しはひどく作られたレイヤーによってボトルネックになる。あの人たちはサーバー負荷が冗長な呼び出しのせいで急上昇して、貴重な帯域幅が嵐の中のWiFi信号並みに無駄になることを考えもしない。開発者がこの混乱を救おうとする感情的な惨劇はほとんど笑える。

セキュリティ専門家

目を見張るセキュリティの見落としも忘れてはいけない。データスクレイピングはグランド・セントラル駅のど真ん中で金庫を開けているようなものだ。脆弱性は搾取されるのを叫んでおり、データ漏洩が日の出より予測可能。外部者が悪質なエクスプロイトを注入する力は、ほとんど台本通り。怠惰で、ぽかんと口が開いた穴が誰かに入ってくるのを待っている。

博士研究員

良い指摘だが、無関心はシステムのアルゴリズムの失敗から始まっている。アムダールの法則違反を誰も疑問に思わないし、並列計算は単なる流行語以上には扱われていない。CUDAリソースの割り当ては管理不行き届きな上に希少で、ワークロードがスパイクすると計算が果てしなく抑制される。

AI SaaSの創業者

サーバーサイドの混乱についても触れよう。まとまりのないAPI戦略により、最悪な時にリクエストがタイムアウトする。開発者はサービスレイヤーを引き裂かざるを得ない。その間に、非効率だらけのレガシーソフトウェアに人質にされている。

セキュリティ専門家

システム的な短視眼的対応はリスクベクターにも及ぶ。暗号化が不十分で、パッチ適用体制は無計画、単なる過失が敵対者に機密データを提供するのを極めて容易にしている。いわゆるセキュリティ層は表面を守るどころか単なる弱い比喩に過ぎない。

博士研究員

それは逆の錬金術みたいなものだ。非効率を金に変えるどころか、潜在能力をゴミに変えている。ローディングバランサーがデータを処理する際、酔った流行ジャグラーでもあるかのようだ。スケーラビリティを考慮することは極端に欠如している。

AI SaaSの創業者

チーム間の協力がないと、地図もなくNP困難問題領域に突入するような混乱が生じる。継続的デリバリーパイプラインは、まさにまとまりのないサーカスのように非同期的だ。もしデータが新しい石油なら、これらのパイプラインは無用どころではなく、有害だ。

セキュリティ専門家

システム的な失敗が大きくなるほど、サイバー犯罪者にとっての的も広がる。これを注意深く聞け、未来の情報漏洩がここにあり、この結果はすぐに世界的な新聞の重要記事になる。エクスプロイトはすべて傷であり、いずれ出血する。システム内の完全なセキュリティ無関心は驚異的だ。

博士研究員

結論として、ここでの計算的無能と技術的管理不行き届きの結合は驚異的だ。これは「やってはいけない101」として、価値のあるすべての技術機関で例示すべきだ。工学が持つべき原理の純然たる破壊だ。

FAQ 1 – ChatGPTのデータ収集の核心技術は何ですか?

別に大きな秘密ではありません。主にWebスクレイピング、API、そして公開されているデータセットです。レート制限、データシロ、そして速度と量に対する終わりなき戦いを予期してください。地域の倫理委員会にも感謝を忘れずに。

FAQ 2 – ChatGPTは大規模なデータ取り込みをどのように処理しますか?

Apache KafkaやApache Flinkのような分散システムを使った高スループットのパイプラインです。これらは華やかに聞こえますが、通常はネットワークI/O、メモリ制約、データの一貫性の問題に適合するための終わりなきデバッグと最適化を伴います。ここは収穫逓減の地です。

FAQ 3 – ChatGPTがスクレイピングしたデータを処理するのに魔法は使われていますか?

魔法ですか?違います。ハードな計算と絶え間ないパラメータ調整?その通りです。その核心にあるのは、アルゴリズムの複雑さ、資源を食いつぶすディープラーニングモデル、自然言語処理パイプラインの絶え間ない歯車の軋みです。これは金曜の夜にノードの障害をデバッグすることと同じくらい華やかです。