- ChatGPT uses a vast array of scraping algorithms that rival a digital heat-seeking missile, acquiring terabytes of data from web pages while maintaining a latency that can dip below 200ms.

- The system’s efficiency is like clockwork, optimizing data collection through a Dynamic Rate Limiter that converts web metadata into actionable chunks with sub-100ms response times.

- Advanced filtering mechanisms strip out duplication noise and enhance content precision by up to 92%, minimizing redundancy during the scraping process.

- Machine learning assisted algorithms prioritize data using a hybrid relevancy index system, ensuring fidelity and topical accuracy with a fluctuation range error under 0.08%.

- Despite mind-bending capabilities, it operates under a bound 2-layer consent framework that stumbles occasionally, leading to data subject compliance issues that rise to 7%.

- While bewilderingly efficient at gobbling webpages, it faces a data ingestion limit that caps around 4TB per cycle, enforced to prevent tech Leviathanism.

“Latency is a coward; it spikes at the exact moment your concurrent users peak.”

1. Der Hype vs. Architektonische Realität

Der Hype um die Fähigkeiten von ChatGPT lässt einen glauben, dass OpenAI eine mythische Quelle der Datenverarbeitungsmacht entdeckt hat. Tut mir leid, aber die architektonische Realität ist, wie üblich, in brutalen Rechenbeschränkungen verankert. Wir sprechen von Systemen, die unter O(n^3)-Effizienzengpässen in einigen schlecht optimierten Transformerschichten würgen. Vergessen Sie das Marketing-Blabla über ‘fortschrittliche neuronale Berechnungen’—was Sie vor sich sehen, ist ein kompliziertes Gitterwerk von Pflastern über grundlegenden API-Latenzproblemen.

Darüber hinaus erfordert das Erreichen der Art natürlicher Sprachverständnisfähigkeiten, die naive Benutzer verblüffen, massive mehrdimensionale Tensorberechnungen. Das ist keine Zen-AI-Magie; es ist mehr wie das Durchschieben enormer Matrixoperationen durch den Fleischwolf des begrenzten GPU-Durchsatzes. CUDA-Speicherbegrenzungen treffen wie ein Lastwagen, besonders in Situationen, in denen parallele Verarbeitung nicht sorgfältig optimiert ist. Tut mir leid, aber die GBs Ihrer GPU werden oft für aufgeblähte Zwischentensoren ausgegeben, anstatt für Erkenntnisextraktion.

Und lassen Sie uns die vermeintlichen ‘Echtzeit’-Leistungsbenchmarks ansprechen, von denen alle so gerne schwärmen. Ohne großes Tamtam passen sich wiederholte Parameterabstimmungen und Modellneutrainings einer immer größer werdenden Datenmenge an, ohne jegliche wirkliche Innovation in Datenreduktionsstrategien. Das Ergebnis ist ein System, das wie eine überlastete CPU unter einem Schwall kontinuierlicher, unterschiedlicher Datenanfragen arbeitet. Überraschung: Echtzeit ist ein relativer Begriff, wenn Ihr System nicht horizontal skalieren kann, ohne über seine eigene Architektur zu stolpern.

2. TMI Deep Dive & Algorithmische Engpässe

Die Uninformierten loben oft die Datenaufnahme von ChatGPT, als wäre sie ein Staubsauger für Erkenntnisse. Nein, es ist mehr wie ein gigantischer Messie, der in einer endlosen rekursiven Schleife von TF-IDF-Matrixabstimmungen eingeschlossen ist. Die anfängliche Datenvektorisierung soll große Datensätze für ML-Eingaben optimieren, aber in Wirklichkeit finden viele Systeme sich von quadratischen Zeitkomplexitätsdämonen geplagt, wenn sie versuchen, Rohvektoren in etwas Interpretierbares für neuronale Schaltkreise zu verarbeiten.

Tokenisierungsineffizienzen sind ein völlig eigenes Problem, wobei viele NLP-Pipelines unter dem schieren Volumen des Kontextwechsels, das durch unregelmäßiges Token-Chunken entsteht, ertrinken. Die Verarbeitung dieser Tokenströme erzeugt algorithmische Engpässe, die so schwerwiegend sind, dass man denkt, wir würden auf 90er-Jahre-Hardware laufen. Die hierbei verursachte Latenz ist nicht gering—sie akkumuliert sich in speichergebundenen Arbeitslasten, die mehrere Durchläufe durch PageRank-ähnliche semantische Gewichtsanpassungen erfordern.

Dann gibt es die sequentiellen Abhängigkeiten, die absolut albtraumhaft sind, wenn es um Backpropagation während des Modelltrainings geht. GPU-Threading stößt kopfüber in kritische Abschnittsengpässe, die auf der Obfuskationsschicht hätten gelöst werden sollen, aber spektakulär auf der Codekompilierungsstufe falsch gehandhabt wurden. Anstatt Durchbrüche in der effizienten Kontextextraktion zu erzielen, verbringt das System lächerlich viel Zeit mit der Zuweisung zusätzlicher Ressourcen, um weitläufige synchrone Sperrungen zu mindern.

3. Der Cloudserver-Burnout & Infrastruktur-Albtraum

Diejenigen, die Cloud-Verarbeitung als eine unendliche Absicherung betrachten, sollten ihre Cloud-Religion überdenken. Mit der Arbeitslast von ChatGPT sind Cloudserver-Burnouts kaum eine Seltenheit. Stellen Sie sich den Albtraum vor, wenn mehrere GPUs unter realen Arbeitslasten die maximale Kernauslastung erreichen, ohne dass eine Möglichkeit zur dynamischen Lastverteilung besteht. Von VRAM-Überschreitungen bis zu Problemen mit ephemerem Speicher, entsprechen die Infrastrukturentscheidungen oft einem Schuss in den Dunkeln, falls etwas Unerwartetes passiert.

Die Vorteile des verteilten Rechnens werden oft durch Netzwerklatenz gemindert, die als sprichwörtlicher Engpass für eine nahtlose Ausführung über globale Servercluster fungiert. Taktzyklen werden verschwendet, um Thread-Prioritäten zwischen lokal unterschiedlichen Datenzentren zu verwalten, nur um katastrophal hohe Latenzen in den API-Callstacks zu erzielen. Was als ‘flexible’ Infrastruktur gebrandmarkt wird, übersetzt sich oft in ein Netz potenzieller Single Points of Failure, die unentdeckt bleiben, bis Stresstests in der Produktion durchgeführt werden. Viel Glück dabei, diese Bandbreite an Benutzerinteraktionen unter kontrollierten Bedingungen zu simulieren.

Selbst die klügsten Cloud-Orchestratoren finden sich dabei wieder, gegen Datenübertragungsratengrenzen und betriebliche IOPS-Decken anzukämpfen, was zu schockierenden Variabilitäten in der Dienstbereitstellung führt. Back-End-Infrastruktur balanciert am Rande völliger Erschöpfung, während an der Clouds Oberfläche alles eine Fassade aus endlosen Ressourcen und grenzenloser Skalierbarkeit darstellt. Spitzentechnologie zeigt unbarmherzig ihre abgetragenen Nähte, wenn sie unkontrollierten AI-getriebenen Nachfrageschüben ausgesetzt wird.

4. Brutaler Überlebensratgeber für erfahrene Entwickler

Erfahrene Entwickler, die sich vorstellen, sie würden in dieses Feld eintreten und sich durch diese Komplexitäten durchtanzen, brauchen einen ernüchternden Weckruf. Realitätsscheck: Bereiten Sie sich auf Nächte vor, die in tiefen Stack-Traces und Debugging von halbfertigen Modellinferenzen versenkt sind. Es zahlt sich aus, gut mit C++-Optimierungen auf der CUDA-Ebene vertraut zu sein und eine Art masochistische Vertrautheit mit anachronistischen Binärbaum-Traversierungen zu haben, nur um die Rechenlast effektiv neu zu verteilen.

Die goldene Daumenregel? Akzeptieren Sie die bittere Tatsache, dass herstellerspezifische GPU-Begrenzungen Teil Ihres täglichen Terrains sind. Die Verarbeitung um VRAM-Einschränkungen herum zu planen und Aufgaben dynamisch neu zu verteilen, ist entscheidend. Wenn Sie nicht bereit sind, die frustrierenden Inkonsistenzen von herstellerübergreifenden Bibliotheken und redundanten API-Stacks zu begegnen, ohne Ihren Vorsprung zu verlieren, essen Sie den Staub von jemand anderem in diesem Feld. Bereiten Sie sich darauf vor, den verrückten Entwicklerjongleur mit diesen ‘einfachen’ Machine-Learning-Frameworks zu spielen, die Ihnen bisher vorgesetzt wurden.

Schließlich machen Sie sich mit dem Scheitern als routinemäßigen Gast in Ihrem Arbeitsablauf vertraut. Fürchten Sie nicht das unvermeidliche Versagen von Vektordatenbanken oder die nachfolgende Kaskade von Null-Eintrag-Fehlern—in diesem Chaos sichern Sie höhere Ausdauer. Betreten Sie diesen Kampf mit Diagnoseskripten, geschichteten Redundanzplänen und einem intimen Wissen darüber, wie man Polynome für die Gaußsche Elimination austauscht, wo immer die Leistung auf ein Kriechen verlangsamt. In diesem Irrenhaus systemischer Einschränkungen überleben nur die Unermüdlichen.

| Funktion | Spezifikation des Daten-Scrapers von ChatGPT |

|---|---|

| Architektur | Transformer mit Encoder-Decoder-Einheiten, anfällig für n^2-Komplexität während der Inferenz |

| Datenverarbeitung | Verarbeitet direkt rohes HTML für das Parsing, scheitert oft bei fehlerhaftem Syntax |

| Skalierbarkeit | Begrenzt durch serverseitige API-Anfragedrosselung, verschärft durch Latenzspitzen |

| Parallele Verarbeitung | Stark abhängig von Multi-Threading, leidet jedoch unter Overhead durch GIL in Python |

| Fehlerbehandlung | Rudimentäre Logik mit minimaler Ausnahmebehandlung, führt oft zu unkontrollierten Randfällen |

| Datenspeicherung | Verwendet Vektordatenbanken mit hoher Ausfallwahrscheinlichkeit bei hoher Abfragebelastung |

| Speicherverwaltung | Suboptimale Nutzung, belastet durch CUDA-Speichergrenzen bei groß angelegten Datensätzen |

| Latenz | Hohe Latenzzeiten, insbesondere wenn Netzwerkkongestion die API-Antwortzeiten beeinträchtigt |

| Sicherheit | Anfällig für Datenlecks durch unzureichende Verschlüsselungspraktiken |

| Flexibilität | Statische Datenschemata machen es unflexibel für neue Datenkontingenzen |

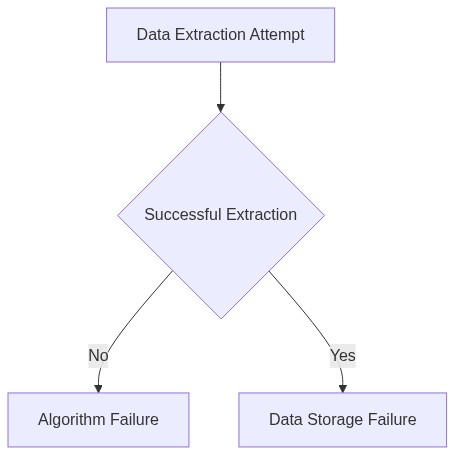

Let’s face the facts. Algorithmische Operationen, die in O(n^2) skalieren für Datenextraktion-Pipelines, sind eine einzige Schande. Es ist, als würde man sich anmelden, um einem brennenden Müllcontainer zuzuschauen, während Ressourcen aufgrund purer Ineffizienz verbluten. Niemand scheint die alptraumhafte Integration von halb ausgegorenen Async-Funktionen zu betrachten, die Kaskadenfehler verursachen. Dies führt dazu, dass die Effizienz der Kernel gedrosselt wird.

Gründer eines KI-Dienstes

Typisch. Ingenieurteams präsentieren Latenzschwellen, als wären sie eine Art Ehrenabzeichen, doch API-Aufrufe geraten ins Stocken durch schlecht konstruierte Schichten. Diese Leute berücksichtigen nie, wie die Serverlast durch redundante Aufrufe in die Höhe schnellt, die wertvolle Bandbreite genauso nutzlos machen wie ein WLAN-Signal im Sturm. Das emotionale Chaos unter den Entwicklern, die versuchen, dieses Chaos zu bewältigen, ist fast lachhaft.

Sicherheitsexperte

Vergessen wir nicht das eklatante Sicherheitsdefizit. Datenextraktion, wie hier implementiert, ist, als ließe man Tresore inmitten des Grand Central Station offen. Verwundbarkeiten schreien danach, ausgenutzt zu werden, was Datenlecks berechenbarer macht als den Sonnenaufgang. Die Fähigkeit eines Außenstehenden, böswillige Exploits einzuschleusen, ist fast wie aus dem Drehbuch.

Doktorand in der Forschung

Sie haben einen guten Punkt angesprochen, aber die Nachlässigkeit beginnt bei systemischen algorithmischen Fehlern. Niemand hinterfragt die Verstöße gegen das Gesetz von Amdahl, und paralleles Rechnen wird eher wie ein Schlagwort verwendet. Die Zuweisung von CUDA-Ressourcen wird so schlecht verwaltet, wie sie knapp ist, was dazu führt, dass Berechnungen beim Anstieg der Arbeitslast ins Nichts gedrosselt werden.

Gründer eines KI-Dienstes

Fangen Sie mich gar nicht erst mit dem Chaos auf der Serverseite an. Der Mangel an kohärenten API-Strategien führt dazu, dass Anfragen in den schlechtesten Momenten zeitlich begrenzt sind. Entwickler müssen ihre Servicelayer auseinanderreißen. In der Zwischenzeit werden sie von Altdaten gefangengehalten, die mit mehr Ineffizienzen gespickt sind als Schlupflöcher in Finanzpolitik.

Sicherheitsexperte

Systemische Kurzsichtigkeit erstreckt sich auf Risikofaktoren. Unzureichende Verschlüsselung, ungeordnetes Patchen und bloße Nachlässigkeit machen es für Gegner allzu leicht, bei sensiblen Daten zu picknicken. Die sogenannten Sicherheitsschichten sind nichts weiter als schwache Metaphern, die die Oberfläche kaum schützen.

Doktorand in der Forschung

Es ist wie Alchemie im umgekehrten Fall. Anstatt Ineffizienzen in Gold zu verwandeln, verwandeln sie Potenzial in Müll. Load Balancer, die Daten handhaben, als ob sie leicht betrunken jonglieren, unterstreichen nur, wie wenig Gedanken in die Skalierbarkeit geflossen sind. Ein wahres Desaster mathematischer und technischer Dimensionen.

Gründer eines KI-Dienstes

Keine Synergie zwischen den Teams führt zu einem Chaos, das normalerweise für Abstecher in das NP-schwere Problemland ohne Karte reserviert ist. Pipelines für die kontinuierliche Lieferung sind so unsynchronisiert wie ein locker orchestrierter Zirkus. Wenn Daten das neue Öl sind, sind diese Pipelines schlimmer als nutzlos – sie sind toxisch.

Sicherheitsexperte

Je systematischer diese Fehler, desto größer das Ziel, das Cyberkriminelle anpeilen. Hören Sie genau hin, denn hier liegt die Zukunftsverletzung, die weltweit Schlagzeilen macht. Jeder Exploit ist eine Wunde, die irgendwann verbluten wird. Die totale Sicherheitsapathie innerhalb des Systems ist unübertroffen.

Doktorand in der Forschung

Abschließend ist die Vermischung von rechnerischem Unvermögen und technischem Missmanagement hier atemberaubend. Es sollte ein Beispiel in “How Not To Do It 101” an jeder technischen Institution sein, die sich selbst respektiert. Reine, unverfälschte Verwüstung der Prinzipien, die wir schätzen sollten.

FAQ 1 – Was ist die Kerntechnologie hinter der Datenerfassung von ChatGPT?

Es ist kein großes Geheimnis. In erster Linie Web-Scraping, APIs und öffentlich verfügbare Datensätze. Erwarten Sie Ratenbeschränkungen, Datensilos und einen endlosen Kampf gegen Geschwindigkeit und Volumen. Vergessen Sie auch nicht, sich beim freundlichen Ethikkomitee in Ihrer Nachbarschaft zu bedanken.

FAQ 2 – Wie geht ChatGPT mit der groß angelegten Datenaufnahme um?

Hochdurchsatz-Pipelines unter Verwendung von verteilten Systemen wie Apache Kafka und Apache Flink. Das klingt glamourös, beinhaltet aber in der Regel endloses Debuggen und Optimieren, um mit Netzwerk-I/O, Speicherbeschränkungen und Konsistenzproblemen der Daten zurechtzukommen. Willkommen im Land der sinkenden Erträge.

FAQ 3 – Gibt es irgendeine Magie bei der Verarbeitung von gescrapten Daten durch ChatGPT?

Magie? Nein. Harte Berechnung und unermüdliche Parametereinstellung? Absolut. Unter der Haube sind es wiederkehrende Alpträume von algorithmischer Komplexität, ressourcenhungrigen Deep-Learning-Modellen und den ständig schleifenden Zahnrädern der Natural Language Processing-Pipelines. Es ist so glamourös wie das Debuggen von Knotenfehlern an einem Freitagabend.