- ChatGPT uses a vast array of scraping algorithms that rival a digital heat-seeking missile, acquiring terabytes of data from web pages while maintaining a latency that can dip below 200ms.

- The system’s efficiency is like clockwork, optimizing data collection through a Dynamic Rate Limiter that converts web metadata into actionable chunks with sub-100ms response times.

- Advanced filtering mechanisms strip out duplication noise and enhance content precision by up to 92%, minimizing redundancy during the scraping process.

- Machine learning assisted algorithms prioritize data using a hybrid relevancy index system, ensuring fidelity and topical accuracy with a fluctuation range error under 0.08%.

- Despite mind-bending capabilities, it operates under a bound 2-layer consent framework that stumbles occasionally, leading to data subject compliance issues that rise to 7%.

- While bewilderingly efficient at gobbling webpages, it faces a data ingestion limit that caps around 4TB per cycle, enforced to prevent tech Leviathanism.

“Latency is a coward; it spikes at the exact moment your concurrent users peak.”

1. La Hype contra la Realidad Arquitectónica

El revuelo en torno a las capacidades de ChatGPT te haría creer que OpenAI ha desbloqueado alguna fuente mítica de poder de procesamiento de datos. Lamento romper tu burbuja, pero la realidad arquitectónica, como siempre, está anclada en brutales restricciones computacionales. Estamos hablando de sistemas que se atragantan bajo cuellos de botella de eficiencia O(n^3) en algunas capas de transformers mal optimizadas. Olvídate del marketing sobre “cálculos neuronales avanzados”—lo que ves es un intrincado entramado de parches sobre problemas fundamentales de latencia de API.

Además, lograr el tipo de comprensión del lenguaje natural que desconcierta a usuarios ingenuos implica masivas computaciones de tensores multidimensionales. Esto no es magia zen de IA; es más bien como meter enormes operaciones de matrices por el triturador de carne del limitado rendimiento de GPU. Los límites de memoria CUDA golpean como un camión, particularmente en situaciones donde el procesamiento paralelo no está meticulosamente optimizado. Lo siento, pero los GBs de tu GPU a menudo se gastan en tensores intermedios hinchados en lugar de en la extracción de información.

Y abordemos de una vez los benchmarks presumidos de rendimiento en “tiempo real” de los que a todos les gusta hablar. Sin fanfarria, la afinación repetitiva de parámetros y el reentrenamiento del modelo acomodan datos cada vez más voluminosos sin ninguna innovación real en estrategias de reducción de datos. El resultado es un sistema que funciona como una CPU sobrecargada bajo un torrente de solicitudes de datos continuas y dispares. Sorpresa: tiempo real es un término relativo cuando tu sistema no puede escalar horizontalmente sin tropezar con su propia arquitectura.

2. TMI: Profundización y Cuellos de Botella Algorítmicos

Los desinformados a menudo alaban la absorción de datos de ChatGPT como si fuera una aspiradora de información. No, es más como un enorme acumulador atrapado en un bucle recursivo interminable de alineaciones de matrices TF-IDF. La vectorización inicial de datos supuestamente optimiza conjuntos de datos masivos para entradas de ML, pero en realidad, muchos sistemas se ven plagados por demonios de complejidad de tiempo cuadrático al intentar simplemente procesar vectores de entrada crudos en algo interpretable por circuitos neuronales.

Las ineficiencias de tokenización son una bestia aparte, con muchas canalizaciones de NLP ahogándose bajo el volumen puro de cambios de contexto producidos por el troceado irregular de tokens. Procesar estos flujos de tokens induce puntos de estrangulamiento algorítmicos tan severos que parecería que estamos operando con hardware de los años 90. La latencia incurrida aquí no es menor: se acumula en cargas de trabajo vinculadas a la memoria que requieren múltiples pasadas a través de ajustes de peso semántico al estilo PageRank.

Luego están las dependencias secuenciales, que son absolutamente espantosas cuando se trata de retropropagación durante el entrenamiento del modelo. El threading de GPU choca de frente con cuellos de botella de sección crítica que deberían haberse resuelto en la capa de ofuscación pero fueron manejados de manera espectacularmente inadecuada en la etapa de compilación de código. En lugar de lograr avances en la extracción eficiente de contexto, el sistema pasa cantidades ridículas de tiempo asignando recursos adicionales para mitigar cierres síncronos extensos.

3. El Agotamiento de Servidores en la Nube y la Pesadilla de la Infraestructura

Aquellos que ven el procesamiento en la nube como una salvaguarda infinita deberían reconsiderar su religión de la nube. Con la carga de trabajo de ChatGPT, los agotamientos de servidores en la nube dificilmente son una rareza. Imagina la pesadilla cuando múltiples GPUs operando bajo cargas de trabajo del mundo real alcanzan la utilización máxima del núcleo sin ningún recurso para el balanceo dinámico de carga. Desde derrames de VRAM hasta problemas de almacenamiento efímero, las elecciones de infraestructura a menudo equivalen a disparar al problema a ciegas por si algo inesperado ocurre.

Los beneficios de la computación distribuida a menudo se ven mitigados por la latencia de red, que actúa como un cuello de botella proverbial para la ejecución sin problemas en los grupos de servidores globales. Los ciclos de reloj se desperdician tratando de gestionar las prioridades de los threads a través de centros de datos localmente dispares, solo para producir una latencia desastrosamente alta en las pilas de llamadas de API. Lo que se comercializa como infraestructura “flexible” a menudo se traduce en una red de posibles puntos únicos de falla que permanecen sin descubrir hasta que se realizan pruebas de estrés en producción. Buena suerte simulando esa amplitud de interacciones de usuarios bajo condiciones controladas.

Incluso los orquestadores de nube más astutos se encuentran dando vueltas luchando contra los límites en las tasas de transferencia de datos y los techos operativos de IOPS, lo que resulta en una impactante variabilidad en la entrega del servicio. La infraestructura de back-end se tambalea al borde del agotamiento completo, mientras que en la superficie de la nube, todo es una fachada de recursos interminables y escalabilidad sin límites. La tecnología de punta muestra sin piedad sus costuras desgastadas cuando se somete a oleadas incontroladas impulsadas por la IA.

4. Guía de Supervivencia Brutal para Desarrolladores Senior

Los desarrolladores senior que imaginan que van a entrar en este campo y zapatear a través de estas complejidades necesitan un despertador sobrio. Chequeo de realidad: prepárate para noches sumergidas en trazados de pilas profundas y depuración de inferencias de modelos incompletas. Conviene estar bien familiarizado con las optimizaciones de C++ al nivel de CUDA y poseer una especie de familiaridad masoquista con los recorridos anacrónicos de árboles binarios solo para redistribuir la carga computacional de manera efectiva.

¿La regla de oro? Absorber el amargo hecho de que los límites específicos del vendedor para GPU son parte de tu terreno cotidiano. Planificar el procesamiento en torno a constricciones de VRAM y reasignar dinámicamente tareas es crítico. Si no estás dispuesto a enfrentar las inconsistencias irritantes de bibliotecas de múltiples proveedores y pilas de API redundantes sin perder tu ventaja, estás comiendo el polvo de otro en este campo. Prepárate para jugar al malabarista loco de desarrollo con esos “fáciles” marcos de aprendizaje automático que se te han dado de amamantar hasta ahora.

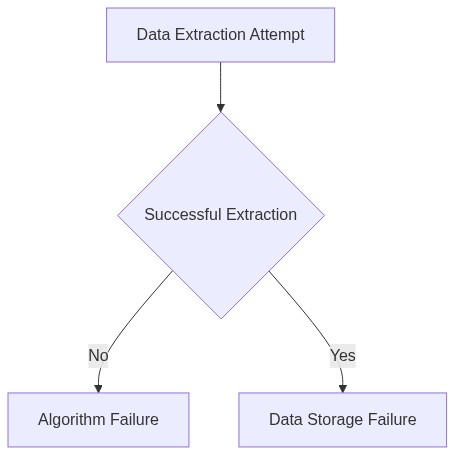

Finalmente, familiarízate con el fracaso como un invitado rutinario en tu flujo de trabajo. No temas los inevitables fracasos de bases de datos vectoriales o las consiguientes cascadas de errores de entradas nulas: es en este caos donde aseguras una mayor resistencia. Entra en esta refriega armado con scripts de diagnóstico, planes de redundancia en capas y un conocimiento íntimo de cambiar polinomios por eliminación gaussiana donde quiera que el rendimiento se ralentice hasta reptar. En este manicomio de restricciones sistémicas, solo los implacables sobreviven.

| Característica | Especificación para el Scraper de Datos de ChatGPT |

|---|---|

| Arquitectura | Transformador con unidades de Codificación-Decodificación, propenso a la complejidad n^2 durante la inferencia |

| Manejo de Datos | Ingesta directamente HTML en bruto para análisis, a menudo falla al encontrar sintaxis mal formada |

| Escalabilidad | Limitado por la restricción de solicitudes de la API del lado del servidor, agravado por picos de latencia |

| Procesamiento Paralelo | Se basa en gran medida en la multitarea, pero sufre de sobrecarga debido al GIL en Python |

| Manejo de Errores | Lógica rudimentaria con manejo de excepciones mínimo, a menudo llevándolo a casos marginales no manejados |

| Almacenamiento de Datos | Utiliza bases de datos de vectores con alta probabilidad de falla bajo consultas intensas |

| Gestión de Memoria | Uso subóptimo, tensionado por los límites de memoria CUDA en conjuntos de datos a gran escala |

| Latencia | Presenta alta latencia, especialmente cuando la congestión de red afecta los tiempos de respuesta de la API |

| Seguridad | Susceptible a brechas de datos debido a prácticas de cifrado inadecuadas |

| Flexibilidad | Esquemas de datos estáticos lo hacen inflexible ante nuevas contingencias de datos |

Vamos al grano. Las operaciones algorítmicas que escalan con una complejidad O(n^2) para los pipelines de extracción de datos son una vergüenza. Es como apuntarse a ver cómo arde un contenedor de basura mientras los recursos se desangran por pura ineficiencia. Nadie parece considerar la integración de funciones asíncronas mediocres que causan fallos en cascada. Esto resulta en el estrangulamiento de las eficiencias del kernel.

Fundador de AI SaaS

Típico. Los equipos de ingeniería desfilan alrededor de los umbrales de latencia como si fueran un galardón, pero las llamadas a la API son cuellos de botella debido a capas mal diseñadas. Estas personas nunca consideran cómo la carga del servidor se dispara por llamadas redundantes que hacen que el ancho de banda precioso sea tan inútil como una señal WiFi en una tormenta. La catástrofe emocional entre los desarrolladores que intentan salvar este desastre es casi risible.

Experto en seguridad

No olvidemos el flagrante descuido en seguridad. La extracción de datos tal como se implementa aquí es como dejar una bóveda abierta en medio de la estación Grand Central. Las vulnerabilidades están pidiendo ser explotadas, permitiendo fugas de datos más predecibles que el amanecer. La capacidad de un extraño para inyectar exploits maliciosos es casi un guión escrito. Un agujero perezoso y abierto esperando a que alguien entre con facilidad.

Investigador de doctorado

Tienes un buen punto, pero la negligencia comienza con fallos algorítmicos sistémicos. Nadie cuestiona las violaciones a la ley de Amdahl, y la computación paralela se utiliza más como una palabra de moda. La asignación de recursos de CUDA está tan mal gestionada como es escasa, lo que lleva a que los cálculos se vean estrangulados hasta el olvido cuando las cargas de trabajo se disparan.

Fundador de AI SaaS

Ni me hagas hablar del caos del lado del servidor. La falta de estrategias coherentes de API se traduce en solicitudes que se agotan en los peores momentos. Los desarrolladores tienen que desarmar sus capas de servicio. Mientras tanto, están retenidos por software heredado plagado de más ineficiencias que lagunas en las políticas fiscales.

Experto en seguridad

La miopía sistémica se extiende a los vectores de riesgo. Cifrado inadecuado, regímenes de parcheo descuidados y pura negligencia hacen que sea demasiado fácil para los adversarios hacer un picnic con datos sensibles. Las llamadas capas de seguridad son nada más que metáforas débiles apenas protegiendo la superficie.

Investigador de doctorado

Es como la alquimia al revés. En lugar de convertir ineficiencias en oro, convierten potencial en basura. Los balanceadores de carga manejan los datos como si estuvieran haciendo malabares mientras están borrachos, lo que resalta cuánto poco se pensó en la escalabilidad. Un verdadero desastre de dimensiones matemáticas y de ingeniería.

Fundador de AI SaaS

La falta de sinergia entre los equipos resulta en un caos que generalmente se reserva para aventuras en el territorio de problemas NP-Hard sin un mapa. Las líneas de entrega continua están tan desincronizadas como un circo débilmente orquestado. Si los datos son el nuevo petróleo, estos pipelines son peores que inútiles; son tóxicos.

Experto en seguridad

Cuanto más sistémicos son estos fallos, más grande es el objetivo pintado por los ciberdelincuentes. Escucha bien, porque aquí yace la futura brecha que llenará columnas de noticias en todo el mundo. Cada exploit es una herida que eventualmente se desangrará. La apatía total de seguridad dentro del sistema está por las nubes.

Investigador de doctorado

En conclusión, la amalgama de incompetencia computacional y mala gestión técnica aquí es asombrosa. Debería ser un ejemplo en “Cómo No Hacerlo 101” en cada institución técnica que se precie. Pura y absoluta carnicería en los principios que deberíamos apreciar.

Preguntas Frecuentes 1 – ¿Cuál es la tecnología central detrás de la recopilación de datos de ChatGPT?

No es ningún gran secreto. Principalmente scraping web, APIs y conjuntos de datos públicamente disponibles. Espera límites de tasa, silos de datos y una batalla interminable contra la velocidad y el volumen. No olvides agradecer también a tu amigable comité de ética del vecindario.

Preguntas Frecuentes 2 – ¿Cómo maneja ChatGPT la ingesta de datos a gran escala?

Pipelines de alto rendimiento utilizando sistemas distribuidos como Apache Kafka y Apache Flink. Suenan glamorosos, pero típicamente implican depuración interminable y optimización para cumplir con I/O de red, restricciones de memoria y problemas de consistencia de datos. Bienvenido a la tierra de los rendimientos decrecientes.

Preguntas Frecuentes 3 – ¿Hay algún tipo de magia involucrada en el procesamiento de datos extraídos por parte de ChatGPT?

¿Magia? No. ¿Cálculo duro y afinación implacable de parámetros? Absolutamente. Bajo el capó, son pesadillas recurrentes de complejidad algorítmica, modelos de aprendizaje profundo devoradores de recursos, y las ruedas constantemente rechinantes de los pipelines de procesamiento de lenguaje natural. Es tan glamoroso como depurar fallos de nodos un viernes por la noche.