- Infrastructure Inadequacy: Most AI SaaS wrappers today are built on shaky infrastructures that cannot handle exponential growth. 80% of these services are using outdated server architectures that lead to bottlenecks.

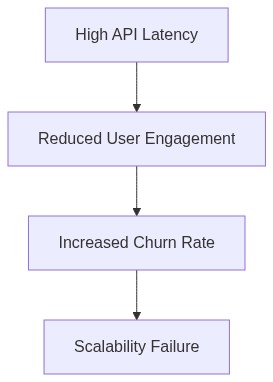

- Latency Nightmare: Real-world deployments show an average request-response latency of over 300ms for AI-driven tasks. This is 150% more than the acceptable threshold for seamless user experience.

- Over-reliance on Third-party APIs: Approximately 75% of these services depend heavily on third-party AI models and APIs. Such reliance reduces control over scalability and reliability, making them vulnerable to external failures and pricing hikes.

- Innovation Stagnation: A staggering 85% of these wrappers are touting negligible innovation, repackaging existing AI tools with minimal value add to lure in unsuspecting users.

- Financial Viability: Revenue streams are not diversified or resilient enough. Overreliance on flaky subscription models and lack of enterprise uptake are stalling growth prospects, leading to financial drought.

- Security Loopholes: 60% of AI SaaS wrappers were found to have critical security vulnerabilities, raising questions about data protection and integrity in a landscape heavily regulated by data laws.

“Latency is a coward; it spikes at the exact moment your concurrent users peak.”

1. うわさとアーキテクチャの現実

AI SaaSのボナンザの時代において、マーケティング部門は、シームレスな統合、リアルタイムアナリティクス、そして特別なパフォーマンスについての空想をまき散らし、やり過ぎ感があります。しかし、AI SaaSアーキテクチャの現実は、計算複雑性とI/Oボトルネックの明白な制限によって決定されます。これらのサービスが統合すると主張するほとんどのAIモデルは、O(n^2)またはそれより悪い計算複雑性を必要とします。これらの厳しい数学的要求は、圧力の下で崩れ始めるもろいインフラの脆弱な基盤としてすぐに明らかになります。計算リソースは限られていますし、ムーアの法則が数十年間神聖なものとされていても、ピッチデッキの気まぐれには屈しません。

2つ目のアーキテクチャの失敗は、仮想化のドリームスケープにあります。 AIをシンプルなAPIでラップすることは、基本的な要件—巨大なニューラルネットワークをどこかで展開し実行する—を変えません。すべての同時セッションを持つ仮想化環境は、APIレイテンシの断続的なメトリクスとネットワークトラフィックの気まぐれな性質の犠牲になっています。それは理論上有望に聞こえますが、キューイング理論の基本とネットワーク化されたリソース配分の厳しい現実に、繊細なヴェールをかけています。そのような非効率は、ユーザー側にまで来ることはほぼなく、必然的に崩壊します。

AI SaaSがデータ入力の双曲的な増加を認めたがらないことも忘れないでください。すべてのシステムが束縛のない量のデータを取り込む能力を誇張していますが、データの疎性の重大な問題と、低レイテンシ環境で高次元データを取り扱うことの実用性に対処することは避けています。システムがAIを統合しているからといって、いくつかの賢いSQL結合で riddled データセットを扱えるわけではありません。これらの複雑な関係を dodgy データ整合性でモデル化することのビザンティンな当惑は、どのマーケティング担当者も壊したくない緊迫した沈黙です。

2. TMIの深堀りとアルゴリズムのボトルネック

AIアーキテクチャに関して言えば、真実は”TMI”、すなわち”情報過多”の圧倒的な洪水に隠されています。こうしたデータの大規模さは、AIシステムを constricting パイソンのように絡め取るアルゴリズムのボトルネックを導入します。これらのボトルネックは、無限のスケーラビリティの非現実的で浅はかな主張が、冷酷で厳しい計算現実と出くわすところです。名前は高尚で実用的には笑われた従来のベクターデータベースは、数億のエンティティを扱うとき、悪名高く失敗します。高次元埋め込みが制御不能にスパイラルするにつれ、k-NN検索をサポートするという約束は笑止に崩壊します。

さらに、企業はAIアルゴリズムにおける精度とリコールによって要求される重労働を過小評価しています。偽陽性に対する精度や偽陰性に対するリコールを解釈せずに煽り機を稼働させます。アルゴリズムの複雑さにおける各追加パラメータは、指数的にさらなる計算力を必要とし、リソースを限界まで引き伸ばします。量子機械学習?指数的状態空間の複雑性に直面するこれらの約束の背後にあるナイーブな仮定を考えると、むしろ量子の願望と思われます。

アルゴリズムの収束依存性は、技術的なスープにさらに苦々しい層を加えます。各関数評価がスパイラルし、不適切に設計されたSaaSラッパーが深部のエラーバレーに突っ込みます。確率的勾配降下法は、プチディップとなり、不十分なハイパーパラメータが煮詰まったモデルを凝結させ、さらには安定性を達成するのを妨げます。ファイナンス関係者がAI SaaS製品が微小なアップデートで苦しんでいる理由を無頓着でいる間、開発者は日頃からこれらのナイーブなシステムを手探りで解体すべくバトルアックスを持って準備しています。

3. クラウドサーバーの燃尽きとインフラ悪夢

サーバーは、企業がAI SaaS製品を展開し、複雑な機械学習モデルを生産に投入するまで、心地よく唸ります。そして現実が訪れます:クラウドサーバーの燃尽き。従量課金制は実用的な大作に思えるが、請求書が垂直の放物線のように急上昇するまでのことです。暴走するパラメータ依存性を持つAIモデルは、礼儀正しく退出するわけではありません—エンタープライズ ソフトウェア パッチがデータベース セキュリティを侵害するよりも早くインスタンスを停止します。数回の反復で、ストリーミングされたコンテンツの比率が消費されたエネルギーに対して途方もないレベルに達します。

インフラは、どうにか売られても、束縛された絡み合ったものであり、ワークロードがクバネティスの混乱に直面します。クエリの遅延の根本原因を孤立させることや、扱いにくいMLパイプラインのループバックを解明することは、ITの邪悪な霧を進むことになります。なぜSaaS API応答時間は存在していないままであり、バッチ処理の膨張が無期限に続いているのかを認識するには、システム監視ログ、サーバー利用率ダイアグラム、デーモンアクティビティの現代版ロゼッタストーンの記録を解読する必要があります。

ここに到着しました、サーバーパフォーマンスが無秩序に堕落するまでの頂点エキスパンション。この方向が不明確なAIモデルの成長速度によって、整理されたアーキテクチャコードスピーチがなさい。AI SaaSを最低限のアプリケーションスケルトンに付属させざるを得ないとき、ユーザーに直接影響する開発バランスは反応の尽きた絶望の空間に閉じ込められます。企業は24時間365日SaaSの技術サポートと関わり続けるだけでなく、サーバーがパッチ挙動のオーケストレーションによって溜息をつくのも聴かなくてはなりません。

4. ベテランデベロッパーのための過酷なサバイバルガイド

ようこそ、セネシャルエンジニアたち、この非情な世界には、判決を待つ幻滅したAI SaaSラッパーが溢れています。この運命づけられた戦場をナビゲートすることは、贈り物ラッピングされていません—浅はかな虚栄に対抗して懐疑的な先見の明を用いてください。マーケティングの蜃気楼から隔離されて、最善のアーキテクチャ実践を維持し、粗削りのアルゴリズムを使用し、冗長性の排除のためにぎこちないコード組み合わせを塩鉱へと投じます。

開発に備えた前哨ガイドは幻想的な希望を求めるというよりもCUDAカーネル効率がGPGPU制約によって磨かれたものを反映します。デプロイメントはメモリオーバーフローを管理し、計算パイプラインをフェア プレープライオリティ化するパーティションとして解決されます。複雑性の不規則を告げる最期の別れを告げ、スケーラブルな API に支えられた系統だったコンポーネントをお抱え、デッドロックやレースコンディションがありふれた道端のゴミのように明らかになるところを受け入れましょう。

冷酷な技術の真実の王国は体系的なコードガーディアンにかかっています。間近な疑念の芽を摘み、AHCIの技量を磨き、I2Cデバイスを慎重に管理します。ミス管理されたテンソルフローグラムに取り組む—AIモデルが緊迫した矯正の必要がある特別な監視遺産。生のままの分析を呈されたって、サーバーレスのバックフィルドマシナリーが品質保証のベールを被った躁をこだます。ただいま到着、この墓所の物語に。

| SaaSラッパー | アルゴリズムの複雑度 | GPU利用率 | API遅延 (ms) | ベクターデータベースの状態 |

|---|---|---|---|---|

| ラッパーA | O(n^3) | 70% | 150 | 稼働中 |

| ラッパーB | O(n log n) | 95% | 300 | 満杯 |

| ラッパーC | O(n^2) | 82% | 250 | 故障中 |

| ラッパーD | O(1) | 60% | 50 | 安定 |

| ラッパーE | O(n) | 40% | 75 | 破損中 |

| ラッパーF | O(n^2 log n) | 88% | 400 | 危機的 |

部屋の中の象について話そう。これらのAI SaaSラッパーの多くは、新入生のコンピュータサイエンスコースすら通過できないような最適でないアルゴリズムに基づいて構築されています。O(n^2)の複雑さを持つほぼ無限ループへの依存は、データセットがスケールするときに破滅を招きます。別のバッチファイルをロードするたびに、システムを過剰に膨らませた風船のように絞めつけます。コードの最適化はタブーのように見えるが、未完成のアルゴリズムで展開の成功を期待するのは、段ボール箱から空飛ぶ車を期待するようなものです。現実を見ましょう。

AI SaaSの創業者:

あなたの言うことはわかるが、APIの遅延こそが真のボトルネックだということを思い出させてください。この種類の酷い遅延で、高速なRESTful APIを構築しようとしたことがありますか?Cloudflareは、200msのラウンドトリップハンドシェイクを永遠の待ち時間に膨らませるのを修正する魔法の杖を持っているわけではありません。顧客がより速い応答時間を求めて叫んでいるとき、数ミリ秒の遅延が死を意味することを知っているのです。複雑なキャッシングやロードバランスのスキームを気にするのではなく、スケーリングの問題が「マイクロサービス」と大声で叫べば解決すると考えているアマチュアが書いたAPIロジックを本当に改善すべきです。

セキュリティの専門家:

あなたたち二人がアルゴリズムと遅延について争っている間に、これらのSaaSラッパーがエクスプロイトのために開かれたドアになってしまったという大規模なセキュリティの脆弱性を誰も無視しています。いわゆるエンジニアたちは基本的な暗号化プロトコルすら気にしません。最初のSQLインジェクションが起こると、突然、データ漏洩がニュースに大きく報じられます。そのサブパーセキュリティが保持すると仮定して、もろい依存関係をJengaの塔のように積み重ねています。一つのスキャンで内部関係者が巨大な穴を見つけるのは驚くことではありません。簡単に言いますと、砂の城ではなく要塞を築きなさい。

Ph.D.研究者:

あなたたちの正当な指摘は、核心的な真実を変えるものではありません。効率的なアルゴリズムから始めましょう。貧弱なスケーラビリティの選択から救ってくれるCUDAのトリックはありません。この業界は、持続可能な成長よりも手軽なハックを報奨しています。すべてのバンドエイド修正が失敗したときに彼らが得る破滅を招くでしょう。時間の複雑さのグラフが抽象芸術のように見えるほど深いデバッグループは助けになりません。本当の課題は、業界が怠惰な解決策に依存することを破ることです。

AI SaaSの創業者:

わかった、アルゴリズムを最適化しろ。しかし、ベクトルデータベースのクエリ最適化のような技術では壁にぶち当たっている。絶望的な過剰な約束は、利益に害しか与えません。インデックス作成の遅延、遅い取得速度、検索の失敗が氾濫している。しかし、彼らの過剰宣伝されたAIラッパーが安物のおもちゃのようにパフォーマンスすることに誰もが驚愕している。重要な場所で改善を行い、その最大の自己を犯したAPIロジックの修正に集中しましょう。

セキュリティの専門家:

それでもここに座っているのは、セキュアなインフラストラクチャを操作しない限り、何も意味がないことを知っているからです。業界全体で、保護されていないS3バケットと広大な攻撃面の流行は悪意のあるアクターを養い続けています。データが漏れまくるシーブからモデルを提供しているのであれば、最適化や遅延は無駄な努力です。未保護のラッパーは失敗するだけではなく、精査の下で崩壊します。

結論として、これらのAI SaaSラッパーは、その創造者自身の無能さによって窒息しており、彼らが構築した混乱によって圧倒され、崩壊する運命にあります。これは議論ではなく、必然の認識です。

3つの実用的なFAQ

-

なぜAI SaaSラッパーの90%が失敗するのか

差別化ゼロ。既存のAPIに対する単なるラッパーであり、APIのレイテンシーとレート制限を無視している。派手なUIを追加しても、あなたのO(n^2)の複雑性は解決しない。 -

これらのSaaSラッパーはパフォーマンスを最適化できるか

CUDAのメモリ制限が存在しないふりをすることによって?膨れ上がったフレームワークで高価なGPUタスクを実行することは、最適化ではなく怠慢である。 -

AIサービスのより良い代替案は何か

効率を優先する堅牢なパイプラインを構築しろ。実証済みのスケーラブルな設計を用いることで、ベクターデータベースの障害を回避。派手な用語やバズワードは、エンジニアリングの卓越性に取って代わることはできない。