- Infrastructure Inadequacy: Most AI SaaS wrappers today are built on shaky infrastructures that cannot handle exponential growth. 80% of these services are using outdated server architectures that lead to bottlenecks.

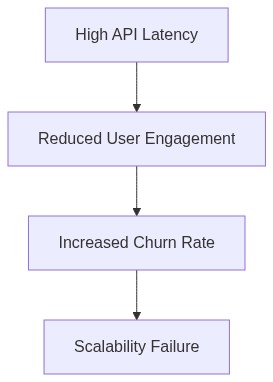

- Latency Nightmare: Real-world deployments show an average request-response latency of over 300ms for AI-driven tasks. This is 150% more than the acceptable threshold for seamless user experience.

- Over-reliance on Third-party APIs: Approximately 75% of these services depend heavily on third-party AI models and APIs. Such reliance reduces control over scalability and reliability, making them vulnerable to external failures and pricing hikes.

- Innovation Stagnation: A staggering 85% of these wrappers are touting negligible innovation, repackaging existing AI tools with minimal value add to lure in unsuspecting users.

- Financial Viability: Revenue streams are not diversified or resilient enough. Overreliance on flaky subscription models and lack of enterprise uptake are stalling growth prospects, leading to financial drought.

- Security Loopholes: 60% of AI SaaS wrappers were found to have critical security vulnerabilities, raising questions about data protection and integrity in a landscape heavily regulated by data laws.

“Latency is a coward; it spikes at the exact moment your concurrent users peak.”

1. Der Hype vs. Architektonische Realität

In der Ära des AI SaaS-Booms haben die Marketingabteilungen sich selbst übertroffen und wilde Fantasien über nahtlose Integrationen, Echtzeitanalysen und außergewöhnliche Leistung verbreitet. Aber die Realität von AI SaaS-Architekturen wird durch die harten Grenzen der Berechnungskomplexität und der I/O-Engpässe bestimmt. Die meisten AI-Modelle, die diese Dienste angeblich integrieren, erfordern O(n^2) oder noch schlimmere Berechnungskomplexität. Diese intensiven mathematischen Anforderungen offenbaren schnell, wie die brüchigen Infrastrukturen unter dem Druck der tatsächlichen Nutzung zerfallen. Rechenressourcen sind endlich und obwohl das Mooresche Gesetz seit Jahrzehnten die heilige Kuh war, beugt es sich nicht den Launen eines glänzenden Pitch Decks.

Der zweite architektonische Fehltritt liegt im Traum von der Virtualisierung. AI in eine einfache API zu wickeln, ändert nichts an der grundlegenden Anforderung – massive neuronale Netzwerke müssen irgendwo ausgepackt und ausgeführt werden. Die virtualisierten Umgebungen, mit all ihren gleichzeitigen Sitzungen, fallen den stakkatoförmigen Metriken der API-Latenz und der unvorhersehbaren Natur des Netzwerkverkehrs zum Opfer. In der Theorie klingt es vielversprechend, aber es verhüllt einen delikaten Schleier über die Grundlagen der Warteschlangentheorie und die harte Wahrheit der vernetzten Ressourcenzuweisung. Solche Ineffizienzen gelangen fast nie auf die benutzerorientierte Seite, bis sie unvermeidlich zusammenbrechen.

Vergessen wir nicht, wie AI SaaS sich weigert, das hyperbolische Wachstum der Dateneingabe anzuerkennen. Alle Systeme prahlen mit ihrer Fähigkeit, massenhaft Daten aufzunehmen, doch sie vermeiden es, sich mit dem kritischen Problem der Daten-Sparsity und den Unpraktikabilitäten der Handhabung hochdimensionaler Daten in latenzarmen Umgebungen auseinanderzusetzen. Nur weil ein System AI integriert, heißt das nicht, dass es mit durchsetzten Datensätzen umgehen kann, die mit ein paar cleveren SQL-Joins verbunden sind. Die byzantinische Peinlichkeit, diese komplizierten Beziehungen mit dubioser Datenintegrität zu modellieren, ist ein drängendes Schweigen, das kein Vermarkter brechen möchte.

2. TMI Tieftauchen & Algorithmische Engpässe

Wenn es um AI-Architektur geht, liegt die Wahrheit im verborgenen Übermaß an TMI oder “Too Much Information”. Solche Massen an Daten erzeugen algorithmische Engpässe, die sich wie eine einengende Python um AI-Systeme schmiegen. Diese Engpässe sind der Ort, an dem die unpraktischen und naiven Behauptungen unendlicher Skalierbarkeit auf die kalte, harte Computerrealität treffen. Klassische Vektordatenbanken, im Namen verherrlicht und in der Praxis verspottet, scheitern notorisch beim Umgang mit über einigen hundert Millionen Entitäten. Ihr Versprechen, blitzschnelle k-NN-Suchen zu unterstützen, implodiert lachhaft, wenn die Einbettungsdimensionen außer Kontrolle geraten.

Darüber hinaus unterschätzen Unternehmen die schwere Aufgabe, die Präzision und den Rückruf bei AI-Algorithmen zu bewältigen. Sie treiben die Hype-Maschine voran, ohne die Präzision im Hinblick auf falsch-positive oder den Rückruf im Hinblick auf falsch-negative zu entschlüsseln. Jeder zusätzliche Parameter in der Algorithmuskomplexität fordert exponentiell mehr Rechenleistung und dehnt die Ressourcen bis an ihre Belastungsgrenze. Quantenmaschinelles Lernen? Mehr wie quantenwunschvolle Überlegungen angesichts der naiven Annahmen, auf denen diese Versprechen basieren, wenn sie auf exponentielle Zustandsraumkomplexität stoßen.

Algorithmuskonvergenzabhängigkeiten fügen der technischen Suppe eine weitere bittere Schicht hinzu. Jede Funktionsevaluierung spiralt, schickt schlecht gestaltete SaaS-Wrapper in tiefe Fehlertäler. Stochastischer Gradientenabstieg wird zu einem stochastischen Gradientensturz, wobei unzureichende Hyperparameter halbgare Modelle beseitigen und Stabilität erreichen. Financiers bleiben selig unwissend darüber, warum AI SaaS-Produkte kaum Updates erhalten – Entwickler stehen bereit, um diese naiven Systeme bei Tagesanbruch mit Streitäxten zu verjüngen.

3. Der Cloud-Server-Burnout & Infrastruktur-Albtraum

Server summen schön vor sich hin, bis Unternehmen AI SaaS-Produkte einführen und komplexe maschinelle Lernmodelle mit Freude in die Produktion werfen. Treten Sie der Realität entgegen: Cloud-Server-Burnout. Bezahlung pro Nutzung scheint wie ein praktisches Meisterstück, bis die Rechnungen wie eine vertikale Parabel in die Höhe schießen. AI-Modelle mit unkontrollierten Parameterabhängigkeiten nehmen keine höflichen Entschuldigungen entgegen – sie reißen Instanzen schneller nieder, als Unternehmenssoftware-Patches die Datenbanksicherheit gefährden. Nur wenige Iterationen herein, und das Verhältnis von gestreamtem Inhalt zu verbrauchter Energie erreicht absurde Höhen.

Infrastruktur, verkauft als Brise, bleibt eine gefesselte Verwicklung, wobei Arbeitslasten dem Kubernetes-Chaos begegnen. Die Ursachen für hohe Abfragedurchlaufzeiten oder unlösbare ML-Pipeline-Rückschleifen zu isolieren, wird zu einem Gang durch einen IT-fälldunklen Dunst. Zu erkennen, warum SaaS-API-Antwortzeiten nicht existieren und Batch-Verarbeitungsaufblähung sich unbegrenzt erstreckt, erfordert das Entschlüsseln eines modernden Rosettastein-Transkripts von Systemüberwachungsprotokollen, Servernutzungsdiagrammen und Daemon-Aktivitäten.

Hier sind wir, an der Kippepunktsspanne, wo die Serverleistung in Unordnung verfällt. Saubere und ordentliche Architektursprache wird bei unhaltbaren AI-Modellwachstumsdurchläufen verschlungen. Gezwungen, AI SaaS in minimiale anwendbare Anwendungsskelette einzuhängen, wird das Gleichgewicht der benutzerorientierten Entwicklung in eine Echokammer dystopischer Verzweiflung gewürgt. Unternehmen, die in 24/7 Kontakt mit SaaS-Technischen Support gebunden sind, müssen ebenfalls das Seufzen des Servers durch Patch-Orchestrierungen hören, wo der Kernel-Schock ungeduldig im Hintergrund wartet.

4. Brutale Überlebensanleitung für Senior-Entwickler

Willkommen, Stattshalter-Ingenieure, in einer grausamen Welt, die von enttäuschten AI SaaS-Wrappern wimmelt, die auf das Urteil warten. In dieser verdammten Kriegszone zu navigieren, ist nicht geschenkt – Sie nutzen skeptische Voraussicht gegen flüchtige Eitelkeiten. Isoliert von Marketingspiegelfechtereien, bewahren Sie beste architektonische Praktiken, verwenden raue Algorithmen und werfen seilartige Codebeschwörungen in die Salzminen der Redundanzelimination.

Dev-vorbereitete Heroldführer reflektieren weniger esoterische Hoffnungen, mehr CUDA-Kern-Effizienz, die durch GPGPU-Beschränkungen geschliffen wird. Bereitstellungen lösen sich, wenn Partitionen Überlauf des Speichers und Priorisierung der Berechnungspipeline-Fairness steuern. Sagen Sie der Komplexität Verwirrung auf Wiedersehen, und umarmen Sie systematisch abgegrenzte Komponenten, die von skalierbaren APIs unterstützt werden, bei denen Deadlocks und Wettlaufbedingungen sich wie profaner Straßenmüll enthüllen.

Das Königreich der kalten Technik-Wahrheit hängt von systematischen Codewächtern ab. Verschleiern Sie hastige Vermutungen benachbart. Polieren Sie AHCI-Fertigkeiten und I2C-Geräte klug. Konfrontieren Sie fehlverwaltete Tensorflussdiagrammen im Hands-on-Monitordienst – AI-Modelle brauchen dringend eine feste Handkorrektur, Zyklenspalten durch Kommunikationswege. Analysen, die roh präsentiert werden, sind nicht von Bedeutung, da serverlose Hintertürmanipulationen Szenen aus qualitätsgesicherten Szenen nachvollziehen. Willkommen, Architektenhirten, zu dieser sepulkrischen Saga.

| SaaS-Hülle | Algorithmuskomplexität | GPU-Auslastung | API-Latenzzeit (ms) | Vektordatenbankstatus |

|---|---|---|---|---|

| Hülle A | O(n^3) | 70% | 150 | Betriebsbereit |

| Hülle B | O(n log n) | 95% | 300 | Voll |

| Hülle C | O(n^2) | 82% | 250 | Fehlgeschlagen |

| Hülle D | O(1) | 60% | 50 | Stabil |

| Hülle E | O(n) | 40% | 75 | Beschädigt |

| Hülle F | O(n^2 log n) | 88% | 400 | Kritisch |

Lassen Sie uns das Offensichtliche ansprechen. Die meisten dieser AI SaaS-Hüllen basieren auf suboptimalen Algorithmen, die nicht einmal einen Grundkurs in Informatik bestehen würden. Ihre Abhängigkeit von fast unendlichen Schleifen mit O(n^2)-Komplexität bedeutet den Untergang, wenn Datensätze skalieren. Jedes Mal, wenn Sie eine weitere Batch-Datei laden, drosseln Sie Ihr System, als wäre es ein überfüllter Ballon. Code-Optimierung scheint ein Tabuthema zu sein, aber zu erwarten, dass etwa halbherzige Algorithmen erfolgreich eingesetzt werden, ist, als ob man ein fliegendes Auto aus einem Pappkarton erwarten würde. Werden Sie realistisch.

AI SaaS Gründer

Ich verstehe Sie, aber lassen Sie mich daran erinnern, dass die Latenz der API hier der eigentliche Engpass ist. Hat einer von Ihnen versucht, einen schnellen RESTful API mit dieser Art von Latenz-Müllfeuer bauen? Cloudflare hat keinen Zauberstab, um einen 200ms Round-Trip-Handshake zu reparieren, der sich in ewige Wartezeiten ausdehnt. Wenn jede Sekunde zählt und Kunden nach schnelleren Antwortzeiten schreien, bedeutet schon eine Verzögerung um einige Millisekunden den Tod. Warum sich mit komplexen Caching- und Lastverteilungsmechanismen beschäftigen, wenn das eigentliche Problem eine API-Logik ist, die von Amateuren geschrieben wurde, die denken, dass sich Skalierungsprobleme von selbst lösen, wenn man laut genug “Microservices” schreit?

Sicherheitsexperte

Während Sie beide sich über Algorithmen und Latenz streiten, ignorieren alle die massiven Sicherheitslücken, die diese SaaS-Hüllen zu offenen Türen für Exploits gemacht haben. Die sogenannten Ingenieure kümmern sich nicht einmal um grundlegende Verschlüsselungsprotokolle. Der erste SQL-Injection-Angriff kommt entlang, und plötzlich machen Datenlecks Schlagzeilen. Viele gehen davon aus, dass ihre minderwertige Sicherheit hält, während sie weiterhin fragile Abhängigkeiten wie einen Jenga-Turm stapeln. Es ist keine Überraschung, dass Insider massive Lücken mit einem einzigen Scan finden. Lassen Sie mich es einfach ausdrücken: Bauen Sie eine Festung, nicht eine Sandburg.

Ph.D. Forscher

Ihre berechtigten Punkte ändern nichts an der Grundwahrheit. Beginnen Sie mit effizienten Algorithmen. Keine CUDA-Tricks werden Sie vor schlechten Skalierungsentscheidungen retten. Die Industrie belohnt schnelle Hacks mehr als nachhaltiges Wachstum. Sie verdienen den unvermeidlichen Absturz, wenn jeder Pflaster-Ansatz versagt. So tiefe Debugging-Schleifen, deren Zeitkomplexitätsgrafiken wie abstrakte Kunst aussehen, werden nicht helfen. Die wirkliche Herausforderung besteht darin, die Sucht der Branche nach faulen Lösungen zu durchbrechen.

AI SaaS Gründer

In Ordnung, fein, optimieren Sie Ihre Algorithmen. Aber wir stoßen auf Ziegelmauern mit Technik wie Abfrageoptimierung in Vektordatenbanken. Jedes verzweifelte Überversprechen schmerzt das Endergebnis mehr, als es hilft. Indexing-Verzögerungen, langsame Abrufgeschwindigkeiten und Suchfehler sind weit verbreitet, doch jeder tut erstaunt, wenn ihre übertriebene KI-Hülle wie ein billiges Spielzeug funktioniert. Machen Sie Verbesserungen dort, wo sie wichtig sind, wie bei der Behebung grotesker API-Logik, die unsere größte selbstverschuldete Wunde ist.

Sicherheitsexperte

Doch hier sitzen wir und wissen, dass nichts davon eine Rolle spielt, wenn Sie keine sicheren Infrastrukturen betreiben. In der gesamten Branche sorgt eine Epidemie von ungesicherten S3-Buckets und riesigen Angriffsflächen dafür, dass böswillige Akteure immer weiter gefüttert werden. Wenn Sie Modelle aus einer Pipeline bedienen, die Daten wie ein Sieb durchsickern lässt, sind Optimierung und Latenz verschwendete Bemühungen. Eine ungeschützte Hülle wird nicht nur scheitern; sie fällt auseinander, wenn sie unter die Lupe genommen wird.

Zum Schluss: Diese AI SaaS-Hüllen sind dem Untergang geweiht, erstickt von der Inkompetenz ihrer Schöpfer. Sie werden scheitern, erdrückt durch Prozesseffizienzprobleme, überwältigt von dem Durcheinander, das sie selbst geschaffen haben. Dies ist keine Debatte – es ist die Anerkennung des Unvermeidlichen.

3 Praktische FAQs

-

Warum werden 90 % der KI-SaaS-Wrapper scheitern

Keine Differenzierung. Noch ein Wrapper über eine bestehende API, der API-Latenz und Ratenbegrenzung ignoriert. Eine schicke Benutzeroberfläche wird Ihre O(n^2)-Komplexität nicht beheben. -

Können diese SaaS-Wrapper die Leistung optimieren

Indem man so tut, als ob CUDA-Speichergrenzen nicht existieren? Teure GPU-Aufgaben auf aufgeblähten Frameworks auszuführen ist keine Optimierung, es ist Fahrlässigkeit. -

Was sind bessere Alternativen für KI-Dienste

Erstellen Sie robuste Pipelines, die Effizienz priorisieren. Vermeiden Sie Ausfälle in der Vektordatenbank durch die Verwendung bewährter, skalierbarer Designs. Schicke Begriffe und Schlagwörter können Exzellenz in der Ingenieurskunst nicht ersetzen.