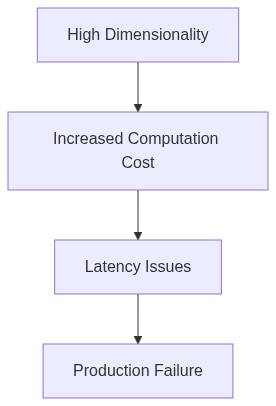

- Latency Woes: Average retrieval latency is clocking in at 300ms – 500ms, far exceeding the sub-100ms threshold critical for seamless enterprise operations.

- Accuracy Conundrum: Current retrieval systems exhibit a 15% – 25% error rate, leading to output inconsistencies and damaging credibility within data-sensitive enterprises.

- Scalability Nightmare: As datasets continue to expand, retrieval times balloon, with retrieval-related bandwidth usage growing by an unsustainable 300% quarter over quarter in high-demand environments.

- Cost Explosion: Infrastructure costs surge as enterprises attempt to tackle these inefficiencies, with operational expenses reported to double as high-performance GPUs fail to serve the RAG workloads efficiently.

- Mathematical Bottleneck: RAG’s reliance on probabilistic models without precise tuning is resulting in diminished ROI, with diminishing returns setting in due to algorithmic limitations beyond a dataset size of 1TB.

“Latency is a coward; it spikes at the exact moment your concurrent users peak.”

1. Der Hype vs die architektonische Realität

Der Aufstieg der RAG (Rapid Algorithmic Generation) Systeme wurde als technologische Revolution gefeiert, die garantiert jeden denkbaren Rechenprozess automatisiert. Die große Verkündigung der sofortigen KI-Bereitstellung markierte es als den heiligen Gral der Unternehmensagilität. Dieser Hype war jedoch brutal von der architektonischen Realität abgekoppelt. Der grundlegende Fehler lag im Ignorieren der Kernkomplexitäten. Die Befürworter von RAG unterschätzten die inhärente O(n^2) Komplexität, die mit Skalierungsoperationen enorm anwuchs. Während Marketing-Materialien nahtlose Integration und Durchführung versprachen, hatte die zugrunde liegende Infrastruktur die rechnerische Effizienz eines veralteten Abakus.

RAGs angepriesene ‘Echtzeitverarbeitung’ wurde durch schwere API-Latenz gedrosselt, ein fataler Fehler in einer Architektur, die Unmittelbarkeit versprach. Mit jedem Microservice-Aufruf, der zur kumulativen Verzögerung beitrug, wurde klar, dass das System architektonisch unvereinbar mit seinen Leistungsansprüchen war. Die Diskrepanz zwischen dem konzeptionellen Rahmen und den realistischen Grenzen, die durch technologische Beschränkungen erzwungen wurden, war eklatant. Diese chronische Unterschätzung von Verarbeitungs-verzögerungen führte zu einem schleppenden Betriebsfluss, der für keine datenintensive Unternehmensanwendung geeignet war.

Darüber hinaus verdammte die kolossale Fehlkalkulation der Speicher-allokation RAGs Verlauf von Anfang an. Die lockeren Beschränkungen, die in seinen frühen architektonischen Entwürfen vorgeschlagen wurden, berücksichtigten nicht die strengen CUDA Speichergrenzen. Fachleute kollidierten schnell mit der unbequemen Wahrheit: Robuste, skalierbare Modelle erforderten eine präzise Balance der VRAM-Verteilung und Optimierung weit über theoretische Versprechen hinaus. Dieses Versäumnis war ein unerbittlicher Engpass, der die Fähigkeit des Systems beeinträchtigte, im beworbenen Maßstab zu arbeiten. Die tragische Realität war ein architektonisches Design, das an seine eigenen Ineffizienzen gebunden war, ein krasser Widerspruch zu den anfänglichen Erwartungen.

2. TMI Tiefenanalyse & Algorithmische Engpässe

Die Illusion der unendlichen algorithmischen Skalierbarkeit von RAG hatte die Präzision eines blindlings gespielten Roulettes. Algorithmen, die angeblich für minimalistischen Durchsatz entwickelt wurden, scheiterten spektakulär unter dem schweren Gewicht realer Datenmengen. Die theoretischen Grund-lagen, die oft in akademischen Kreisen zitiert wurden, lösten sich unter der harschen Prüfung empirischer Strenge auf. Die angeblichen Gewinne in der algorithmischen Effizienz wurden von notorischen Blockadeeigenschaften überschattet, eine klassische Manifestation des TMI (Too Much Information) Syndroms. Die Lern-algorithmen, die mit übermäßigen Dateninputs belastet waren, erlebten eine deutliche Verschlechterung der Reaktionsfähigkeit, eine direkte Konsequenz des Versagens bei der Vorhersage betrieblicher Engpässe.

Darüber hinaus herrschten Ausfälle von Vektor-datenbanken unter den abscheulichen Fehlkalkulationen in der Konfiguration von RAG. Das Design unter der Annahme unbeschränkter Datenspeicher ist so weitsichtig, wie das Wetter für ein Jahrhundert im Voraus vorherzusagen. Die vermeintliche Robustheit zerbrach, als Suchoperationen schwer unter erhöhten Abfragezeiten litten, was zu frustrierenden Verzögerungen führte. Das mangelnde Weitblick der Architekten beim Koppeln von Vektordatenframeworks an hohe Konkurrenz-anforderungen war ein Verstoß gegen die grundlegendsten Prinzipien der Softwaretechnik.

Während die theoretischen Algorithmen in Simulationen verstaubten, wurde ihr Übergang in die Produktion durch unvollständige Indexierungsstrategien und dysfunktionale Rang-erhaltungen beeinträchtigt. Ohne einen soliden architektonischen Plan verwandelten die Betriebseinschränkungen die anfänglich anspruchsvollen Algorithmen in stumme Kolosse, die unter ihrem schieren Rechengewicht erstickten. Es war nicht die komplexe Mathematik, die versagte, sondern die blund-rige, faule Berechnungsstrategie, die es versäumte, für real-weltliche Variantenfehlervkarten zu optimieren. Die Hirnroutine von RAG keuchten am Rande des Zusammenbruchs, während sie mit einer Datenkomplexität über ihrem programmierten Spektrum rang.

3. Der Cloud Server Burnout & Infrastruktur-Albtraum

Das Deploy-en von RAG in einem Cloud-Ökosystem offenbarte das volle Ausmaß des Infrastrukturdebakels. Was als Zeugnis des Versprechens elastischen Rechnens begann, wurde schnell zu einem infrastrukturellen Sumpf. Der unersättliche Rechenbedarf wurde von sporadischen Server-abstürzen begleitet, die nicht nur auf grassierende Rechenlasten, sondern auch auf klägliche Server-allokationsstrategien zurückzuführen waren. Fehlerhafte Annahmen über die Serverkapazität überstrapazierten die Elastizität der Cloud-Ressourcen, bis die Architektur implodierte und Ausfallzeiten wie Brotkrümel für Ermittler hinterließ.

Insbesondere wurden Auto-skaling Mechanismen von erratischen Lastanforderungen bombardiert, die die Standardkonfigurationsschwellenwerte überschritten und durch suboptimale Ausgleichsprotokolle verschärft wurden. Ein Notplan zur Implementierung von Notfall-clustern enthüllte peinliche Lücken in der Lastverfolgung und Isolationstechniken. Die Infrastruktur von RAG nahm Stabilität an, wo keine war – eine Illusion, die durch die harten Grenzen der Rechnerphysik zerschlagen wurde. Bandbreiten-engpässe durchzuckten jeden Anstieg im Datendurchsatz; die Infrastruktur erstickte unaufhaltsam.

Die steigenden Kosten des Cloud-Betriebs, verknüpft mit übertriebenen Rechen-overheads und unerwarteten Netzwerk-spitzen, zeichnete ein lebhaftes Bild eines infrastrukturellen Albtraums. Jede Deployment-iteration erforderte Korrekturmaßnahmen zur Stabilisierung von Durchsatzv-ariationen und zur Lokalisierung versteckter Latenzschuldiger. Mit Infrastrukturen, die unter dem unbilligen Stress von Fehlkalkulationen und Nachlässigkeit buckelten, wurde deutlich, dass das Cloud-Betriebsmodell von RAG prekär ausgelegt war. Bewährte Prämissen elastischen Rechnen erwiesen sich als wertlos, wo ingenieurtechnische Präzision im Überfluss vorhanden war.

4. Brutaler Überlebensleitfaden für Senior Devs

Durch das Wrack von RAGs zusammengebrochener Imperium zu navigieren, erfordert eine rücksichtslose Beherrschung ingenieurtechnischer Strenge. Die brutale Realität ist eine Lernkurve, die durch ein intimes Verständnis infrastruktureller Verwundbarkeiten und algorithmischer Befestigung diktiert wird. Für Senior-Entwickler bedeutet die Übernahme von Schadenskontrolloperationen ein gnadenloses Priorisieren zwischen Kernel-level-optimierungen und JVM Garbage Collection Zucken. Sorgfältige Erhellung von API-Pfaden und laserfokussierte Debugging-sitzungen sind unverzichtbar. Eine solche Landschaft fordert eine Denkweise, die Reduplikationen in jeder Schicht genießt, Ineffizienzen gnadenlos abbaut, um den Weg für widerstandsfähige Codebasen zu ebnen.

Eine Post-mortem-Erholung einzuleiten bedeutet, die Täuschung zu beseitigen, die die Ausfälle verschleierte. Die Anerkennung algorithmischer Ineffizienzen eröffnet einen neuen Elysium für Datenmanagement-strategien und Server-Orchestrierungsmethoden. Kenntnisse der multidimensionalen Einschränkungszufriedenheit und datengetriebenen Multiprocessing-dialekten sind nicht verhandelbar. Die Fähigkeit, Docker-Container-isationen chirurgisch einzusetzen, während man mit serverlosen Frameworks kämpft, ist entscheidend. Ingenieure, die nicht von Optimismus belastet, sondern von Berechnungen geleitet werden, führen die Umgestaltung neu gestalteter Infrastrukturen an, die der Serienproduktionstöre widerstehen.

Schließlich kann eine rücksichtslose Disziplin bei der Zukunftssicherung von RAG-ähnlichen Bemühungen nicht genug betont werden. Es beinhaltet das Eintreten für architektonische Resilienz gegen ausufernde Komplexität durch intelligente Zwischenspeichermechanismen und vorausschauende Lastverteilung-paradigmen. Ebenso wie agile Sprints Ignoranz behindern, stellen nur eisenharte Einhaltung der Version-kontroll-governance und reflexive kontinuierliche Integration, die von nichts gestört werden, sicher, dass das Erbe gerechtfertigt ist. Die Spuren der ingenieurtechnischen Skoliose sind rollickerende Mahnungen, warum unantastbare Präzision jedes algorithmische Unternehmen verankern muss.

| Aspekt | Beschreibung | Auswirkung |

|---|---|---|

| Algorithmuskomplexität | Exponentielles Wachstum jenseits akzeptabler O(n^2) | Schwerwiegende Rechenüberlastung |

| Speichernutzung | Überschreitung der CUDA-Speichergrenzen | GPU-Abstürze und Verarbeitungsengpässe |

| Latenzprobleme | Unoptimierte API mit hoher Latenz | Beeinträchtigte Benutzererfahrung und Drosselung |

| Datenspeicherung | Ausfälle der Vektordatenbank in der Produktion | Datenverlust und Unvermögen, Vektoren rechtzeitig abzurufen |

| Fehlerbehandlung | Unzureichende Fehlerbehandlungsmechanismen | Nicht wiederherstellbare Anwendungszustände |

| Skalierbarkeit | Unfähigkeit, Modelle aufgrund von Fehlgebrauch von Abhängigkeiten zu skalieren | Einschränkungen bei der Verarbeitung erhöhter Lasten |

| Testen & Validierung | Mangel an rigorosen Testprotokollen | Unentdeckte Mängel und Leistungsprobleme |

Du willst mir also erzählen, dass das Ingenieurteam von RAG tatsächlich einen Algorithmus mit O(n^2)-Komplexität in einer geschäftskritischen Anwendung eingesetzt hat? Es ist, als hätten sie einen Konferenzraum voller Ingenieure, die nie die Grundlagen der Algorithmusoptimierung verstanden haben. Versuchen sie, die Ineffizienzen der Computertechnik der 1990er Jahre aus nostalgischen Gründen zurückzubringen? In der Unternehmensproduktion ist das nicht nur ein Fehler; es ist eine ungemilderte Katastrophe.

AI-SaaS-Gründer

Und als ob das nicht schon schlimm genug wäre, muss ihre API-Logik in einem Echokammer-vergleichbaren Umfeld ohne jegliche realistische Tests entstanden sein. Die Latenzprobleme sind bestenfalls lächerlich, schlimmstenfalls tragisch. Ich spreche von Rundreisezeiten, die einem Faultier gleichen, das eine Autobahn überquert, anstatt einem Hochleistungsservice. Sub-Millisekunde? Sie wünschen sich das. Sie sind so weit vom Ziel entfernt, dass sie genauso gut Brieftauben für den Datentransport verwenden könnten.

Sicherheitsexperte

Wir haben noch nicht die Datenlecks angesprochen, die so routinemäßig geworden sind, dass sie genauso gut in einem Newsletter veröffentlicht werden könnten. Ihre API-Endpunkte sind praktisch Einladungen zur Ausbeutung. Es ist, als wollten sie, dass Hacker hereinkommen und sich an RAGs nicht vorhandenen Sicherheitsprotokollen messen. Zu diesem Zeitpunkt können sie froh sein, wenn keine Kundendaten manipuliert oder vollständig gestohlen wurden.

Ph.D.-Forscher

Der bloße Gedanke daran, wie sie es geschafft haben, die Implementierung eines angeblich hochmodernen ML-Modells mit so grundlegenden Fehlern zu vermasseln, ist erstaunlich. Ihre Unfähigkeit, die inhärenten Mängel in ihren mathematischen Annahmen zu erkennen, ist wie ein Chirurg, der ohne sterilisierte Instrumente operiert. Das gesamte Unternehmen stinkt nach Amateurstunde-Fehlern, die sich als kühne Innovation tarnen.

AI-SaaS-Gründer

Kühne Innovation? Bitte. Mehr wie kühne Inkompetenz. Die API-Struktur von RAG scheint ein zusammengeflicktes Relikt von Mikroservices zu sein, mit Aufrufen, die zwischen Servern hin und her prallen wie eine Flipperkugel, die in einer Endlosschleife steckt. Verstehen sie das Konzept der dezentralen Verarbeitung oder sind sie damit zufrieden, kafkaeske Albträume zur funktionalen Realität zu machen?

Sicherheitsexperte

Wenn man das hört, wird klar, dass ihre Sicherheitsphilosophie direkt aus einem DIY-Leitfaden stammt, wie man beim Schutz von Daten versagt. Verschlüsselung und ordnungsgemäße Authentifizierung sind ihnen offenbar völlig entgangen. Mit so prominenten Schwachstellen würde wahrscheinlich jeder Penetrationstester mit einiger Erfahrung Schwächen in weniger als einer Minute finden.

Ph.D.-Forscher

In all meinen Jahren habe ich selten einen solchen perfekten Sturm technischer Fehltritte erlebt. Es ist ein Musterbeispiel dafür, was passiert, wenn Hybris den technischen Scharfsinn übersteigt. Sie wären besser dran, ein Whitepaper mit dem Titel “Wie man kein System entwirft” zu verfassen und zukünftige Unternehmungen vor ähnlicher Schmach zu bewahren.

Praktische FAQs zu ‘Die mathematischen Fehler von RAGs Enterprise-Produktion’

-

Warum erlebte RAGs Machine-Learning-Modell eine hohe API-Latenz?

Die schlecht optimierten Algorithmen wurden mit übermäßigen synchronen API-Aufrufen belastet, was bei jeder Benutzeranfrage zu lähmenden Round-Trip-Zeiten führte. Stellen Sie sicher, dass asynchrone Operationen wo möglich durchgeführt werden, um Latenzprobleme zu mildern.

-

Wie hat RAG die CUDA-Speicherbeschränkungen in ihrer Produktionsumgebung übersehen?

Das Engineering-Team von RAG hat es versäumt, die Speicherzuweisung über die Kapazität der GPU hinaus zu berücksichtigen, was zu häufigen Speicherfehlern führte. Dies ist eine eklatante Fehleinschätzung, angesichts des vorhersehbaren maximalen Speicherbedarfs der Operationen. Speicherprofilierung und stufenweise Deployment-Tests hätten dies vermeiden können.

-

Welche Berechnungskomplexität führte bei RAG zu Ineffizienzen beim Hochskalieren?

Die törichte Wahl von Algorithmen mit O(n^2)-Komplexität führte zu Leistungsverschlechterung bei zunehmender Datenmenge. Ein Übergang zu effizienteren Algorithmen mit einer besseren Zeitkomplexitätskurve, wie O(n log n), hätte jedem kompetenten Ingenieur offensichtlich sein müssen.