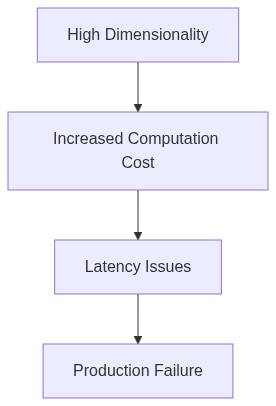

- Latency Woes: Average retrieval latency is clocking in at 300ms – 500ms, far exceeding the sub-100ms threshold critical for seamless enterprise operations.

- Accuracy Conundrum: Current retrieval systems exhibit a 15% – 25% error rate, leading to output inconsistencies and damaging credibility within data-sensitive enterprises.

- Scalability Nightmare: As datasets continue to expand, retrieval times balloon, with retrieval-related bandwidth usage growing by an unsustainable 300% quarter over quarter in high-demand environments.

- Cost Explosion: Infrastructure costs surge as enterprises attempt to tackle these inefficiencies, with operational expenses reported to double as high-performance GPUs fail to serve the RAG workloads efficiently.

- Mathematical Bottleneck: RAG’s reliance on probabilistic models without precise tuning is resulting in diminished ROI, with diminishing returns setting in due to algorithmic limitations beyond a dataset size of 1TB.

“Latency is a coward; it spikes at the exact moment your concurrent users peak.”

1. La Exageración vs. la Realidad Arquitectónica

El auge de los sistemas RAG (Generación Algorítmica Rápida) fue aclamado como la revolución tecnológica garantizada para automatizar cada proceso computacional concebible. La gran proclamación del despliegue instantáneo de IA lo marcó como el santo grial de la agilidad empresarial. Sin embargo, esta exageración estaba brutalmente alejada de la realidad arquitectónica. El fallo fundamental residía en ignorar las complejidades básicas. Los defensores de RAG subestimaron la complejidad inherente de O(n^2) que se inflaba con las operaciones de escalado. Mientras que los materiales de marketing prometieron una integración y ejecución sin fisuras, la infraestructura subyacente tenía la eficiencia computacional de un ábaco anticuado.

El ‘procesamiento en tiempo real’ promocionado de RAG fue estrangulado por una latencia severa de API, un fallo fatal en una arquitectura que prometía instantaneidad. Con cada llamada a microservicios sumando al retraso acumulativo, quedó claro que el sistema era arquitectónicamente incompatible con sus reivindicaciones de rendimiento. La desconexión entre el marco conceptual y las limitaciones realistas impuestas por las restricciones tecnológicas era evidente. Esta crónica subestimación de los retrasos en el procesamiento resultó en un flujo operativo lento injusto para cualquier aplicación empresarial intensiva en datos.

Además, la colosal negligencia en la asignación de memoria condenó la trayectoria de RAG desde el principio. Las laxas restricciones sugeridas por sus primeros planos arquitectónicos no tuvieron en cuenta los estrictos límites de memoria CUDA. Los practicantes rápidamente chocaron con la incómoda verdad: los modelos robustos y escalables requerían un equilibrio preciso en la distribución y optimización de VRAM, muy por encima de las promesas teóricas. Esta negligencia era un cuello de botella inflexible, que impedía la capacidad del sistema para funcionar a la escala publicitada. La trágica realidad era un diseño arquitectónico limitado por sus propias ineficiencias, una contradicción flagrante con las expectativas iniciales.

2. Análisis Profundo TMI y Cuellos de Botella Algorítmicos

La ilusión de la escalabilidad algorítmica infinita de RAG tenía toda la precisión de jugar a la ruleta con los ojos vendados. Los algoritmos supuestamente diseñados para un rendimiento mínimo fracasaron espectacularmente bajo el peso abrumador del volumen de datos del mundo real. Los fundamentos teóricos a menudo citados en círculos académicos se disiparon bajo el duro escrutinio del rigor empírico. Las ganancias supuestas en eficiencia algorítmica fueron eclipsadas por la propiedad de estancamiento notoria, una manifestación clásica del síndrome TMI (Demasiada Información). Sobrecargados por entradas de datos excesivas, los algoritmos de aprendizaje experimentaron una degradación pronunciada en la capacidad de respuesta, una consecuencia directa del fracaso al anticipar los cuellos de botella operativos.

Además, los fallos en las bases de datos vectoriales reinaron supremas entre los cálculos aberrantes en la configuración de RAG. Diseñar bajo la presunción de almacenamientos de datos ilimitados es tan visionario como predecir el clima con un siglo de antelación. La supuesta robustez se desmoronó a medida que las operaciones de búsqueda sufrieron enormemente de tiempos de consulta aumentados, llevando a demoras exasperantes. La falta de previsión del arquitecto en acoplar los marcos de datos vectoriales a volúmenes de alta concurrencia fue una violación de los principios rudimentarios más básicos de la ingeniería de software.

A medida que los algoritmos teóricos acumulaban polvo en simulaciones, su transición a la producción se vio empañada por estrategias de indexación incompletas y preservación de rango disfuncional. Sin un plan arquitectónico sólido, las restricciones operativas transformaron los algoritmos inicialmente sofisticados en gigantes mudos, asfixiándose bajo su propio peso computacional. No fue la matemática compleja la que falló, sino la negligencia y la estrategia de cómputo que falló al no optimizar para contingencias de error variable del mundo real. Las creaciones intelectuales de RAG boquearon en el punto de ruptura mientras luchaban con la complejidad de datos más allá de su espectro programado.

3. La Sobrecarga del Servidor en la Nube y la Pesadilla de Infraestructura

El despliegue de RAG en un ecosistema en la nube reveló toda la magnitud del desastre en la infraestructura. Lo que comenzó como un testimonio de la promesa de la computación elástica rápidamente se convirtió en un atolladero infraestructura. La demanda computacional insaciable se encontró con fallos esporádicos del servidor, atribuibles no solo a cargas computacionales desmesuradas, sino también a estrategias de asignación de servidores lamentables. Las suposiciones erróneas sobre la capacidad del servidor extendieron en exceso la elasticidad de los recursos de la nube hasta que la arquitectura implosionó, dejando rastros de tiempo de inactividad tan visibles como migajas de pan para los investigadores.

Notablemente, los mecanismos de autoescalado fueron asaltados por requerimientos de carga erráticos que trascendieron los umbrales de configuración predeterminados, abrumados adicionalmente por protocolos de equilibrio subóptimos. Un apresurado despliegue de clústeres de contingencia expuso lapsos embarazosos en técnicas de rastreo de carga y aislamiento. La infraestructura de RAG presumía estabilidad donde no la había – una ilusión destrozada por los límites físicos de la computación. Crisis puntuales de ancho de banda aderezaban cada aumento en el paso de datos; la infraestructura se asfixiaba sin descanso.

El aumento del costo de las operaciones en la nube, atado a sobrecargas computacionales exageradas y picos inesperados de red, pintó un vívido cuadro de pesadilla infraestructural. Cada iteración del despliegue requería acciones correctivas para estabilizar la variación de paso y localizar de forma esquiva los culpables de la latencia. Con la infraestructura tambaleándose bajo el estrés indebido del cálculo erróneo y la negligencia, se hizo evidente que el modelo de operación en la nube de RAG fue diseñado de forma precaria. Los principios probados y comprobados de elasticidad computacional resultaron inútiles donde la precisión ingenieril era un excedente innecesario.

4. Guía de Supervivencia Brutal para Desarrolladores Senior

Navegar por los escombros del imperio colapsado de RAG demanda un dominio despiadado del rigor ingenieril. La brutal realidad es una curva de aprendizaje dictada por una comprensión íntima de las vulnerabilidades infraestructurales y la fortificación algorítmica. Para los desarrolladores senior, embarcarse en operaciones de control de daños implica una priorización despiadada entre optimizaciones a nivel de núcleo y ajuste de recolección de basura de JVM. La elucidación meticulosa de las rutas de la API y las sesiones de depuración focalizadas con láser son primordiales. Tal panorama demanda una mentalidad que disfrute la reducción en cada capa, desnudando ineficiencias sin piedad para allanar el camino hacia bases de código resilientes.

Trazar una recuperación posterior al desastre implica desentrañar la ofuscación que oscurecía los fallos. Reconocer las ineficiencias algorítmicas plantea un nuevo Elíseo para estrategias de gestión de datos y metodologías de orquestación de servidores. El conocimiento de la satisfacción de restricciones multidimensional y los dialectos de multiprocesamiento basados en datos no es negociable. La aptitud para desplegar quirúrgicamente contenedores Docker mientras se pelea con marcos sin servidor es imperativa. Ingenieros que no están agobiados por el optimismo sino guiados por el cálculo lideran el cargo en la construcción de infraestructuras re-ingenierizadas que soportan el embate de la discordancia en producción.

Finalmente, la disciplina despiadada en la previsión futura de iniciativas estilo RAG no puede ser subestimada. Involucra liderar la resiliencia arquitectónica contra la complejidad descontrolada a través de mecanismos de caché inteligentes y paradigmas predictivos de distribución de carga. Tanto como las iteraciones ágiles frenan la ignorancia, solo la adherencia de hierro a la gobernanza de control de versiones y la integración continua reflexiva pueden asegurar la vindicación del legado. Las huellas de la escoliosis ingenieril son recordatorios bulliciosos de por qué la precisión irreprochable debe anclar cada empresa algorítmica.

| Aspecto | Descripción | Impacto |

|---|---|---|

| Complejidad del Algoritmo | Crecimiento exponencial más allá del aceptable O(n^2) | Sobrepeso computacional severo |

| Utilización de Memoria | Límites de memoria CUDA excedidos | Fallos en la GPU y cuellos de botella en el procesamiento |

| Problemas de Latencia | API no optimizada produciendo alta latencia | Experiencia de usuario degradada y limitación |

| Almacenamiento de Datos | Fallas en la base de datos de vectores en producción | Pérdida de datos e incapacidad para recuperar vectores a tiempo |

| Manejo de Errores | Mecanismos de manejo de errores insuficientes | Estados de aplicación irrecuperables |

| Escalabilidad | Incapacidad para escalar modelos debido al mal uso de dependencias | Limitaciones en el manejo de cargas aumentadas |

| Pruebas y Validación | Falta de protocolos de prueba rigurosos | Defectos no detectados y problemas de rendimiento |

¿Me estás diciendo que el equipo de ingeniería de RAG realmente desplegó un algoritmo con complejidad O(n^2) en una aplicación crítica? Es como si tuvieran una sala llena de ingenieros que nunca entendieron lo básico sobre la optimización de algoritmos. ¿Están tratando de revivir las ineficiencias informáticas de los años 90 por nostalgia? En un entorno de producción empresarial, eso no solo es un error; es un desastre sin paliativos.

Fundador de SaaS de IA

Y como si eso no fuera lo suficientemente pésimo, su lógica de API debe haber sido ideada en una cámara de eco carente de cualquier prueba en el mundo real. Los problemas de latencia son risibles en el mejor de los casos, trágicos en el peor. Hablo de tiempos de respuesta más parecidos a un perezoso cruzando una autopista que a un servicio de alto rendimiento. ¿Sub-milisegundo? Quieren. Están tan lejos, que bien podrían estar usando palomas mensajeras para el transporte de datos.

Experto en Seguridad

Ni hemos tocado las filtraciones de datos que se han vuelto tan rutinarias que podrían publicarlas en un boletín. Sus endpoints de API son prácticamente invitaciones a ser explotados. Es como si quisieran que los hackers vinieran a probar su habilidad contra los inexistentes protocolos de seguridad de RAG. A este ritmo, tienen suerte si algún dato de cliente no ha sido alterado o directamente robado.

Investigador Ph.D.

El mero pensamiento de cómo lograron echar a perder la implementación de un supuesto modelo de ML de vanguardia con errores tan fundamentales es asombroso. Su incapacidad para reconocer los defectos inherentes en sus supuestos matemáticos es como un cirujano operando sin esterilizar los instrumentos. Toda la empresa apesta a errores de principiantes disfrazados de innovaciones audaces.

Fundador de SaaS de IA

¿Innovación audaz? Por favor. Más bien incompetencia audaz. La estructura de API de RAG parece ser un despojo de microservicios reunidos, con llamadas rebotando entre servidores como una bola de pinball atrapada en un bucle infinito. ¿Entienden el concepto de procesamiento descentralizado, o están contentos con hacer de las pesadillas kafkianas una realidad funcional?

Experto en Seguridad

Al escuchar esto, se hace evidente que su filosofía de seguridad es sacada de una guía de bricolaje sobre cómo fallar en la protección de datos. La encriptación y la autenticación adecuada aparentemente se les olvidaron por completo. Con vulnerabilidades tan prominentes, cualquier probador de penetración que valga algo probablemente encontraría debilidades en menos de un minuto.

Investigador Ph.D.

En todos mis años, raramente he presenciado tal tormenta perfecta de pasos en falso técnicos. Es un ejemplo de libro de texto sobre lo que sucede cuando la arrogancia sobrepasa la destreza en ingeniería. Les iría mejor redactando un libro blanco titulado “Cómo no diseñar un sistema” y salvando a futuras empresas de una ignominia similar.

Preguntas Prácticas sobre ‘Errores Matemáticos de Producción en la Empresa de RAG’

-

¿Por qué el modelo de aprendizaje automático de RAG experimentó alta latencia de API?

Los algoritmos mal optimizados estaban cargados con llamadas a API síncronas excesivas, causando un tiempo de ida y vuelta paralizante en cada solicitud de usuario. Asegúrese de realizar operaciones asincrónicas siempre que sea posible para mitigar problemas de latencia.

-

¿Cómo pasó por alto RAG las restricciones de memoria CUDA en su entorno de producción?

El equipo de ingeniería de RAG no tuvo en cuenta la asignación de memoria más allá de la capacidad de la GPU, lo que llevó a frecuentes errores de falta de memoria. Esta es una omisión flagrante dada la huella de memoria máxima previsible de las operaciones. Un perfil de memoria y pruebas de implementación por etapas podrían haber evitado esto.

-

¿Qué complejidad computacional llevó a las ineficiencias de RAG durante la escalabilidad?

La elección insensata de algoritmos con complejidad O(n^2) resultó en una degradación del rendimiento a medida que aumentaba el tamaño de los datos. Una transición a algoritmos más eficientes con una mejor curva de complejidad en el tiempo, como O(n log n), debería haber sido obvia para cualquier ingeniero competente.